Gemini uczy teraz przez interaktywne obrazy. To zmienia wszystko

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Pamiętasz te podkreślenia w podręczniku? Notatki na marginesach? Gemini">Gemini właśnie przeniosło to do świata AI.

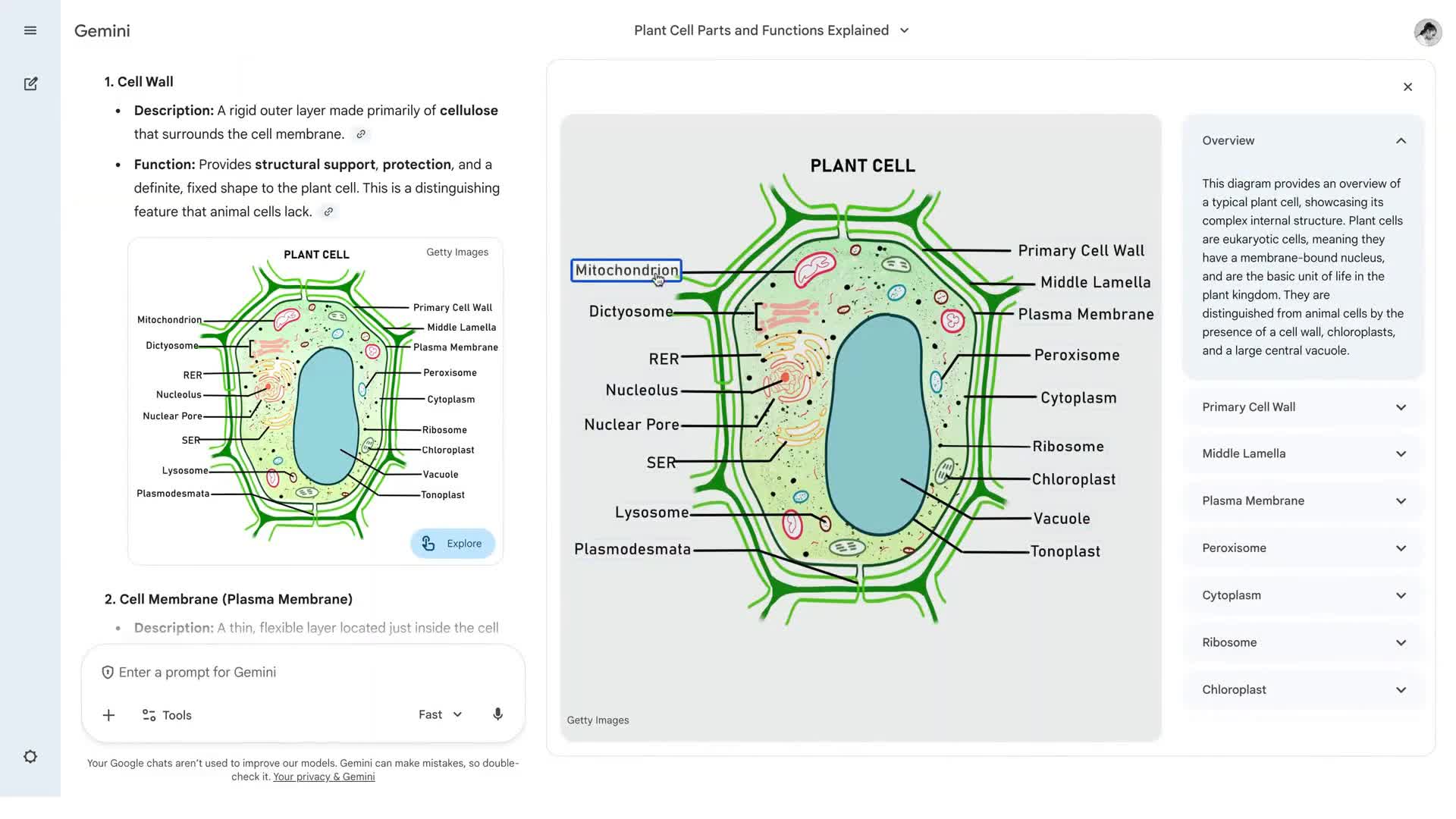

Google dodało właśnie do Gemini interaktywne obrazy. Brzmi prosto. Efekt? Klikasz w dowolny element zdjęcia, diagramu czy infografiki i pytasz: "Co to jest?", "Jak to działa?", "Dlaczego akurat tak?". System odpowiada kontekstowo — dokładnie o tym, co zaznaczyłeś.

To nie kolejny gadżet.

Nauka przez aktywne zaangażowanie. Fundament pedagogiki potwierdzony dziesiątkami badań. Nie wystarczy przeczytać — trzeba zapytać, sprawdzić, połączyć kropki.

Do tej pory Gemini odpowiadało na pytania o obrazy globalnie. Wrzucałeś zdjęcie, pisałeś prompt, dostawałeś ogólną analizę. Teraz? Klikasz w konkretny fragment anatomicznego diagramu serca i pytasz: "Która komora pompuje krew do płuc?". Dostajesz odpowiedź precyzyjnie o tym elemencie.

Różnica? Gigantyczna.

Wcześniejsze podejście miało fundamentalną wadę: model nie wiedział, co cię tak naprawdę interesuje. Analizował cały obraz i próbował zgadnąć, o co pytasz. Teraz punkt wyjścia jest jednoznaczny — wskazujesz palcem, model reaguje. To przesunięcie inicjatywy z systemu na użytkownika zmienia całą dynamikę interakcji.

Wyobraź sobie analizę mapy historycznej. Zamiast pytać "Co się działo w Europie w 1914?", klikasz w konkretny region. "Dlaczego tutaj wybuchł konflikt?". Gemini odpowiada z kontekstem miejsca, czasu i powiązań.

Albo — uczysz się biologii. Przed tobą schemat komórki. Klikasz w mitochondrium. Pytasz: "Dlaczego to nazywają elektrownią komórki?". Odpowiedź odnosi się bezpośrednio do struktury, którą wskazałeś. Nie do całej komórki.

To jak mieć nauczyciela, który nie tylko zna materiał, ale rozumie, o co dokładnie pytasz. I nie zasypuje cię informacjami, których nie potrzebujesz.

Podobne zastosowanie znajdą inżynierowie i technicy. Schemat elektryczny, rysunek techniczny, diagram architektury oprogramowania — kliknięcie w konkretny komponent i zapytanie o jego funkcję to coś, co do tej pory wymagało albo eksperta pod ręką, albo żmudnego przeszukiwania dokumentacji. Teraz odpowiedź pojawia się natychmiast, osadzona w kontekście dokładnie tego fragmentu, który cię interesuje.

Lekarze i studenci medycyny mogą klikać w przekroje anatomiczne i pytać o funkcje konkretnych struktur. Architekci — analizować rzuty budynków element po elemencie. Uczniowie szkół średnich — rozkładać na czynniki pierwsze wykresy z podręczników do fizyki czy chemii. Funkcja jest na tyle uniwersalna, że trudno wskazać dziedzinę, w której nie znalazłaby zastosowania.

Przede wszystkim: tempo. Zamiast przedzierać się przez ściany tekstu, idziesz prosto do sedna. Klikasz, pytasz, rozumiesz. Powtarzasz.

Po drugie: głębokość zrozumienia. Gdy możesz zapytać o każdy detal, nie przeskakujesz niejasnych fragmentów. Nie zostawiasz białych plam. Budujesz wiedzę warstwa po warstwie.

I jeszcze jedno — personalizacja. Każdy uczy się inaczej. Ktoś potrzebuje kontekstu historycznego, ktoś inny technicznych detali. Interaktywne obrazy pozwalają zadawać pytania, które są ważne dla ciebie. Nie dla autora podręcznika.

To ostatnie jest szczególnie istotne. Przez dekady edukacja działała w jednym kierunku: autor materiału decydował, co jest ważne, i przekazywał to w ustalonej kolejności. Uczeń dopasowywał się do struktury. Interaktywne obrazy odwracają ten schemat — to uczeń wyznacza ścieżkę przez materiał. Jedni zaczną od ogółu i będą zagłębiać się w szczegóły. Inni wychwycą niepozorny element w rogu diagramu i stamtąd zbudują całe zrozumienie tematu. Obie strategie są teraz równie dostępne.

Google nie działa w próżni. OpenAI rozwija możliwości GPT-4o w zakresie analizy obrazów, Anthropic pracuje nad multimodalnymi funkcjami Claude'a, a Microsoft integruje podobne rozwiązania w ekosystemie Office i Bing. Wyścig o dominację w edukacyjnych zastosowaniach AI trwa od miesięcy.

Interaktywne obrazy w Gemini to odpowiedź na konkretną lukę, której konkurencja jeszcze nie wypełniła w tak bezpośredni sposób. Zamiast ogólnej analizy całego obrazu, Google postawiło na precyzję wskazania. To pozornie drobna różnica techniczna, która w praktyce przekłada się na zupełnie inne doświadczenie użytkownika.

Warto też zauważyć szerszy kontekst strategiczny. Google od lat buduje pozycję w edukacji — Workspace for Education, Google Classroom, Chromebooki w szkołach. Gemini z interaktywnymi obrazami naturalnie wpisuje się w ten ekosystem. Dla szkół korzystających już z narzędzi Google integracja nowej funkcji będzie prosta i niemal bezkosztowa.

Google stawia na edukację. Widać to nie tylko w Gemini. Interaktywne obrazy to krok w stronę nauki, która dostosowuje się do ucznia — nie odwrotnie.

Za rok może to będzie standard. Każdy diagram, każda mapa, każde zdjęcie w sieci stanie się interaktywne. Klikniesz i zapytasz.

Natychmiast.

Na razie możesz sprawdzić nową funkcję w Gemini. I przekonać się, czy nauka faktycznie stała się prostsza.

Albo po prostu kliknąć i zapytać.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar