Gradient descent w Excelu? Tak, da się nauczyć AI w arkuszu

Źródło: Link

Źródło: Link

90 minut praktyki na żywo. Pokazuję krok po kroku, jak zacząć z AI bez kodowania.

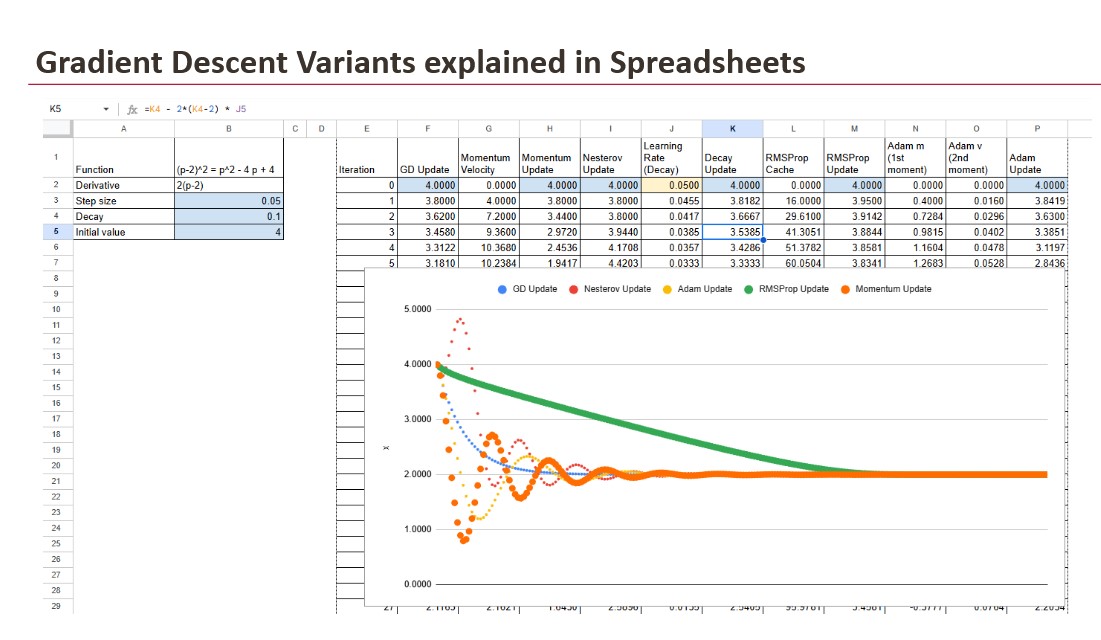

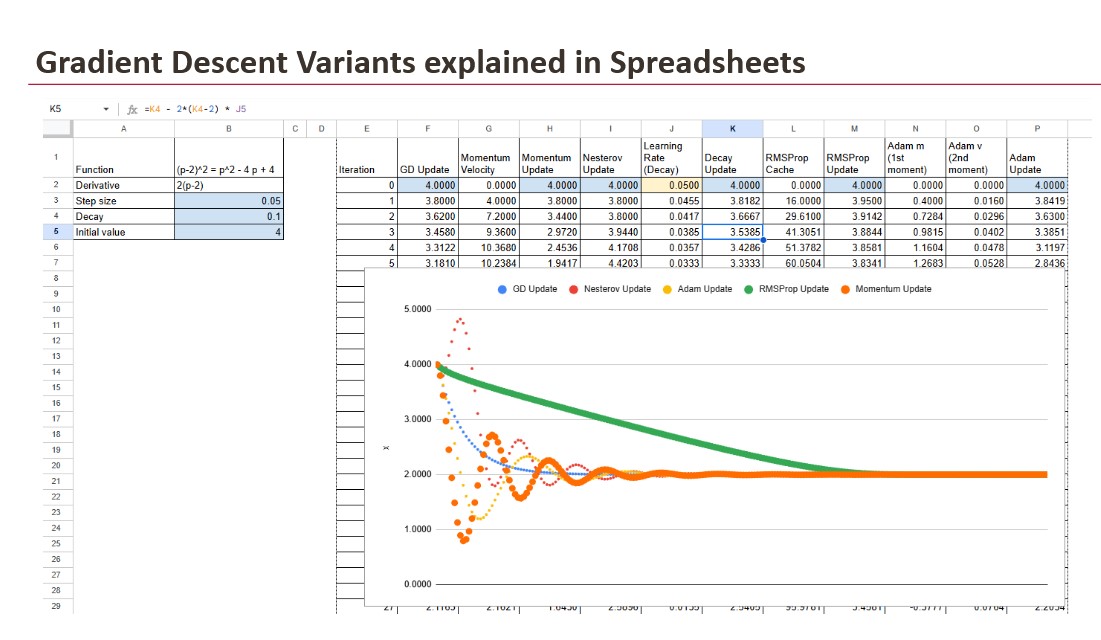

Gradient descent przypomina termin z podręcznika dla doktorantów. A ktoś właśnie pokazał, jak to działa – w Excelu.

Nie w Pythonie. Nie w TensorFlow. W zwykłym arkuszu kalkulacyjnym.

I nagle najbardziej fundamentalny mechanizm uczenia maszynowego przestaje być czarną magią.

Stoisz w górach we mgle. Nie widzisz doliny, ale chcesz do niej zejść. Co robisz?

Sprawdzasz, która strona jest najbardziej stroma w dół – i idziesz tam. Potem znowu sprawdzasz. I znowu. Krok po kroku.

To właśnie gradient descent.

W uczeniu maszynowym model szuka "doliny" – miejsca, gdzie błąd predykcji jest najmniejszy. Gradient (nachylenie) pokazuje kierunek. Descent (zejście) oznacza ruch w tym kierunku.

Tylko że podstawowa wersja ma swoje wady. Czasem idzie za wolno. Czasem gubi się w terenie. Czasem skacze tam i z powrotem jak pijany turysta, który nie może znaleźć ścieżki.

Pierwsza poprawka nazywa się Momentum. Działa jak kula tocząca się w dół zbocza.

Zamiast po prostu iść w stronę nachylenia, "zapamiętuje" poprzedni ruch. Jeśli przez kilka kroków szedłeś w podobnym kierunku – przyspieszasz. Jeśli kierunek się zmienia – zwalniasz.

Efekt?

Model szybciej schodzi do minimum. Nie zatrzymuje się na płaskich odcinkach. Nie skacze nerwowo w miejscu, bo ma rozpęd, który niesie go dalej.

W Excelu widać to dosłownie: komórka z "prędkością" akumuluje wartości z poprzednich kroków. To nie jest abstrakcja – to zwykłe dodawanie z wagą. Widzisz, jak liczby się zmieniają, krok po kroku.

Momentum rozwiązuje jeden problem, ale tworzy inny. Co jeśli w jednym kierunku nachylenie jest strome, a w drugim płaskie? Kula toczy się za szybko w jedną stronę i za wolno w drugą.

RMSProp (Root Mean Square Propagation) to naprawia.

Zamiast jednej prędkości dla wszystkich parametrów, każdy dostaje swoją. Jeśli gradient w danym kierunku często się zmienia – algorytm zwalnia. Jeśli jest stabilny – przyspiesza.

W praktyce oznacza to, że model nie "przeskakuje" minimum, bo zbyt mocno przyspieszył. Dostosowuje tempo do terenu, po którym się porusza.

Adam (Adaptive Moment Estimation) to połączenie Momentum i RMSProp. Bierze rozpęd z pierwszego i adaptacyjną prędkość z drugiego.

I dlatego stał się standardem.

W większości nowoczesnych modeli AI – od GPT po Stable Diffusion – to właśnie Adam optymalizuje wagi. Nie chodzi o to, że jest "najlepszy" w sensie matematycznym. Po prostu działa stabilnie w większości sytuacji. Nie wymaga ręcznego strojenia parametrów. Robi robotę.

W Excelu widać, jak te dwa mechanizmy działają równolegle. Jedna kolumna liczy momentum (średnią ruchomą gradientu), druga – RMSProp (średnią ruchomą kwadratu gradientu). Potem oba wpływają na finalny krok. Żadnej magii – tylko formuły.

Bo Excel zmusza do zrozumienia.

Kiedy piszesz model.fit() w Pythonie, magia dzieje się w środku. Nie widzisz, jak wartości się zmieniają. Nie widzisz, dlaczego model nagle przyspiesza lub zwalnia. Wszystko ukryte w bibliotece.

W arkuszu każda komórka to jeden krok obliczeń.

Widzisz, jak gradient wpływa na momentum. Jak momentum wpływa na aktualizację wagi. Jak waga wpływa na błąd. To jak rozebrać silnik samochodu – nie musisz tego robić, żeby jeździć, ale jeśli chcesz naprawdę zrozumieć mechanikę – warto.

Nie.

Wszystkie cztery metody – gradient descent, Momentum, RMSProp, Adam – dążą do tego samego minimum. Nie zmieniają miejsca docelowego. Zmieniają tylko drogę, którą tam prowadzi.

Każda kolejna wersja dodaje mechanizm, który naprawia ograniczenie poprzedniej. Ruch staje się szybszy, bardziej stabilny, bardziej adaptatywny.

Ale dolina pozostaje ta sama.

I to jest kluczowe: optymalizatory nie "uczą" modelu czegoś innego. Po prostu pomagają mu dotrzeć tam, gdzie ma dotrzeć – szybciej i pewniej. Różnica między nimi to nie cel, tylko elegancja drogi.

Jeśli uczysz się machine learningu i czujesz, że teoria ucieka w abstrakcję – to dla Ciebie.

Jeśli chcesz zobaczyć, co naprawdę dzieje się w optimizer='adam' – to dla Ciebie. Jeśli prowadzisz zespół AI i chcesz wytłumaczyć szefowi, dlaczego zmiana optymalizatora przyspieszyła trening – Excel może być lepszym narzędziem niż slajdy pełne równań.

Bo pokazuje, zamiast mówić.

I czasem właśnie to robi różnicę.

Przeczytaj też:

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar