Jak rozpoznać deepfake i nie dać się zmanipulować AI w 2026

Źródło: Link

Źródło: Link

90 minut praktyki na żywo. Pokazuję krok po kroku, jak zacząć z AI bez kodowania.

Widziałeś film, w którym premier ogłasza stan wojenny. Albo nagranie, w którym szef Twojej firmy poleca przelać pieniądze na nowe konto. Albo zdjęcie celebryty popierającego produkt, którego nigdy nie dotknął. Pytanie nie brzmi "czy to się zdarza" — tylko "jak często tego nie zauważasz".

Deepfake'i i dezinformacja generowana przez AI przestały być problemem przyszłości. To codzienność 2026 roku. Różnica między osobą, która daje się zmanipulować, a tą, która nie — to nie inteligencja. To znajomość kilku prostych zasad weryfikacji.

Zaczynamy od najtrudniejszego: deepfake'i wideo i audio są dziś na poziomie, który oszuka większość ludzi przy pierwszym oglądaniu. Technologia ma swoje limity — i te limity zostawiają ślady.

Oczy i mruganie. Modele AI wciąż mają problem z naturalnym rytmem mrugania. Jeśli osoba na nagraniu mruga zbyt regularnie — co 2-3 sekundy jak zegar — albo w ogóle nie mruga przez 10+ sekund, to czerwona flaga. Prawdziwy człowiek mruga nieregularnie. Częściej gdy mówi o czymś emocjonalnym, rzadziej gdy się koncentruje.

Krawędzie twarzy i włosy. Włosy to koszmar dla AI — szczególnie gdy poruszają się na wietrze albo przy szybkich ruchach głowy. Zwróć uwagę na linię włosów przy czole i granicę twarzy z tłem. Lekkie rozmycie? "Ślizganie się" krawędzi? Włosy wyglądające jak plastikowa peruka? Sprawdź źródło dwukrotnie.

Synchronizacja ust z dźwiękiem. Deepfake'i audio są dziś lepsze niż wideo. Jeśli widzisz nagranie, w którym usta poruszają się "prawie" w rytm słów, ale coś jest nie tak — opóźnienie 0.1-0.2 sekundy, brak naturalnych ruchów języka przy "l" czy "r" — to może być manipulacja.

Oświetlenie i cienie. AI ma problem z konsystentnym oświetleniem. Twarz oświetlona z lewej, ale cień pod nosem pada jakby światło było z prawej? Problem. Osoba obraca głowę, ale cienie na twarzy nie zmieniają się proporcjonalnie? Też problem.

Deepfake audio (voice cloning) to dziś kwestia 3-5 sekund nagrania oryginalnego głosu. Narzędzia jak ElevenLabs czy Resemble AI potrafią sklonować głos w kilka minut. Jak się bronić?

Oddech i naturalne pauzy. Prawdziwy człowiek oddycha — słyszysz subtelne wdechy przed dłuższymi zdaniami, wahania, "eee", "hmm". AI generuje głos bez tych niedoskonałości. Jeśli nagranie brzmi "zbyt czysto" — jak lektor audiobooka bez jednej pomyłki — to sygnał ostrzegawczy.

Emocje w głosie. AI potrafi naśladować ton, ale emocjonalna modulacja wciąż jest trudna. Drżenie głosu przy wzruszeniu, przyśpieszenie przy ekscytacji — to szczegóły, które AI omija. Jeśli ktoś mówi o czymś dramatycznym głosem neutralnego asystenta, sprawdź źródło.

Weryfikacja przez callback. Najprostszy test: dostajesz telefon od szefa/banku/rodziny z pilną prośbą? Rozłącz się i zadzwoń sam na znany Ci numer. Deepfake nie przetrwa weryfikacji zwrotnej.

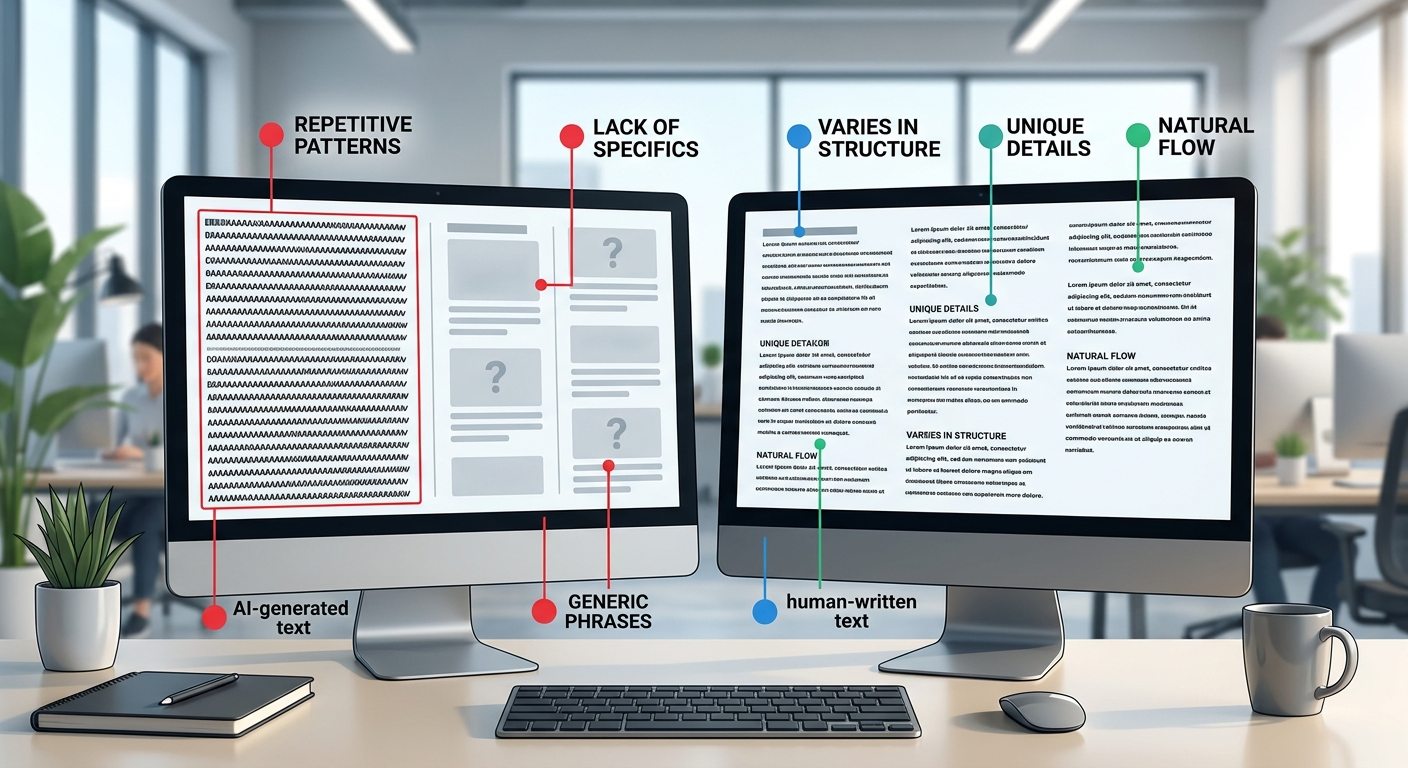

Tekst to najłatwiejszy wektor ataku — i najtrudniejszy do wykrycia. GPT-5, Claude Opus 4.7 czy Gemini 3.1 Pro piszą dziś na poziomie, który przechodzi przez większość detektorów AI. Mają swoje nawyki.

Powtarzalne struktury. AI uwielbia schematy: wprowadzenie, trzy punkty, podsumowanie. Jeśli czytasz artykuł, który To przypomina "Firstly... Secondly... Finally..." albo "W kontekście... Ponadto... Należy podkreślić..." — to prawdopodobnie AI. Albo człowiek, który pisze jak AI, co jest równie smutne.

Brak konkretów. AI generalizuje. Tekst mówi "eksperci twierdzą", "badania pokazują", "wiele firm" — ale NIE podaje nazwisk, dat, nazw firm? Czerwona flaga. Prawdziwy dziennikarz czy analityk podaje źródła.

Perfekcyjna gramatyka, zero osobowości. AI nie robi literówek. Nie używa slang'u. Nie wtrąca komentarzy w nawiasach. Jeśli tekst To przypomina podręcznik akademicki napisany przez robota — prawdopodobnie tak jest.

Halucynacje faktograficzne. AI wymyśla fakty z przekonaniem. Artykuł cytuje "badanie Uniwersytetu Stanford z 2025 roku"? Sprawdź, czy takie badanie istnieje. Narzędzia jak Google Scholar albo bezpośrednie wyszukiwanie na stronie uczelni zajmą Ci 30 sekund.

Brak kontrowersji. AI jest wyuczone na bycie neutralnym. Jeśli tekst o spornym temacie — polityka, religia, etyka AI — To przypomina "z jednej strony... z drugiej strony... ostatecznie to skomplikowane", to prawdopodobnie maszyna. Ludzie mają zdanie.

Modele jak DALL-E 3, Midjourney v7 czy Stable Diffusion 3.5 generują obrazy fotorealistyczne. Mają swoje obsesje i słabości.

Ręce i palce. Klasyka. AI wciąż ma problem z dłońmi — sześć palców, dziwne zgięcia, palce zlewające się ze sobą. Widzisz zdjęcie osoby? Sprawdź dłonie. To najszybszy test.

Tekst na obrazie. AI nie potrafi pisać. Widzisz napis na koszulce, szyld sklepu, okładkę książki — i tekst wygląda jak losowe litery albo jest nieczytelny? To generacja.

Symetria i powtórzenia. AI uwielbia symetrię. Jeśli tło ma dziwnie powtarzające się wzory — jak tapeta kopiuj-wklej — albo budynki są podejrzanie identyczne, to sygnał ostrzegawczy.

Metadane EXIF. Prawdziwe zdjęcie z aparatu czy telefonu ma metadane: model urządzenia, data, lokalizacja GPS, ustawienia ISO/przysłony. Obraz AI ma puste metadane albo tylko datę wygenerowania. Narzędzia jak Metadata2Go sprawdzą to za darmo.

Detektory AI to pole bitwy — producenci AI vs. twórcy detektorów. Żadne narzędzie nie daje 100% pewności. Kilka warto znać.

GPTZero — jeden z lepszych detektorów, analizuje "perplexity" (nieprzewidywalność) i "burstiness" (zmienność długości zdań). Darmowa wersja do 5000 znaków. Problem: GPT-5 z custom promptami potrafi go oszukać.

Originality.AI — płatny ($0.01 za 100 słów), twierdzi że wykrywa GPT-5 i Claude z 85% accuracy. W praktyce: ~70% na tekstach z dobrym promptem. Lepszy od darmowych alternatyw.

Zasada: NIE ufaj jednemu detektorowi. Masz wątpliwości? Przepuść tekst przez 2-3 narzędzia i porównaj wyniki.

Hive Moderation — API do wykrywania AI-generowanych obrazów, używane przez Reddita i Discorda. Darmowe demo na stronie. Wykrywa ~80% obrazów z Midjourney/DALL-E.

Optic AI or Not — proste narzędzie online, upload obrazu i dostajesz wynik w 3 sekundy. Mniej dokładne (~65%), ale szybkie.

Zasada: Jeśli obraz jest podejrzany, sprawdź metadane NAJPIERW. Są puste? To już 80% pewności, że AI.

Deepware Scanner — darmowe narzędzie do skanowania wideo pod kątem deepfake'ów. Upload do 100MB, wynik w ~5 minut. Wykrywa ~70% manipulacji.

Sensity AI — platforma enterprise do monitoringu deepfake'ów, używana przez firmy medialne. Dla indywidualnych użytkowników: droga. Pokazuje, że technologia weryfikacji istnieje.

Zasada: Jeśli nagranie jest krytyczne — dowód w sprawie, decyzja biznesowa — NIE polegaj na darmowych narzędziach. Zainwestuj w profesjonalną weryfikację forensic.

Wykrywanie to jedno. Ochrona to drugie. Oto konkretne kroki, które możesz wdrożyć dziś.

Ustal "safe word" z rodziną. Proste hasło, które tylko Ty i bliscy znacie. Dostajesz telefon z prośbą o pieniądze? Pytasz o safe word. Deepfake nie będzie wiedział.

Weryfikuj przez drugi kanał. Ktoś pisze na Messengerze pilną prośbę? Zadzwoń. Ktoś dzwoni z banku? Rozłącz się i zadzwoń na numer z karty. Zero wyjątków.

Ogranicz publicznie dostępne nagrania głosu. Im mniej nagrań Twojego głosu w sieci, tym trudniej sklonować. Prowadzisz podcast czy YouTube? To ryzyko zawodowe. Jeśli nie musisz — ogranicz.

Sprawdzaj źródło PRZED udostępnieniem. Widzisz szokujący news? Sprawdź, czy inne wiarygodne media go potwierdzają. Jeśli tylko jeden portal — szczególnie nieznany — poczekaj 24h. Deepfake'i i fake newsy żyją z viralowości.

Procedury weryfikacji przelewów. Każdy przelew powyżej X złotych wymaga potwierdzenia przez telefon (na znany numer) + email + SMS. Deepfake CEO to realne zagrożenie — firmy już tracą miliony.

Szkolenia dla zespołu. Twoi pracownicy muszą wiedzieć, jak wygląda deepfake i co robić, gdy coś jest podejrzane. Jedno szkolenie rocznie to minimum.

Monitoring marki. Narzędzia jak Brand24 czy Google Alerts mogą wyłapać, gdy ktoś używa Twojego logo czy wizerunku w deepfake'u. Im szybciej zareagujesz, tym mniejsza szkoda.

Polityka AI-generated content. Jeśli Twoja firma publikuje treści — ustal jasną politykę: czy używacie AI, jak to oznaczacie, kto weryfikuje. Brak polityki to zaproszenie do problemów prawnych — AI Act w UE tego wymaga.

Nie możesz weryfikować każdego obrazka i każdego tekstu — zwariujesz. Potrzebujesz heurystyki: kiedy sprawdzać, a kiedy zaufać.

Sprawdzaj ZAWSZE, gdy:

Możesz zaufać (z ostrożnością), gdy:

Zasada: im wyższa stawka, tym wyższa weryfikacja. Mem na Twitterze? Olej. Email od "szefa" z prośbą o przelew $50k? Trzy poziomy weryfikacji.

Czy detektory AI naprawdę działają?

Działają, ale nie są niezawodne. Najlepsze detektory (płatne) mają ~80-85% accuracy na tekście i ~70-75% na obrazach. To oznacza, że 15-25% treści AI przejdzie niezauważone. Dlatego detektory to JEDNO z narzędzi, nie jedyne.

Jak sprawdzić, czy mój głos został sklonowany?

Postaw Google Alert na swoje imię + "nagranie" / "audio" / "wywiad". Jeśli ktoś opublikuje deepfake Twojego głosu, prawdopodobnie pojawi się w wynikach. Dodatkowo: jeśli dostajesz pytania o coś, czego nigdy nie powiedziałeś — to sygnał ostrzegawczy.

Czy watermarking obrazów AI rozwiąże problem?

Częściowo. OpenAI, Google i Meta testują niewidzialne watermarki w obrazach AI. Problem: łatwo je usunąć (crop, resize, filtr). Watermarking pomaga w śledzeniu źródła, ale nie zatrzyma złej woli.

Co zrobić, jeśli znajdę deepfake ze mną?

Zapisz dowody (screenshot, link, archiwum). Zgłoś platformie (YouTube/Facebook/Twitter mają procedury). Jeśli deepfake szkodzi Twojej reputacji czy finansom — skonsultuj prawnika. W UE masz prawo do usunięcia (AI Act, Art. 52).

Ten artykuł pokazuje, jak się bronić. Prawdziwa przewaga to rozumieć, JAK AI działa od środka — jak generuje tekst, obrazy, głos. W kursie AI Evolution rozkładam to na czynniki pierwsze: od podstaw promptowania (poziom BASIC) po zaawansowane techniki weryfikacji i bezpieczeństwa (poziom ADVANCED). 118 lekcji, zero teorii bez praktyki.

Sprawdź AI Evolution →Sprawdzanie każdego obrazka pod kątem deepfake'a to paranoja. Weryfikacja źródła przed udostępnieniem szokującego newsa? To zdrowy rozsądek. Różnica jest subtelna, ale krytyczna.

Deepfake'i i dezinformacja AI to nie problem przyszłości — to codzienność 2026 roku. Nie musisz być ekspertem forensic, żeby się chronić. Musisz znać podstawowe sygnały ostrzegawcze i mieć nawyk weryfikacji. Proste, skuteczne, ratuje zdrowie.

Technologia będzie lepsza. Deepfake'i będą trudniejsze do wykrycia. Twoja zdolność do krytycznego myślenia i weryfikacji źródeł? Ta nie starzeje się tak szybko jak modele AI.

Na podstawie: Materiały własne, aktualne standardy wykrywania deepfake (2026), dokumentacja narzędzi GPTZero, Hive Moderation, Deepware Scanner

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar