Jak rozpoznać treści wygenerowane przez AI – przewodnik praktyczny

Źródło: Link

Źródło: Link

90 minut praktyki. Co tydzień na żywo.

68% pracowników używa AI do tworzenia treści po kryjomu (Sago Research, 2024). Problem? Nikt nie wie, jak sprawdzić, czy tekst napisał człowiek, czy ChatGPT. Detektory obiecują 95% skuteczności, ale rzeczywistość jest bardziej skomplikowana.

Rozpoznawanie treści AI to nie czarna magia – to zestaw konkretnych technik, które możesz opanować. W tym przewodniku pokażę Ci, jak sprawdzać autentyczność tekstów krok po kroku, bez wydawania pieniędzy na drogie narzędzia.

Nie istnieje metoda dająca 100% pewności. OpenAI zamknęło swój oficjalny detektor w lipcu 2023 roku – przyznali, że nie działał wystarczająco dobrze. To mówi wszystko o stanie technologii.

Potrzebujesz:

Zacznijmy od najprostszego rozwiązania. Detektory AI analizują statystyczne wzorce w tekście – sprawdzają, jak bardzo przypomina on typowy output modeli językowych.

Otwierasz gptzero.me i wklejasz tekst. Narzędzie daje Ci trzy wskaźniki:

Klikasz "Scan" i czekasz 10-15 sekund. Dostajesz raport z zaznaczonymi fragmentami – żółte to "może AI", czerwone to "prawdopodobnie AI".

Ważne: GPTZero działa najlepiej z tekstami po angielsku. Polskie teksty sprawdzaj w Writer.com AI Content Detector – lepiej radzi sobie z językami innymi niż angielski.

Wchodzisz na copyleaks.com/ai-content-detector, wklejasz tekst i klikasz "Scan for AI". Copyleaks pokazuje:

Darmowa wersja pozwala na 10 skanów miesięcznie. Wystarczy na podstawowe potrzeby.

Najlepszy dla polskich tekstów. Otwierasz writer.com/ai-content-detector, wklejasz tekst i dostajesz prostą odpowiedź: "Human-Generated", "AI-Generated" lub "Mix".

Plus: działa bez rejestracji, bez limitów. Minus: mniej szczegółów niż GPTZero.

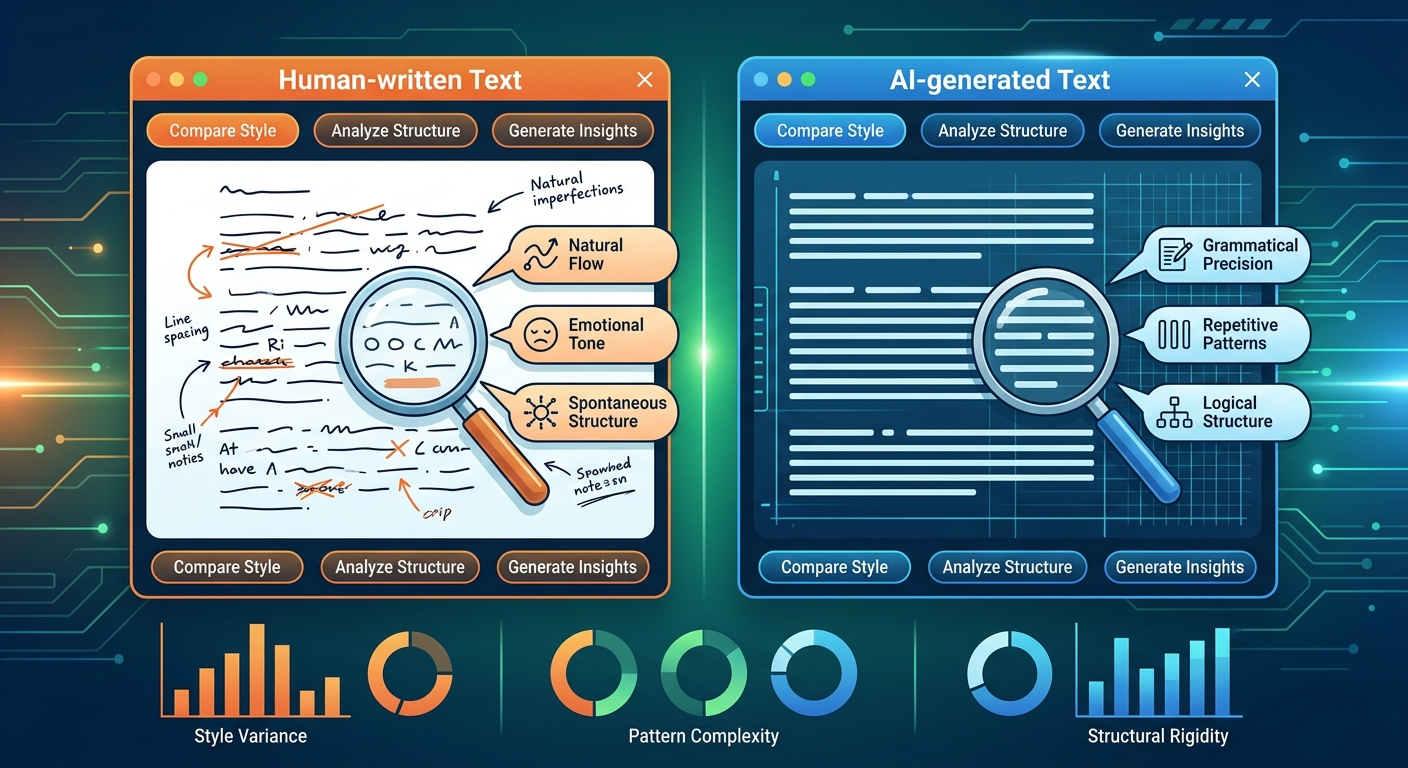

Detektory mylą się. Często. Dlatego musisz umieć sprawdzić tekst samodzielnie. Oto konkretne znaki rozpoznawcze.

Otwierasz tekst i szukasz wzorców:

Przykład AI: "Sztuczna inteligencja zmienia sposób, w jaki pracujemy. Automatyzacja procesów biznesowych staje się coraz bardziej powszechna. Firmy inwestują w nowe technologie."

Przykład człowieka: "AI zmienia wszystko. Automatyzacja? Już nie przyszłość – teraźniejszość. Firmy, które tego nie widzą, zostają w tyle."

AI pisze bezpiecznie. Sprawdzasz:

Tekst bez ani jednego konkretnego przykładu, daty czy liczby? Prawdopodobnie AI.

Czytasz tekst na głos. Pytasz siebie:

AI pisze jak podręcznik. Człowiek pisze jak człowiek.

Google, OpenAI i Meta pracują nad niewidzialnym znakowaniem treści AI. To jak wodny znak w tekście – niewidoczny dla oka, czytelny dla detektorów.

Model AI podczas generowania tekstu wprowadza subtelne wzorce w wyborze słów. Przykład: jeśli ma do wyboru "jednak" i "ale", zawsze wybiera "jednak" w określonych kontekstach. Dla człowieka niezauważalne. Dla detektora – jasny sygnał.

Problem: działa tylko z tekstami generowanymi przez modele z wbudowanym watermarkingiem. Jeśli ktoś użył API OpenAI bez watermarkingu lub przepisał tekst ręcznie – metoda zawodzi.

Google wprowadził SynthID dla swoich modeli Gemini. Jeśli tekst został wygenerowany przez Gemini z włączonym SynthID, możesz to sprawdzić narzędziem Google (dostępnym dla wybranych partnerów, nie publicznie).

Na razie to technologia dla dużych platform – nie dla Ciebie. Ale za rok-dwa może być standardem.

Jeśli dostajesz tekst w pliku Word lub Google Docs, sprawdzasz metadane:

Jeśli tekst na 3 strony został "napisany" w 2 minuty – prawdopodobnie wklejony z AI.

Najskuteczniejsza metoda, jeśli masz kontakt z autorem. Prosisz go o wyjaśnienie fragmentu tekstu.

Wybierasz najbardziej techniczny lub szczegółowy akapit i pytasz: "Możesz rozwinąć ten punkt? Jak dokładnie to działa?"

Jeśli autor napisał tekst sam – odpowie konkretnie, z dodatkowymi szczegółami. Jeśli użył AI – albo ucieknie od tematu, albo odpowie ogólnikami (bo nie zna szczegółów).

Przykład: tekst mówi o "optymalizacji procesów przez AI". Pytasz: "Jakie konkretnie procesy optymalizowałeś i jaki był wynik?" Brak konkretnej odpowiedzi = czerwona flaga.

Detektory AI mają poważne ograniczenia. Musisz je znać, żeby nie polegać na nich ślepo.

Detektor oznacza tekst jako AI, choć napisał go człowiek. Dlaczego?

Badanie Uniwersytetu Stanforda (2023) pokazało, że detektory mylnie oznaczają jako AI nawet 50% tekstów napisanych przez osoby, dla których angielski nie jest językiem ojczystym.

Detektor mówi "człowiek", choć tekst wygenerowało AI. Jak to możliwe?

Detektory potrzebują minimum 250-300 słów. Krótszy tekst? Wynik niewiarygodny. To jak próba rozpoznania osoby po fragmencie twarzy.

Nie polegaj na jednej metodzie. Używasz kombinacji:

Przykład: detektor pokazuje 70% prawdopodobieństwa AI. Sam widzisz powtarzające się zwroty i brak konkretów. Metadane mówią, że tekst "napisano" w 3 minuty. Trzy czerwone flagi = prawdopodobnie AI.

Jeden sygnał to za mało. Trzy sygnały to już wzorzec.

Wykryłeś tekst AI. Co teraz?

Jeśli pracownik używa AI bez zgody:

Jeśli freelancer dostarczył tekst AI zamiast własnego – to już kwestia umowy. Jeśli płaciłeś za "autorski tekst", masz prawo do reklamacji.

Student oddał pracę wygenerowaną przez AI. Zamiast od razu karać:

Więcej o tym, jak wykorzystać ChatGPT w szkole jako narzędzie edukacyjne, nie zagrożenie.

Jeśli dostajesz teksty od copywritera i podejrzewasz AI:

AI w content marketingu to nie grzech – ale musi być transparentne. Płacisz za wartość, nie za metodę. Jeśli AI daje taką samą wartość jak praca ręczna – OK. Jeśli nie – masz prawo do renegocjacji.

Tak. Możesz używać detektorów do sprawdzania tekstów. Ale nie możesz karać kogoś TYLKO na podstawie wyniku detektora – to nie dowód, tylko wskazówka. Jeśli chcesz wyciągnąć konsekwencje (np. wobec pracownika), potrzebujesz dodatkowych dowodów lub przyznania się.

Tak. Nowsze modele (GPT-5, Claude Opus 4.6, Gemini 3 Pro) piszą bardziej "po ludzku" – różnorodne struktury, mniej szablonów. Detektory oparte na wzorcach starszych modeli często ich nie wyłapują. Dlatego analiza ręczna jest coraz ważniejsza.

Spokojnie. To częste. Jeśli piszesz formalnie lub po przetłumaczeniu, detektory mylą się. Możesz:

Jeśli to tekst służbowy lub akademicki – dołącz notatkę: "Tekst napisany przeze mnie, wynik detektora to fałszywy pozytyw". Jeśli ktoś będzie miał wątpliwości, możesz przejść test kontekstowy (wyjaśnienie szczegółów).

Prawdopodobnie tak, ale nie szybko. Google, OpenAI i Meta pracują nad tym, ale wdrożenie wymaga współpracy całej branży. Problem: watermarking działa tylko z modelami, które go wspierają. Jeśli ktoś użyje open-source'owego modelu bez watermarkingu (np. Llama 4) – nie wykryjesz. Realnie: za 2-3 lata będzie to standard w dużych platformach, ale nie wszędzie.

Nie. Żaden detektor nie daje 100% pewności. OpenAI zamknęło swój detektor, bo nie działał. GPTZero i inne narzędzia są lepsze, ale wciąż mylą się w 10-20% przypadków. Używaj detektorów jako pierwszego filtru, nie ostatecznego werdyktu. Zawsze łącz z analizą ręczną.

Ten poradnik to dopiero początek. W naszym kursie "Praktyczna AI" nauczysz się korzystać z ChatGPT, Claude i innych narzędzi AI w sposób systematyczny — od zera do zaawansowanego poziomu.

Sprawdź kurs →Rozpoznawanie treści AI to nie magia – to kombinacja narzędzi i zdrowego rozsądku. Detektory pomagają, ale nie zastąpią Twojej oceny. Sprawdzasz wzorce, szukasz szczegółów, testujesz kontekst.

Pamiętaj: AI w tworzeniu treści to nie przestępstwo. To narzędzie. Problem zaczyna się, gdy ktoś ukrywa jego użycie i sprzedaje jako pracę ręczną. Transparentność to klucz.

Jeden krok na start: Weź jeden tekst, który podejrzewasz o AI, i przepuść przez GPTZero. Potem przeanalizuj ręcznie – szukaj powtarzających się struktur i ogólników. Porównaj wyniki. To da Ci czucie, jak działają obie metody.

Na podstawie: GPTZero, Copyleaks, Writer.com, Sago Research 2024, Stanford University AI Detection Study 2023

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar