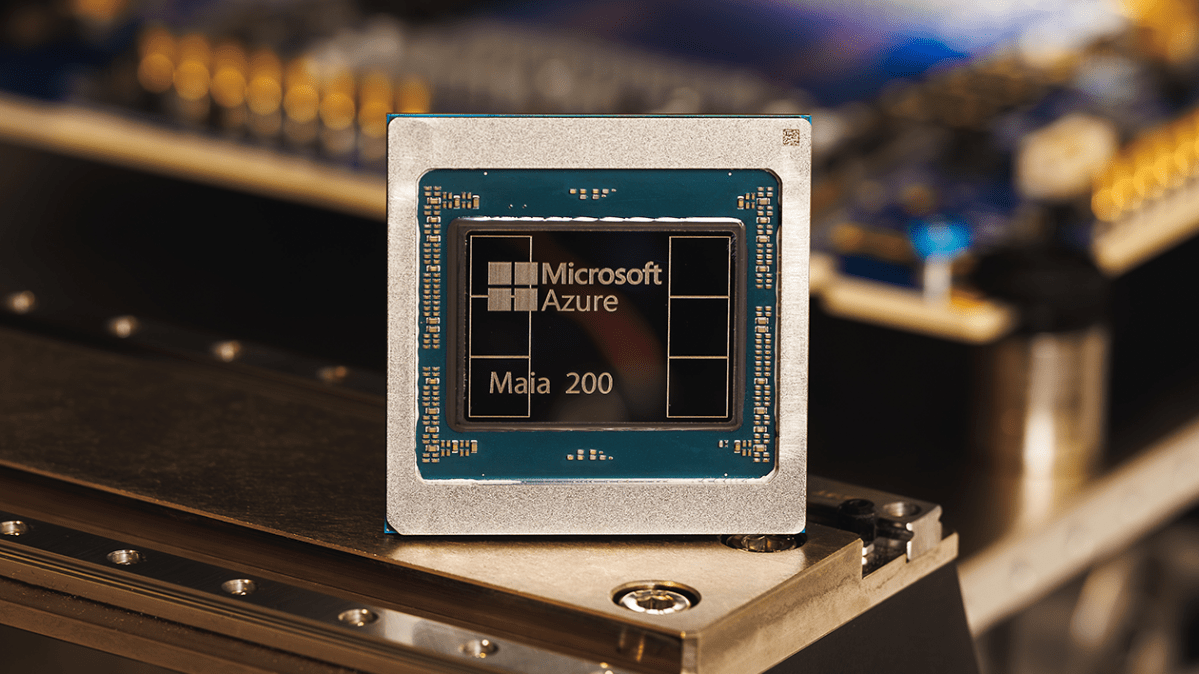

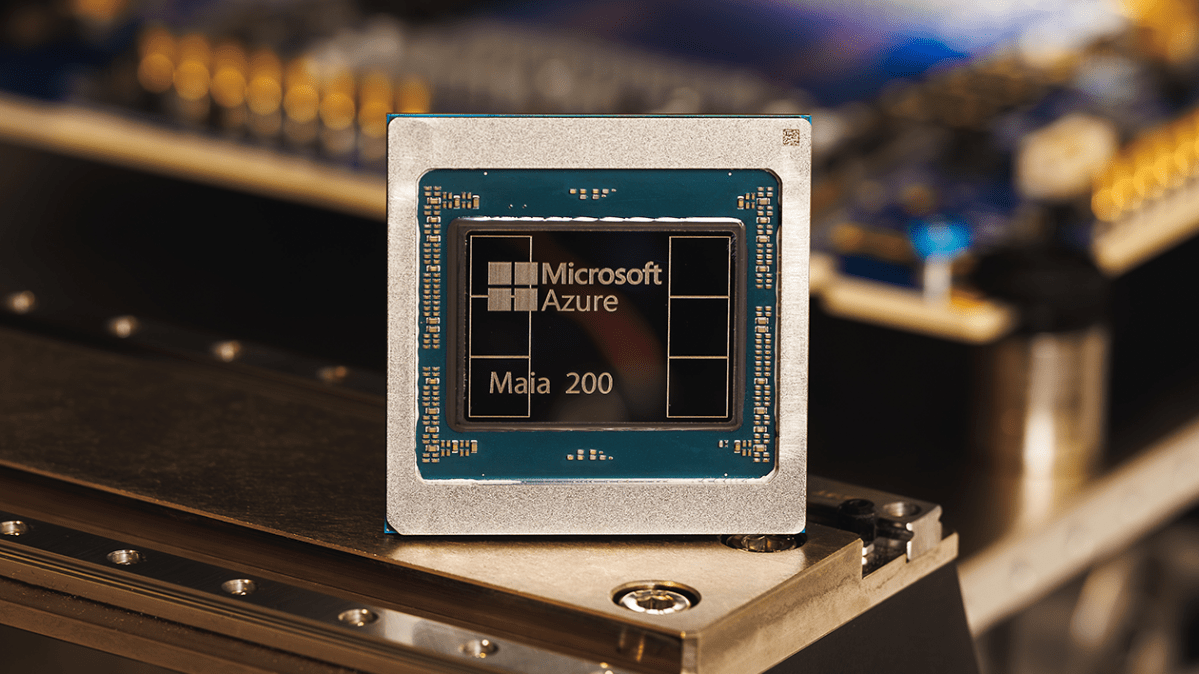

Microsoft Maia 2: chip AI z 100 miliardami tranzystorów

Źródło: Link

Źródło: Link

90 minut praktyki na żywo. Pokazuję krok po kroku, jak zacząć z AI bez kodowania.

Microsoft właśnie zaprezentował Maia 2. Chip do AI, który ma ponad 100 miliardów tranzystorów. Zaraz zobaczysz, co to oznacza naprawdę.

To nie kolejny procesor do laptopa. Maia 2 to wyspecjalizowany układ z jednym celem: błyskawicznie przetwarzać dane dla sztucznej inteligencji. Microsoft projektował go od zera. Bez licencji od Nvidii czy AMD. Własny projekt, własna technologia.

Tranzystor to mikroskopijny przełącznik elektroniczny. Włącz-wyłącz. Jeden-zero. Miliardy takich przełączników działających jednocześnie tworzą "mózg" chipu.

Dla porównania: procesor w Twoim telefonie ma około 15-20 miliardów tranzystorów. Maia 2? Pięć razy więcej. Jak różnica między małym samochodem miejskim a ciężarówką – obie jeżdżą, ale skala jest kompletnie inna.

Więcej tranzystorów = więcej obliczeń w tym samym czasie. A przy AI liczy się właśnie to – szybkość przetwarzania ogromnych ilości danych.

Microsoft podaje, że Maia 2 osiąga "ponad 10 petaflopów w precyzji 4-bitowej". Petaflops to kwadryliard operacji matematycznych na sekundę. Kwadryliard. Jedynka z 15 zerami.

Spróbujmy to zobrazować. Gdybyś liczył jedną operację na sekundę, potrzebowałbyś około 32 milionów lat, żeby dorównać temu, co Maia 2 robi w sekundę.

Precyzja 4-bitowa to sposób, w jaki chip przetwarza liczby. Uproszczona matematyka – mniej dokładna, ale znacznie szybsza. Przy generowaniu tekstu przez ChatGPT czy tworzeniu obrazków ta uproszczona precyzja w zupełności wystarczy. Nikt nie zauważy różnicy w jakości. A odpowiedź dostaniesz dwa razy szybciej.

W precyzji 8-bitowej (bardziej dokładnej) Maia 2 osiąga około 5 petaflopów. Wciąż astronomiczna liczba. Przydatna przy bardziej wymagających obliczeniach, gdzie liczy się dokładność.

Pierwsza Maia ukazała się w 2024 roku. Maia 2 to ewolucja, nie rewolucja – ale skok wydajności jest znaczący. Microsoft twierdzi, że nowy chip jest "substantially faster" od swojego poprzednika.

Substantially – to mniej więcej dwukrotnie. Dwukrotnie więcej mocy obliczeniowej w tym samym czasie. Dwukrotnie więcej zapytań do AI obsłużonych jednocześnie.

Dla Ciebie? Szybsze odpowiedzi w Copilot. Płynniejsza praca z AI w aplikacjach Microsoft 365. Mniej opóźnień przy generowaniu tekstu czy analizie dokumentów. Zauważysz to.

W nagłówku pojawia się słowo "inference". Kluczowy termin, który warto zrozumieć.

AI działa w dwóch fazach. Pierwsza to trening – uczenie modelu na ogromnych zbiorach danych. Trwa miesiące, pochłania gigantyczne ilości energii i wymaga setek chipów pracujących jednocześnie.

Druga faza to inference – używanie już nauczonego modelu. Kiedy piszesz pytanie do ChatGPT i dostajesz odpowiedź? To właśnie inference. Model nie uczy się w tym momencie niczego nowego. Po prostu wykorzystuje wiedzę, którą już ma.

Maia 2 jest zaprojektowana właśnie do inference. Microsoft ma miliony użytkowników Copilot, Azure AI, usług chmurowych. Każde zapytanie to inference. Każda analiza dokumentu. Każda sugestia w Wordzie. Każda rozmowa z chatbotem.

Szybszy inference = niższe koszty dla Microsoft. Jeden chip obsługuje więcej użytkowników jednocześnie. Mniejsze rachunki za energię. Mniejsze opóźnienia. Lepsze doświadczenie. Proste.

Do niedawna praktycznie każda firma AI kupowała chipy od Nvidii. H100, A100 – te procesory zdominowały rynek. Problem? Są drogie. Trudno dostępne. I Nvidia dyktuje warunki.

Microsoft poszedł inną drogą. Zaprojektował Maię we własnym zakresie, dostosowując ją precyzyjnie do swoich potrzeb. Nie płaci Nvidii za licencje. Nie czeka w kolejce na dostawy. Kontroluje cały proces.

Google ma TPU. Amazon ma Trainium i Inferentia. Microsoft ma Maię. Giganci technologiczni budują własne układy AI, bo to ma sens ekonomiczny i strategiczny. I punkt.

Dla rynku to oznacza jedno: monopol Nvidii słabnie. Konkurencja rośnie. A to zazwyczaj prowadzi do niższych cen i szybszego rozwoju technologii.

Nie kupisz Maii 2 do swojego komputera. To chip serwerowy, który trafi do centrów danych Microsoft Azure. Będzie pracował w tle, obsługując miliony zapytań jednocześnie.

Dla Ciebie zmieni się jedno: szybkość i dostępność usług AI. Copilot w Wordzie zareaguje sprawniej. Analiza danych w Excelu przebiegnie błyskawicznie. Chatbot obsługi klienta odpowie bez opóźnień.

Microsoft inwestuje w Maię, żeby obniżyć koszty i zwiększyć wydajność swojej infrastruktury. Część tych oszczędności może przełożyć się na ceny usług – albo po prostu na lepszą jakość przy tej samej cenie.

I jest jeszcze jeden aspekt: energia. Inference to miliardy operacji dziennie. Każda zaoszczędzona nanosekunda, każdy watt energii – w skali całej infrastruktury Microsoft to ogromne liczby. Efektywniejsze chipy = mniejszy ślad węglowy AI. To się liczy.

Microsoft ogłosił chip w styczniu 2026. Zazwyczaj od ogłoszenia do masowego wdrożenia mija kilka miesięcy. Produkcja, testy, integracja z istniejącą infrastrukturą – to wszystko wymaga czasu.

Prawdopodobnie pierwsze serwery z Maią 2 zaczną działać w centrach danych Azure w drugiej połowie 2026 roku. Stopniowo będą zastępować starsze chipy, aż w końcu staną się standardem.

Nie zobaczysz komunikatu "Teraz korzystasz z Maia 2". To będzie niewidoczna zmiana w tle. Po prostu zauważysz, że usługi działają szybciej. I tyle.

Maia 2 to kolejny dowód, że AI to nie tylko algorytmy i dane. To również hardware – fizyczne chipy, które muszą przetworzyć te wszystkie obliczenia.

Nvidia, Google, Amazon, Microsoft, Apple – wszyscy inwestują miliardy w projektowanie własnych układów AI. Każdy chce mieć przewagę. Każdy chce kontrolować swój stack technologiczny od podstaw.

A my, użytkownicy, korzystamy na tym wyścigu. Szybsze modele. Niższe koszty. Lepsze doświadczenia. Technologia, która jeszcze rok temu była science fiction, dziś działa na naszych telefonach i laptopach.

Maia 2 to nie rewolucja. To ewolucja. Kolejny krok w budowaniu infrastruktury, która sprawi, że AI stanie się tak powszechna jak wyszukiwarka czy poczta email. Niewidoczna, ale niezastąpiona.

Przeczytaj też:

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar