A2UI v0.9: interfejsy generowane przez AI w czasie rzeczywistym

Źródło: Link

Źródło: Link

Szkolenia, warsztaty i wdrożenia AI. Dopasowane do Twojego zespołu.

Mówią, że AI generuje interfejsy. Pytanie brzmi: czy generuje je tak, żeby pasowały do Twojego design systemu, działały w każdym frameworku i nie wymagały przepisywania kodu za każdym razem? Do tej pory — niekoniecznie. Google właśnie wypuściło A2UI v0.9, standard, który ma to zmienić.

To nie jest kolejne narzędzie do prototypowania. To specyfikacja, która pozwala agentom AI tworzyć komponenty UI w czasie rzeczywistym, używając Twoich istniejących stylów, kolorów i wzorców. Działa niezależnie od tego, czy piszesz w React, Vue, czy czymkolwiek innym.

A2UI (Agent-to-UI) to otwarty standard zaprojektowany tak, żeby agenci AI mogli generować widgety interfejsu użytkownika bez konieczności dostosowywania się do konkretnego frameworka. Wersja 0.9 wprowadza kilka kluczowych zmian, które upraszczają pracę developerów.

Po pierwsze: nowy Agent SDK dla Pythona. Jeśli budujesz agenta AI, który ma wchodzić w interakcję z użytkownikiem przez interfejs graficzny, teraz możesz to zrobić bez pisania dedykowanego kodu renderującego dla każdej platformy. Agent generuje komponenty w standardzie A2UI, a renderer po stronie klienta zajmuje się resztą.

Po drugie: wspólna biblioteka web-core. To zestaw narzędzi, które pozwalają renderować komponenty A2UI w przeglądarce. Zamiast budować własny parser i renderer, dostajesz gotowe rozwiązanie, które obsługuje podstawowe widgety: przyciski, formularze, karty, listy. Możesz je stylować zgodnie z Twoim design systemem.

Po trzecie: oficjalne wsparcie dla rendererów. Google udostępnia referencyjne implementacje dla najpopularniejszych frameworków. Jeśli pracujesz w React, dostajesz gotowy renderer. Jeśli w Vue — również. Nie musisz wymyślać koła na nowo.

Największy problem z generowaniem UI przez AI? Spójność wizualna. Agent może stworzyć funkcjonalny przycisk, ale czy będzie wyglądał jak reszta Twojej aplikacji? Czy użyje właściwych kolorów, czcionek, odstępów?

A2UI v0.9 rozwiązuje to przez integrację z design systemami. Przekazujesz agentowi specyfikację Twojego systemu — palety kolorów, typografię, komponenty — a on generuje widgety zgodne z tymi wytycznymi. Nie dostajesz losowego przycisku w losowym kolorze. Dostajesz przycisk, który wygląda jak część Twojej aplikacji.

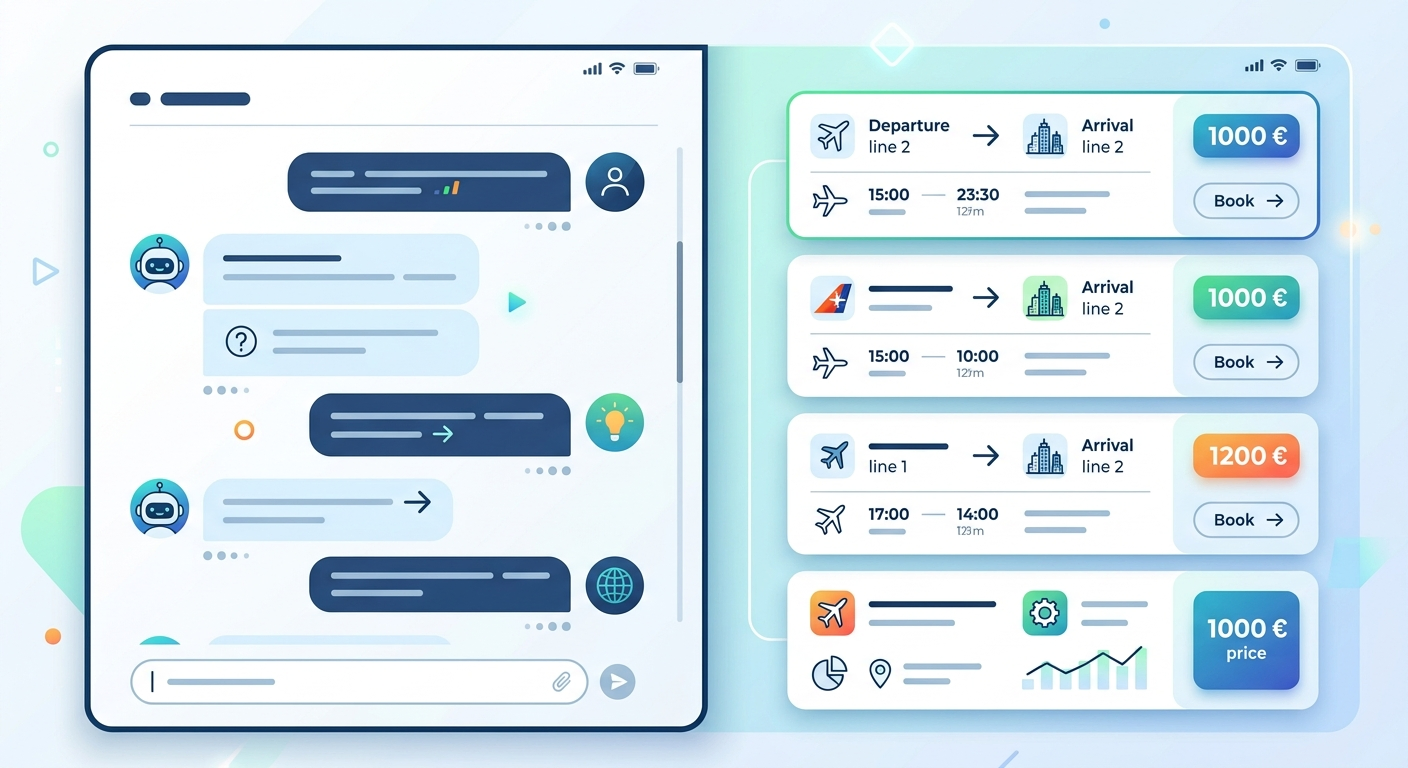

Prosta sytuacja: użytkownik rozmawia z agentem AI, który pomaga mu zarezerwować lot. Agent musi pokazać dostępne opcje — nie jako tekst, ale jako interaktywne karty z przyciskami "Wybierz". W tradycyjnym podejściu musiałbyś zaprogramować te karty ręcznie. Z A2UI agent generuje je na żywo, w trakcie rozmowy, dopasowując do kontekstu i preferencji użytkownika.

Te same komponenty działają w aplikacji webowej, mobilnej (jeśli renderer obsługuje React Native) i desktopowej. Raz zdefiniowany design system, wiele platform.

Nowy Agent SDK dla Pythona to odpowiedź na najpopularniejszy język w ekosystemie AI. Jeśli Twój agent działa na bazie modeli OpenAI, Anthropic czy Google Gemini, możesz teraz podłączyć go do A2UI bez przechodzenia przez JavaScript.

SDK obsługuje podstawowe operacje: tworzenie komponentów, aktualizowanie stanu, reagowanie na interakcje użytkownika. Jeśli agent musi zmienić treść karty po kliknięciu przycisku — robi to przez SDK, a renderer automatycznie odświeża widok.

Google udostępnia przykładowe implementacje dla typowych scenariuszy: formularze wieloetapowe, dashboardy z danymi na żywo, interaktywne wizualizacje. Nie musisz zaczynać od zera.

A2UI to otwarty standard. Jeśli pracujesz w Svelte, Angular czy czymś mniej popularnym, możesz napisać własny renderer. Specyfikacja jest publicznie dostępna, a Google udostępnia narzędzia do testowania zgodności. To nie jest zamknięty ekosystem — to protokół, który każdy może zaimplementować.

A2UI nie zastąpi tradycyjnego projektowania interfejsów. Jeśli budujesz statyczną aplikację z przewidywalnym flow, nie potrzebujesz generowania UI w czasie rzeczywistym. Jeśli tworzysz agenta AI, który ma wchodzić w interakcję z użytkownikiem przez interfejs graficzny — to ma sens.

Przykłady zastosowań: asystenci wirtualni, którzy pokazują wyniki wyszukiwania jako karty produktów. Chatboty wspierające klientów, które generują formularze zgłoszeniowe na podstawie kontekstu rozmowy. Dashboardy analityczne, które dostosowują widoki do pytań użytkownika.

Gdzie to nie ma sensu? W aplikacjach, gdzie UI jest z góry określony i nie zmienia się w zależności od kontekstu. W prostych formularzach kontaktowych. W statycznych stronach informacyjnych. A2UI to narzędzie do dynamicznych, kontekstowych interfejsów — nie do wszystkiego.

Jeśli pracujesz w polskiej firmie, która ma własny design system (albo używa gotowych jak Material Design czy Fluent), A2UI pozwala Ci zachować spójność wizualną bez względu na to, jak bardzo dynamiczny jest Twój interfejs. To ważne zwłaszcza w branżach regulowanych — finanse, zdrowie, edukacja — gdzie spójność i dostępność UI to nie fanaberia, tylko wymóg.

Jeśli chodzi o lokalizację: A2UI obsługuje wielojęzyczność na poziomie komponentów. Agent może generować widgety po polsku, a design system zapewnia, że polskie znaki diakrytyczne wyświetlają się poprawnie. Drobna rzecz, która w praktyce robi różnicę.

Wersja 0.9 to nadal beta. Google zapowiada, że finalna wersja 1.0 pojawi się w kolejnych miesiącach, z pełnym wsparciem dla zaawansowanych komponentów (wykresy, mapy, edytory tekstu) i lepszą integracją z popularnymi bibliotekami UI.

Czy to się przyjmie? Zależy. Jeśli deweloperzy zaczną budować agentów AI z myślą o dynamicznych interfejsach — tak. Jeśli zostanie niszowym narzędziem dla kilku projektów Google — nie. Patrząc na to, jak Adobe i Canva inwestują w AI generujące UI, kierunek wydaje się jasny.

Standard jest otwarty, SDK dostępny, dokumentacja publiczna. Jeśli budujesz agenta AI, który ma pokazywać coś więcej niż tekst — warto sprawdzić. Jeśli nie — możesz poczekać, aż ktoś inny zbuduje narzędzie, które z tego korzysta. Obie opcje są OK. Gorsza jest tylko ta, w której nie wiesz, że takie rozwiązanie istnieje.

Na podstawie: Google Developers Blog

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar