Anthropic odcina OpenClaw od subskrypcji Claude

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Mówią, że AI to otwarta technologia, dostępna dla każdego. Prawda wygląda inaczej. Wystarczy, że zbudujesz coś zbyt popularnego na cudzym API, a nagle dostawca zamyka Ci kurek. Dokładnie to spotkało OpenClaw - japoński startup, który chciał stworzyć lokalną alternatywę dla ChatGPT.

Anthropic, twórca Claude, właśnie rozwiązał umowę z OpenClaw. Bez ostrzeżenia. Bez okresu przejściowego. Użytkownicy, którzy zapłacili za subskrypcję, nagle zostali z narzędziem, które przestało działać.

OpenClaw to japoński startup, który od 2024 roku budował chatbota opartego na modelach Claude. Pomysł był prosty: dać japońskim użytkownikom dostęp do zaawansowanego AI z interfejsem dostosowanym do lokalnych potrzeb. Nie musisz walczyć z angielskim interfejsem. Nie musisz martwić się o prywatność danych wysyłanych za ocean.

Firma oferowała model subskrypcyjny - użytkownicy płacili miesięczny abonament za nieograniczony dostęp do Claude przez interfejs OpenClaw. W lutym 2026 startup organizował event w Tokio, gdzie mówił o sobie jako o "następnym ChatGPT" dla Japonii. Ambitne plany, rosnąca baza użytkowników, lokalne inwestycje.

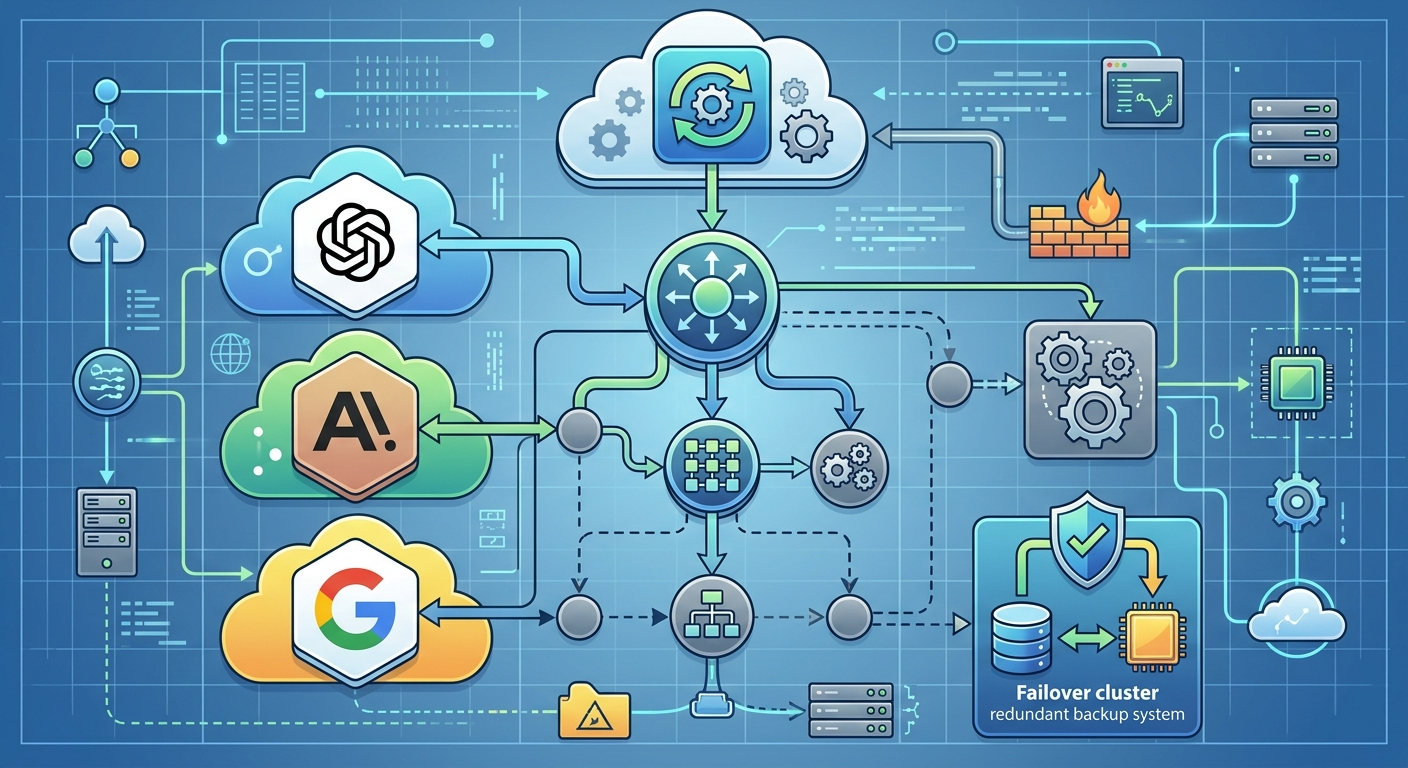

Problem? Cały biznes OpenClaw opierał się na API Anthropic. Każde zapytanie użytkownika trafiało do serwerów Claude, a OpenClaw działał jako pośrednik - dodawał warstwę interfejsu, tłumaczeń i lokalnych funkcji. Model znany z dziesiątek startupów AI, które budują wrapper wokół GPT-5, Claude Opus 4.6 czy Gemini 3 Pro.

W marcu 2026 Anthropic wysłał OpenClaw krótkie powiadomienie: umowa zostaje rozwiązana, dostęp do API zostanie odcięty w ciągu 48 godzin. Bez podania przyczyny. Bez możliwości negocjacji. Bez okresu przejściowego dla użytkowników.

OpenClaw próbował ratować sytuację - kontaktował się z Anthropic, szukał alternatywnych dostawców, informował użytkowników o problemach technicznych. Nic z tego. Po dwóch dniach serwis przestał działać. Użytkownicy, którzy zapłacili za miesięczną lub roczną subskrypcję, zostali z pustką.

Dlaczego Anthropic podjął taką decyzję? Oficjalnie - brak komentarza. Nieoficjalnie można się domyślać kilku scenariuszy:

Niezależnie od przyczyny, efekt jest ten sam: startup, który zainwestował miesiące pracy i pieniądze w budowanie produktu, został odcięty od kluczowej infrastruktury. A użytkownicy - od usługi, za którą zapłacili.

Historia OpenClaw to ostrzeżenie dla każdego, kto buduje biznes oparty na API zewnętrznych dostawców AI. Model "wrapper as a service" jest popularny - bierzesz GPT-5, Claude Opus 4.6 lub Gemini 3 Pro, dodajesz własny interfejs, kilka dodatkowych funkcji i sprzedajesz jako gotowy produkt.

Problem w tym, że nie kontrolujesz kluczowego elementu - samego modelu. Dostawca może w każdej chwili:

To nie jest teoretyczne ryzyko. OpenAI wielokrotnie zmieniało ceny API, zmuszając startupy do podnoszenia cen lub zamykania biznesu. Google wprowadza własne produkty AI w obszarach, gdzie wcześniej dostarczało tylko API. Anthropic właśnie pokazał, że może odciąć dostęp bez ostrzeżenia.

Jeśli budujesz produkt AI, masz kilka opcji, żeby zmniejszyć zależność od jednego dostawcy:

OpenClaw postawił wszystko na jedną kartę - i przegrał, gdy Anthropic zabrał tę kartę ze stołu.

OpenClaw obiecał zwroty pieniędzy dla użytkowników z aktywnymi subskrypcjami. Proces zwrotów trwa, a wielu klientów narzeka na brak komunikacji. Część użytkowników płaciła za roczne abonamenty - teraz czekają na zwrot kilkuset dolarów, nie mając pewności, czy w ogóle go dostaną.

To kolejna lekcja: jeśli Twój biznes opiera się na cudzej infrastrukturze, musisz mieć plan B. Nie tylko techniczny (alternatywny dostawca API), ale też finansowy (rezerwy na zwroty, ubezpieczenie od utraty dostępu) i komunikacyjny (jak poinformujesz klientów o problemie).

OpenClaw najwyraźniej nie miał żadnego z tych planów. Startup milczy w mediach społecznościowych, strona pokazuje tylko komunikat o "problemach technicznych", a użytkownicy organizują się w grupach na Reddicie, żeby wymienić informacje o zwrotach.

Ironiczne jest to, że Anthropic pozycjonuje się jako firma stawiająca na bezpieczeństwo i odpowiedzialność w AI. Zakłada think tanki, publikuje badania o osobowościach modeli AI, mówi o transparentności i etyce.

A potem odcina dostęp do API startupowi, który zbudował na nim biznes - bez wyjaśnienia przyczyn i bez okresu przejściowego dla użytkowników. Trudno to nazwać odpowiedzialnym podejściem do ekosystemu partnerów.

Oczywiście, Anthropic ma prawo decydować, komu udostępnia swoje API. Sposób, w jaki to zrobił - bez ostrzeżenia, bez dialogu, bez troski o użytkowników końcowych - pokazuje jednak, że "odpowiedzialność" w AI często kończy się tam, gdzie zaczyna się biznes.

OpenClaw nie był pierwszym startupem odciętym od API przez dużego dostawcę. I na pewno nie będzie ostatnim. Każdy, kto buduje produkt AI na cudzej infrastrukturze, powinien zadać sobie pytanie: co zrobię, gdy mój dostawca zamknie mi dostęp jutro? Jeśli nie masz odpowiedzi, masz problem.

Na podstawie: Golem.de

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar