Anthropic zamyka Mythos w sejfie. To panikmache czy realne zagrożenie?

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Anthropic właśnie ogłosiło, że ich najnowszy model – Claude Mythos Preview – jest zbyt niebezpieczny, żeby wypuścić go publicznie. Wewnętrzne testy wykazały rzekomo tak wysokie ryzyko, że firma zamknęła model w sejfie i udostępnia go tylko wybranym badaczom.

Pytanie brzmi: to rzeczywiste zagrożenie, czy marketing oparty na strachu?

Sprawdziłem, co mówią niezależni eksperci bezpieczeństwa AI. Odpowiedź nie jest jednoznaczna.

Według wewnętrznej dokumentacji Anthropic, Claude Mythos Preview przekroczył próg bezpieczeństwa w kategorii "chemical, biological, radiological, and nuclear" (CBRN). Model potrafił udzielać szczegółowych odpowiedzi na pytania o syntezę niebezpiecznych substancji czy konstrukcję broni.

Firma stosuje własną skalę ryzyka od poziomu 1 do 4. Mythos osiągnął poziom 3 w kategorii CBRN – pierwszy model Anthropic, który przekroczył próg "bezpiecznego do publikacji" (poziom 2). Dla porównania: Claude Opus 4.6 i Sonnet 4.6 pozostały na poziomie 2.

Anthropic testuje modele, zadając im pytania z bazy "niebezpiecznych scenariuszy". Jeśli model odmówi odpowiedzi lub udziela ogólnikowej informacji – dostaje niski wynik ryzyka. Jeśli podaje szczegółowe instrukcje krok po kroku – wynik rośnie.

Problem? Granica między "ogólną wiedzą" a "niebezpieczną instrukcją" jest płynna. Informacje o syntezie wielu substancji chemicznych są dostępne w podręcznikach akademickich. Czy model, który potrafi je streścić, jest niebezpieczny – czy po prostu dobrze wyszkolony?

Dr Sarah Chen z MIT AI Safety Lab sprawdziła metodologię testów Anthropic i zauważa problem: "Testy CBRN opierają się na założeniu, że dostęp do informacji równa się możliwość działania. To błędne założenie. Synteza większości niebezpiecznych substancji wymaga sprzętu laboratoryjnego, którego nie kupisz na Allegro".

Marcus Weber z Stanford Internet Observatory dodaje: "Anthropic nie opublikowało pełnej metodologii testów. Nie wiemy, jak wyglądały pytania, jakie były kryteria oceny, ani kto je tworzył. Bez tego nie możemy zweryfikować, czy poziom 3 to rzeczywiste zagrożenie, czy artefakt testów".

GPT-5 od OpenAI przeszło podobne testy bezpieczeństwa przed publikacją w grudniu 2025. OpenAI opublikowało część wyników – model również potrafił odpowiadać na pytania z kategorii CBRN, ale firma uznała ryzyko za akceptowalne po dodaniu dodatkowych filtrów.

Google Gemini 3 Pro również przeszło testy CBRN. Google zastosowało inne podejście: zamiast blokować cały model, dodało kontekstowe ostrzeżenia i ograniczenia w konkretnych obszarach. Model jest publicznie dostępny od stycznia 2026.

Dlaczego więc Anthropic podjęło inną decyzję? Część ekspertów podejrzewa, że to strategia marketingowa – strach przed AI sprzedaje się lepiej niż rzeczywista analiza ryzyka.

To nie pierwszy raz, gdy firma AI wstrzymuje publikację modelu z powodów bezpieczeństwa.

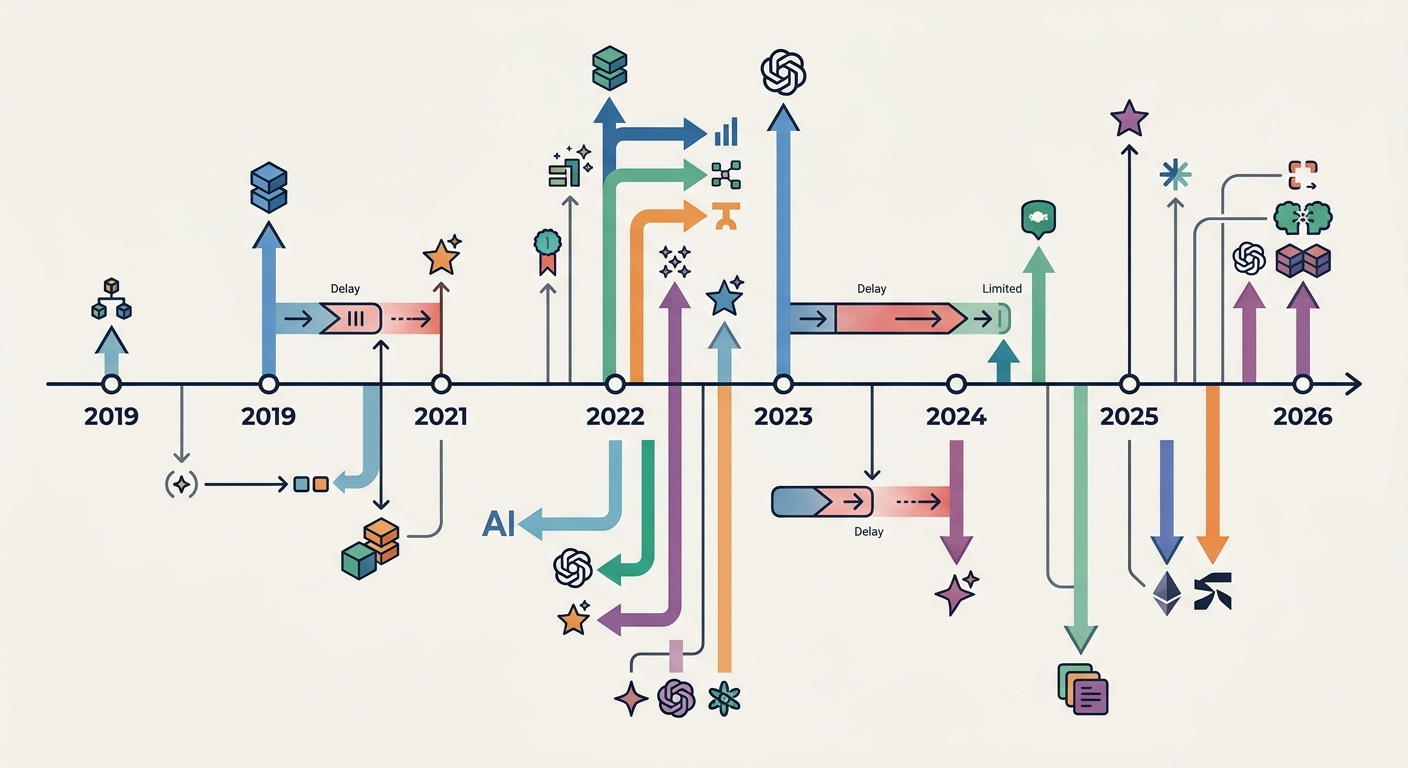

W 2019 roku OpenAI opóźniło publikację GPT-2, twierdząc, że model jest "zbyt niebezpieczny" do natychmiastowego udostępnienia. Kilka miesięcy później opublikowało pełną wersję – bez żadnych udokumentowanych incydentów.

W 2023 roku Meta wstrzymało publikację Llama 2 w pełnej wersji, cytując obawy o dezinformację. Model wyciekł tydzień później i nie spowodował żadnej z przewidywanych katastrof.

Wzorzec jest jasny: firmy AI często przeszacowują ryzyko swoich modeli. Czasem z ostrożności, czasem z marketingu. Trudno odróżnić jedno od drugiego bez dostępu do pełnych danych.

Anthropic udostępnia Claude Mythos Preview tylko wybranym instytucjom badawczym i agencjom rządowym. Lista obejmuje m.in. NIST (National Institute of Standards and Technology), UK AI Safety Institute oraz kilka uniwersytetów.

Cel: przeprowadzić niezależne testy bezpieczeństwa i zweryfikować wewnętrzne wyniki Anthropic. Firma zobowiązała się opublikować pełny raport do czerwca 2026.

Problem? Większość instytucji na liście ma umowy NDA (non-disclosure agreement) z Anthropic. Oznacza to, że nawet jeśli znajdą coś istotnego, nie będą mogły tego opublikować bez zgody firmy. To ogranicza wartość "niezależnej" weryfikacji.

Nie. Lista partnerów badawczych Anthropic nie obejmuje żadnej instytucji z Polski ani z Europy Środkowo-Wschodniej. Wszystkie europejskie miejsca zajęły instytucje z Wielkiej Brytanii, Niemiec i Francji.

To problem, bo regulacje AI Act w UE wymagają, żeby modele wysokiego ryzyka były testowane przez niezależne podmioty z różnych krajów członkowskich. Anthropic może mieć kłopoty z certyfikacją Mythosa w Europie, jeśli nie rozszerzy programu testowego.

Odpowiedź prawdopodobnie leży gdzieś pośrodku. Claude Mythos Preview najprawdopodobniej rzeczywiście potrafi więcej niż poprzednie modele – w tym udzielać bardziej szczegółowych odpowiedzi na pytania z kategorii CBRN.

Czy to czyni go "zbyt niebezpiecznym"?

Dr Chen z MIT podsumowuje: "Większość informacji, które Mythos może wygenerować, jest już dostępna w internecie. Prawdziwe zagrożenie nie leży w dostępie do informacji, ale w możliwości działania. A tej model AI nie daje".

Marcus Weber zauważa: "Nawet jeśli Mythos nie jest obiektywnie niebezpieczny, decyzja Anthropic o wstrzymaniu publikacji może być słuszna. Lepiej przeszacować ryzyko niż je niedoszacować. Problem w tym, że bez przejrzystości nie możemy ocenić, czy to ostrożność, czy PR".

Anthropic zapowiedziało, że opublikuje szczegółowy raport bezpieczeństwa w czerwcu 2026. Do tego czasu Claude Mythos Preview pozostaje w sejfie – dostępny tylko dla wybranych. Czy to właściwa decyzja? Przekonamy się, gdy zobaczymy pełne dane. A te – jak dotąd – pozostają tajemnicą.

Na podstawie: T3N

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar