Apple może destylować własne modele AI z Gemini Google

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Kiedy Apple ogłosiło partnerstwo z Google w zakresie AI, większość uznała to za prostą integrację: Siri nie wie? Pytamy Gemini. Koniec historii.

Okazuje się, że umowa może być znacznie głębsza. Według doniesień z branży, Apple może otrzymać dostęp do destylacji modeli bezpośrednio z Gemini - czyli tworzenia własnych, mniejszych wersji AI, które uczą się od większego modelu Google.

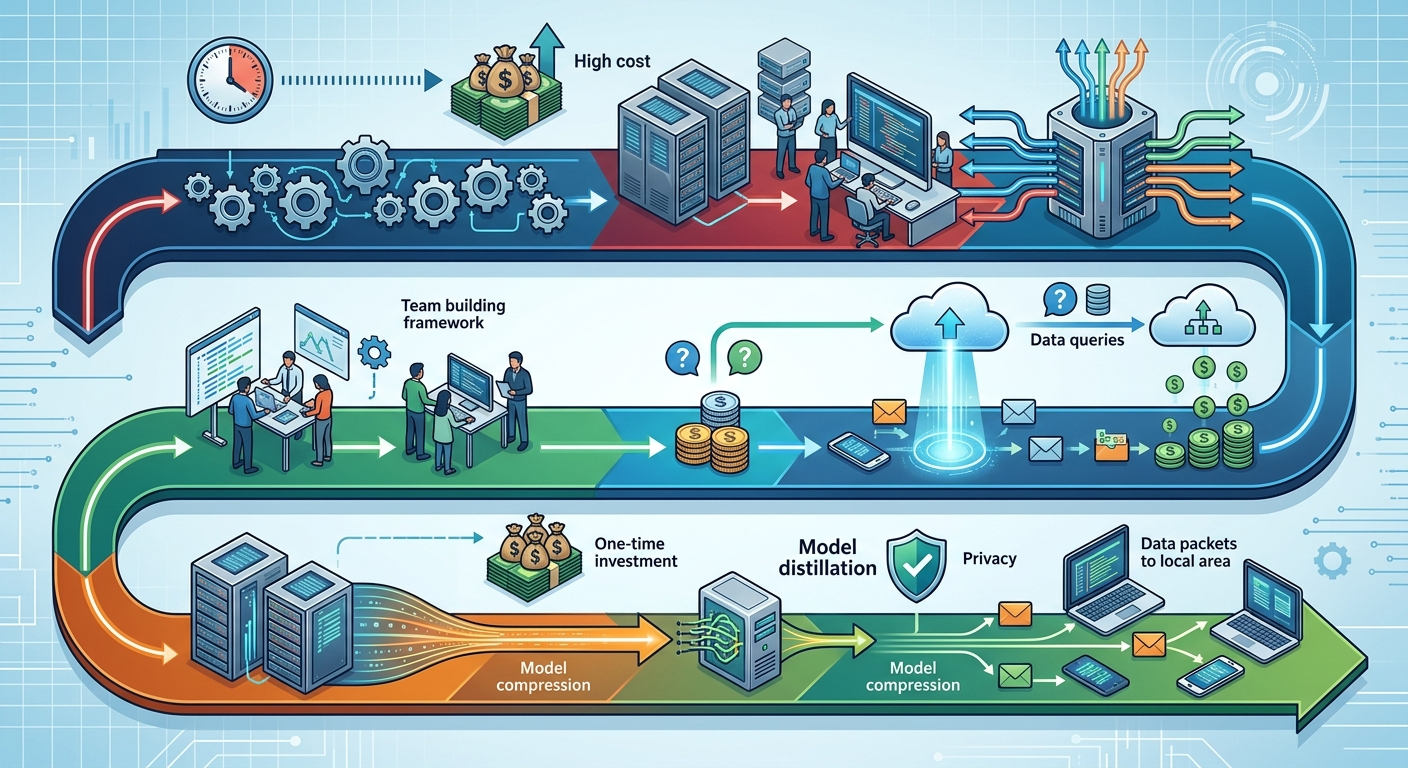

Destylacja to technika, w której duży, potężny model AI (tzw. "nauczyciel") uczy mniejszy model ("uczeń") jak myśleć. Mniejszy model nie kopiuje kodu - uczy się wzorców, sposobu rozumowania, stylu odpowiedzi.

Efekt? Dostajesz model, który:

Apple od lat stawia na prywatność i przetwarzanie on-device. Problem? Trenowanie dużych modeli AI od zera kosztuje setki milionów dolarów i wymaga lat pracy. OpenAI łączy swoje narzędzia, Anthropic rozwija Claude, a Apple... ma Siri, które wciąż nie rozumie kontekstu.

Jeśli doniesienia się potwierdzą, Apple dostaje coś więcej niż API do Gemini. Dostaje dostęp do wiedzy Google - bez konieczności budowania własnej infrastruktury treningowej od podstaw.

Konkretnie:

Zamiast trenować modele od zera, Apple może destylować wiedzę z Gemini 2.5 Pro do własnych, mniejszych modeli dopasowanych do iPhone'a, iPada czy Apple Watch. To skraca czas rozwoju z lat do miesięcy.

Destylowane modele są na tyle małe, że mogą działać lokalnie. To oznacza szybsze odpowiedzi, brak opóźnień sieciowych i - co kluczowe dla Apple - zero wysyłania danych do chmury. Bezpieczeństwo i prywatność to argument sprzedażowy, który Apple zna na pamięć.

Każde zapytanie do chmury kosztuje. Model działający na urządzeniu? Płacisz raz - za chip. Reszta to koszt energii użytkownika, nie Apple.

Google nie robi tego z dobroci serca. W zamian za dostęp do destylacji, Gemini staje się domyślnym "cloud AI" dla Siri w sytuacjach, gdy lokalny model nie wystarczy.

To oznacza:

Poza tym Google wciąż kontroluje "nauczyciela". Apple może destylować wiedzę z Gemini, ale nie dostaje dostępu do wag modelu, architektury czy danych treningowych. To jak wynajęcie korepetytora, nie kupno jego mózgu.

Jeśli Apple rzeczywiście zacznie destylować modele z Gemini, możemy spodziewać się:

Lepszego wsparcia dla języka polskiego. Gemini 2.5 radzi sobie z polskim znacznie lepiej niż poprzednie modele Apple. Destylowane wersje powinny dziedziczyć tę wiedzę. Google Gemini Code Assist już pokazał, że Google potrafi obsługiwać niszowe języki.

Szybszej adopcji AI w firmach. Polskie przedsiębiorstwa, zwłaszcza w sektorze finansowym i medycznym, obawiają się wysyłania danych do chmury. Modele działające lokalnie na urządzeniach Apple mogą złamać ten opór.

Presji na lokalnych dostawców AI. Jeśli Apple dostarczy przyzwoite AI offline w telefonie za 0 zł miesięcznie, trudniej będzie sprzedawać subskrypcje narzędzi chmurowych.

Destylacja to nie nowość - OpenAI używa tej techniki do tworzenia szybszych wersji swoich modeli, Anthropic destyluje Claude Opus do wersji Sonnet i Haiku. Różnica? Apple ma 1,5 miliarda aktywnych urządzeń.

Jeśli Cupertino nauczy się destylować modele efektywnie, może wyprodukować dziesiątki wyspecjalizowanych AI: jedno do zdjęć, drugie do kalendarza, trzecie do maili. Każde małe, szybkie, działające offline. Razem tworzące ekosystem, który nie potrzebuje chmury.

To zmienia dynamikę rynku. Dzisiaj AI to wyścig mocy - kto ma większy model, ten wygrywa. Jutro może być wyścig efektywności - kto zmieści więcej inteligencji w mniejszym pakiecie, ten zdobędzie urządzenia użytkowników.

Apple ma hardware. Google ma wiedzę. Jeśli połączą to dobrze, konkurencja będzie musiała nadrobić dystans - albo zaakceptować, że przegrała wyścig o AI w kieszeni.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar