Cerebras idzie na giełdę. OpenAI zapłaci im 10 miliardów

Źródło: Link

Źródło: Link

Szkolenia, warsztaty i wdrożenia AI. Dopasowane do Twojego zespołu.

Co sprawia, że firma produkująca chipy AI decyduje się na wejście na giełdę akurat teraz? Ma klientów z portfelami grubszymi niż budżet małego państwa.

Cerebras — startup z Doliny Krzemowej — właśnie złożył dokumenty do IPO. Firma specjalizuje się w produkcji procesorów zaprojektowanych specjalnie pod trening i wnioskowanie modeli AI. To nie są kolejne GPU. To coś zupełnie innego.

W ostatnich miesiącach Cerebras ogłosił dwie rzeczy: umowę z Amazon Web Services (chipy Cerebras trafią do centrów danych AWS) oraz kontrakt z OpenAI o wartości przekraczającej 10 miliardów dolarów. Tak, dobrze przeczytałeś — 10 miliardów. To nie błąd w zaokrągleniu.

Standardowe GPU (jak te od Nvidii) to procesory zaprojektowane pierwotnie do grafiki. Okazały się świetne w obliczeniach równoległych — stąd ich popularność w AI. Cerebras poszedł inną drogą.

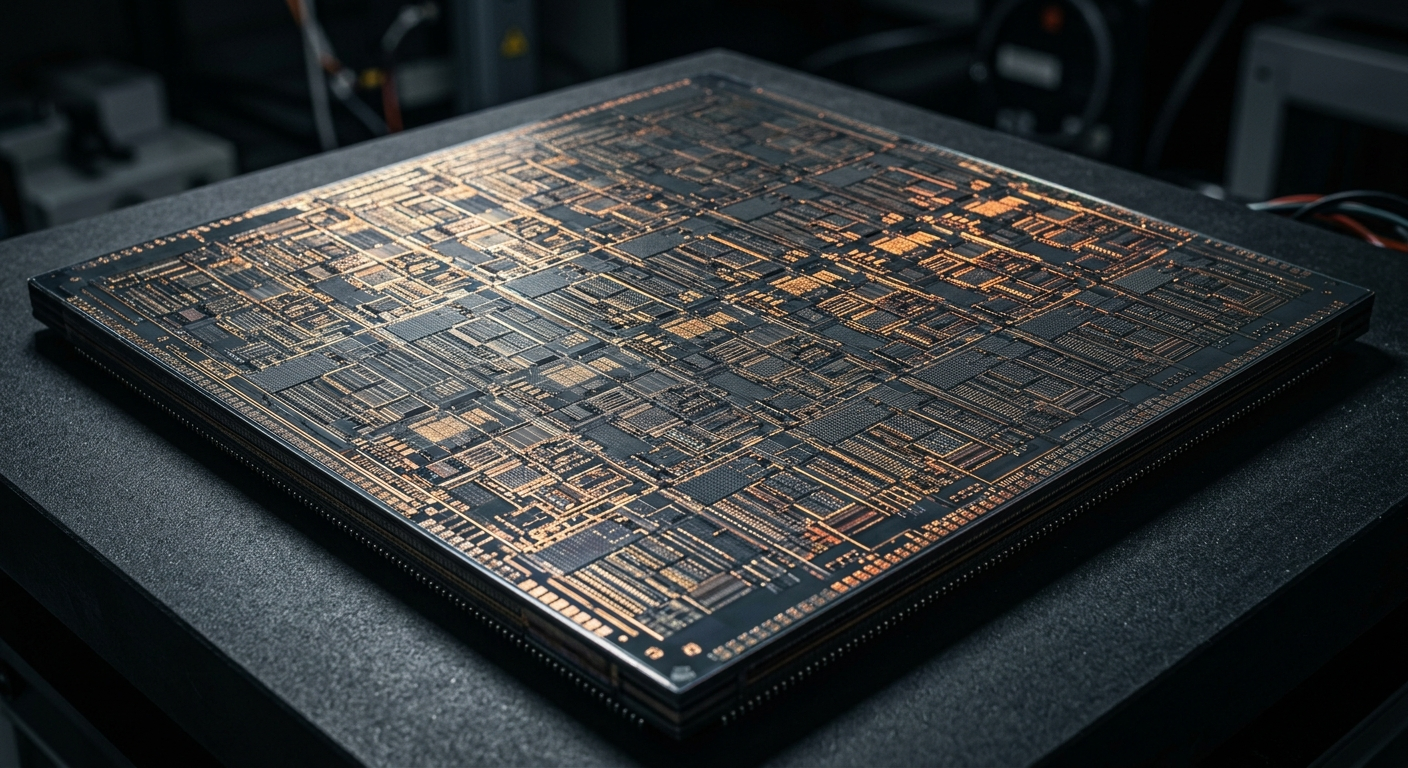

Ich procesor to wafer-scale engine — pojedynczy chip wielkości całego wafla krzemowego (około 21 cm × 21 cm). Dla porównania: typowy procesor to mały kawałek takiego wafla. Cerebras bierze cały wafel i robi z niego jeden gigantyczny układ scalony.

Efekt? Więcej rdzeni, więcej pamięci, mniejsze opóźnienia w komunikacji między jednostkami obliczeniowymi. W praktyce: szybszy trening modeli AI i niższe koszty energii na operację (przynajmniej w teorii — zależy to od konkretnego zastosowania).

OpenAI trenuje modele pokroju GPT-5 i kolejnych iteracji. Każdy taki trening to setki tysięcy godzin obliczeń na tysiącach procesorów. Koszty? Astronomiczne.

Jeśli Cerebras oferuje architekturę, która przyspiesza trening o 20-30% albo obniża koszty energii o podobny procent, to przy skali OpenAI te 10 miliardów to nie wydatek — to inwestycja zwracająca się w ciągu kilku lat.

Dodatkowo: OpenAI nie chce być uzależnione wyłącznie od Nvidii. Dywersyfikacja dostawców sprzętu daje większą kontrolę nad kosztami i dostępnością zasobów. Szczególnie teraz, gdy koszty energii rosną, a dostępność chipów bywa problematyczna.

Amazon Web Services to jeden z największych dostawców usług chmurowych na świecie. Jeśli AWS dodaje chipy Cerebras do swojej oferty, to sygnał dla rynku: ta technologia działa na tyle dobrze, że warto ją oferować klientom.

Firmy korzystające z AWS będą mogły trenować i uruchamiać modele AI na sprzęcie Cerebras — bez konieczności kupowania własnych serwerów. To obniża próg wejścia dla mniejszych graczy, którzy nie mają budżetu na własną infrastrukturę.

Dla Cerebras to klucz do skalowalności. Sprzedaż chipów bezpośrednio do firm to jedno. Umowa z AWS to dostęp do tysięcy potencjalnych klientów, którzy nawet nie wiedzą, że używają technologii Cerebras — po prostu wynajmują moc obliczeniową w chmurze.

Jeśli prowadzisz firmę w Polsce i korzystasz z AWS (albo planujesz), to dostęp do chipów Cerebras może oznaczać niższe koszty treningu własnych modeli AI. Szczególnie jeśli pracujesz nad rozwiązaniami językowymi dla polskiego rynku — tam każda złotówka zaoszczędzona na infrastrukturze to więcej budżetu na dane i rozwój.

Jeśli Cerebras wejdzie na giełdę i pozyska kapitał, może otworzyć biura w Europie. To potencjalne miejsca pracy dla polskich inżynierów i większa dostępność technologii na lokalnym rynku.

Cerebras składa dokumenty IPO w kwietniu 2026 roku. Rynek AI jest gorący — Anthropic generuje 30 miliardów przychodu, Nvidia stawia na azjatyckie centra danych, a inwestorzy szukają sposobów, żeby wejść w infrastrukturę AI.

Cerebras ma dwie rzeczy, które inwestorzy lubią: kontrakt z OpenAI (przewidywalne przychody na lata) i umowę z AWS (skalowalność). To nie startup bez modelu biznesowego — to firma z klientami, którzy płacą miliardy.

Ryzyko? Nvidia nadal dominuje na rynku GPU do AI. Google ma własne TPU (Tensor Processing Units). Amazon rozwija chipy Trainium i Inferentia. Cerebras musi udowodnić, że ich architektura jest na tyle lepsza, żeby klienci płacili więcej (albo przełączali się z konkurencji).

Jeśli pracujesz z AI — czy to jako programista, czy jako osoba zarządzająca projektami — warto śledzić, co dzieje się na rynku chipów. Koszty infrastruktury to często największa pozycja w budżecie projektów AI.

Cerebras i podobne firmy (jak Firmus w Azji) pokazują, że rynek się dywersyfikuje. Większa konkurencja, niższe ceny, więcej opcji do wyboru.

Jeśli prowadzisz małą firmę i testujesz AI, to dobra wiadomość: technologia staje się dostępniejsza. Nie musisz kupować własnych serwerów — wynajmujesz moc obliczeniową w chmurze, a dostawcy (jak AWS) oferują coraz lepszy sprzęt.

Jeśli jesteś inwestorem — IPO Cerebras to sygnał, że rynek infrastruktury AI rośnie. Pamiętaj: nie każdy startup, który wchodzi na giełdę, przetrwa. Sprawdź fundamenty: kto płaci, ile płaci i na jak długo.

Ostatecznie: Cerebras może wygrać albo przegrać z Nvidią. Sama próba pokazuje, że monopol w technologii AI nie jest przesądzony. Masz więcej opcji — i to jest dobra wiadomość, niezależnie od tego, po której stronie stoisz.

Na podstawie: TechCrunch AI

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar