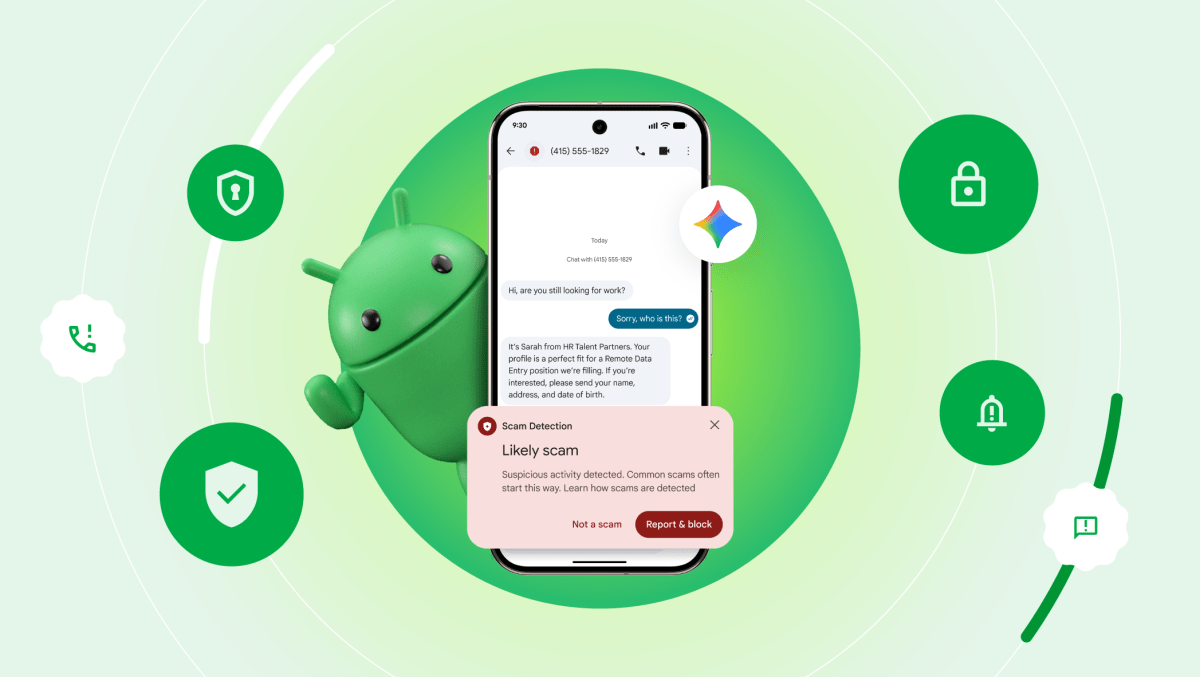

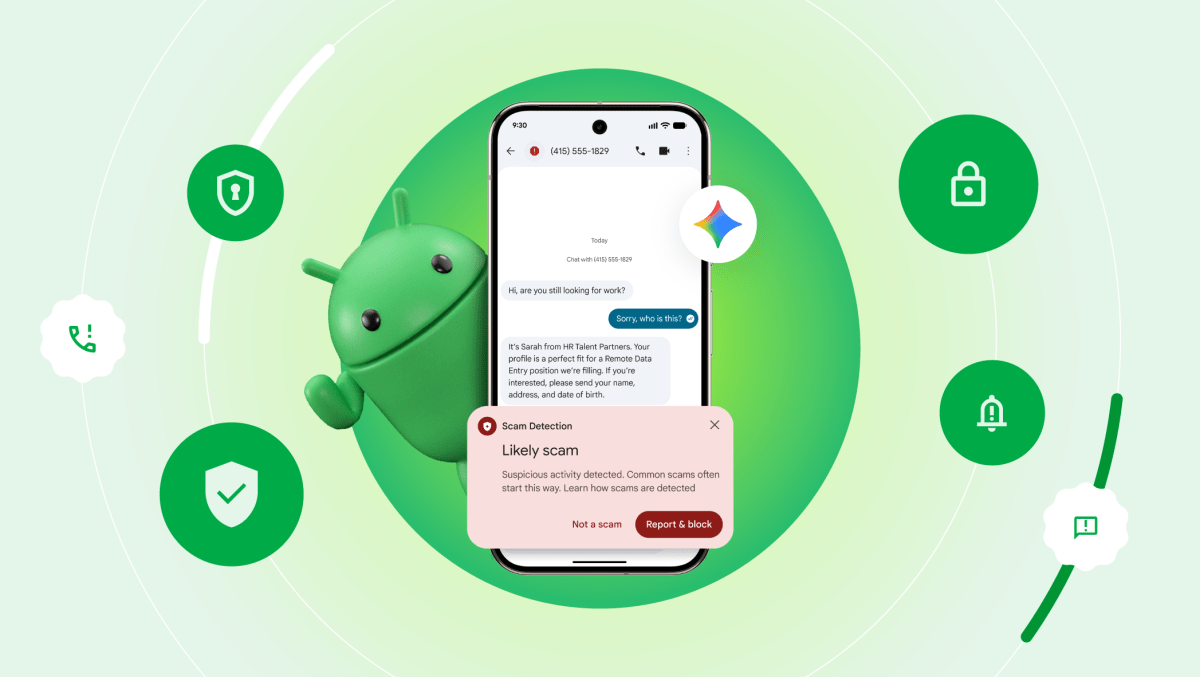

Gemini automatyzuje zadania Android. Google idzie dalej

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Dobra, powiedzmy to wprost: asystenci AI do tej pory byli jak praktykanci - musieli pytać o każdy krok. Gemini właśnie awansował.

Google ogłosiło w lutym 2026, że Gemini na Androidzie nauczył się wykonywać wieloetapowe zadania bez Twojego ciągłego nadzoru. Mówisz "zamów pizzę" - a on sam otwiera aplikację, wybiera restaurację, dodaje do koszyka i finalizuje zamówienie. Podobnie z zamawianiem przejazdu czy zakupów spożywczych.

To nie jest kolejna funkcja "nice to have". To fundamentalna zmiana w tym, jak AI działa na Twoim telefonie.

Dotychczas Gemini działał jak zaawansowana wyszukiwarka - odpowiadał na pytania, tłumaczył teksty, generował treści. Teraz Google uczy go działać jak agent: rozumieć intencję, planować kroki i wykonywać je samodzielnie.

Różnica? Wcześniej mówiłeś "pokaż mi pizzerie w okolicy". Teraz mówisz "zamów mi pizzę margherita" - i Gemini sam:

Wszystko to na podstawie jednego polecenia głosowego. Żadnych dodatkowych pytań. Żadnego przełączania się między ekranami.

Google integruje Gemini bezpośrednio z API popularnych aplikacji na Androidzie. Asystent nie "klika" w interfejs jak człowiek (co byłoby wolne i zawodne), ale komunikuje się z aplikacjami na poziomie kodu.

Gemini analizuje Twoje polecenie, rozbija je na sekwencję działań, a następnie wykonuje je przez odpowiednie API. Jeśli brakuje mu informacji (np. nie wiesz, z której restauracji zamawiasz), zapyta raz - nie przy każdym kroku.

Na start Google skupia się na trzech kategoriach zadań:

To dopiero początek. Google planuje rozszerzyć funkcjonalność na rezerwacje restauracji, hoteli, biletów lotniczych czy zarządzanie kalendarzem. Lista partnerskich aplikacji ma rosnąć w kolejnych miesiącach 2026 roku.

Kluczowe pytanie: czy Gemini będzie działał tylko z wybranymi aplikacjami, czy otworzy się na szerszy ekosystem? Na razie Google milczy na temat szczegółów, ale presja regulacyjna może wymusić większą otwartość.

Znam to. Kolejna funkcja, która "w teorii" ułatwia życie, a w praktyce działa w 60% przypadków i frustruje bardziej niż pomaga.

Sprawdzam więc, gdzie to ma sens, a gdzie to tylko demo na konferencję.

Powtarzalne zadania, które robisz regularnie i które mają przewidywalną strukturę. Zamawianie tego samego jedzenia w piątkowy wieczór. Wzywanie Ubera do pracy o tej samej godzinie. Cotygodniowe zakupy spożywcze z podobnej listy.

Tu Gemini faktycznie oszczędza czas. Zamiast otwierać aplikację, przeszukiwać menu, klikać przez trzy ekrany - mówisz jedno zdanie i wracasz do tego, co robiłeś.

Zadania wymagające kontekstu, który AI nie ma. Jeśli zamawiasz jedzenie na spotkanie ze znajomymi i musisz uwzględnić alergię jednej osoby, preferencje drugiej i budżet trzeciej - Gemini będzie potrzebował Twojego udziału. Albo podejmie decyzję za Ciebie (czego możesz nie chcieć).

Podobnie z sytuacjami nietypowymi. Jeśli Twoja ulubiona restauracja jest zamknięta, a Gemini wybierze alternatywę bez pytania - możesz dostać coś, czego nie chciałeś.

Gemini, żeby działać w Twoim imieniu, potrzebuje dostępu do Twoich aplikacji, danych płatniczych, lokalizacji, historii zamówień. To spory zakres uprawnień.

Google zapewnia, że dane są przetwarzane lokalnie na urządzeniu tam, gdzie to możliwe, a integracje z aplikacjami wymagają Twojej zgody. Możesz też w każdej chwili cofnąć uprawnienia dla konkretnych aplikacji.

Realnie? Musisz zaufać Google, że nie wykorzysta tych danych do czegoś więcej niż deklaruje. Historia pokazuje, że AI na Androidzie może być wykorzystywane na różne sposoby - nie zawsze zgodne z intencjami twórców.

Zrób jedną rzecz: zanim włączysz automatyzację zadań, przejrzyj ustawienia prywatności Gemini. Sprawdź, które aplikacje mają dostęp, jakie dane są udostępniane i czy możesz ograniczyć zakres do minimum, który Ci wystarcza.

Google nie jest jedyny w wyścigu o autonomicznych agentów AI. Apple pracuje nad podobnymi funkcjami dla Siri, Amazon rozwija Alexę w kierunku większej proaktywności. Chińskie firmy jak Alibaba inwestują w AI z długoterminową pamięcią, co może dać ich asystentom przewagę w rozumieniu kontekstu.

Różnica? Google ma Android. To 70% rynku smartfonów na świecie. Gemini jest wbudowany w system operacyjny, ma dostęp do wszystkich aplikacji, zna Twoje nawyki lepiej niż konkurencja.

Apple ma zamknięty ekosystem iOS, co daje kontrolę, ale ogranicza skalę. Amazon nie ma własnego systemu mobilnego (Fire OS praktycznie umarł). Google ma pozycję startową, której inni mogą pozazdrościć.

To dopiero początek. Google testuje Gemini w scenariuszach, które są relatywnie proste i bezpieczne. Zamawianie jedzenia to jedno - ale Google ma większe plany dla Gemini na różnych platformach.

W kolejnych miesiącach możemy spodziewać się:

Ten ostatni punkt to największa zmiana. Przejście od "rób to, co mówię" do "przewiduj, czego potrzebuję". To moment, kiedy asystent staje się agentem w pełnym tego słowa znaczeniu.

Pytanie: czy jesteśmy gotowi na AI, który podejmuje decyzje za nas? I czy potrafimy ustawić granice, których nie powinien przekraczać?

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar