Gemini potrafi teraz sprawdzić, czy zdjęcie to fejk AI

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Pytasz AI, czy coś jest AI. Paradoks? Może. Ale właśnie to zrobił Google.

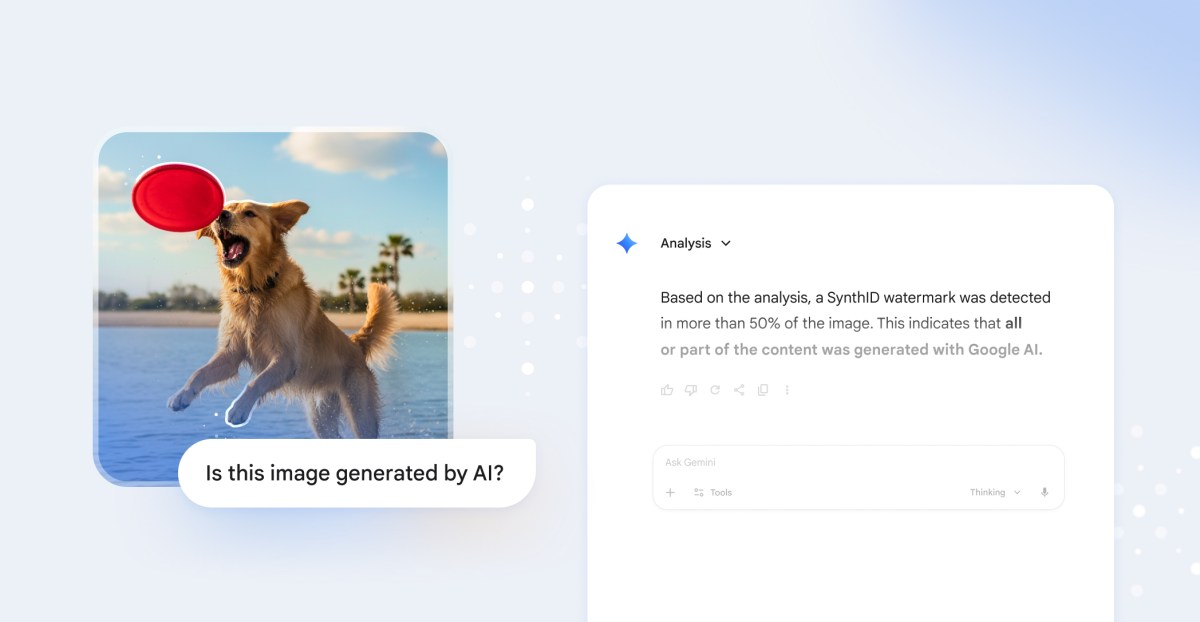

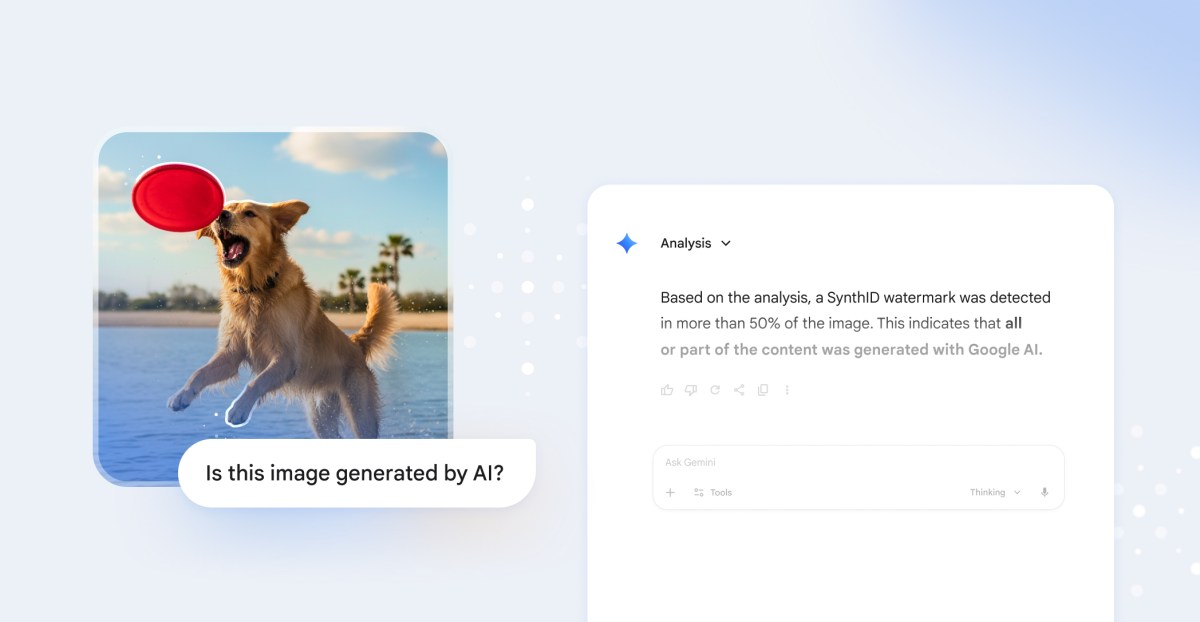

Od dziś Gemini potrafi sprawdzić, czy obraz wyszedł z narzędzi Google'a. Wrzucasz zdjęcie, pytasz: "Czy to wygenerowane przez AI?" I tyle.

Brzmi jak science fiction? Jeszcze rok temu byłoby. Dziś to rzeczywistość, z którą musimy się oswoić. Świat pełen syntetycznych obrazów wymaga nowych narzędzi weryfikacji. I choć rozwiązanie Google'a nie jest idealne, to przynajmniej ktoś próbuje coś z tym zrobić.

Gemini szuka cyfrowych odcisków palców – technologii SynthID. To niewidoczny watermark, który Google wmontowuje w swoje kreacje AI. Tatuaż na pikselu, można powiedzieć.

Obrazek z Imagen, Veo czy innego narzędzia Google'a? Gemini go rozpozna. Problem? Na razie tylko własne dzieła Google'a. Meta, OpenAI, Midjourney – poza zasięgiem.

SynthID działa na poziomie pikseli, wplatając informacje o pochodzeniu obrazu w sposób, który przetrwa nawet kompresję czy drobne edycje. To nie jest zwykły metadata, którą można usunąć jednym kliknięciem. To coś głębszego – wzór zakodowany w samej strukturze obrazu, niewidoczny dla ludzkiego oka, ale czytelny dla algorytmów.

Proces weryfikacji jest banalnie prosty. Otwierasz Gemini, wrzucasz podejrzany obraz i zadajesz pytanie. Model analizuje plik w ułamku sekundy i odpowiada: tak, to nasze dzieło – albo nie, nie rozpoznaję tego. Bez skomplikowanych interfejsów, bez technicznych zawiłości.

Technologia wykrywa wyłącznie obrazy z wbudowanym SynthID. A co z resztą internetu? Co z deepfake'ami z innych źródeł? Cisza.

Google nie ukrywa: to nie jest uniwersalny detektor. Raczej pierwszy, ostrożny krok. W dobrą stronę – owszem.

Wyobraź sobie sytuację: scrollujesz media społecznościowe, widzisz szokujące zdjęcie polityka w kompromitującej sytuacji. Wrzucasz do Gemini. Odpowiedź: "nie wykryto SynthID". Co to znaczy? Że obraz jest prawdziwy? Niekoniecznie. Może powstał w DALL-E, Stable Diffusion, albo jakimś chińskim narzędziu, o którym nawet nie słyszałeś. Gemini po prostu nie ma pojęcia.

To jak strażnik, który zna tylko twarze z własnej dzielnicy. Skuteczny lokalnie, bezradny globalnie. I tu pojawia się pytanie: czy częściowa weryfikacja jest lepsza niż żadna? Pewnie tak. Ale użytkownicy muszą rozumieć te ograniczenia, inaczej fałszywe poczucie bezpieczeństwa może być gorsze niż brak narzędzia.

Rok 2025. Deepfake'i wszędzie. Politycy, którzy nigdy nie powiedzieli danego zdania. Zdjęcia miejsc, które nie istnieją. Twarze ludzi, którzy się nigdy nie urodzili.

Ironia? Teraz AI ma nas bronić przed AI. Historia zatoczyła koło – i to całkiem szybko.

Dla zwykłego użytkownika może to oznaczać jedno: mniej czasu na zastanawianie się "prawda czy fotomontaż". Przynajmniej w teorii. W praktyce – no cóż, zobaczymy.

Problem nabrał krytycznej masy podczas ostatnich wyborów w kilku krajach. Syntetyczne nagrania kandydatów, sfabrykowane zdjęcia z rzekомych skandali, wirusowe materiały, które okazywały się całkowicie sztuczne – ale dopiero po wyborach. Szkoda była już wyrządzona.

Nie chodzi tylko o politykę. Firmy walczą z fałszywymi wizerunkami swoich produktów. Osoby publiczne z kompromitującymi deepfake'ami. Zwykli ludzie z syntetycznymi zdjęciami wykorzystywanymi do oszustw. Skala problemu rośnie wykładniczo, a narzędzia do weryfikacji ledwo za nią nadążają.

Gemini z funkcją detekcji to odpowiedź na realne zapotrzebowanie. Niedoskonała, ograniczona, ale konkretna. To nie obietnica na przyszłość – to działające rozwiązanie, które możesz przetestować już teraz. I choć nie rozwiąże wszystkich problemów, to przynajmniej pokazuje kierunek, w którym branża powinna iść.

Google otwarcie mówi: to dopiero beta. Funkcja będzie się uczyć, rozwijać. Może kiedyś rozpozna więcej niż tylko własne produkty. A może konkurencja dołoży swoje cegiełki i powstanie coś większego.

Jedno pewne: wyścig zbrojeń między twórcami AI a detektorami właśnie przyspieszył. I nie wiadomo, kto prowadzi.

Idealny scenariusz? Branżowy standard. Wszystkie główne platformy generujące obrazy AI – OpenAI, Anthropic, Stability AI, Midjourney – implementują kompatybilny system watermarków. Jeden detektor, wszystkie źródła. Utopia? Może. Ale nie niemożliwa.

Realistyczny scenariusz wygląda inaczej. Każda firma rozwija własną technologię. Użytkownicy muszą sprawdzać obrazy w kilku różnych narzędziach. Chaos, fragmentacja, frustracja. Dokładnie tak, jak to zwykle bywa z nowymi technologiami.

Chcesz przetestować? Gemini już czeka. Wrzucasz obraz, pytasz. Proste? Owszem. Skuteczne? Sam się przekonasz.

Przeczytaj też:

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar