Gemini Robotics ER 1.6: Google uczy roboty widzieć przestrzeń

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Robot rozpoznaje kubek na zdjęciu bez problemu. Ale gdy próbuje go podnieść ze stołu – pudło. Problem nie leży w sile chwytu ani precyzji silników. Większość modeli AI po prostu nie rozumie przestrzeni tak, jak Ty.

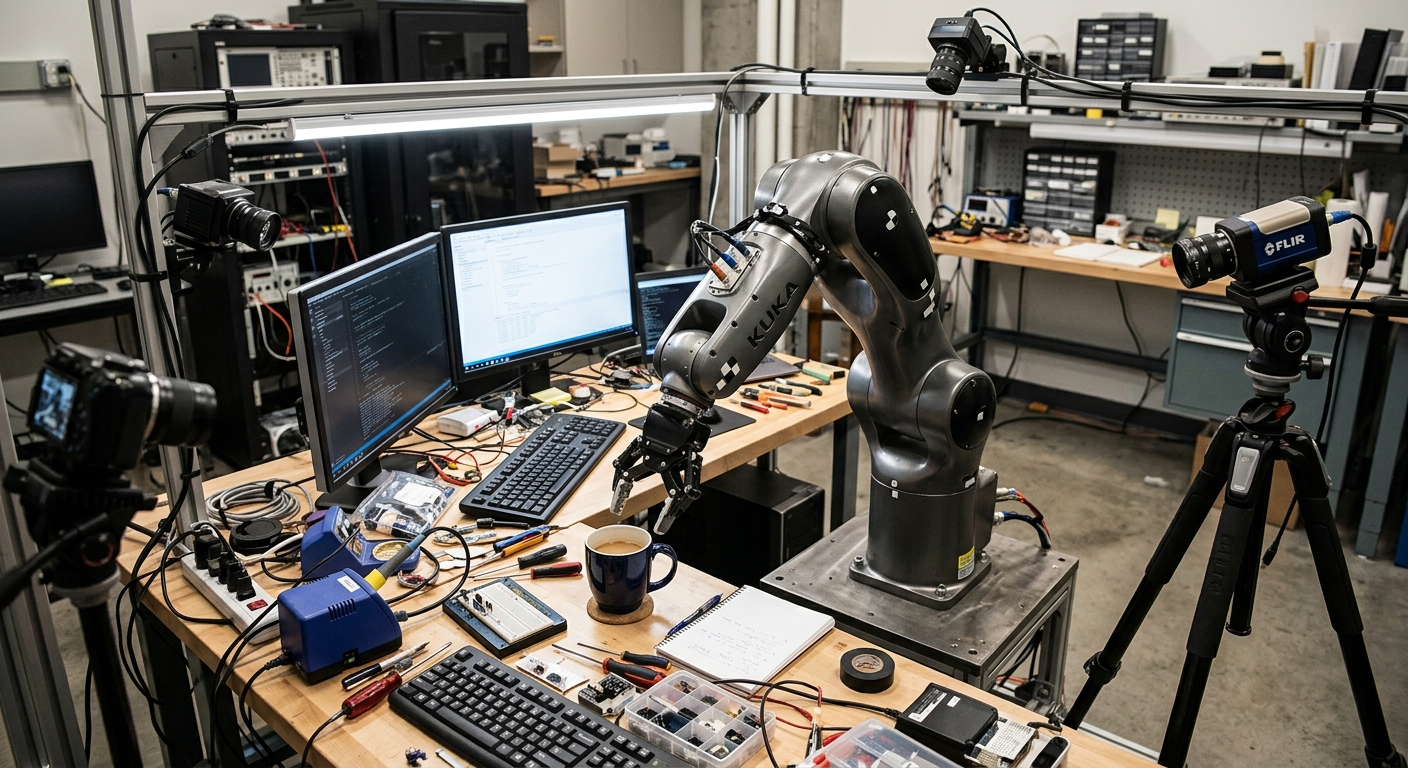

Google DeepMind właśnie wypuścił Gemini Robotics ER 1.6 – model, który ma to zmienić. ER to skrót od "Embodied Reasoning", czyli rozumowania w fizycznym ciele. W praktyce chodzi o to, żeby robot wiedział, gdzie jest jego ręka względem kubka, jak daleko musi się nachylić i pod jakim kątem chwycić.

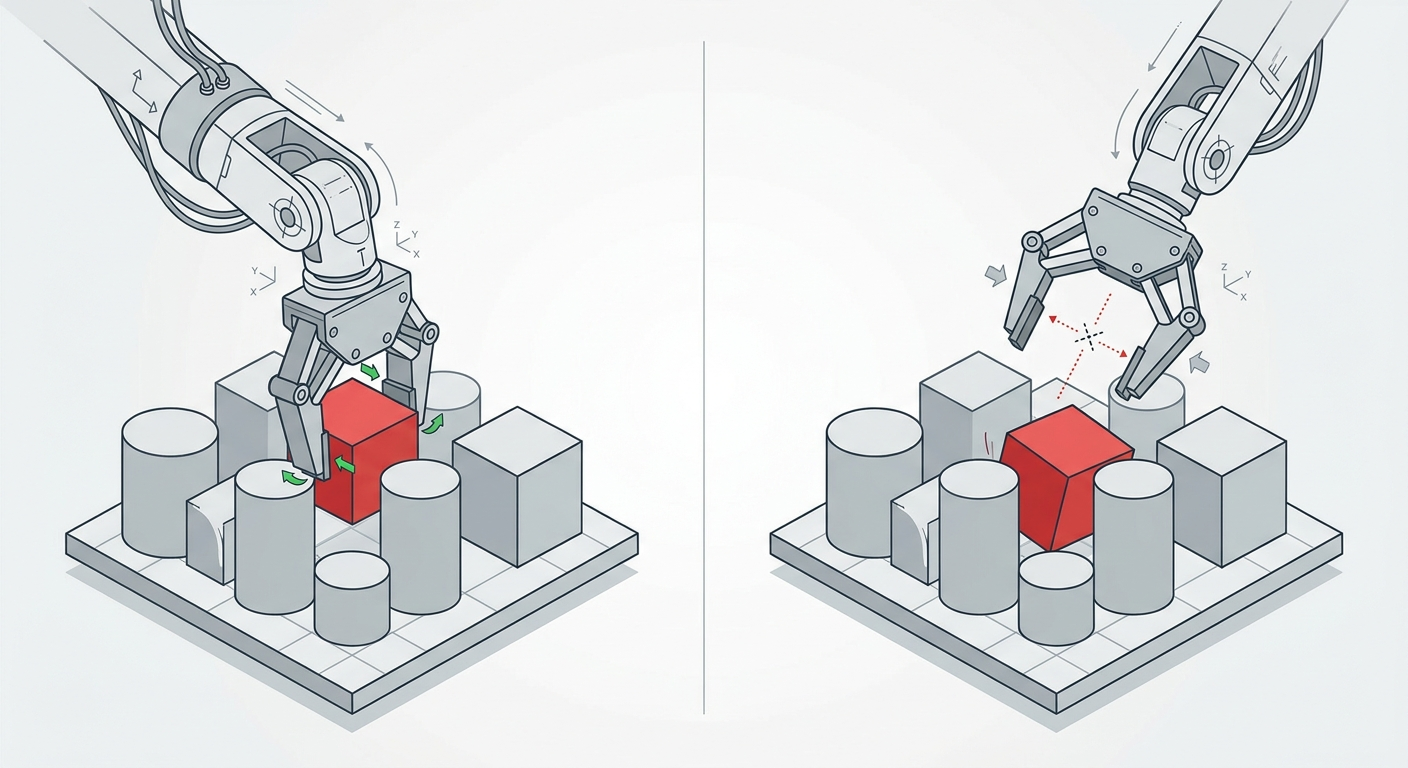

Gemini Robotics ER 1.6 różni się od standardowych modeli wizyjnych jedną kluczową rzeczą: rozumie relacje przestrzenne. Nie analizuje obrazu jak płaskiej grafiki. Buduje mentalną mapę obiektów w trzech wymiarach.

DeepMind podaje konkretny przykład: robot ma przed sobą kubek częściowo zasłonięty przez inny przedmiot. Standardowy model wizyjny widzi dwa obiekty, nie wie który jest bliżej. ER 1.6 potrafi to ocenić – i zaplanować ruch ręki tak, żeby nie przewrócić tego, co stoi z przodu.

To przepaść między robotem, który działa w kontrolowanym środowisku laboratoryjnym, a takim, który poradzi sobie w zwykłej kuchni. Gdzie kubki stoją obok talerzy, a ręczniki wiszą na krawędzi blatu.

Druga nowość to zdolność do przetwarzania obrazu z wielu kamer jednocześnie. Nie chodzi o zwykłe sklejanie perspektyw – ER 1.6 rozumie, że ten sam obiekt widziany z dwóch kątów to wciąż jeden obiekt, nie dwa różne.

W prawdziwym świecie roboty nie mają jednej kamery przymocowanej do głowy. Mają sensory w różnych miejscach – w nadgarstku, na torsie, czasem w otoczeniu. Wcześniejsze modele traktowały każdy obraz osobno. ER 1.6 łączy je w spójną całość.

DeepMind testował to na zadaniach manipulacyjnych: robot miał podnieść przedmiot widoczny tylko z jednej kamery, ale jego pozycję względem ręki pokazywała dopiero druga. Model poradził sobie – wcześniejsze wersje nie.

Gemini Robotics ER 1.6 to ewolucja, nie rewolucja. DeepMind nie podaje pełnej listy zmian, wymienia trzy kluczowe ulepszenia:

Techniczne detale, które w praktyce oznaczają różnicę między robotem wykonującym zadanie w 70% przypadków, a takim, który robi to w 90%. W laboratorium 70% wystarcza. W fabryce czy magazynie – nie.

DeepMind nie mówi wprost "to jest dla fabryk" ani "to jest dla domów". Z opisu zadań testowych wynika jasny obraz: ER 1.6 jest projektowany pod pick-and-place w zmiennym otoczeniu.

Konkretnie: sortowanie paczek w magazynie, gdzie każda ma inny kształt i leży pod innym kątem. Montaż elementów, gdzie robot musi chwycić część z pojemnika pełnego dziesiątek innych. Obsługa maszyn, gdzie trzeba włożyć narzędzie w uchwyt częściowo zasłonięty przez obudowę.

To nie są zadania wymagające inteligencji na poziomie człowieka. Wymagają czegoś, czego dotychczasowe roboty nie miały: zdolności do improwizacji w granicach zadania. Jeśli paczka leży inaczej niż wczoraj – robot powinien sobie poradzić bez przeprogramowania.

W Polsce roboty przemysłowe to wciąż głównie ramiona spawalnicze i paletyzatory – maszyny, które robią jedną rzecz, za to szybko. Gemini Robotics ER 1.6 celuje w inny segment: elastyczną automatyzację dla średnich firm, które nie mogą sobie pozwolić na dedykowaną linię produkcyjną.

Przykład: firma produkująca meble na zamówienie. Każde zlecenie to inny zestaw elementów, inne wymiary, inna kolejność montażu. Klasyczny robot wymaga przeprogramowania przy każdej zmianie. Robot z ER 1.6 – teoretycznie – dostaje zdjęcie docelowego produktu i sam planuje kolejność chwytów.

Teoretycznie, bo DeepMind nie podaje, czy model jest dostępny komercyjnie, w jakiej formie i za ile. To wciąż research project, nie produkt z ceną i datą dostawy. Kierunek jest jasny: Physical AI wchodzi do fabryk, a Google chce być tam pierwszy.

Google nie jest sam. OpenAI ma swój projekt robotyczny (niewiele o nim wiadomo, rekrutują inżynierów od embodied AI). Tesla rozwija Optimusa. Chiński startup chce wejść do 100 000 domów z robotami. Titan o1 kopiuje Twoje ruchy w czasie rzeczywistym, ucząc się przez demonstrację.

Gemini Robotics ER 1.6 to odpowiedź Google na pytanie: jak nauczyć robota widzieć, nie tylko rozpoznawać. Różnica jest subtelna, kluczowa. Rozpoznawanie to "widzę kubek". Widzenie to "kubek jest 30 cm ode mnie, pod kątem 15 stopni, częściowo zasłonięty przez talerz, muszę go chwycić z lewej strony".

Jeśli ER 1.6 faktycznie robi to niezawodnie – a DeepMind nie podaje jeszcze pełnych benchmarków – to Google ma przewagę. Google ma dane. Miliony godzin nagrań z YouTube, na których ludzie manipulują przedmiotami. To zasób, którego nikt inny nie ma w takiej skali.

DeepMind nie mówi o dwóch rzeczach kluczowych dla wdrożenia: szybkości inferencji i wymaganiach sprzętowych. Czy ER 1.6 działa w czasie rzeczywistym na zwykłym GPU, czy wymaga klastra serwerów? Czy robot może podejmować decyzje w 100 milisekund, czy potrzebuje sekundy na analizę?

To nie są akademickie pytania. Jeśli robot sortujący paczki musi czekać sekundę na każdą decyzję, jest bezużyteczny. Jeśli wymaga połączenia z chmurą, nie zadziała w fabryce bez stabilnego internetu.

Google milczy na ten temat. Model jest jeszcze za wolny, albo wymaga sprzętu, który kosztuje więcej niż sam robot. Albo – najbardziej prawdopodobne – DeepMind testuje go wewnętrznie i nie chce pokazywać kart przed czasem.

DeepMind publikuje research, nie sprzedaje robotów. Gemini Robotics ER 1.6 to model, który ktoś musi wbudować w fizyczną maszynę. Kto to zrobi?

Najprawdopodobniej partnerzy Google – firmy takie jak Boston Dynamics (którą Google kiedyś miał, potem sprzedał, a teraz współpracuje), Agility Robotics (producent Digita, humanoidalnego robota dla magazynów) czy Figure AI (startup, który dostał inwestycję od Microsoftu i Nvidii, korzysta z modeli OpenAI).

Albo – bardziej prawdopodobne – Google zbuduje własnego robota. Pichai dostał 692 mln dolarów. Google stawia na roboty. To nie jest kwota na research. To budżet na produkt.

Jeśli Google faktycznie wchodzi w hardware, ER 1.6 to nie publikacja naukowa. To zapowiedź.

Za rok zobaczymy, czy miałem rację. Albo za dwa – bo robotyka to nie software, gdzie wypuszczasz update co tydzień. Tu każda iteracja to miesiące testów, certyfikacje bezpieczeństwa i integracja z systemami, które mają po 10 lat. Kierunek jest jasny: roboty wychodzą z laboratoriów. Google chce, żeby widziały świat jego oczami.

Na podstawie: DeepMind Blog

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar