Jak wdrożyć model AI w produkcji – przewodnik FSDL

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

"Deploying models is a critical part of making your models good, to begin with" – Josh Tobin, wykładowca Full Stack Deep Learning. To zdanie trafia w punkt. Większość zespołów AI zna ten scenariusz: model działa świetnie na laptopie, demo wygląda dobrze, wszyscy kiwają głowami. Potem przychodzi produkcja i zapada cisza.

Wdrażanie modeli AI w produkcji to chwila prawdy. Wtedy sprawdzasz, czy cała ta praca naprawdę ma sens. Dopiero gdy użytkownicy zaczynają korzystać z modelu, wychodzą na jaw jego prawdziwe słabości. Wtedy też widzisz, czy rozwiązujesz właściwy problem.

W tym przewodniku przejdziemy od prototypu do działającego systemu — bez inżynieryjnych wygibasów na starcie. Opieramy się na materiałach z kursu FSDL 2022, tłumaczymy je prostym językiem i dodajemy kontekst z kwietnia 2026.

Nie musisz być inżynierem DevOps, żeby wdrożyć model AI. Potrzebujesz jednak kilku podstaw:

Jeśli masz te cztery elementy, możesz ruszać. Reszta to już sekwencja konkretnych kroków.

Pierwsza zasada wdrażania modeli AI jest prosta: nie wdrażaj czegoś, czego nikt wcześniej nie widział. Zanim model trafi do produkcji, przetestuj go w kontrolowanych warunkach. Nie chodzi tu o testy jednostkowe. Chodzi o to, żeby ktoś — najlepiej użytkownik końcowy — mógł z nim chwilę popracować i sprawdzić, czy to w ogóle pomaga.

W 2026 roku masz kilka sensownych opcji, żeby szybko postawić interfejs do modelu:

Wybierz narzędzie, które już znasz albo opanujesz najszybciej. Nie ma tu jednego „najlepszego” wyboru. Liczy się to, żeby prototyp działał za tydzień, a nie za trzy miesiące.

Twój prototyp nie musi wyglądać pięknie. Ma być funkcjonalny:

Jeśli te cztery rzeczy działają, masz prototyp. I to już wystarczy, żeby pokazać go komuś i zapytać: „Czy to rozwiązuje Twój problem?”. Odpowiedź na to pytanie zwykle daje więcej niż tydzień dłubania w optymalizacji modelu.

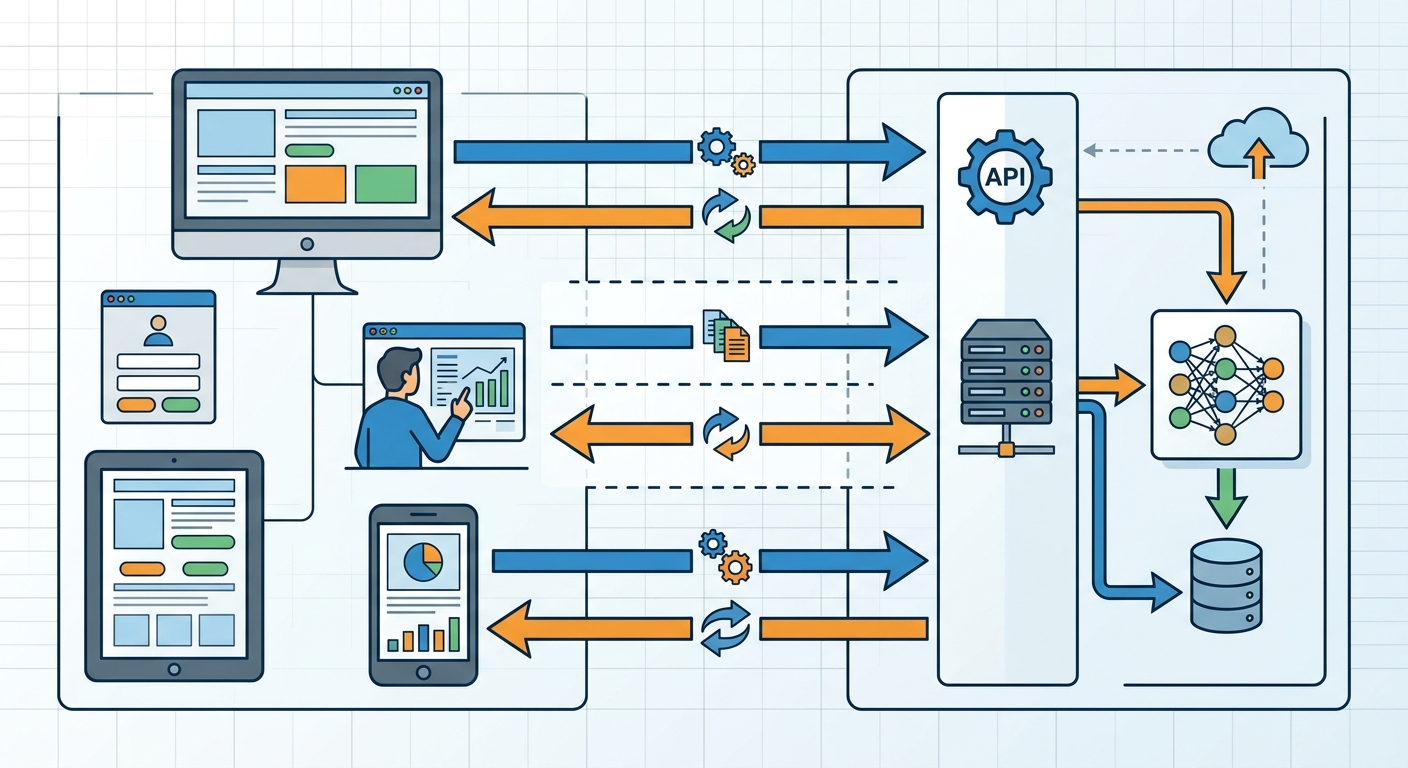

Prototyp działa. Super. Teraz zrób rzecz, która oszczędzi Ci sporo bólu później: rozdziel logikę modelu od interfejsu.

W praktyce chodzi o to, żeby model działał jako osobny serwis (API), a interfejs użytkownika — aplikacja webowa, mobilna czy cokolwiek innego — komunikował się z nim przez sieć. To ważne z kilku powodów:

Najprościej użyć FastAPI (Python) albo Flask. Tworzysz endpoint, który przyjmuje dane, wywołuje model i zwraca wynik. Tyle.

pip install fastapi uvicornmain.py z endpointem /predictuvicorn main:apphttp://localhost:8000/predictDobra, powiedzmy to wprost: nie musisz od razu stawiać Kubernetesa ani load balancera. Na początek wystarczy, że model działa jako osobny proces, z którym interfejs potrafi się połączyć.

Jeśli Twój model obsługuje 10 użytkowników dziennie, nie masz problemu ze skalowaniem. Gdy liczba rośnie do setek albo tysięcy, zaczynają się schody: odpowiedzi zwalniają, serwer się wykłada, użytkownicy tracą cierpliwość.

Wtedy zaczynasz myśleć o skalowaniu. Wtedy — nie wcześniej. Przedwczesna optymalizacja regularnie zjada czas, który lepiej przeznaczyć na poprawę modelu (albo po prostu na dowiezienie wersji działającej).

Skalowanie pionowe oznacza większą maszynę. Zamiast serwera z 8 GB RAM dajesz 32 GB. Zamiast CPU dajesz GPU. To proste, ale drogie i ma swój limit.

Skalowanie poziome oznacza więcej maszyn. Zamiast jednego serwera masz trzy, pięć albo dziesięć. Ruch rozdzielasz między nie przez load balancing. To lepiej skaluje się w dłuższym terminie, ale wymaga więcej konfiguracji.

Na start skaluj pionowo. Gdy to przestanie wystarczać, przejdź na skalowanie poziome. Taka kolejność oszczędza sporo zamieszania.

Większość modeli AI działa szybciej, gdy przetwarza kilka przykładów naraz zamiast pojedynczo. To właśnie batching.

Zamiast obsługiwać każde zapytanie osobno, zbierasz 10–50 zapytań i wysyłasz je do modelu jednocześnie. Model przerabia je razem — często w czasie zbliżonym do obsługi jednego zapytania — a potem zwracasz wyniki użytkownikom.

W praktyce wygląda to tak: jeśli Twój model obsługuje 1 zapytanie w 100 ms, to z batchingiem może obsłużyć 20 zapytań w 150 ms. Daje to 13x większą przepustowość przy minimalnym wzroście opóźnienia.

Narzędzia takie jak BentoML albo TorchServe potrafią robić to automatycznie. Nie musisz pisać wszystkiego ręcznie.

Jeśli Twoja firma ma budżet i nie chce zajmować się infrastrukturą, możesz skorzystać z kilku gotowych opcji:

Jeśli model zarabia pieniądze albo oszczędza czas zespołu, zarządzana opcja często szybko się spina. Jeśli dopiero eksperymentujesz, własny serwer zwykle w zupełności wystarczy.

Najgorszy sposób wdrożenia nowego modelu? Wyłączyć stary, włączyć nowy i liczyć na szczęście. Lepsza droga to stopniowe wdrażanie: canary deployment, blue-green deployment albo A/B testing.

Zamiast przełączać wszystkich użytkowników na nowy model, kierujesz do niego tylko 5% ruchu. Potem obserwujesz metryki: błędy, czas odpowiedzi, satysfakcję użytkowników. Jeśli wszystko wygląda dobrze, zwiększasz udział do 10%, 25%, 50% i w końcu 100%. Jeśli coś się psuje, wracasz do starego modelu i poprawiasz problem.

Do tego potrzebujesz load balancera, który potrafi kierować ruch według reguł. Narzędzia takie jak Nginx, Traefik albo Istio (jeśli używasz Kubernetesa) obsługują taki scenariusz.

Masz dwa modele: stary (A) i nowy (B). Połowa użytkowników dostaje A, połowa B. Mierzysz, który daje lepsze wyniki — na przykład wyższy conversion rate, mniej błędów albo lepsze oceny użytkowników. Wygrywający zostaje.

To nie jest tylko technika wdrożeniowa. To także technika decyzyjna. Gdy nie masz pewności, czy nowy model naprawdę jest lepszy, dane podejmują decyzję za Ciebie.

Edge deployment oznacza po prostu tyle, że zamiast wysyłać dane do serwera w chmurze, przetwarzasz je lokalnie — na telefonie, w przeglądarce albo na urządzeniu IoT.

Kiedy to ma sens?

Kiedy to nie ma sensu?

W kwietniu 2026 masz kilka sprawdzonych opcji:

Znam to: edge deployment kusi, bo wygląda nowocześnie. Tylko że to dodatkowa warstwa złożoności. Wchodź w nią dopiero wtedy, gdy masz konkretny powód: prywatność, opóźnienie albo koszt. W większości przypadków chmura spokojnie wystarcza.

Widziałem to już nie raz. Zespoły AI wpadają w te same pułapki:

Stawiasz Kubernetesa, load balancery, monitoring i CI/CD jeszcze zanim masz pierwszego użytkownika. Efekt? Mijają miesiące, a Ty nadal budujesz infrastrukturę, której nikt jeszcze nie potrzebuje. Rozwiązanie: zacznij od prostego serwera. Dokładaj złożoność dopiero wtedy, gdy pojawią się realne problemy.

Model działa w produkcji, ale nie wiesz, jak często się myli, ile trwają odpowiedzi i czy użytkownicy są zadowoleni. Rozwiązanie: od pierwszego dnia loguj podstawowe metryki: czas odpowiedzi, błędy i liczbę zapytań. Narzędzia: Prometheus, Grafana, Datadog.

Wdrażasz nowy model, coś się psuje, chcesz wrócić do starego — i nagle okazuje się, że nie wiesz, która wersja była wcześniej na produkcji. Rozwiązanie: każda wersja modelu dostaje unikalny identyfikator, na przykład timestamp albo numer wersji. Stare wersje przechowujesz przez co najmniej miesiąc.

Model działa, więc zespół uznaje temat za zamknięty. Tymczasem użytkownicy zgłaszają, że rozwiązanie nie trafia w ich realny problem. Rozwiązanie: zbieraj feedback — ankiety, oceny, komentarze. Analizuj błędy modelu i iteruj.

Wdrażanie modeli AI nie musi być skomplikowane. Jeśli trzymasz się zasady „najpierw proste, potem złożone”, unikniesz większości typowych problemów:

Jeśli chcesz wejść głębiej w temat wdrażania modeli AI, zajrzyj też do przewodnika po wdrażaniu AI w małych firmach — znajdziesz tam więcej praktycznych wskazówek.

Nie. Na początek wystarczy podstawowa znajomość API i umiejętność uruchomienia serwera, na przykład w FastAPI. Bardziej zaawansowane rzeczy, takie jak Kubernetes czy CI/CD, przydają się dopiero przy dużej skali. Zacznij prosto i dokładaj kolejne elementy wtedy, gdy naprawdę stają się potrzebne.

To zależy od skali. Prosty prototyp możesz postawić za darmo, na przykład na Hugging Face Spaces albo Google Colab. Serwer w chmurze to zwykle $50–200 miesięcznie (AWS EC2, Google Cloud). Zarządzane platformy, takie jak SageMaker czy Vertex AI, zaczynają się od kilkuset dolarów miesięcznie. Przy milionach użytkowników koszty rosną do tysięcy — ale wtedy model zwykle już na siebie pracuje.

Jak najszybciej — pod warunkiem że model daje już jakąkolwiek użyteczną wartość. Jeśli ma 60% dokładności, ale realnie oszczędza użytkownikom czas, możesz wdrażać. Jeśli ma 95%, ale nie rozwiązuje ich problemu, nie ma sensu go wypychać do produkcji. Liczy się wartość dla użytkownika, nie perfekcyjny wynik w notatniku.

Nie na początek. Kubernetes ma sens wtedy, gdy masz dziesiątki mikrousług, zespół DevOps i tysiące użytkowników. Jeśli wdrażasz jeden model dla kilkudziesięciu użytkowników, prosty serwer w stylu FastAPI + Nginx spokojnie wystarczy.

Zacznij od podstaw: liczba zapytań, czas odpowiedzi, błędy (HTTP 500, timeouty). Loguj te dane do pliku albo narzędzia typu Prometheus. Ustaw alerty, na przykład e-mail, gdy błędów jest więcej niż 5% zapytań. Później możesz dodać bardziej zaawansowane metryki, takie jak drift modelu czy rozkład predykcji, ale na start podstawy naprawdę wystarczą. Jeśli interesuje Cię monitoring AI w praktyce, sprawdź artykuł o zabezpieczaniu systemów AI.

Ten poradnik to dopiero początek. W naszym kursie "Praktyczna AI" nauczysz się korzystać z ChatGPT, Claude i innych narzędzi AI w sposób systematyczny — od zera do zaawansowanego poziomu. Bez korporacyjnego bełkotu, za to z konkretnymi przykładami i ćwiczeniami.

Sprawdź kurs →Masz model, który działa na Twoim komputerze? To na początek postaw prosty interfejs w Gradio albo Streamlit i pokaż go komuś, kto mógłby z niego korzystać. Bez optymalizacji, bez skalowania, bez dokładania funkcji na zapas. Po prostu pokaż. Feedback, który zbierzesz, będzie cenniejszy niż kolejny tydzień pracy nad kodem.

Na podstawie: SukcesAI Course Material Generator

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar