Jak zrozumieć paper DeepSeek R1 – przewodnik dla początkujących

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Paper naukowy DeepSeek R1 ma 70 stron gęstego tekstu, wykresy, wzory matematyczne i tabelki z benchmarkami. Patrzysz na to i myślisz: "To nie dla mnie". Moment – ten dokument opisuje model, który kosztuje ułamek ceny Claude'a Opus 4.7, a w niektórych zadaniach kodowania go przewyższa. Może warto wiedzieć, jak to działa?

Nie musisz rozumieć każdego wzoru. Musisz wiedzieć, gdzie szukać informacji, które mają znaczenie dla Twojej pracy. W tym przewodniku pokażę Ci, jak czytać paper DeepSeek R1 tak, żeby wyciągnąć z niego wartość – bez studiowania matematyki przez pół roku.

DeepSeek R1 to duży model językowy (LLM) wydany w styczniu 2025 roku przez chiński startup DeepSeek. W kwietniu 2026 mamy już jego następcę – DeepSeek V4-Pro – ale R1 to punkt zwrotny w historii AI. Dlaczego? Bo pokazał, że można zbudować model konkurencyjny dla GPT-5 czy Claude'a Opus 4.7 za znacznie niższe koszty i udostępnić go na licencji MIT (czyli całkowicie otwartej).

Paper to dokument naukowy opisujący, jak model powstał. Znajdziesz tam:

Jeśli pracujesz z AI – czy to w marketingu, analizie danych, czy edukacji – zrozumienie podstaw tego, jak modele są budowane, daje Ci przewagę. Nie musisz tego robić sam. Musisz wiedzieć, czy to możliwe i ile to kosztuje.

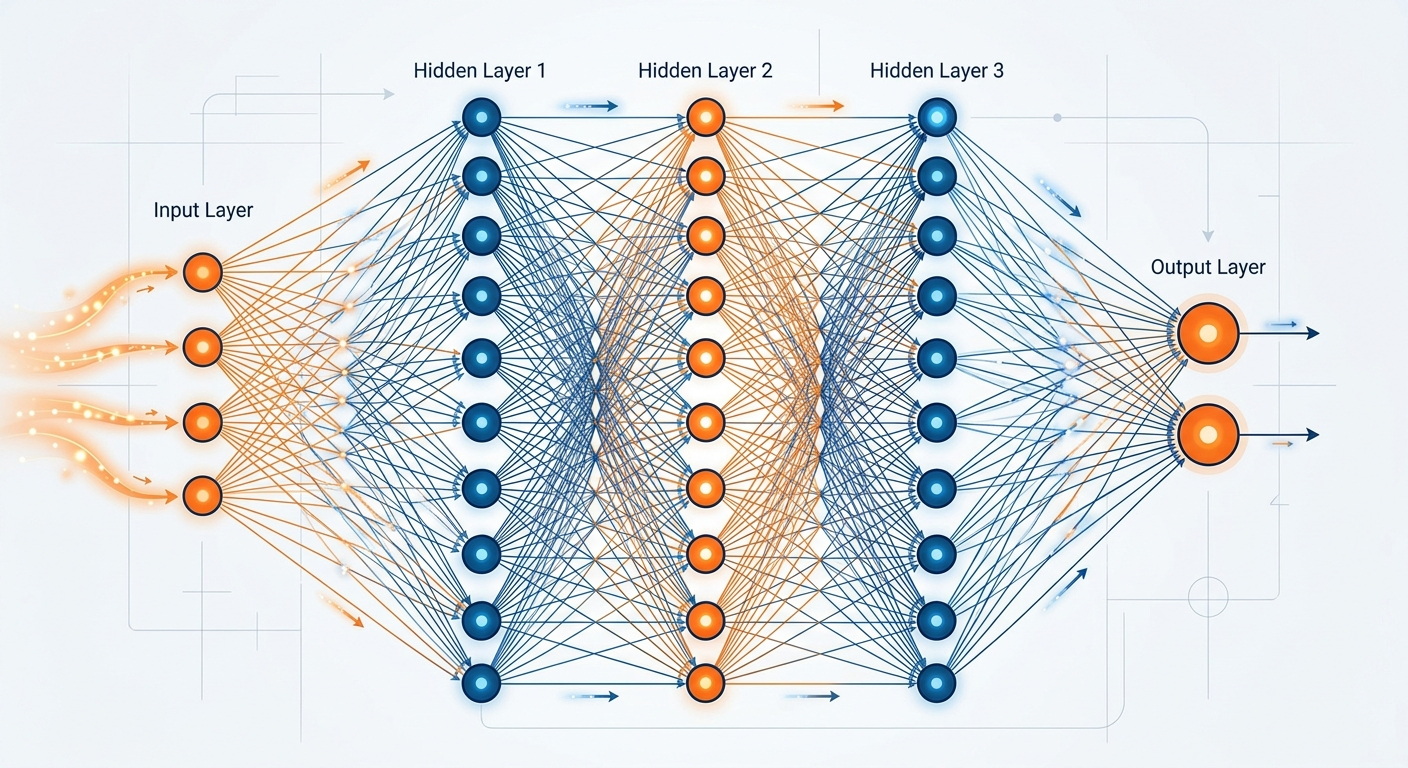

Nie potrzebujesz doktoratu z informatyki. Kilka pojęć ułatwi Ci życie:

Jeśli te pojęcia brzmią obco, zerknij na nasz przewodnik po uczeniu ze wzmocnieniem – tam wyjaśniamy to krok po kroku.

Abstrakt (Abstract) to pierwsze 200-300 słów paperu. Autorzy podsumowują tam całą pracę: co zrobili, jakie wyniki osiągnęli i dlaczego to ważne. To jedyna część, którą musisz przeczytać w całości.

W przypadku DeepSeek R1 abstrakt mówi Ci:

Wprowadzenie (Introduction) rozwija te wątki. Czytaj je selektywnie – szukaj zdań zaczynających się od "We show that...", "Our results demonstrate...", "Unlike previous approaches...". Tam autorzy mówią, co jest nowe w ich podejściu.

Zapisz sobie w notatkach (możesz użyć NotebookLM do organizacji notatek z paperu):

To wystarczy, żeby zrozumieć, czy warto czytać dalej.

Pomiń na razie sekcję "Methods" (Metodologia) – tam są szczegóły techniczne, do których możesz wrócić później. Idź prosto do "Results" lub "Experiments". Tu autorzy pokazują, jak model wypada w praktyce.

W przypadku DeepSeek R1 znajdziesz tam tabele z wynikami benchmarków. Przykład:

Co to znaczy? Że w zadaniach kodowania (SWE-bench, Aider) i naukowych pytaniach (GPQA) DeepSeek R1 jest nieznacznie lepszy od GPT-4. Nie rewolucja, ale solidny wynik – szczególnie biorąc pod uwagę, że model jest open-source i można go uruchomić lokalnie.

Nie musisz rozumieć każdego benchmarku. Szukaj tych, które dotyczą Twojej pracy:

Ignoruj benchmarki, które nie dotyczą Twojego przypadku użycia. Nikt nie potrzebuje modelu, który jest dobry we wszystkim – potrzebujesz modelu, który jest dobry w tym, co robisz.

Sekcja "Methods" to serce paperu. Nie musisz czytać jej od deski do deski. Szukaj podsekcji, które mają praktyczne znaczenie:

Autorzy opisują, na jakich danych model był uczony. W przypadku DeepSeek R1:

Dlaczego to ważne? Bo pokazuje, że można zbudować dobry model bez kosztownego procesu zbierania feedbacku od ludzi. To obniża koszty i przyspiesza rozwój.

Tu znajdziesz szczegóły techniczne: ile warstw ma model, jaki rozmiar kontekstu (ile tekstu może "zapamiętać" na raz), jak działa mechanizm uwagi (attention). Jeśli nie jesteś programistą, możesz to pominąć. Zapisz sobie dwie liczby:

Jeśli chcesz zrozumieć, jak działają transformery (architektura, na której opierają się wszystkie duże modele językowe), zajrzyj do naszego przewodnika po transformerach.

To najważniejsza sekcja, którą większość ludzi pomija. Autorzy są tam szczerzy: co nie działa, gdzie model ma problemy, jakie są ryzyka. W przypadku DeepSeek R1:

Dlaczego to ważne? Bo mówi Ci, kiedy nie używać tego modelu. Jeśli budujesz chatbota dla klientów, który musi być zwięzły – DeepSeek R1 może nie być najlepszym wyborem. Jeśli analizujesz kod lub rozwiązujesz problemy matematyczne – będzie świetny.

Niektóre papery (w tym DeepSeek R1) zawierają sekcję "Case Studies" lub "Qualitative Analysis". To przykłady rzeczywistych zadań, które model wykonał – z pełnymi promptami i odpowiedziami.

To najcenniejsza część dla praktyków. Widzisz tam:

Przykład z DeepSeek R1: w jednym case study model dostał zadanie napisania funkcji w Pythonie, która sortuje listę obiektów według złożonego klucza. Odpowiedź była poprawna, ale zawierała 15 linijek komentarzy wyjaśniających kod. Dla niektórych to wartość (uczysz się, czytając kod), dla innych – zbędny koszt (płacisz za tokeny w komentarzach).

Sekcja "Related Work" to przegląd innych modeli i podejść. Autorzy pokazują tam, czym ich model różni się od konkurencji. W przypadku DeepSeek R1:

To daje Ci kontekst: gdzie DeepSeek R1 (i jego następca V4-Pro) ma sens, a gdzie lepiej użyć innego modelu.

Przeczytałeś paper (albo jego kluczowe sekcje). Co teraz?

Jeśli chcesz nauczyć się budować agentów AI, które uruchamiają kod, sprawdź nasz przewodnik po agentach AI.

Jeśli dopiero zaczynasz przygodę z AI, nasz poradnik o używaniu ChatGPT do nauki pomoże Ci zbudować fundamenty.

Nie. Sekcje z wzorami matematycznymi możesz pominąć – są dla badaczy, którzy chcą odtworzyć wyniki. Ty potrzebujesz zrozumieć co model robi i jak wypada w praktyce, a to znajdziesz w abstrakcie, wynikach i case studies. Jeśli napotkasz niezrozumiały termin, wklej go do ChatGPT z pytaniem "Wytłumacz to prostym językiem".

Zależy od zadania. W benchmarku Terminal-Bench (zadania agentów w terminalu) DeepSeek V4-Pro wypada lepiej. W zadaniach wymagających długiego kontekstu (np. analiza 200-stronicowego raportu) Claude Opus 4.7 jest lepszy. DeepSeek jest około 7 razy tańszy ($1.74/$3.48 vs $15/$75 za 1M tokenów), więc jeśli różnica w jakości jest niewielka, ekonomia przemawia za DeepSeek.

DeepSeek oferuje API dostępne przez chat.deepseek.com – możesz tam testować model za darmo (z limitem zapytań). Jeśli chcesz użyć go w produkcji, API jest kompatybilne z OpenAI, więc możesz zmienić endpoint w swoim kodzie i od razu zacząć używać. Alternatywnie, model jest dostępny na Hugging Face – możesz uruchomić go lokalnie, jeśli masz GPU z przynajmniej 80GB VRAM (lub użyć usług chmurowych jak Replicate czy Together AI).

Tak, jeśli są na licencji MIT (jak DeepSeek R1 i V4-Pro). Licencja MIT pozwala na użycie komercyjne, modyfikację i redystrybucję bez opłat. Jedyne ryzyko to techniczne: musisz sam zadbać o hosting, skalowanie i bezpieczeństwo danych. Jeśli nie masz zespołu technicznego, lepiej użyć API DeepSeek (płatne, ale zarządzane przez nich) niż hostować model samodzielnie.

Nie musisz czytać każdego paperu. Śledź 2-3 kluczowe modele w swojej dziedzinie (np. jeśli pracujesz z kodem, to DeepSeek, GPT-5.3-Codex, Claude Sonnet 4.6). Gdy pojawi się nowa wersja, przeczytaj abstrakt i wyniki – to zajmie 10 minut. Pełny paper czytaj tylko wtedy, gdy planujesz wdrożenie lub chcesz zrozumieć, dlaczego model działa inaczej niż poprzednik. Jeśli chcesz być na bieżąco, nasz blog AI Evolution śledzi najważniejsze zmiany i tłumaczy je prostym językiem.

Ten poradnik to dopiero początek. W naszym kursie "Praktyczna AI" nauczysz się korzystać z ChatGPT, Claude i innych narzędzi AI w sposób systematyczny — od zera do zaawansowanego poziomu.

Sprawdź kurs →Paper DeepSeek R1 (i podobne dokumenty naukowe) to nie podręczniki dla praktyków. To mapy terenu – pokazują, co jest możliwe, jakie są ograniczenia i gdzie szukać szczegółów. Nie musisz rozumieć każdego wzoru. Musisz wiedzieć, gdzie znaleźć odpowiedzi na pytania: "Czy ten model nadaje się do mojego przypadku użycia?" i "Ile będzie mnie to kosztować?"

Kluczowe sekcje, które dają Ci 80% wartości w 20% czasu:

Reszta to szczegóły dla badaczy. Ty potrzebujesz wiedzieć, czy warto przetestować model w swojej pracy. A to ustalisz w 30 minut czytania – nie w 3 godziny.

Otwórz paper DeepSeek R1 (znajdziesz go na deepseek.com lub arxiv.org). Przeczytaj abstrakt i zapisz sobie trzy liczby: rozmiar modelu (671B parametrów), rozmiar kontekstu (128k tokenów) i wynik w benchmarku, który Cię interesuje (np. SWE-bench Verified: 49.2%). To zajmie 5 minut. Masz teraz punkt odniesienia – wiesz, czy model jest wart głębszego testowania.

Na podstawie: SukcesAI Course Material Generator, DeepSeek Official

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar