Jak zrobić fine-tuning modelu AI i nie przepalić budżetu

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Fine-tuning modelu AI to nie technologiczna fanaberia dla programistów z przerostem ambicji. To konkretna technika, która może rozwiązać realny problem: model AI nie rozumie Twojej branżowej nomenklatury, miesza fakty albo odpowiada w stylu, który nie pasuje do Twojej firmy.

Zanim rzucisz się na fine-tuning, sprawdźmy jedną rzecz: czy na pewno go potrzebujesz? W 70% przypadków wystarczy prostsze (i tańsze) rozwiązanie.

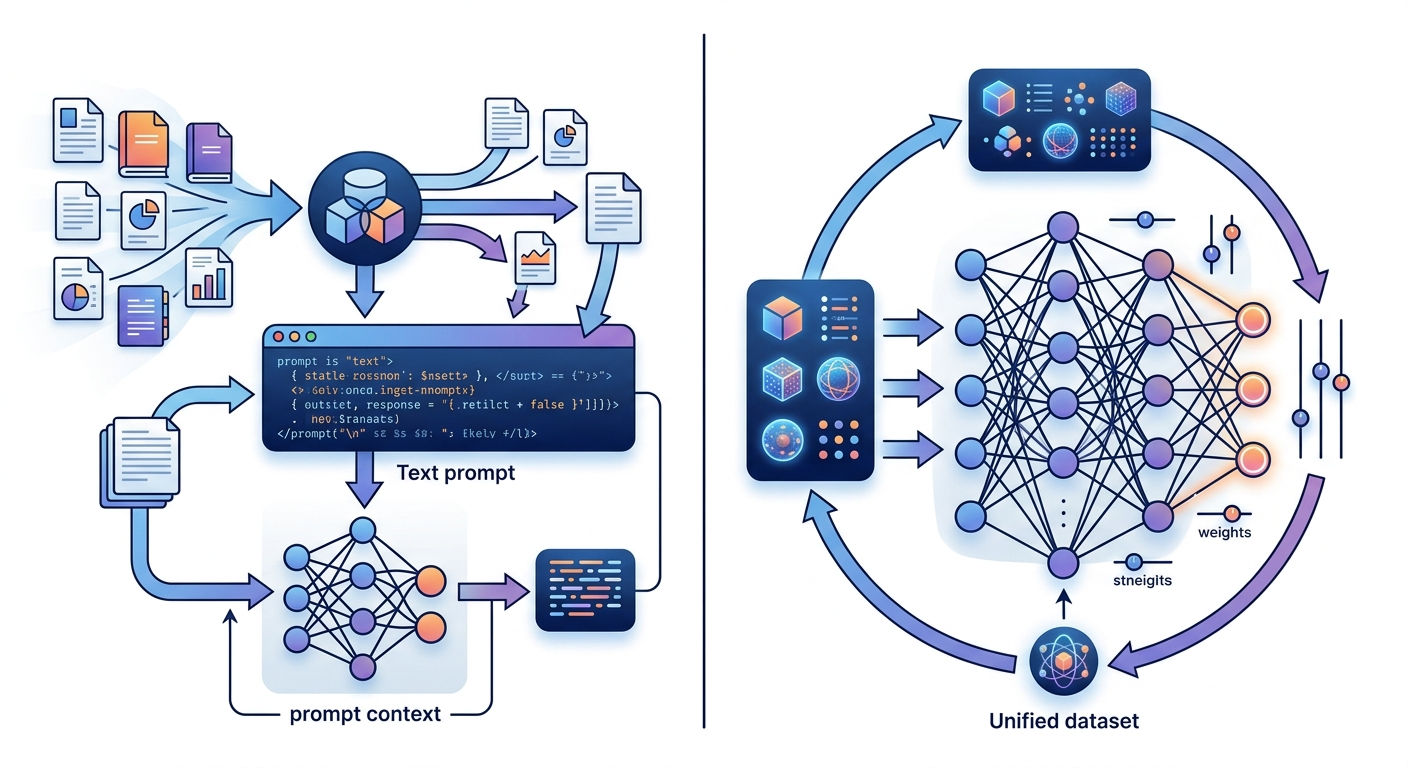

Zacznijmy od demaskacji mitu: fine-tuning nie jest domyślnym krokiem w pracy z AI. Jeśli Twój problem sprowadza się do tego, że model nie zna Twoich dokumentów, cenników czy procedur - nie potrzebujesz fine-tuningu. Potrzebujesz RAG (Retrieval-Augmented Generation).

RAG działa prosto: model dostaje Twoje dokumenty jako kontekst w promptcie. Pytasz o coś konkretnego, system wyszukuje odpowiedni fragment z Twojej bazy i wrzuca go do kontekstu. Model odpowiada na podstawie tego, co dostał. Zero treningu, zero kosztów dopasowania.

Kiedy RAG wystarczy:

Jeśli którykolwiek punkt pasuje - zacznij od RAG. Nie działa? Dopiero wtedy rozważ fine-tuning. Przygotowanie danych do RAG to osobny temat, ale kluczowy - źle podzielone dokumenty to najczęstsza przyczyna słabych odpowiedzi.

Fine-tuning to trening modelu na Twoich danych. Model uczy się nie tylko faktów, ale też stylu, struktury odpowiedzi i specyficznego sposobu rozumowania. To nie jest wyszukiwanie dokumentów - to zmiana zachowania modelu.

Kiedy warto zapłacić za fine-tuning:

Przykład: firma prawnicza chce, żeby model generował pisma procesowe. RAG da mu dostęp do szablonów, ale nie nauczy go, jak pisać w stylu kancelarii. Fine-tuning może - jeśli masz 500+ przykładów pism z adnotacjami.

OpenAI pobiera opłaty za:

Jeśli masz 10 000 przykładów treningowych (średnio 500 tokenów każdy = 5M tokenów), zapłacisz:

To nie jest drogo, jeśli fine-tuning obniży liczbę wywołań - krótsze prompty, lepsze wyniki za pierwszym razem. Jeśli masz 50 przykładów i liczysz, że model "się nauczy" - przepalisz pieniądze.

Fine-tuning to nie magia. Model uczy się na przykładach. Jeśli przykłady są kiepskie, model będzie kiepski. Prosta zasada.

OpenAI mówi: minimum 10 przykładów. W praktyce:

Jeśli masz mniej niż 100 przykładów - zacznij od few-shot promptingu (wrzuć przykłady do systemu promptu). Działa? Świetnie. Nie działa? Zbierz więcej danych.

OpenAI wymaga formatu JSONL (JSON Lines). Każda linia to jeden przykład:

{"messages": [{"role": "system", "content": "Jesteś asystentem prawnym."}, {"role": "user", "content": "Napisz pismo procesowe o zwrot kaucji."}, {"role": "assistant", "content": "Szanowny Sądzie, wnoszę o..."}]}

{"messages": [{"role": "system", "content": "Jesteś asystentem prawnym."}, {"role": "user", "content": "Przygotuj odpowiedź na pozew."}, {"role": "assistant", "content": "W odpowiedzi na pozew..."}]}Kluczowe zasady:

Jeśli nie masz gotowych danych, możesz je wygenerować. Użyj bazowego modelu (np. GPT-5) do stworzenia przykładów, a potem ręcznie je popraw. To szybsze niż pisanie od zera.

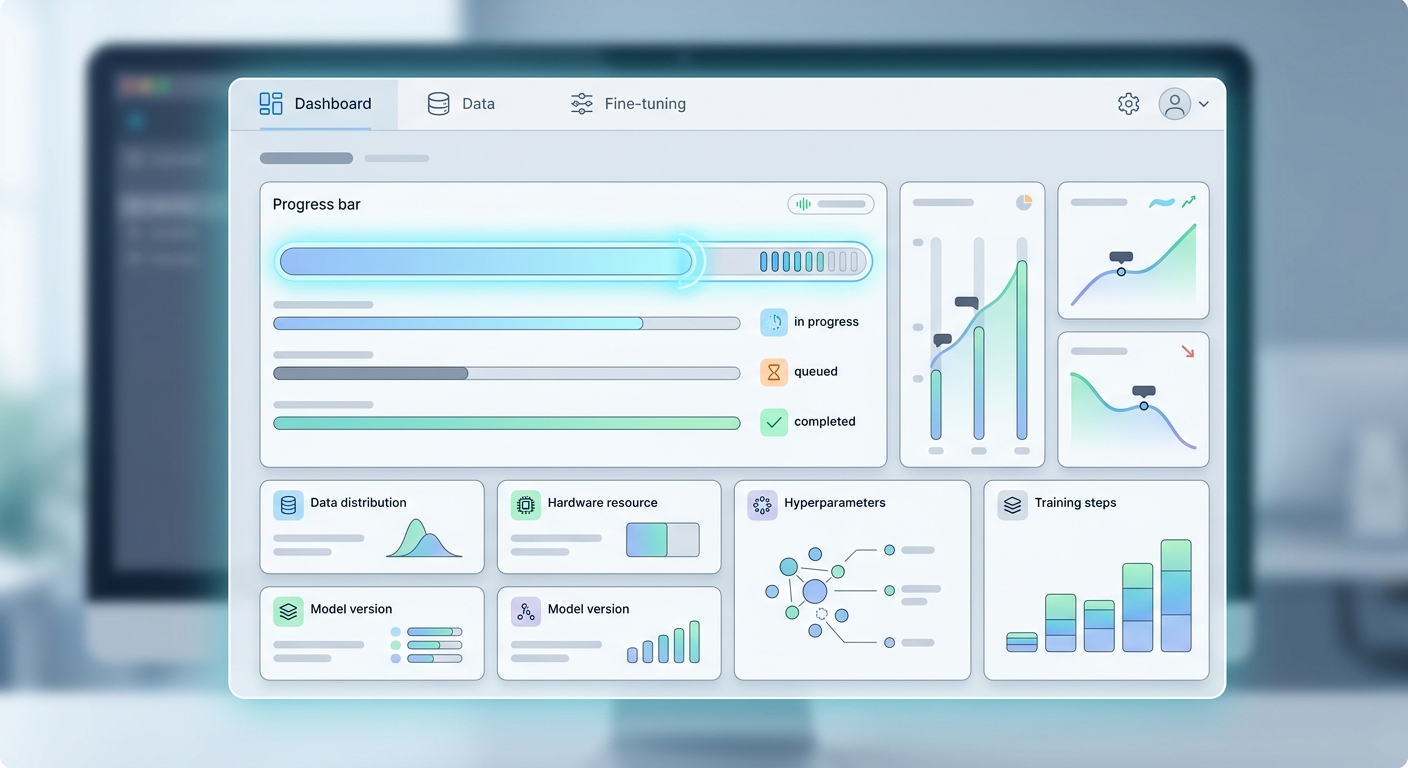

Dobra, masz dane. Czas na trening. OpenAI udostępnia API do fine-tuningu - nie musisz instalować Pythona ani zarządzać infrastrukturą. Wszystko dzieje się w chmurze.

Potrzebujesz:

training_data.jsonlpip install openaiOtwierasz terminal i wpisujesz:

from openai import OpenAI

client = OpenAI(api_key="twoj-api-key")

file = client.files.create(

file=open("training_data.jsonl", "rb"),

purpose="fine-tune"

)

print(file.id) # Zapisz to ID - będzie potrzebneOpenAI sprawdzi plik pod kątem błędów (np. złego formatu JSON). Jeśli coś jest nie tak, dostaniesz komunikat. Popraw i spróbuj ponownie.

Teraz startujesz trening:

job = client.fine_tuning.jobs.create(

training_file=file.id,

model="gpt-4o-mini-2024-07-18" # lub "gpt-4o-2024-08-06"

)

print(job.id) # ID zadania - możesz sprawdzić statusTrening zajmie od kilku minut (małe zestawy danych) do kilku godzin (duże zestawy). OpenAI wyśle Ci email, kiedy skończy.

Możesz sprawdzić, co się dzieje:

status = client.fine_tuning.jobs.retrieve(job.id)

print(status.status) # "running", "succeeded", "failed"Jeśli status to succeeded, dostaniesz ID nowego modelu (np. ft:gpt-4o-mini:twoja-firma:model-v1:abc123). Zapisz je - to Twój dopasowany model.

Teraz możesz wywoływać model jak każdy inny:

response = client.chat.completions.create(

model="ft:gpt-4o-mini:twoja-firma:model-v1:abc123",

messages=[

{"role": "system", "content": "Jesteś asystentem prawnym."},

{"role": "user", "content": "Napisz pismo procesowe o zwrot kaucji."}

]

)

print(response.choices[0].message.content)Model odpowie w stylu, którego nauczył się z Twoich danych. Jeśli odpowiedź jest kiepska - problem leży w danych treningowych, nie w API.

Fine-tuning to proces iteracyjny. Rzadko wychodzi za pierwszym razem. Typowy cykl:

OpenAI pozwala na nieograniczoną liczbę fine-tuningów. Płacisz tylko za trening i użycie.

Widziałem setki projektów fine-tuningowych. Większość popełnia te same błędy. Oto top 5:

10 przykładów to nie fine-tuning. To loteria. Model "zapamięta" wzorce, ale nie uogólni. Jeśli nie masz minimum 50 przykładów - nie zaczynaj.

Jeśli Twoje przykłady treningowe są pełne błędów, literówek, niespójności - model to powieli. Garbage in, garbage out. Sprawdź dane ręcznie. Tak, to żmudne. Tak, musisz to zrobić.

Podziel dane na zestaw treningowy (80%) i walidacyjny (20%). Trenuj na 80%, testuj na 20%. Jeśli model radzi sobie dobrze na treningu, ale źle na walidacji - masz overfitting. Potrzebujesz więcej danych lub prostszego zadania.

Jeśli problem da się rozwiązać RAG-iem lub few-shot promptingiem - nie używaj fine-tuningu. To jak wynajmowanie helikoptera, żeby dojechać do sklepu. Działa, ale jest głupie.

Model działa świetnie na testach, ale po miesiącu zaczyna odpowiadać dziwnie? To normalne. Dane się zmieniają, użytkownicy zadają nowe pytania, kontekst się przesuwa. Monitoruj odpowiedzi, zbieraj feedback, trenuj ponownie co kilka miesięcy.

OpenAI to nie jedyna opcja. Jeśli chcesz więcej kontroli (lub masz wrażliwe dane), możesz:

Jeśli dopiero zaczynasz - idź z OpenAI. Jeśli masz specyficzne wymagania (prywatność, koszt, kontrola) - rozważ alternatywy.

Na razie (marzec 2026) OpenAI nie udostępniło fine-tuningu dla GPT-5. Możesz dopasować GPT-5. Jeśli potrzebujesz najnowszego modelu - użyj RAG lub few-shot promptingu.

Zależy od rozmiaru danych. 100 przykładów: 10-20 minut. 10 000 przykładów: kilka godzin. OpenAI nie gwarantuje czasu - jeśli serwery są obciążone, może trwać dłużej.

Tak. GPT-5 radzi sobie dobrze z polskim. Jeśli Twoje dane są po polsku, model nauczy się odpowiadać po polsku. Nie musisz tłumaczyć na angielski.

Nie zawsze. Jeśli model halucynuje fakty, fine-tuning może to pogorszyć (model "nauczy się" halucynować w Twoim stylu). Lepsze rozwiązanie: RAG z weryfikacją źródeł.

Tak. Wchodzisz do dashboardu OpenAI, znajdujesz model i klikasz "Delete". Przestaniesz płacić za jego użycie. Dane treningowe możesz też usunąć (ale nie musisz - nie są publicznie dostępne).

Ten poradnik to dopiero początek. W naszym kursie "Praktyczna AI" nauczysz się korzystać z ChatGPT, Claude i innych narzędzi AI w sposób systematyczny - od zera do zaawansowanego poziomu.

Sprawdź kurs →Fine-tuning to narzędzie, nie cel sam w sobie. Jeśli RAG wystarczy - użyj RAG. Jeśli potrzebujesz dopasowania stylu, terminologii, struktury odpowiedzi - fine-tuning ma sens. Tylko wtedy, gdy masz dane i budżet.

Najczęstszy scenariusz: zaczynasz od RAG, widzisz, co nie działa, zbierasz dane z produkcji, robisz fine-tuning. Nie na odwrót.

Weź 10 przykładów typowych zapytań z Twojej firmy i odpowiedzi, które chcesz dostać. Zapisz je w formacie JSONL. Wgraj do OpenAI. Zrób fine-tuning na GPT-5 (koszt: kilka dolarów). Przetestuj. Jeśli działa lepiej niż bazowy model - masz punkt wyjścia. Jeśli nie - wiesz, że problem leży gdzie indziej.

Na podstawie: OpenAI Fine-tuning Guide, Anthropic Claude Documentation, Google Vertex AI Docs

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar