NVIDIA buduje Physical AI. Co to znaczy dla robotyki?

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

NVIDIA właśnie pokazała, jak ich badania nad renderowaniem neuronowym, generowaniem 3D i symulacją świata przekładają się na coś, co nazywają Physical AI. To nie abstrakcja – mówimy o technologiach, które już teraz kształtują robotykę, pojazdy autonomiczne i produkcję treści 3D.

Na SIGGRAPH 2025 firma zaprezentowała zestaw narzędzi badawczych z jednym celem: nauczyć AI rozumieć i symulować fizyczny świat. Jak spojrzysz na konkretne zastosowania, zaczyna to mieć sens.

Physical AI to termin, którym NVIDIA opisuje systemy sztucznej inteligencji zdolne do rozumienia, przewidywania i interakcji z prawami fizycznego świata. W odróżnieniu od modeli językowych operujących na tekście czy modeli wizyjnych analizujących płaskie obrazy, Physical AI musi rozumieć przestrzeń, głębię, masę, tarcie i czas. To fundamentalnie trudniejszy problem – i dlatego rozwiązania NVIDIA skupiają się na trzech kluczowych filarach: renderowaniu neuronowym, generowaniu syntetycznych danych oraz symulacji fizyki.

Połączenie tych trzech obszarów tworzy spójny ekosystem: robot może być trenowany w wirtualnym środowisku, które wygląda i zachowuje się jak rzeczywistość, a następnie przeniesiony do prawdziwego świata z minimalną utratą wydajności. To właśnie ten łańcuch – od symulacji do rzeczywistości – jest sednem tego, co NVIDIA zaprezentowała na SIGGRAPH 2025.

Zamiast tradycyjnego renderowania 3D, gdzie każdy piksel to wynik matematycznych obliczeń geometrii i światła, neural rendering używa sieci neuronowych do generowania obrazów. NVIDIA rozwija technologie, które tworzą fotorealistyczne sceny z minimalnej ilości danych wejściowych.

Co to oznacza w praktyce? Robot wyposażony w taką technologię lepiej "rozumie" to, co widzi. Nie tylko rozpoznaje obiekt – przewiduje, jak będzie wyglądał z innej perspektywy czy w innym oświetleniu. To kluczowe dla manipulacji przedmiotami w zmiennych warunkach.

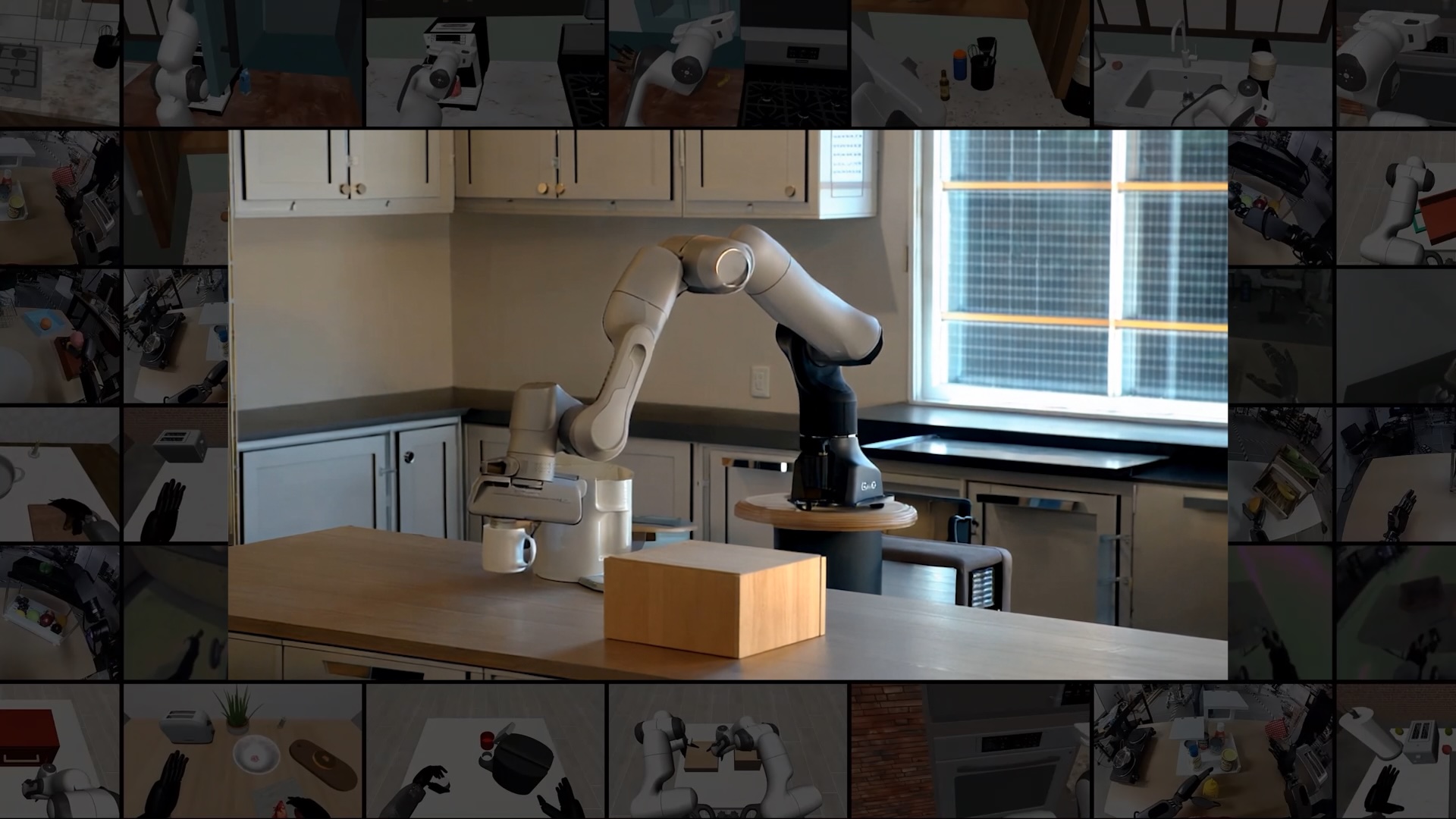

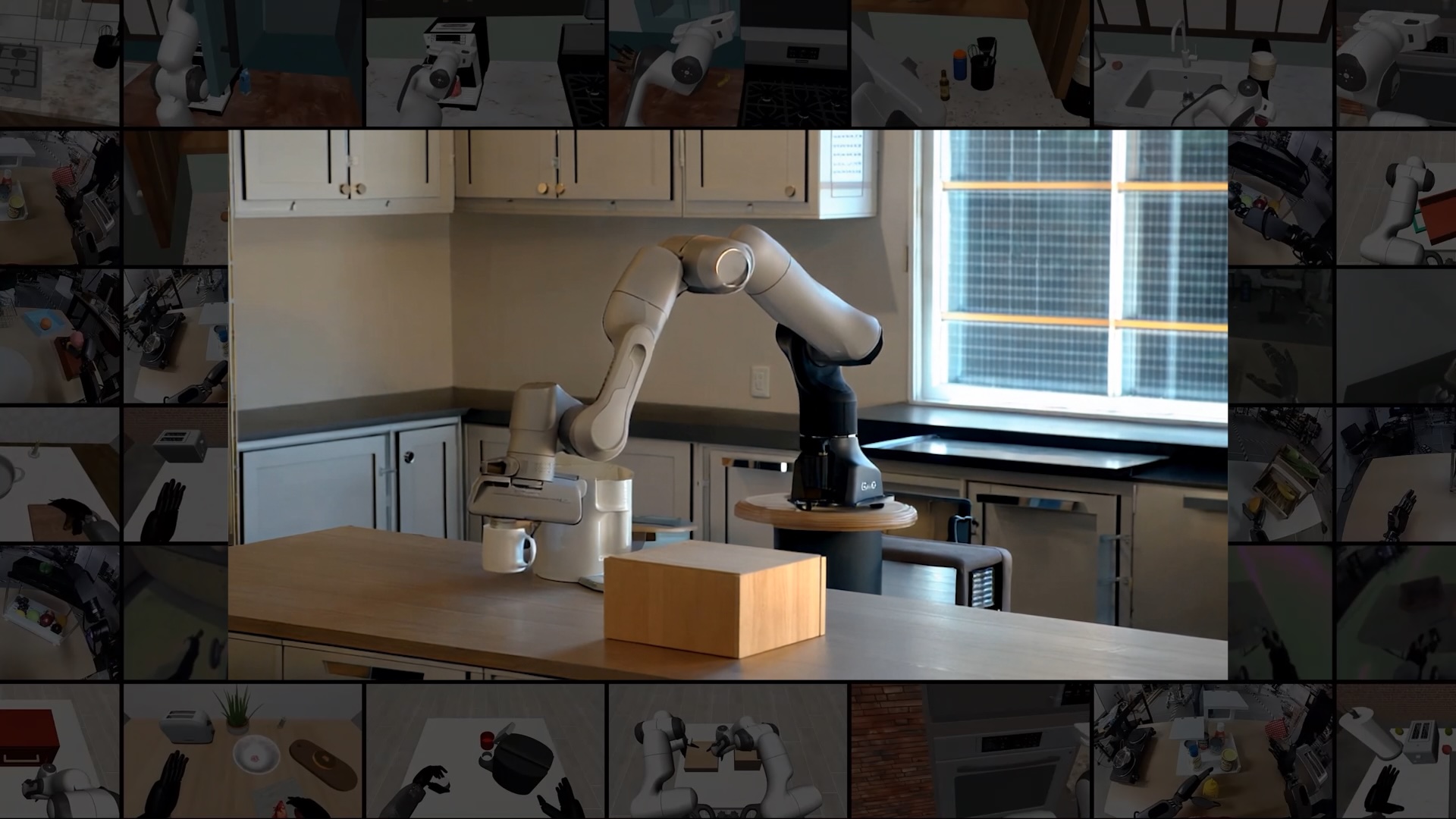

Wyobraź sobie ramię robota sortującego paczki w magazynie. Tradycyjny system wizyjny może mylić się, gdy zmienia się kąt padania światła lub gdy obiekt jest częściowo zasłonięty. System oparty na neural renderingu potrafi wnioskować o kształcie i położeniu obiektu nawet z niepełnych danych – bo model "wie", jak dany obiekt powinien wyglądać w trzech wymiarach. To przekłada się bezpośrednio na mniejszą liczbę błędów i wyższą niezawodność w środowiskach przemysłowych.

Jednym z największych wyzwań w robotyce jest brak danych treningowych. Nie możesz po prostu puścić robota do fabryki i kazać mu się uczyć metodą prób i błędów (koszty byłyby astronomiczne). NVIDIA stawia na generowanie syntetycznych środowisk 3D, w których roboty mogą trenować miliony scenariuszy bez ryzyka.

Ich badania nad proceduralnym generowaniem scen 3D pozwalają tworzyć realistyczne symulacje magazynów, ulic czy linii produkcyjnych. Robot uczy się w wirtualnym świecie, a potem przenosi tę wiedzę do rzeczywistości – technika znana jako sim-to-real transfer.

Skuteczność sim-to-real transfer zależy przede wszystkim od tego, jak wiernie symulacja odwzorowuje rzeczywistość. Jeśli wirtualny magazyn różni się od prawdziwego oświetleniem, teksturami podłogi czy sposobem, w jaki obiekty rzucają cienie, robot będzie miał problemy z adaptacją. Właśnie dlatego proceduralnie generowane sceny NVIDII są projektowane z myślą o maksymalnej różnorodności – losowe układy obiektów, zmienne warunki oświetleniowe, różne tekstury materiałów. Im bardziej zróżnicowane środowisko treningowe, tym bardziej odporny na zmienne warunki jest finalny model.

Tutaj Physical AI nabiera konkretnego znaczenia. NVIDIA pracuje nad silnikami symulacji, które w czasie rzeczywistym odwzorowują fizyczne właściwości materiałów, kolizje, grawitację czy dynamikę płynów. Wykorzystują do tego GPU acceleration i modele uczenia maszynowego, które przyspieszają obliczenia fizyczne.

Dla pojazdów autonomicznych to możliwość testowania milionów scenariuszy drogowych w symulacji, zanim auto wyjedzie na ulicę. Dla twórców treści – narzędzia, które generują realistyczne animacje bez żmudnego ręcznego setupu fizyki.

Tradycyjne silniki fizyczne opierają się na deterministycznych obliczeniach – każda kolizja, każdy ruch płynu to setki równań rozwiązywanych krok po kroku. Podejście NVIDII łączy klasyczne algorytmy z sieciami neuronowymi, które uczą się przybliżać wyniki tych obliczeń znacznie szybciej. Efekt: symulacje, które wcześniej wymagały godzin renderowania, mogą działać w czasie rzeczywistym. Dla robotyki przemysłowej to różnica między testowaniem dziesięciu scenariuszy dziennie a testowaniem dziesiątek tysięcy.

Te technologie już wychodzą z laboratoriów. Firmy robotyczne używają NVIDIA Omniverse do symulacji magazynów przed wdrożeniem robotów. Producenci aut testują autonomiczne systemy w wirtualnych miastach. Studia filmowe generują tła i efekty specjalne szybciej niż kiedykolwiek.

Warto zwrócić uwagę na kilka konkretnych obszarów zastosowań, które najszybciej korzystają z tego ekosystemu:

Physical AI to nie buzzword – to zestaw konkretnych narzędzi, które pozwalają AI działać w fizycznym świecie albo go wiernie symulować. Badania, które NVIDIA prezentuje na SIGGRAPH 2025, pokazują, jak daleko już zaszliśmy w tym kierunku.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar