OpenAI wypuszcza GPT-Rosalind. Model dla biologów na zamkniętym dostępie

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Co jeśli za rok każde laboratorium będzie miało asystenta AI, który rozumie sekwencjonowanie DNA lepiej niż junior researcher? OpenAI właśnie wypuściło GPT-Rosalind — model językowy trenowany na biologicznych workflow. Problem? Nie możesz go po prostu otworzyć i przetestować.

Zamknięty dostęp. Wybrani partnerzy. Żadnych szczegółów technicznych. Klasyczny ruch OpenAI — pokazują narzędzie, ale nie dają Ci go dotknąć. Chyba że jesteś dużym laboratorium z budżetem.

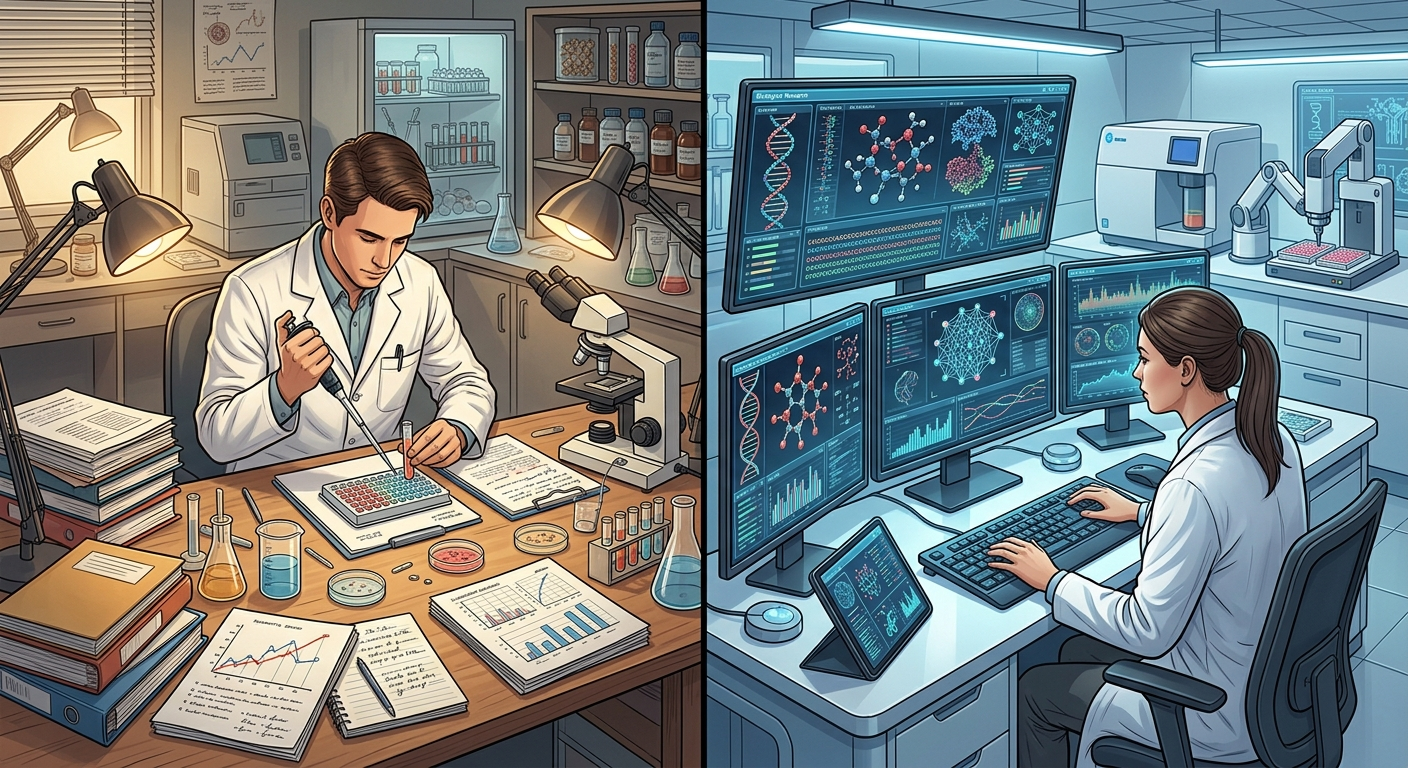

GPT-Rosalind to nie GPT-5 z dodatkowymi danymi o biologii. To osobny model, który od podstaw uczył się na specjalistycznych danych: protokołach laboratoryjnych, wynikach eksperymentów, dokumentacji procesów badawczych. Różnica? Standardowy LLM wie o biologii. GPT-Rosalind ma rozumieć jak pracują biolodzy.

OpenAI nie podaje szczegółów architektury, rozmiaru modelu ani datasetu. Wiemy tyle: model ma wspierać workflow w laboratoriach — od planowania eksperymentów po analizę wyników. Nie zastępuje naukowca. Ma być narzędziem, które przyspiesza rutynowe zadania i podpowiada kolejne kroki w badaniach.

Możesz dziś zapytać ChatGPT o mechanizm CRISPR. Odpowie Ci poprawnie — ma dostęp do publikacji naukowych. Zapytasz o konkretny protokół sekwencjonowania dla specyficznego organizmu? Albo o to, dlaczego Twój eksperyment dał nieoczekiwane wyniki? Dostaniesz ogólniki.

GPT-Rosalind ma być trenowany na danych, które pokazują jak biolodzy rozwiązują problemy, nie tylko co wiedzą. To różnica między podręcznikiem a notatkami z lat pracy w laboratorium.

OpenAI nie uruchamia publicznego API. GPT-Rosalind jest dostępny tylko dla wybranych partnerów — prawdopodobnie dużych instytucji badawczych, firm biotechnologicznych, laboratoriów farmaceutycznych. Żadnych informacji o cenie, warunkach dostępu ani planach rozszerzenia.

To strategia, którą OpenAI testowało już wcześniej — GPT-5.3-Codex przez pierwsze miesiące był dostępny tylko dla wybranych firm. Później otworzyli dostęp szerszej grupie. Czy z GPT-Rosalind będzie podobnie? Nie wiemy.

Dwa powody. Pierwszy — bezpieczeństwo. Model trenowany na procesach biologicznych może teoretycznie generować protokoły dla niebezpiecznych substancji. OpenAI kontroluje, kto ma dostęp, żeby zminimalizować ryzyko niewłaściwego użycia.

Drugi — biznes. Specjalistyczne modele to droższy produkt. Jeśli GPT-Rosalind faktycznie przyspiesza badania, laboratoria zapłacą więcej niż za standardowy ChatGPT. Zamknięty dostęp pozwala OpenAI negocjować ceny indywidualnie.

Jeśli model działa tak, jak obiecuje OpenAI — skraca czas między pomysłem a eksperymentem. Zamiast przeszukiwać literaturę przez tydzień, dostajesz gotowy protokół w 10 minut. Zamiast ręcznie analizować setki wyników, AI podpowiada wzorce, które przeoczyłeś.

To automatyzacja tego, co zajmuje biologom czas, ale nie wymaga kreatywności. Planowanie eksperymentu, przegląd literatury, formatowanie danych — zadania, które AI może przejąć, żeby naukowiec miał więcej czasu na myślenie.

Podobne narzędzia już istnieją — Google z Gemini testuje asystentów dla naukowców, Anthropic współpracuje z laboratoriami nad Claude dostosowanym do analizy danych medycznych. Różnica? OpenAI ma doświadczenie w budowaniu modeli, które ludzie faktycznie używają. ChatGPT to standard w wielu firmach — jeśli GPT-Rosalind będzie równie intuicyjny, ma szansę stać się narzędziem codziennego użytku.

W Polsce dostęp do GPT-Rosalind będą miały prawdopodobnie tylko największe ośrodki badawcze — uniwersytety medyczne, instytuty PAN, firmy biotechnologiczne z budżetem na eksperymentalne narzędzia. Mniejsze laboratoria? Raczej nie w pierwszej kolejności.

Regulacje unijne (AI Act) mogą dodatkowo skomplikować sprawę. Jeśli model generuje rekomendacje medyczne lub farmaceutyczne, musi spełniać wymogi dla systemów wysokiego ryzyka. OpenAI nie podało, jak GPT-Rosalind będzie klasyfikowany — jeśli trafisz na ścianę biurokratyczną, nie będzie zaskoczenia.

OpenAI nie podaje roadmapy. Nie wiemy, czy model będzie rozwijany, czy to jednorazowy eksperyment. Nie wiemy, czy za rok dostęp się otworzy, czy zostanie zamknięty na stałe. Nie wiemy nawet, ile kosztuje — OpenAI nie publikuje cennika.

Frustrujące, jeśli jesteś biologiem i chcesz przetestować narzędzie. Logiczne z perspektywy OpenAI — testują, czy specjalistyczne modele mają sens biznesowy. Jeśli GPT-Rosalind się sprawdzi, zobaczysz więcej takich projektów. Jeśli nie — zniknie bez śladu, jak dziesiątki innych eksperymentów.

Jedna rzecz jest pewna: AI w nauce to już nie przyszłość. To teraźniejszość. Pytanie nie brzmi "czy AI wejdzie do laboratoriów". Pytanie brzmi: "kto będzie miał do niego dostęp".

Na podstawie: Ars Technica AI

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar