OpenAI wyjaśnia AI dla początkujących. Czy warto czytać

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

OpenAI właśnie opublikowało przewodnik "AI Fundamentals" - materiał dla osób, które chcą zrozumieć, jak działa sztuczna inteligencja, ale nie mają technicznego backgroundu. To nie kolejny tutorial dla programistów. To próba wytłumaczenia, czym właściwie jest AI, jak działają duże modele językowe i dlaczego ChatGPT czasem odpowiada sensownie, a czasem halucynuje.

Sprawdziłem, czy warto poświęcić temu czas.

Pierwsza rzecz, którą OpenAI stawia jasno: AI to nie konkretny program. To szerokie określenie dla oprogramowania, które potrafi rozpoznawać wzorce, uczyć się z danych i produkować użyteczne wyniki.

Widzisz AI w codziennych sytuacjach. Aplikacja mapowa omija korek. Bank blokuje podejrzaną transakcję. Chatbot odpowiada na pytanie o status zamówienia. To wszystko AI, działające w różnych kontekstach i na różnych danych.

W ramach tej kategorii masz modele - wytrenowane systemy, które uczą się z danych, a potem stosują tę wiedzę w nowych sytuacjach. Niektóre specjalizują się w rozpoznawaniu mowy, inne w obrazach, jeszcze inne w prognozowaniu.

Jeśli zaczynasz swoją przygodę z AI od ChatGPT (a prawdopodobnie tak właśnie jest), pracujesz z dużymi modelami językowymi - systemami zaprojektowanymi do pracy z tekstem.

Duży model językowy (LLM - Large Language Model) to system, który uczy się wzorców z ogromnych ilości tekstu z różnych źródeł. Dzięki temu potrafi generować i przekształcać tekst w użyteczny sposób.

Kluczowa rzecz: LLM nie "wie" rzeczy tak jak człowiek. Zamiast tego przewiduje najbardziej prawdopodobny kolejny fragment tekstu na podstawie kontekstu. To subtelna, ale istotna różnica. Model nie ma świadomości, nie rozumie w ludzkim sensie. Po prostu bardzo dobrze nauczył się statystycznych zależności między słowami.

OpenAI i inne laboratoria badawcze budują te modele jako rdzeń swojej oferty, a potem udostępniają je przez produkty użytkownika końcowego (jak ChatGPT) albo przez API - interfejsy, które pozwalają programistom wbudować AI we własne aplikacje.

Gdy słyszysz, że model został "wytrenowany", chodzi o dwa odrębne etapy. OpenAI porównuje to do nauki nowego pracownika.

Pre-training (wstępne trenowanie) to etap, w którym model uczy się ogólnych wzorców z ogromnej ilości tekstu. Zdobywa szerokie umiejętności - podsumowywanie, pisanie, tłumaczenie, wyjaśnianie. Nowy pracownik spędza tygodnie czytając instrukcje, przykłady dobrej roboty, stare projekty i FAQ, aż zrozumie "kształt" zadania.

Fine-tuning (dostrajanie) to etap, w którym model zaczyna wykonywać pracę, a "menedżer" go coachuje - bądź jaśniejszy, zadawaj dobre pytania uzupełniające, dopasuj ton, przestrzegaj zasad firmy. Model dostaje feedback na swoich odpowiedziach i dostosowuje się, żeby być bardziej użyteczny w konkretnych zadaniach.

To wyjaśnia, dlaczego ChatGPT potrafi dostosować ton odpowiedzi do kontekstu rozmowy - to efekt fine-tuningu, nie przypadek.

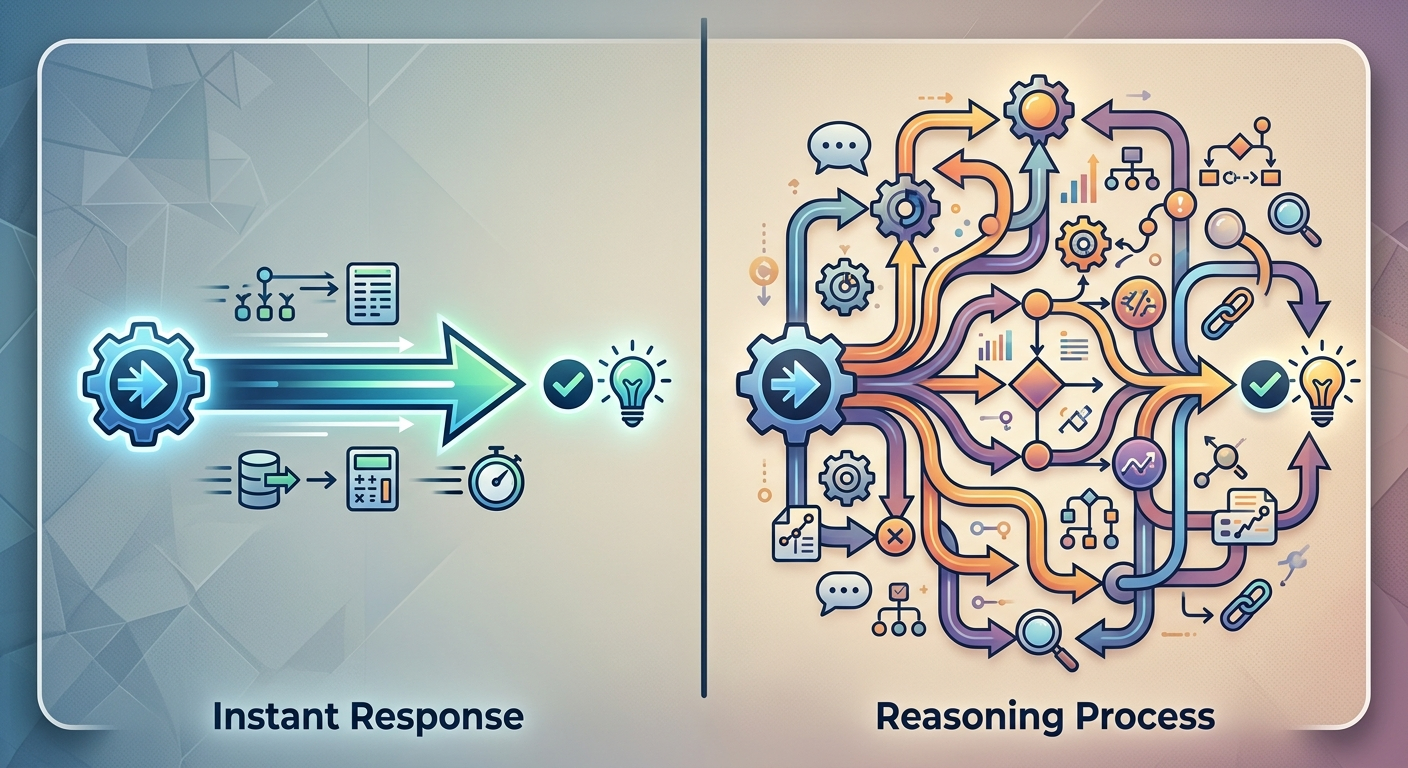

OpenAI wprowadza rozróżnienie, które wcześniej nie było tak wyraźnie komunikowane: modele rozumujące (reasoning models) vs. modele nierozumujące (non-reasoning models).

Modele nierozumujące (jak większość wersji GPT-5 w trybie standardowym) generują odpowiedzi natychmiast - przewidują kolejne słowa na podstawie kontekstu i treningu. Działają szybko, nie "myślą" przed odpowiedzią.

Modele rozumujące (jak GPT-5 w trybie reasoning) mają dodatkowy krok: przed wygenerowaniem odpowiedzi "zastanawiają się" - analizują problem, rozważają różne podejścia, sprawdzają wewnętrzną spójność. To kosztuje czas (odpowiedź trwa dłużej), ale daje lepsze wyniki w zadaniach wymagających logiki, matematyki czy planowania.

W praktyce: jeśli pytasz o przepis na ciasto, wystarczy model nierozumujący. Jeśli prosisz o rozwiązanie złożonego problemu biznesowego z wieloma zmiennymi, model rozumujący da Ci lepszą odpowiedź.

OpenAI wprowadził w GPT-5 mechanizm adaptive routing - model sam decyduje, czy dane zapytanie wymaga trybu rozumującego, czy wystarczy standardowa odpowiedź.

Nie musisz ręcznie przełączać trybów. GPT-5 analizuje pytanie i wybiera odpowiednią ścieżkę. Proste pytanie? Szybka odpowiedź. Złożony problem? Model przechodzi w tryb reasoning.

To zmienia sposób, w jaki korzystasz z ChatGPT - nie musisz już myśleć "czy powinienem użyć trybu o1, czy standardowego". GPT-5 robi to za Ciebie. (Choć nadal możesz wymusić konkretny tryb, jeśli chcesz.)

OpenAI celuje w osoby, które chcą zrozumieć AI, ale nie mają technicznego backgroundu. Jeśli pracujesz w marketingu, edukacji, zarządzaniu - i wiesz, że AI zmienia sposób pracy, ale nie do końca rozumiesz, co dzieje się pod maską - ten materiał jest dla Ciebie.

Przewodnik nie wymaga znajomości programowania ani matematyki. Nie ma wzorów, nie ma kodu. Tylko wyjaśnienia w języku, który rozumie osoba spoza branży tech.

Jednocześnie - to nie jest uproszczenie do poziomu infantylizacji. OpenAI nie traktuje czytelnika protekcjonalnie. Tłumaczy pojęcia wprost, bez zbędnego żargonu.

Jeśli dopiero zaczynasz rozumieć AI - przeczytaj przewodnik. Zajmie Ci 15-20 minut, a dostaniesz solidną mapę terenu. Zrozumiesz, dlaczego ChatGPT czasem "halucynuje", czym różni się pre-training od fine-tuningu i kiedy warto użyć modelu rozumującego.

Jeśli już korzystasz z AI w pracy - przewodnik da Ci język do rozmowy z zespołem. Zamiast mówić "ChatGPT czasem się myli", będziesz mógł wyjaśnić, że model przewiduje prawdopodobieństwo, nie weryfikuje faktów - i dlatego potrzebujesz weryfikacji wyników.

Jeśli zarządzasz ludźmi, którzy mają wdrożyć AI - prześlij im ten link. To lepsze wprowadzenie niż większość korporacyjnych szkoleń.

OpenAI Academy (platforma, na której opublikowano przewodnik) to próba edukacji na większą skalę. Nie tylko dla developerów, ale dla każdego, kto chce zrozumieć, jak AI działa i jak go używać. Jeśli kolejne materiały będą na tym poziomie - warto śledzić.

Na podstawie: OpenAI Academy - AI Fundamentals

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar