Qwen3.6-27B: model AI, który mieści się na jednej karcie graficznej

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Alibaba właśnie wypuściło Qwen3.6-27B — otwarty model AI, który ma zmieścić się na jednej karcie graficznej do komputera stacjonarnego. Jednocześnie — według producenta — dorównuje w niektórych zadaniach kodowania Claude Opus 4.5, czyli jednemu z najlepszych komercyjnych modeli na rynku. Jeśli to prawda, mówimy o konkretnej zmianie: zamiast płacić za API albo wynajmować serwery w chmurze, uruchamiasz model lokalnie. Na swoim sprzęcie. Bez wysyłania kodu do zewnętrznych serwerów.

Pytanie brzmi: czy to faktycznie działa, czy to kolejny marketing oparty na wybiórczych benchmarkach?

Qwen3.6-27B to model z 27 miliardami parametrów. Dla porównania: Claude Opus 4.5 ma ich znacznie więcej (Anthropic nie ujawnia dokładnej liczby, ale szacunki mówią o ponad 100 miliardach). Mimo to Alibaba twierdzi, że w wybranych zadaniach — zwłaszcza związanych z kodowaniem — ich model osiąga porównywalne wyniki.

Kluczowa różnica? Qwen3.6-27B jest open-source'owy. Pobierasz go, uruchamiasz lokalnie i używasz bez limitów API, bez subskrypcji, bez wysyłania danych na zewnątrz. Alibaba podaje, że model zmieści się na jednej karcie graficznej z 24 GB VRAM — czyli np. NVIDIA RTX 4090 albo A5000. To sprzęt, który możesz mieć w biurze albo w domu.

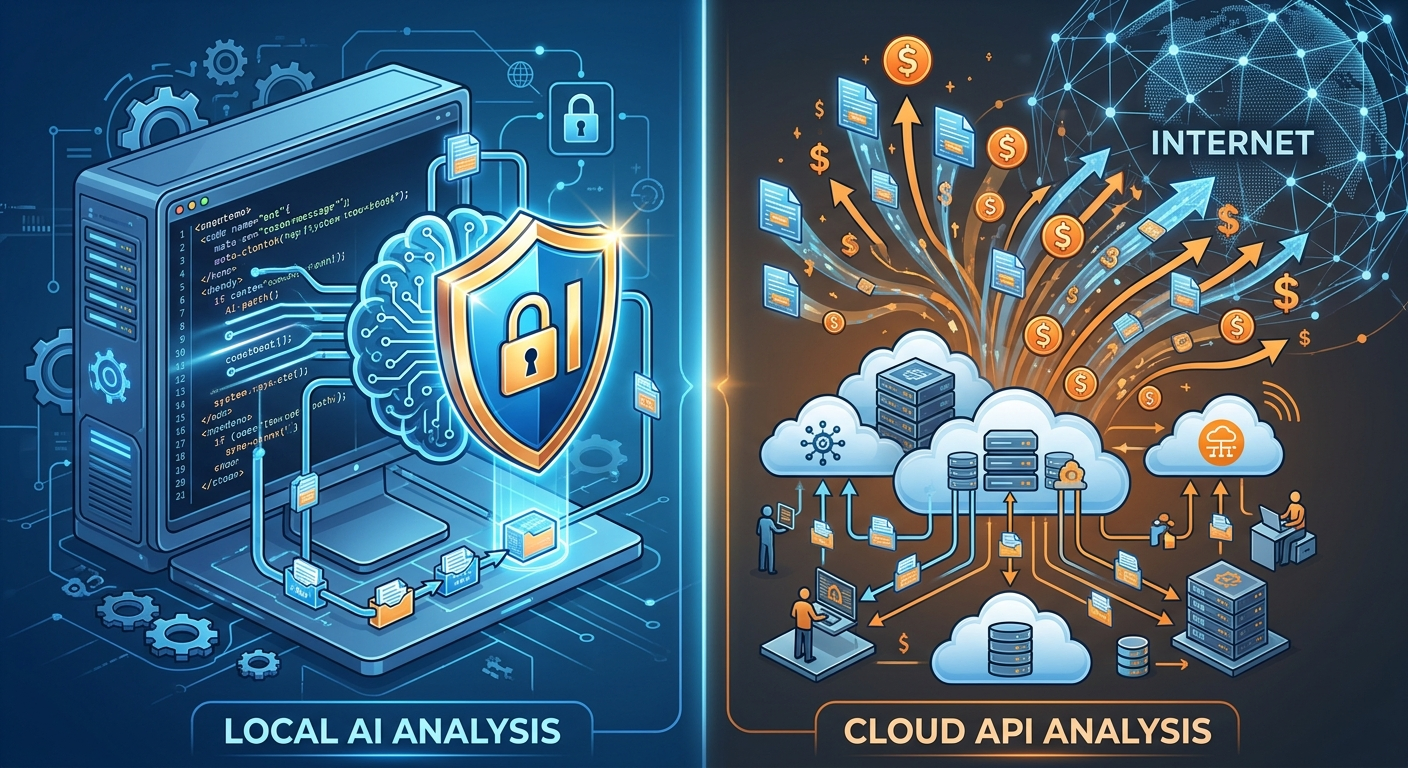

Pracujesz z kodem, który nie może opuścić Twojej infrastruktury (np. ze względów bezpieczeństwa albo regulacji)? Lokalny model to konkretna opcja. Nie musisz wysyłać fragmentów kodu do OpenAI, Anthropic czy Google. Wszystko dzieje się na Twoim sprzęcie.

Drugi scenariusz: koszty. API komercyjnych modeli kosztuje — zwłaszcza jeśli używasz ich intensywnie. Lokalny model to jednorazowa inwestycja w sprzęt, potem płacisz tylko za prąd. Dla firm, które przetwarzają duże ilości kodu codziennie, różnica w budżecie może być znacząca.

Alibaba publikuje wyniki benchmarków, w których Qwen3.6-27B osiąga wyniki zbliżone do Claude Opus 4.5 w zadaniach związanych z kodowaniem. Konkretnie: w testach HumanEval (generowanie kodu na podstawie opisu) i MBPP (rozwiązywanie problemów programistycznych) model uzyskał wyniki na poziomie 85-87%, podczas gdy Claude Opus 4.5 osiąga 88-90%.

Różnica? Około 3-5 punktów procentowych. W większości zadań kodowania Qwen3.6 radzi sobie porównywalnie. Nie lepiej, ale też nie znacząco gorzej.

Tam, gdzie liczy się rozumienie kontekstu i złożone rozumowanie. W testach MMLU (ogólna wiedza) i BBH (trudne zadania rozumowania) Qwen3.6 wypada słabiej — około 10-15 punktów procentowych poniżej Claude Opus 4.5. Potrzebujesz modelu do analizy złożonych dokumentów, strategii biznesowej albo zadań wymagających głębokiego rozumowania? Claude nadal wygrywa.

Qwen3.6 to narzędzie do konkretnych zadań: generowanie kodu, refaktoryzacja, debugowanie, dokumentacja. Nie zastąpi uniwersalnych asystentów w każdym scenariuszu, ale w swoim zakresie działa solidnie.

Qwen3.6-27B to model otwarty. Modyfikujesz go, fine-tunujesz na własnych danych, uruchamiasz bez ograniczeń. Dla firm, które chcą dostosować model do specyficznych zadań (np. analizy kodu w konkretnym języku programowania albo frameworku), to konkretna przewaga.

Z drugiej strony: brak wsparcia technicznego, brak gwarancji stabilności, brak automatycznych aktualizacji. Jeśli coś nie działa, nie zadzwonisz do supportu. Musisz mieć zespół, który ogarnie deployment, monitoring i ewentualne problemy.

W Europie (w tym w Polsce) regulacje dotyczące przetwarzania danych — zwłaszcza Jeśli chodzi o RODO — stają się coraz bardziej restrykcyjne. Wysyłanie kodu albo danych klientów do API w chmurze może być problematyczne. Lokalny model eliminuje ten problem: dane nie opuszczają Twojej infrastruktury.

Dla firm z sektora finansowego, medycznego albo prawniczego to może być decydujący argument. Regulacje wymagają kontroli nad tym, gdzie dane trafiają. Lokalny model daje Ci tę kontrolę.

Qwen3.6-27B możesz uruchomić na sprzęcie z 24 GB VRAM. To oznacza kartę graficzną z wyższej półki — np. NVIDIA RTX 4090 (ok. 8-10 tys. zł) albo A5000 (ok. 12-15 tys. zł). Nie jest to budżet dla każdego, ale dla firmy, która płaci miesięcznie kilka tysięcy złotych za API, zwrot z inwestycji może przyjść w ciągu kilku miesięcy.

Alibaba udostępnia model przez platformę Hugging Face — pobierasz go, uruchamiasz lokalnie (np. przez Ollama albo LM Studio) i testujesz bez rejestracji, bez płatności, bez limitów. Chcesz sprawdzić, jak radzi sobie z Twoim kodem? Możesz to zrobić dziś.

Jesteś freelancerem albo małą firmą, która nie przetwarza dużych ilości kodu codziennie? API w chmurze (np. ChatGPT albo Claude) będzie prostsze i tańsze. Nie musisz kupować sprzętu, nie musisz zarządzać infrastrukturą.

Jesteś średnią albo dużą firmą, która przetwarza kod codziennie, ma zespół DevOps i potrzebuje kontroli nad danymi? Qwen3.6 może być konkretną opcją. Zwłaszcza jeśli regulacje albo polityka bezpieczeństwa wykluczają wysyłanie kodu na zewnątrz.

Qwen3.6-27B to kolejny krok w kierunku demokratyzacji AI. Nie musisz płacić za API, nie musisz uzależniać się od jednego dostawcy, nie musisz wysyłać danych na zewnątrz. Uruchamiasz model lokalnie i masz pełną kontrolę.

Dla firm, które do tej pory rezygnowały z AI ze względu na koszty albo obawy o prywatność, to konkretna alternatywa. Nie jest idealna — wymaga sprzętu, wymaga kompetencji technicznych, wymaga zarządzania. Daje jednak coś, czego API w chmurze nie daje: kontrolę.

Pytanie, które zostaje: czy open-source'owe modele będą nadal doganiać komercyjne giganty, czy różnica w jakości zacznie się powiększać? Na razie — w marcu 2026 — Qwen3.6 pokazuje, że lokalny model może dorównać komercyjnym rozwiązaniom w wybranych zadaniach. Za kilka miesięcy zobaczymy, czy ten trend się utrzyma.

Na podstawie: ITmedia AI

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar