Starcloud wynosi centra danych na orbitę

Źródło: Link

Źródło: Link

90 minut praktyki na żywo. Pokazuję krok po kroku, jak zacząć z AI bez kodowania.

Centra danych pożerają energię. Wymagają gigantycznych systemów chłodzenia. Starcloud, startup ze Szkocji, ma propozycję: wynieś serwery w kosmos. Próżnia zapewni naturalne chłodzenie, panele słoneczne – nieograniczoną energię.

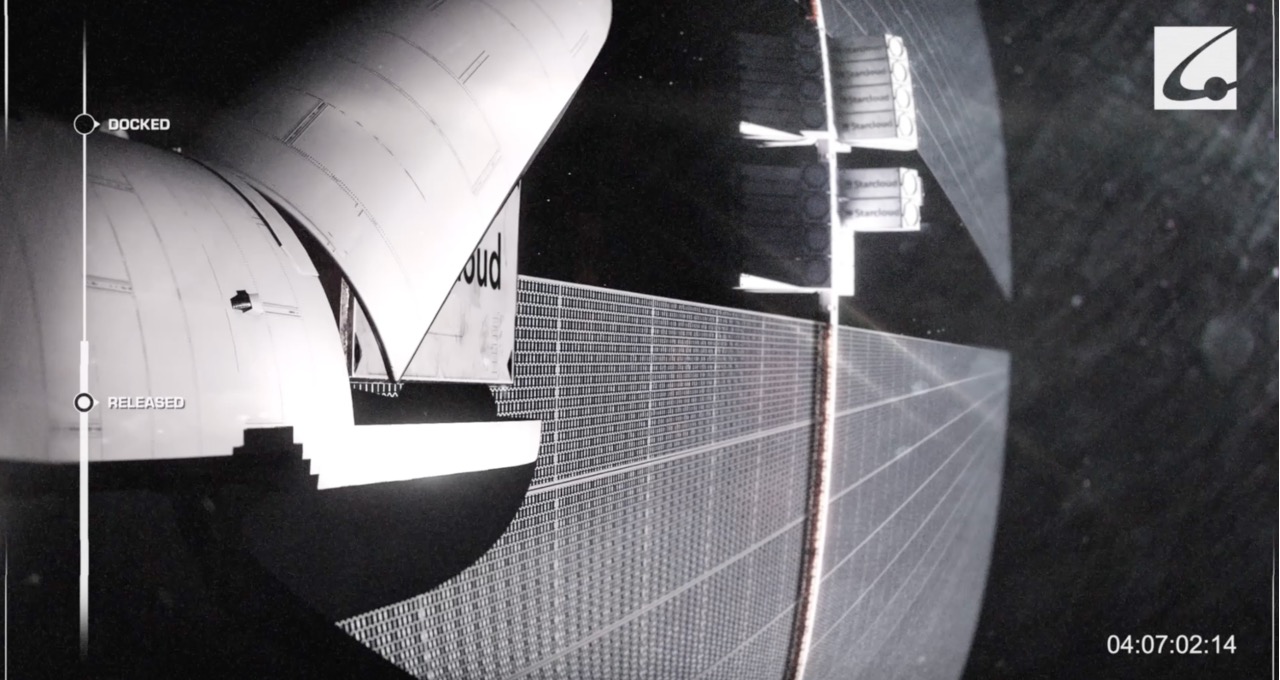

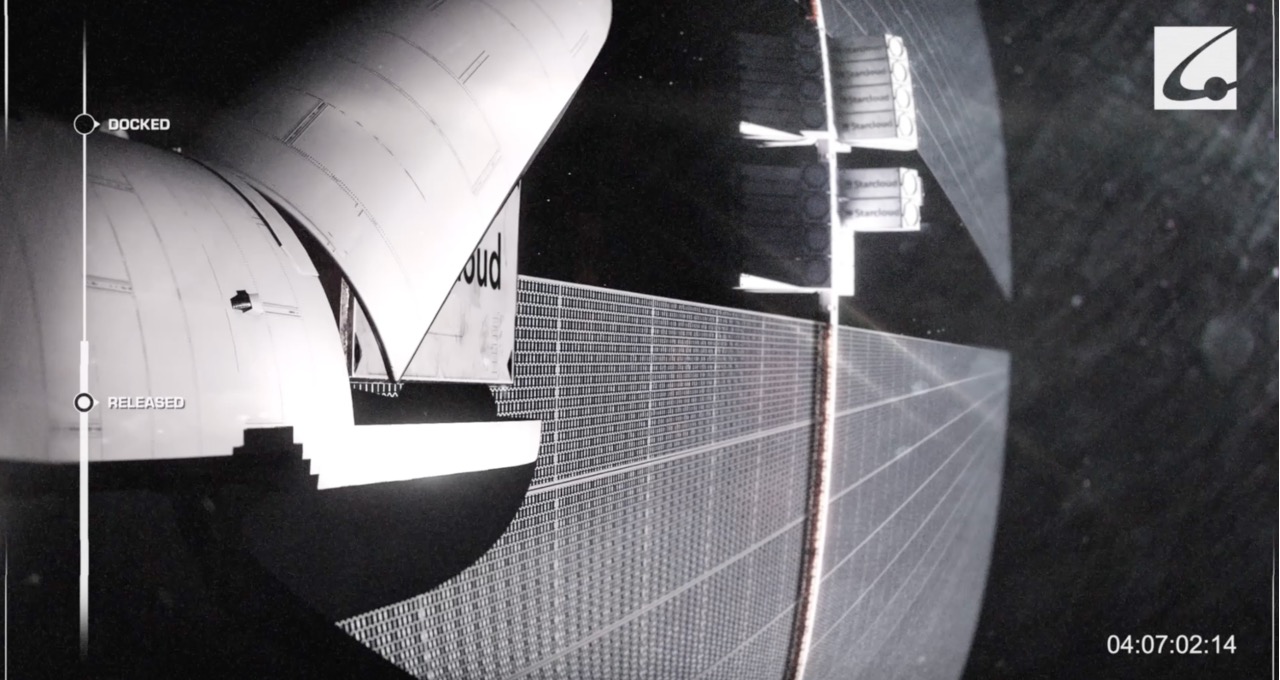

Firma planuje umieścić na orbicie satelity z GPU NVIDIA. Mają obsługiwać najbardziej wymagające obliczenia AI. Pierwsza misja demonstracyjna SCS-1 wystartuje już w 2025 roku. To nie science fiction – Starcloud właśnie podpisał kontrakt z NVIDIA na dostawy kart graficznych H100 i L40S.

Tradycyjne centra danych to energetyczne potwory. Trening dużych modeli językowych wymaga tysięcy GPU pracujących przez tygodnie. 40% energii idzie wyłącznie na chłodzenie. W kosmosie próżnia odbiera ciepło przez radiację – bez wentylatorów, bez klimatyzacji, bez rachunków za prąd.

Warto tu zaznaczyć skalę problemu, który Starcloud próbuje rozwiązać. Globalne centra danych zużywają już dziś więcej energii elektrycznej niż całe kraje, takie jak Argentyna czy Polska. Szacuje się, że samo trenowanie jednego dużego modelu językowego klasy GPT-5 generuje emisję CO2 porównywalną z kilkuset lotami transatlantycznymi. Wraz z eksplozją popularności narzędzi AI zapotrzebowanie na moc obliczeniową rośnie w tempie, za którym trudno nadążyć z budową nowej infrastruktury naziemnej.

Panele słoneczne generują energię non-stop (bo tam, gdzie są satelity, noc nie trwa 12 godzin). Starcloud szacuje, że koszt obliczeń na orbicie spadnie o 60-70% w porównaniu z naziemnymi centrami danych. Satelity będą komunikować się z Ziemią przez łącza optyczne o przepustowości do 100 Gbps – wystarczy to do przesyłania wyników w czasie rzeczywistym.

Łącza optyczne to kluczowy element całej układanki. Tradycyjna komunikacja radiowa byłaby zbyt wolna i zbyt podatna na zakłócenia, żeby realnie konkurować z naziemnymi chmurami obliczeniowymi. Technologia laserowej transmisji danych między satelitą a naziemnymi stacjami odbioru pozwala na przepustowość porównywalną z łączami światłowodowymi – co sprawia, że opóźnienia w dostępie do wyników obliczeń mogą być akceptowalne dla wielu zastosowań komercyjnych.

Satelita SCS-1 to demonstrator technologii. Platforma wielkości biurka z GPU NVIDIA i systemem chłodzenia radiacyjnego. Misja ma udowodnić, że sprzęt działa stabilnie w warunkach orbitalnych: promieniowanie kosmiczne, wahania temperatury od -150°C do +150°C, brak grawitacji.

To nie są trywialne wyzwania inżynieryjne. Promieniowanie kosmiczne może powodować tzw. single-event upsets – losowe błędy w rejestrach procesora wywołane uderzeniem cząstki energetycznej. Na Ziemi atmosfera i pole magnetyczne chronią układy elektroniczne przed tym zjawiskiem. Na orbicie sprzęt musi być odpowiednio hartowany lub wyposażony w mechanizmy detekcji i korekcji błędów. Właśnie dlatego misja SCS-1 ma charakter demonstracyjny – Starcloud musi zebrać rzeczywiste dane o niezawodności GPU NVIDIA w środowisku orbitalnym, zanim zaoferuje usługę klientom komercyjnym.

Jeśli test się powiedzie, Starcloud planuje serię większych satelitów do 2027 roku. Każdy będzie mieścił rack serwerów z wieloma GPU, działając jako węzeł w rozproszonej chmurze obliczeniowej. Dostęp dla klientów przez standardowe API – jak dziś wynajmujesz instancje w AWS czy Google Cloud.

Model dostępu przez standardowe API to świadomy wybór strategiczny. Starcloud nie chce zmuszać klientów do przepisywania kodu ani integrowania egzotycznych interfejsów. Firmy, które dziś korzystają z chmurowych instancji GPU, mogłyby teoretycznie przekierować wybrane zadania obliczeniowe na orbitalne węzły bez zmiany architektury swoich aplikacji.

Najbardziej oczywistymi odbiorcami są zadania, które nie wymagają interaktywności w czasie rzeczywistym. Trenowanie modeli uczenia maszynowego, przetwarzanie wsadowe dużych zbiorów danych, renderowanie grafiki 3D, symulacje naukowe czy analiza obrazów satelitarnych to obszary, gdzie kilkusekundowe opóźnienie w komunikacji z orbitą nie stanowi przeszkody. Inaczej sytuacja wygląda w przypadku aplikacji wymagających odpowiedzi w ułamkach sekund – tam naziemna infrastruktura pozostanie niezastąpiona.

Firmy trenujące duże modele językowe mogą zyskać tańszą alternatywę dla Google, Microsoft czy Amazon. Startupy AI często czekają tygodniami na dostęp do GPU w chmurze – orbitalne centra danych mogą zwiększyć globalną podaż mocy obliczeniowej.

Problem dostępności GPU stał się jednym z głównych hamulców rozwoju całej branży AI. Po premierze ChatGPT popyt na karty graficzne do obliczeń AI dosłownie prześcignął możliwości produkcyjne NVIDIA. Kolejki na instancje H100 w największych chmurach publicznych liczyły się w tygodniach, a ceny spot instance'ów osiągały absurdalne poziomy. Każde nowe źródło mocy obliczeniowej – nawet jeśli dziś brzmi egzotycznie – jest przez część rynku traktowane poważnie.

Wyzwania oczywiście pozostają. Koszt wyniesienia sprzętu na orbitę. Ograniczona możliwość napraw (żadnych fizycznych interwencji). Ryzyko kolizji z kosmicznymi śmieciami. Starcloud zakłada 5-7 lat żywotności każdego satelity, po czym musi go sprowadzić na Ziemię lub przenieść na orbitę cmentarną.

Kwestia kosmicznych śmieci to nie tylko problem techniczny, ale i regulacyjny. Agencje kosmiczne oraz organizacje odpowiedzialne za zarządzanie ruchem orbitalnym coraz głośniej domagają się odpowiedzialności operatorów za pozostawiane na orbicie obiekty. Starcloud, planując kolejne satelity do 2027 roku, będzie musiał uzyskać stosowne zgody i wykazać, że jego operacje nie zwiększają ryzyka kolizji na zatłoczonych orbitach niskich.

Czy to się sprawdzi? Przekonamy się w 2025 roku. Jedno jest pewne – jeśli kosmiczne GPU okazują się opłacalne, konkurencja nie będzie czekać.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar