Tirada de Cordura: jak gra RPG nauczyła AI mierzyć strach

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

„Gracze zaczęli zamykać oczy. Nie chcieli patrzeć na potwory” — Sandy Petersen, twórca „La Llamada de Cthulhu”, opisał pierwszą sesję testową w 1981 roku. W „Dungeons & Dragons” nikt nie odwracał wzroku. Potwór to cel do zabicia. W świecie Lovecrafta? Samo spojrzenie na coś, co nie powinno istnieć, niszczy umysł.

Petersen wymyślił wtedy coś, czego nie było w żadnej grze RPG: mechanikę strachu. Tirada de Cordura — rzut na Zdrowie Psychiczne. Pierwszy system, który zmierzył to, czego zmierzyć się nie da.

W klasycznych grach fabularnych masz punkty życia. Tracisz je, gdy cię uderzą. Proste. Jak zmierzyć moment, gdy twoja postać widzi coś, co łamie jej rozumienie rzeczywistości?

Petersen stworzył osobną pulę punktów — Cordura (Sanity). Każde spotkanie z czymś niewyobrażalnym wymaga rzutu kością. Nie zdasz? Tracisz punkty. Stracisz za dużo? Twoja postać popada w obłęd. Może na stałe.

To nie był kosmetyczny dodatek. To była fundamentalna zmiana filozofii gry. W D&D jesteś bohaterem, który wygrywa. W „La Llamada de Cthulhu” jesteś człowiekiem, który próbuje przetrwać — i prawdopodobnie przegra.

Dziś systemy oparte na Cordurze znajdziesz w dziesiątkach gier — od „Amnesia” po „Darkest Dungeon”. W 1981 roku to był eksperyment. Petersen nie wiedział, czy gracze to zaakceptują.

Zaakceptowali. Gra sprzedała się w milionach egzemplarzy. Dlaczego? Po raz pierwszy mechanika oddawała coś prawdziwego — uczucie bezradności wobec czegoś większego niż Ty.

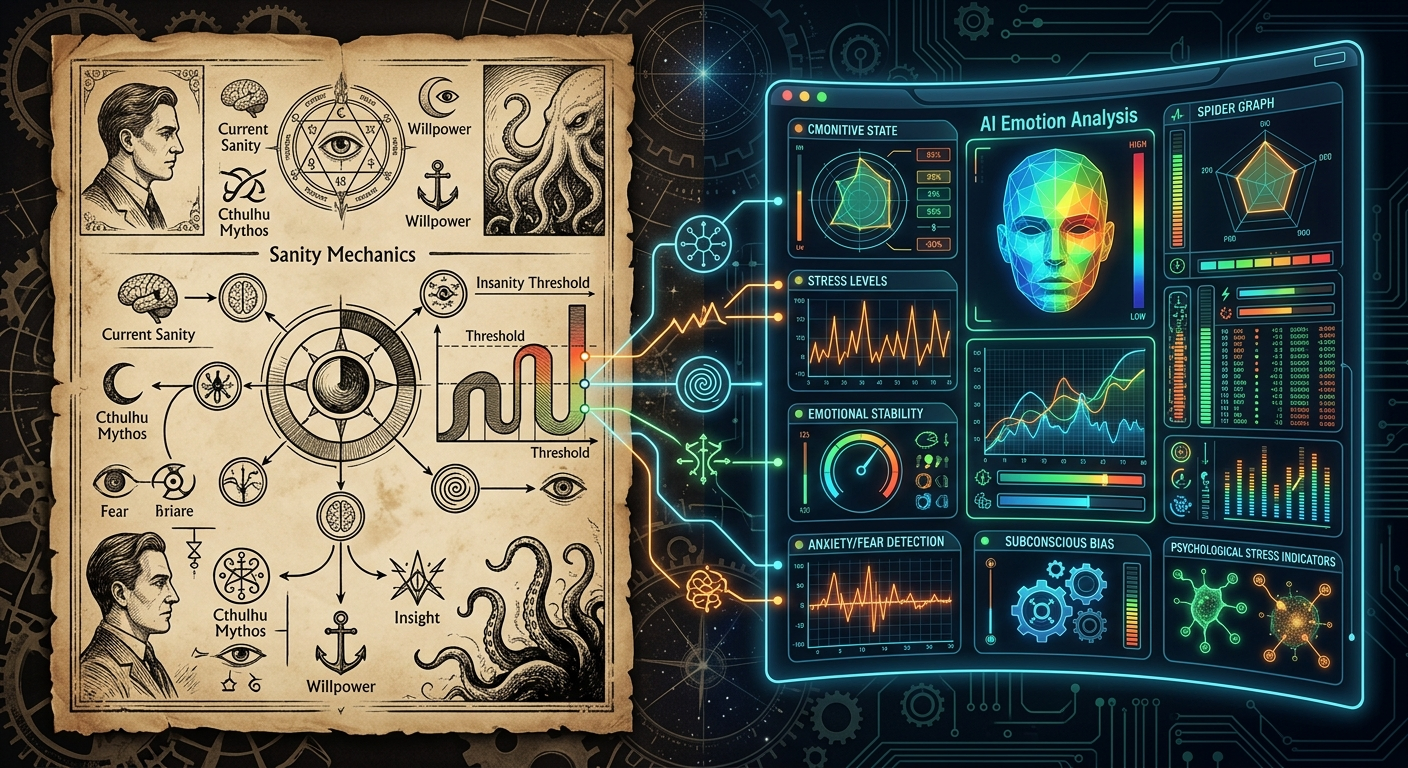

Przeskoczmy do 2026 roku. Systemy AI próbują dziś robić to samo, co Tirada de Cordura — mierzyć stany emocjonalne. Tylko zamiast kości używają analizy tekstu, głosu, mimiki.

Przykład? Chatboty medyczne oceniają poziom lęku pacjenta na podstawie tego, jak formułuje pytania. Modele językowe analizują ton wiadomości, by dostosować odpowiedź. To już działa w aplikacjach, których używasz.

Petersen miał łatwiej. W grze RPG rzucasz kością, patrzysz na wynik, akceptujesz konsekwencje. Nikt nie kwestionuje, że twoja postać zwariowała, bo wyrzuciłeś 3 zamiast 15.

W prawdziwym życiu? AI może powiedzieć, że jesteś zestresowany na poziomie 7/10. Na podstawie czego? Tempa pisania? Wyboru słów? I co z tego wynika — że potrzebujesz pomocy, czy po prostu masz zły dzień?

Systemy takie jak Claude czy Gemini uczą się rozpoznawać sygnały emocjonalne w tekście. Nie mają kontekstu. Nie wiedzą, że piszesz szybko, bo spóźniasz się na pociąg, a Nie chodzi o to, że jesteś w panice.

Tirada de Cordura działa, bo gracze zgadzają się na abstrakcję. Wiesz, że twoja postać nie ma naprawdę „45 punktów zdrowia psychicznego”. To tylko sposób, by opowiedzieć historię o tym, jak umysł radzi sobie z horrorem.

AI potrzebuje tego samego — zgody na uproszczenie. Nie zmierzy Twojego strachu z precyzją termometru. Może zauważyć wzorce. Może dostrzec, że piszesz inaczej, gdy jesteś pod presją. I może — jeśli zaprojektujemy to dobrze — zareagować w sposób, który pomoże, a nie zaszkodzi.

Weź asystentów AI w przeglądarkach. Jeśli system zauważy, że zadajesz to samo pytanie piąty raz z rzędu — może zaproponować inny sposób wyjaśnienia. Nie chodzi o to, że „wie”, że jesteś sfrustrowany. Dlatego, że rozpoznaje wzorzec.

To nie empatia. To heurystyka. Czasem wystarczy.

Petersen stworzył Tiradę de Cordura, by gra była lepsza. Co, jeśli ktoś użyje podobnej mechaniki, by cię kontrolować?

Systemy AI, które „czytają” twoje emocje, mogą dostosować treści, by utrzymać cię w aplikacji dłużej. Mogą pokazać ci reklamy w momencie, gdy jesteś najbardziej podatny. Mogą — i robią to — optymalizować nie pod Twoją korzyść, ale pod zaangażowanie.

Różnica między pomocą a manipulacją? Intencja. Kto projektuje te systemy i w czyim interesie?

W grze RPG wiesz, kiedy rzucasz na Cordurę. Widzisz wynik. Rozumiesz konsekwencje. W AI? Rzadko masz pojęcie, że system właśnie ocenił Twój stan emocjonalny i dostosował odpowiedź.

Anthropic i inne firmy zaczynają publikować dokumentację, jak ich modele reagują na sygnały emocjonalne. To krok w dobrą stronę. Wciąż za mało firm robi to samo.

Sandy Petersen nie próbował stworzyć idealnego symulatora ludzkiej psychiki. Stworzył narzędzie, które pozwoliło graczom opowiedzieć lepsze historie. Tirada de Cordura działa, bo służy narracji — nie udaje, że jest czymś więcej.

AI powinno działać tak samo. Nie udawać, że „rozumie” Twoje emocje. Oferować narzędzia, które pomagają — i być uczciwym co do swoich ograniczeń.

Czy model językowy może zmierzyć strach? Nie. Może zauważyć, że piszesz inaczej. I zapytać: „Potrzebujesz pomocy w inny sposób?”

To nie magia. To mechanika. Czasem to wystarcza.

Na podstawie: Xataka

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar