Wielka awaria AI. ChatGPT, Gemini, Copilot i Claude padły

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Poniedziałek, 20 kwietnia 2026. Otwierasz ChatGPT, żeby dokończyć raport. Błąd. Próbujesz Gemini — to samo. Copilot? Cisza. Claude? Też nie odpowiada.

Nie, to nie Twoje WiFi.

Tego dnia kilka największych narzędzi AI generatywnego przestało działać jednocześnie. Nie mówimy o drobnym spowolnieniu — mówimy o całkowitej przerwie w dostępie. Jeśli Twój workflow opiera się na którymś z tych asystentów, ten dzień był bolesny.

ChatGPT, Gemini, Microsoft Copilot i Claude — wszystkie zgłosiły problemy z działaniem w tym samym czasie. To nie przypadek, że akurat te cztery. To najpopularniejsze narzędzia AI na rynku, z których korzystają miliony użytkowników dziennie.

ChatGPT (OpenAI) — flagowy produkt, który uruchomił całą falę zainteresowania AI generatywnym. Gemini (Google) — odpowiedź giganta z Mountain View, zintegrowana z ekosystemem Google. Copilot (Microsoft) — asystent wbudowany w pakiet Office i Windows. Claude (Anthropic) — model stawiający na bezpieczeństwo i precyzję, ulubieniec osób pracujących z długimi dokumentami.

Kiedy jeden z nich pada, to problem. Kiedy wszystkie naraz — to już wzorzec.

Szczegóły różnią się w zależności od platformy. ChatGPT nie odpowiadał na zapytania — użytkownicy widzieli komunikaty o błędach lub nieskończone ładowanie. Gemini miał podobne objawy. Copilot przestał generować odpowiedzi w aplikacjach Microsoft 365. Claude zwracał błędy API.

Żadna z firm nie podała oficjalnej przyczyny w pierwszych godzinach awarii. To standardowa procedura — najpierw napraw, potem tłumacz. Brak komunikacji tylko podsycał spekulacje.

Awarie się zdarzają. Każda usługa online ma swoje momenty słabości. Synchroniczna przerwa w działaniu czterech niezależnych platform to sygnał, że problem leży głębiej.

Możliwe scenariusze? Kilka.

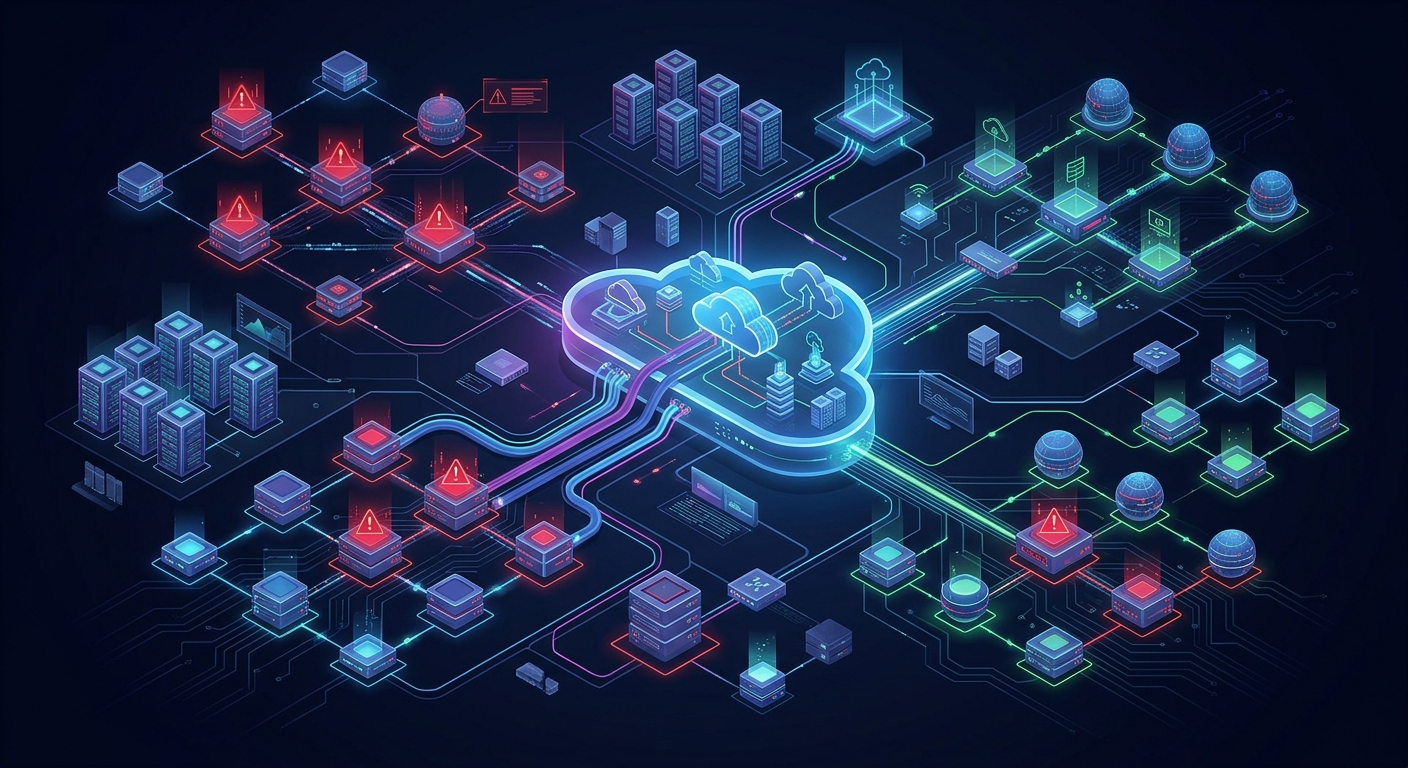

Pierwszy: wspólny dostawca infrastruktury. Większość dużych modeli AI działa na chmurze — AWS, Azure, Google Cloud. Jeśli jeden z tych gigantów ma problem, efekt domina jest nieunikniony.

Drugi: atak DDoS wymierzony w sektor AI.

Trzeci: problem z dostawcą usług sieciowych, który obsługuje ruch między użytkownikami a serwerami AI.

Żaden z tych scenariuszy nie jest uspokajający. Pierwszy oznacza, że zbyt wiele zależy od zbyt małej liczby dostawców. Drugi — że AI stało się na tyle ważne, by stać się celem ataków. Trzeci — że infrastruktura internetowa ma pojedyncze punkty awarii, które mogą sparaliżować kluczowe usługi.

Jeśli używasz AI do pracy — a statystycznie coraz więcej osób to robi — ta awaria to lekcja. Backup to nie tylko kopia plików. To też alternatywne narzędzie, gdy główne odmówi posłuszeństwa.

Jeśli Twój workflow opiera się wyłącznie na ChatGPT, dzień jak 20 kwietnia oznacza przestój. Jeśli masz dostęp do dwóch-trzech różnych modeli — masz bufor.

Podobnie jak Hyatt, który wdrożył ChatGPT Enterprise dla 120 000 pracowników, każda organizacja polegająca na AI musi myśleć o redundancji. Nie tylko technologicznej, ale też strategicznej.

Cztery platformy. Setki milionów użytkowników. Jeden dzień awarii. To nie przypadek — to konsekwencja tego, jak zbudowany jest rynek AI.

Większość popularnych narzędzi AI działa na kilku dużych modelach: GPT-5 (OpenAI), Gemini 3 (Google), Claude Opus 4.6 (Anthropic), Llama 4 (Meta). Każdy z nich wymaga ogromnej infrastruktury obliczeniowej, którą zapewniają głównie trzy firmy: Amazon (AWS), Microsoft (Azure), Google (Cloud).

To oznacza, że nawet jeśli korzystasz z różnych aplikacji AI, pod spodem mogą one dzielić tę samą infrastrukturę. Kiedy ta infrastruktura ma problem, wszystko staje.

Podobnie jak OpenAI skupuje mniejszych graczy i konsoliduje rynek, cała branża AI zmierza w kierunku coraz większej centralizacji. To nie jest zdrowe — nie dla użytkowników, nie dla konkurencji, nie dla bezpieczeństwa.

Tak. Nie wiem kiedy, ale tak.

Każdy system ma swoje punkty awarii. Im bardziej skomplikowany, tym więcej takich punktów. A infrastruktura AI jest jedną z najbardziej skomplikowanych rzeczy, jakie kiedykolwiek zbudowaliśmy.

Różnica między firmami będzie w tym, jak szybko się podniosą i co zrobią, żeby to się nie powtórzyło. OpenAI, Google, Microsoft i Anthropic mają zespoły, które pracują 24/7, żeby utrzymać te systemy w ruchu. Nawet najlepsze zespoły nie są nieomylne.

Nie ma magicznego rozwiązania, które uchroni Cię przed każdą awarią. Są rzeczy, które możesz zrobić, żeby zmniejszyć ryzyko.

Po pierwsze: nie polegaj na jednym narzędziu. Jeśli pracujesz z AI, miej dostęp do przynajmniej dwóch różnych platform. ChatGPT i Claude. Gemini i Copilot. Nieważne która kombinacja — ważne, żeby nie była to jedna firma.

Po drugie: zapisuj ważne rzeczy lokalnie. AI generuje tekst, kod, analizy — jeśli wszystko jest w chmurze i chmura przestaje działać, zostaniesz z niczym. Kopiuj, zapisuj, archiwizuj.

Po trzecie: ucz się podstaw tego, co automatyzujesz. Jeśli AI pisze za Ciebie raporty, upewnij się, że potrafisz to zrobić sam. Nie rezygnuj z narzędzi — po prostu nie bądź całkowicie od nich zależny.

Podobnie jak wykładowcy mierzą się z problemem studentów całkowicie polegających na ChatGPT, każdy użytkownik AI musi znaleźć równowagę między automatyzacją a kompetencją.

20 kwietnia 2026 pokazał, że AI nie jest niezniszczalne. To narzędzie, które działa — dopóki działa infrastruktura, na której stoi. Kiedy ta infrastruktura pada, zostaje Twoja umiejętność radzenia sobie bez niej. I to jest umiejętność, której warto nie zaniedbywać.

Na podstawie: Numerama

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar