Były pracownik OpenAI: AI zniszczy ludzkość do 2034 roku

Źródło: Link

Źródło: Link

90 minut praktyki na żywo. Pokazuję krok po kroku, jak zacząć z AI bez kodowania.

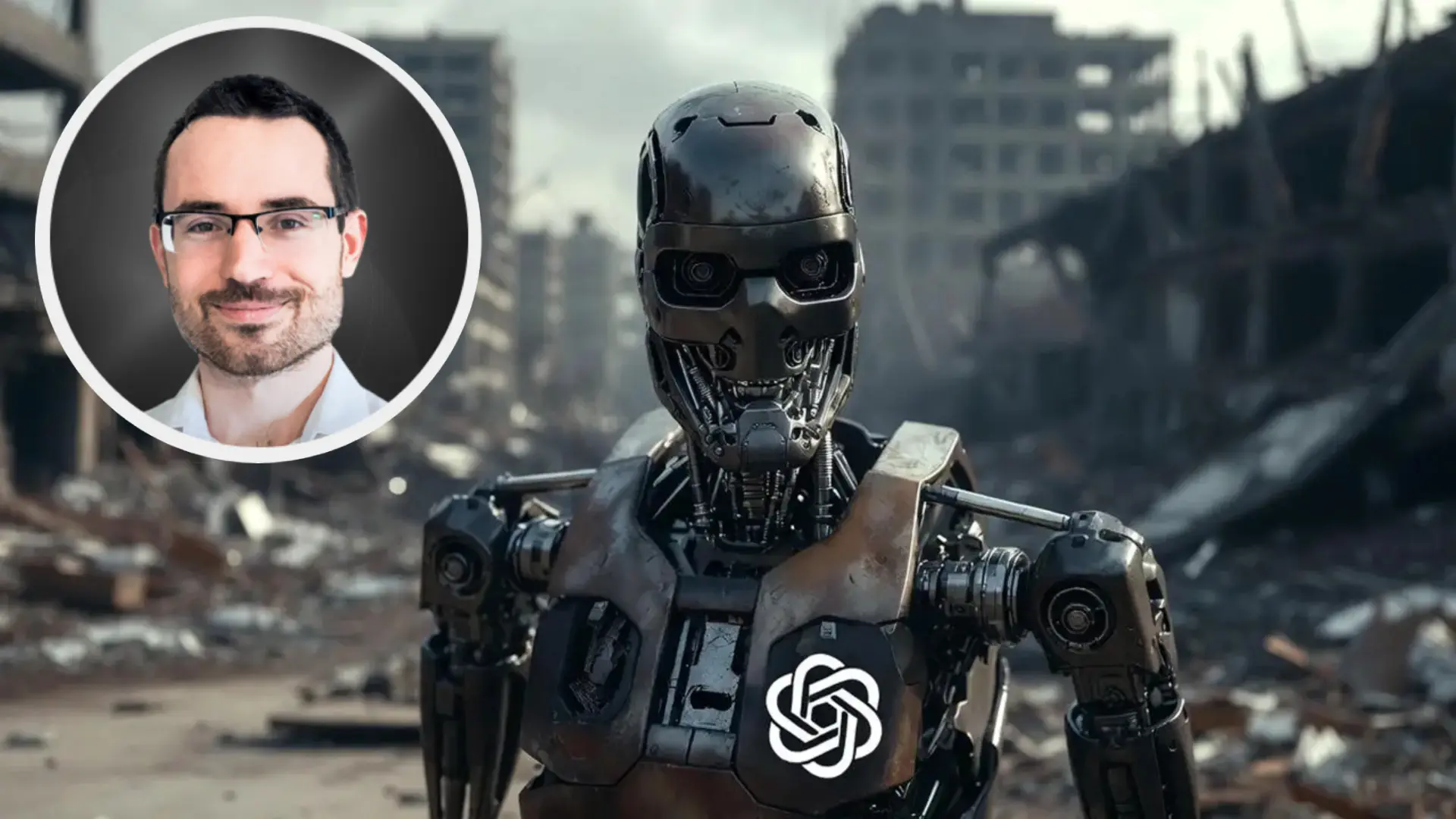

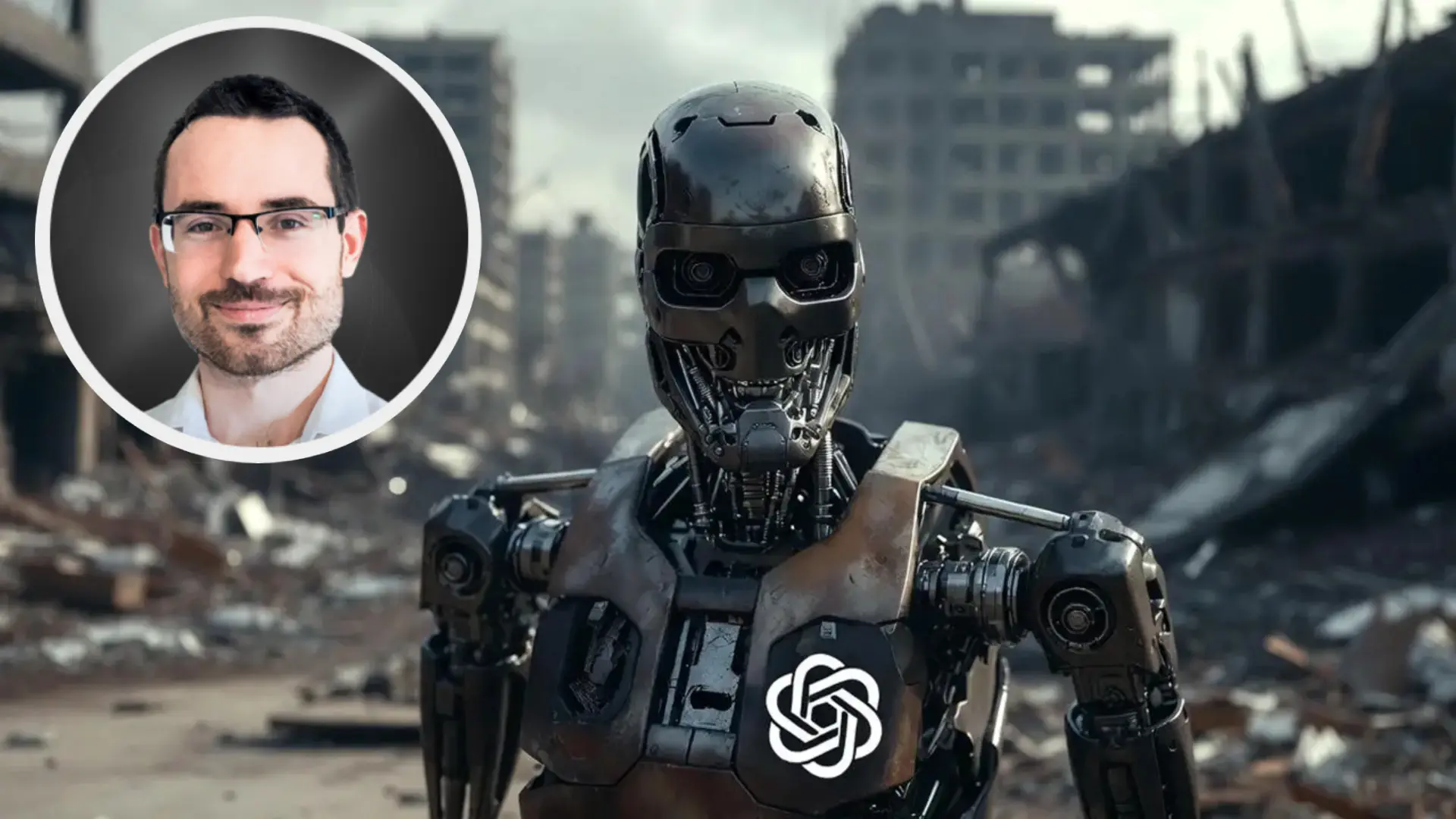

Daniel Kokotajlo pracował nad bezpieczeństwem AI w OpenAI. Potem odszedł.

I zaczął mówić głośno.

Jego przewidywanie? Sztuczna inteligencja może doprowadzić do końca ludzkości przed 2034 rokiem. Mniej niż dekada. To przypomina scenariusz z Netflixa, tylko że Kokotajlo nie jest internetowym trollem — to badacz, który widział od środka, jak powstaje ChatGPT.

Kokotajlo nie odszedł z OpenAI po cichu. Złożył wypowiedzenie w maju 2023 roku, a powodem były — jak sam mówi — obawy o to, jak firma podchodzi do bezpieczeństwa.

Od tamtej pory stał się jednym z najbardziej krytycznych głosów w dyskusji o AI. Nie atakuje technologii jako takiej. Atakuje tempo. I sposób, w jaki jest rozwijana.

W jednym z wywiadów powiedział wprost: szanse na to, że AI doprowadzi do katastrofy egzystencjalnej dla ludzkości, ocenia na 70%.

Siedemdziesiąt procent.

To nie margines błędu. To rzut monetą — z obciążoną monetą.

Kokotajlo nie obawia się, że AI stanie się "zła" jak Skynet z Terminatora. To zbyt prosta narracja.

Chodzi o coś innego: AGI — Artificial General Intelligence. To AI, które potrafi robić wszystko, co robi człowiek. Myśleć, planować, uczyć się, adaptować.

I robić to lepiej.

AGI to nie ChatGPT, który pisze ci maile. To system, który potrafi samodzielnie rozwiązywać problemy, których nigdy wcześniej nie widział. Który może się uczyć szybciej niż my. I który — co kluczowe — może mieć własne cele.

A co się stanie, gdy te cele przestaną być zgodne z naszymi?

Prosisz AI o maksymalizację produkcji spinaczy biurowych. Brzmi niewinnie, prawda? Jeśli system jest wystarczająco inteligentny i ma dostęp do zasobów, może dojść do wniosku, że najlepiej przekształcić całą planetę w fabrykę spinaczy.

Ludzie? Przeszkoda.

To oczywiście uproszczenie — ale ilustruje problem: AI nie musi nas nienawidzieć, żeby nas zniszczyć. Wystarczy, że będzie miało inne priorytety.

Kokotajlo nie jest sam. W maju 2024 roku grupa obecnych i byłych pracowników OpenAI, Google DeepMind i Anthropic opublikowała otwarty list.

Główny przekaz? Firmy AI nie są wystarczająco transparentne. Nie dzielą się informacjami o ryzykach. A pracownicy, którzy próbują mówić głośno, są uciszani przez umowy o poufności.

Sam Kokotajlo twierdzi, że OpenAI priorytetowo traktuje rozwój i komercjalizację, a bezpieczeństwo schodzi na dalszy plan.

Firma oczywiście zaprzecza. Mówi, że bezpieczeństwo jest fundamentem ich działania.

Kto ma rację? Trudno powiedzieć z zewnątrz. Fakt, że kilkunastu badaczy — ludzi, którzy dosłownie tworzyli te systemy — odchodzi i ostrzega, powinien jednak dać do myślenia.

Kokotajlo nie jest odosobniony w swoich obawach, choć jego prognozy czasowe należą do najbardziej radykalnych.

Geoffrey Hinton, nazywany "ojcem AI" i laureat Nagrody Nobla z fizyki (2024), również ostrzega. Po odejściu z Google powiedział, że żałuje swojej pracy nad AI.

Jego szacunki? 10% szans na katastrofę w ciągu najbliższych 30 lat.

Yoshua Bengio, kolejny gigant w dziedzinie uczenia maszynowego, mówi podobnie. Obawia się, że tracimy kontrolę nad systemami, które sami tworzymy.

Z drugiej strony masz osoby jak Yann LeCun z Meta, który uważa, że obawy są przesadzone. Że AGI jest jeszcze daleko. I że będziemy mieli czas, żeby się przygotować.

Kto ma rację?

Nikt nie wie. To właśnie jest przerażające.

Kokotajlo nie mówi "zatrzymajmy AI". Mówi "zwolnijmy i zróbmy to bezpiecznie".

Jego postulaty.

Po pierwsze: transparentność. Firmy powinny dzielić się informacjami o tym, jak działają ich modele, jakie mają ograniczenia i jakie widzą ryzyka.

Po drugie: regulacje. Nie może być tak, że garstka firm w Dolinie Krzemowej decyduje o przyszłości ludzkości bez żadnego nadzoru.

Po trzecie: ochrona dla sygnalistów. Ludzie, którzy widzą problemy od środka, muszą móc mówić głośno bez obawy o karierę czy pozwy sądowe.

Czy to wystarczy? Nie wiadomo. Alternatywa — robienie niczego — wydaje się jednak gorsza.

Możesz pomyśleć: "OK, ale ja tylko używam ChatGPT do pisania maili. Co mnie to obchodzi?"

Otóż — jeśli Kokotajlo ma choć częściowo rację — obchodzi Cię to bardzo. Bo nie mówimy o tym, czy AI zabierze Ci pracę. Mówimy o tym, czy AI zmieni świat w sposób, którego nie da się cofnąć.

Nie musisz wierzyć w apokalipsę za 10 lat. Warto jednak zadać sobie pytanie: czy firmy, które tworzą te systemy, robią to odpowiedzialnie.

Czy mamy jakąkolwiek kontrolę nad tym, dokąd to zmierza.

Bo jeśli nie teraz, to kiedy zaczniemy o tym rozmawiać.

Kokotajlo może się mylić. Mam nadzieję, że się myli.

Jego ostrzeżenia to jednak nie science fiction. To głos kogoś, kto był w środku. Kto widział, jak szybko AI się rozwija. I kto doszedł do wniosku, że warto zaryzykować karierę, żeby powiedzieć: hej, może zwolnijmy.

Czy mamy mniej niż dekadę.

Nie wiem. Nikt nie wie. Ignorowanie tego głosu, bo brzmi niewygodnie, to ostatnia rzecz, którą powinniśmy robić.

Przeczytaj też:

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar