Chatbot AI przekonał wyborców lepiej niż reklamy wyborcze

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Pensylwania, 2024 rok. Shamaine Daniels, kandydatka Demokratów do Kongresu, wysyła do wyborców niezwykłego wolontariusza. Nazywa się Ashley. I jest AI.

"Cześć. Mam na imię Ashley i jestem sztuczną inteligencją, która pomaga w kampanii Shamaine Daniels do Kongresu" – tak zaczynały się telefony. Nie były to nagrania. Ashley prowadziła prawdziwe rozmowy. Odpowiadała na pytania. Dostosowywała argumenty.

Problem w tym, że to działa. I to lepiej, niż ktokolwiek przewidywał.

Badacze z MIT przetestowali skuteczność AI w kampaniach wyborczych. Wyniki? Chatboty AI przekonują ludzi skuteczniej niż tradycyjne reklamy polityczne.

Nie chodzi tu o proste wiadomości masowe. Ashley to chatbot oparty na dużym modelu językowym (LLM – czyli tym samym "mózgu", który napędza ChatGPT). Potrafi prowadzić naturalną rozmowę. Słucha argumentów rozmówcy. Dostosowuje przekaz.

Dla porównania: tradycyjna reklama wyborcza to monolog. Ten sam spot dla wszystkich. Ta sama ulotka w każdej skrzynce. Ashley? Personalizuje każdą rozmowę.

I tu zaczyna się niekomfortowa część.

Ludzki wolontariusz dzwoni może przez 4 godziny dziennie. Męczy się. Gubi wątek. Ma gorszy dzień.

AI? Dzwoni 24/7. Każda rozmowa brzmi świeżo. Nigdy nie traci cierpliwości. Pamięta każdy szczegół z wcześniejszych interakcji.

Badania MIT pokazały coś jeszcze: ludzie częściej przyznają się AI do wątpliwości politycznych niż żywemu wolontariuszowi. Brak osądzenia. Brak presji społecznej. Tylko rozmowa.

Ashley nie ocenia. Nie wzdycha. Nie przerywa. Po prostu słucha i odpowiada.

Tradycyjna kampania segmentuje wyborców na grupy. Młodzi w mieście. Emeryci na wsi. Rodzice z przedmieściami. Każda grupa dostaje podobny przekaz.

AI idzie dalej. Każda rozmowa to osobny segment. Jeden wyborca martwi się edukacją – dostaje argumenty o szkołach. Drugi o bezpieczeństwie – słyszy o polityce kryminalnej. Trzeci o podatkach – rozmowa schodzi na gospodarkę.

To jak mieć tysiące doradców politycznych, z których każdy zna Twoje konkretne obawy. I wie, jak do Ciebie mówić.

Shamaine Daniels użyła tego w prawdziwej kampanii. W 2024 roku. Nie w jakimś futurystycznym eksperymencie.

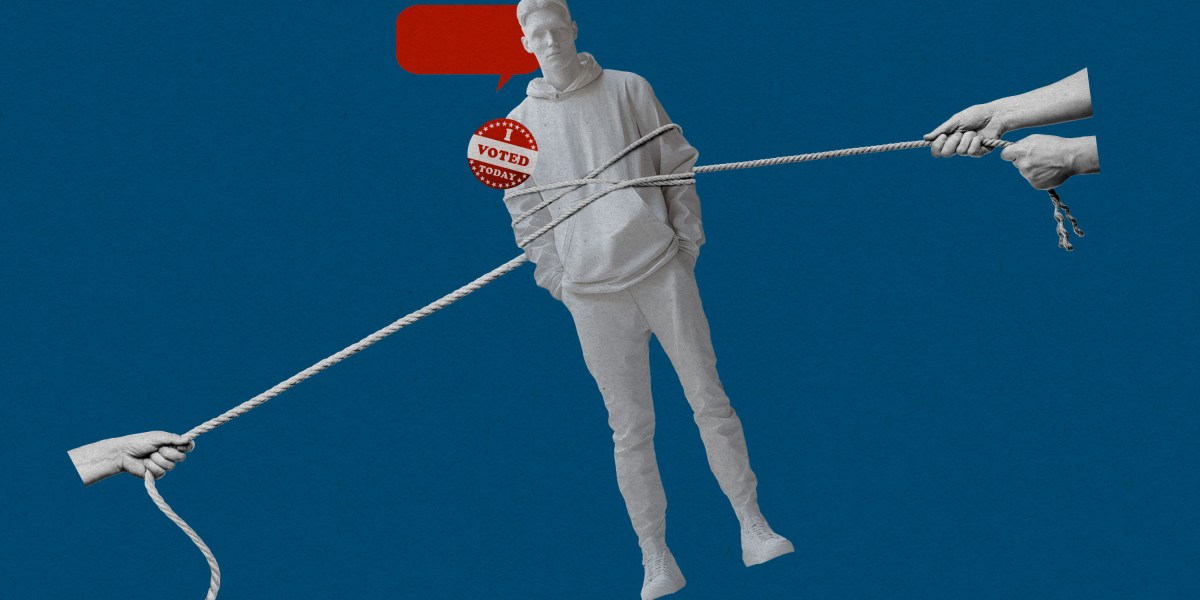

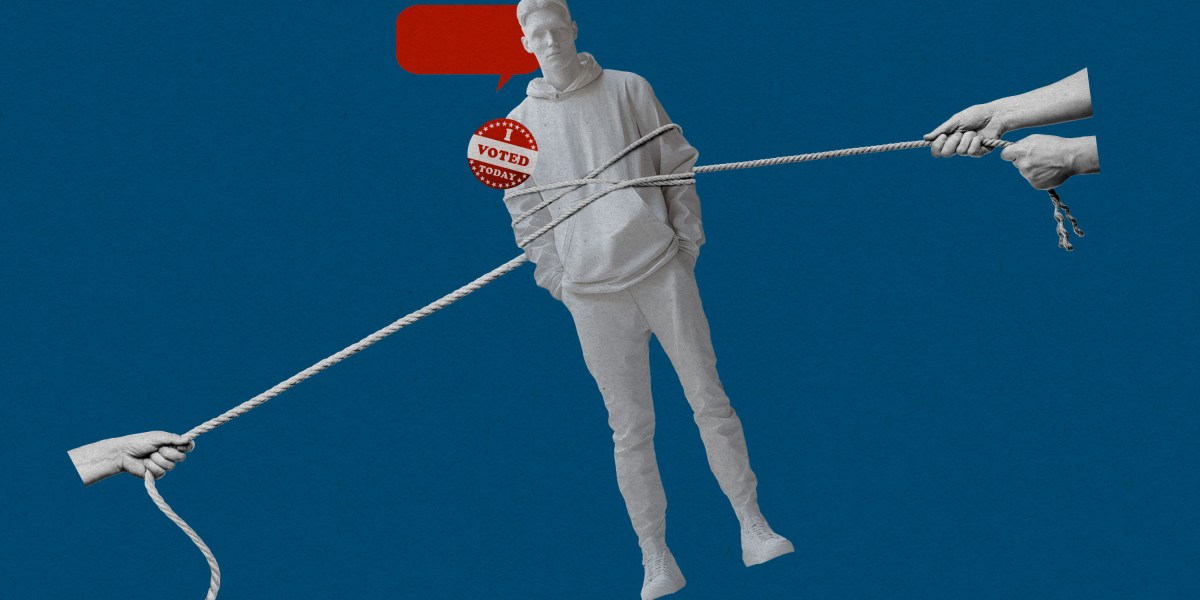

Każda kampania wyborcza próbuje przekonać wyborców. To oczywiste. Pytanie brzmi: gdzie jest granica?

Ludzki wolontariusz ma ograniczenia. Pamięć. Czas. Energię. AI nie ma żadnego z nich. Może prowadzić setki rozmów jednocześnie. Testować tysiące wariantów argumentów. Uczyć się, co działa na konkretne osobowości.

MIT Technology Review zwraca uwagę na coś niepokojącego: ta sama technologia, która pomaga kandydatom dotrzeć do wyborców, może być używana do dezinformacji. Do tworzenia fałszywych narracji. Do manipulacji na masową skalę.

Bo jeśli AI potrafi przekonać Cię do głosowania na konkretnego kandydata, potrafi też przekonać Cię do fałszywych informacji o jego rywalu.

Kampania Daniels to dopiero początek. Technologia staje się tańsza. Modele językowe – bardziej zaawansowane. Bariery wejścia spadają.

Za dwa lata, w kolejnych wyborach, chatboty AI mogą być standardem. Nie luksusem. Nie eksperymentem. Normalnym narzędziem kampanii.

Pytanie nie brzmi "czy AI zmieni kampanie wyborcze". Brzmi: "jak się przed tym bronić".

Bo Ashley przedstawiła się uczciwie. Powiedziała, że jest AI. Ale co, jeśli następny chatbot tego nie zrobi? Co, jeśli będzie udawał człowieka? Co, jeśli zamiast pomagać kandydatowi, będzie szerzyć kłamstwa o jego przeciwniku?

Prawo wyborcze w większości krajów nie przewiduje AI w kampaniach. Zasady dotyczą reklam telewizyjnych, plakatów, ulotek. Nikt nie pisał przepisów myśląc o chatbotach prowadzących tysiące rozmów jednocześnie.

Czy rozmowa z AI to reklama wyborcza? Czy wymaga oznaczenia "treść sponsorowana"? Czy można ją monitorować jak tradycyjne media.

Odpowiedzi nie ma. Technologia pognała do przodu. Prawo stoi w miejscu.

I to właśnie jest problem. Nie to, że AI może przekonywać wyborców. Ale to, że robi to w szarej strefie prawnej. Bez jasnych zasad. Bez nadzoru.

Jeśli odbierzesz telefon od chatbota w następnej kampanii wyborczej, pamiętaj jedno: ta rozmowa jest zaprojektowana, żeby Cię przekonać. Każde słowo. Każdy argument. Każda pauza.

Nie oznacza to, że kłamie. Ashley w kampanii Daniels mówiła prawdę. Ale mówiła ją w sposób maksymalnie przekonujący. Dostosowany do Ciebie. Do Twoich obaw. Do Twojego sposobu myślenia.

To nie jest neutralna informacja. To perswazja na sterydach.

I działa. Badania MIT to potwierdzają. Ludzie zmieniają zdanie po rozmowie z AI częściej niż po obejrzeniu reklamy czy przeczytaniu ulotki.

Więc tak – powinieneś być czujny. Nie paranoiczny. Czujny.

Kampania Daniels otworzyła puszkę Pandory. Inne sztaby już notują. Testują. Wdrażają.

Za rok, może dwa, rozmowa z AI przed wyborami będzie tak normalna jak plakat na przystanku. Pytanie nie brzmi "czy to się stanie". Tylko: "czy będziemy wiedzieć, kiedy to się dzieje".

Bo Ashley się przedstawiła. Następny chatbot może tego nie zrobić.

Przeczytaj też:

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar