DeepSeek V4 ma bilion parametrów. I natywną multimodalność

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

DeepSeek szykuje się do premiery V4. Według doniesień Tech in Asia, nowa wersja ma przynieść natywne wsparcie multimodalne - model będzie przetwarzał tekst, obrazy i wideo bez dodatkowych modułów. Część raportów sugeruje, że V4 może mieć około biliona parametrów.

Jeśli to prawda, mówimy o skoku z 671 miliardów parametrów w V3 do liczby, która plasuje DeepSeek w lidze największych modeli na świecie. Więcej parametrów nie zawsze oznacza lepszy model - sprawdzam, co faktycznie się zmienia.

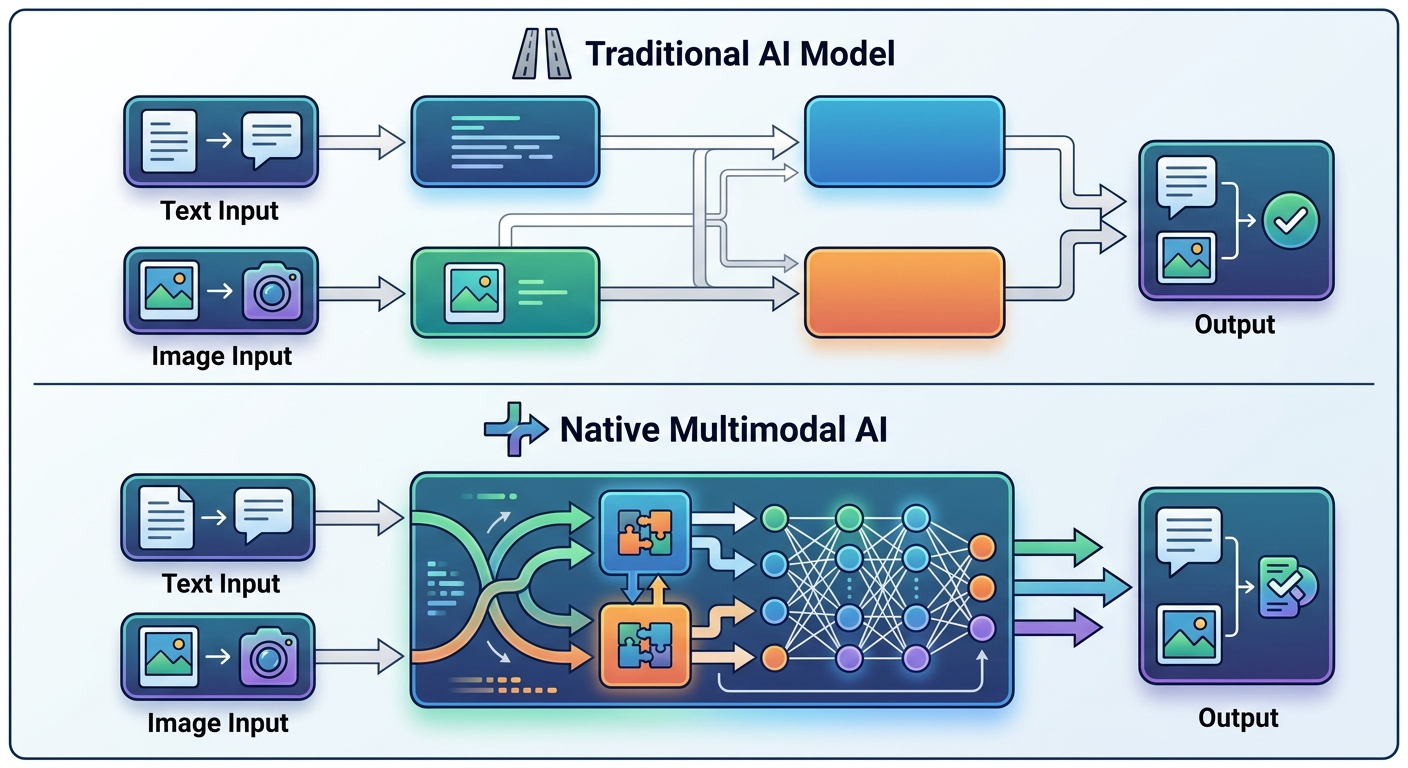

Większość dzisiejszych modeli AI działa tak: masz osobny model do tekstu, osobny do obrazów, a potem łączysz je przez dodatkowe warstwy. To działa, nie jest optymalne. Gemini pokazał, że natywne podejście daje lepsze wyniki w rozumieniu kontekstu między różnymi typami danych.

Natywna multimodalność oznacza, że model od początku trenowany jest na tekście, obrazach i wideo jednocześnie. Nie musi „tłumaczyć” obrazu na tekst, żeby go zrozumieć - po prostu rozumie obraz jako obraz. Różnica jak między osobą dwujęzyczną od dziecka a kimś, kto zawsze myśli w jednym języku i tłumaczy w głowie.

Jeśli pracujesz z danymi wizualnymi - analizujesz raporty, przetwarzasz screeny, wyciągasz informacje z infografik - natywna multimodalność daje lepsze wyniki. Model nie gubi kontekstu między tekstem a obrazem. Widzi całość, nie puzzle.

DeepSeek V4-Pro już pokazał, że chińskie modele doganiają zachodnich liderów w benchmarkach (dla aktualnych modeli standardem są SWE-bench Verified, Terminal-Bench i Aider Polyglot). Jeśli V4 rzeczywiście dostanie natywną multimodalność, to kolejny krok w tym kierunku.

Parametry to w uproszczeniu „pokrętła”, które model dostosowuje podczas treningu, żeby lepiej rozumieć dane. Więcej parametrów = więcej możliwości, także więcej kosztów i złożoności.

DeepSeek V4-Pro ma 671 miliardów parametrów. Jeśli V4 rzeczywiście skoczy do biliona, to skok o około 50%. Dla porównania: GPT-5 ma (według nieoficjalnych źródeł) około 1,76 biliona parametrów. Claude Sonnet 4.6 nie ujawnia liczby, szacunki mówią o podobnej skali.

Problem w tym, że liczba parametrów to nie wszystko. Anthropic pokazało, że architektura i sposób treningu mają większe znaczenie niż sama wielkość. DeepSeek słynie z efektywności - ich modele działają szybciej i taniej niż konkurencja o podobnej skali.

Większy model to wyższe koszty inference (przetwarzania zapytań). Jeśli DeepSeek utrzyma swoją filozofię niskokosztowych rozwiązań, V4 może być ciekawą alternatywą dla firm, które nie chcą płacić premium za GPT-5 czy Claude.

W Polsce i Europie to ma znaczenie. Regulacje RODO i AI Act sprawiają, że wiele firm szuka modeli, które można hostować lokalnie lub w europejskich chmurach. DeepSeek, mimo chińskiego pochodzenia, oferuje API dostępne globalnie - często taniej niż OpenAI.

DeepSeek to nie jedyny chiński gracz, jeden z najbardziej agresywnych. V3 pokazał, że mogą konkurować z OpenAI i Anthropic w benchmarkach. V4 z natywną multimodalnością to kolejny sygnał, że Chiny nie tylko doganiają - zaczynają dyktować tempo.

OpenAI walczy o korporacje, Anthropic stawia na bezpieczeństwo i transparentność, a DeepSeek - na efektywność i dostępność. Różne strategie, ten sam cel: dominacja w rynku AI.

Jeśli V4 rzeczywiście wyjdzie w tym tygodniu (jak sugerują niektóre źródła), zobaczymy szybko, czy bilion parametrów i natywna multimodalność to realna przewaga, czy tylko marketing. Benchmarki pokażą prawdę - szczególnie w zadaniach wymagających rozumienia kontekstu między tekstem a obrazem.

Dla polskich firm i użytkowników DeepSeek to ciekawa opcja - szczególnie jeśli V4 utrzyma niskie ceny API. Wybór modelu AI to dziś kwestia nie tylko możliwości, także kosztów i zgodności z regulacjami. DeepSeek nie ma polskiej wersji językowej, API działa globalnie i obsługuje polski przez tłumaczenie.

Problem? Brak lokalnych serwerów w UE i pytania o prywatność danych. Jeśli pracujesz z wrażliwymi informacjami, musisz to wziąć pod uwagę. AI Act wymaga od firm transparentności w kwestii przetwarzania danych - a chińskie modele nie zawsze to gwarantują.

Jeśli DeepSeek V4 faktycznie wystartuje w tym tygodniu, pierwsze testy pokażą, czy natywna multimodalność działa lepiej niż w konkurencji. Kluczowe będą zadania typu:

Jeśli V4 poradzi sobie z tym lepiej niż GPT-5 czy Claude Sonnet 4.6, to będzie realny konkurent. Jeśli nie - bilion parametrów pozostanie tylko liczbą w komunikacie prasowym.

Dobra, powiedzmy to wprost: nie chodzi o to, kto ma więcej parametrów. Chodzi o to, kto szybciej i taniej rozwiąże Twój problem. Jeśli DeepSeek V4 utrzyma efektywność V3 i doda natywną multimodalność, może być to model, który zmieni zasady gry w segmencie biznesowym - szczególnie dla firm szukających alternatywy dla drogich zachodnich rozwiązań.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar