Google testuje AI w nadprzewodnictwie. Wyniki zaskakują

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Co jeśli AI mogłoby odpowiadać na pytania z fizyki kwantowej równie sprawnie jak na pytania o przepis na naleśniki? Google Research właśnie to sprawdził – przetestował duże modele językowe na jednej z najbardziej wymagających dziedzin nauki: nadprzewodnictwie. Wyniki pokazują coś więcej niż tylko możliwości techniczne.

Zespół z Google postanowił przetestować LLM-y w terenie, gdzie nie wystarczy przetwarzanie języka naturalnego. Nadprzewodnictwo wymaga zrozumienia złożonych zjawisk kwantowych, matematyki na zaawansowanym poziomie i znajomości najnowszych publikacji naukowych. Jeśli AI poradzi sobie tutaj, może rzeczywiście stać się narzędziem dla naukowców – nie tylko copywriterów.

Google Research przygotował zestaw pytań z fizyki nadprzewodników – od podstawowych definicji po zaawansowane problemy badawcze. Pytania obejmowały teorię BCS (Bardeen-Cooper-Schrieffer), mechanizmy powstawania par Coopera, właściwości materiałów nadprzewodzących i najnowsze odkrycia w dziedzinie nadprzewodników wysokotemperaturowych.

Zespół nie ograniczył się do prostych pytań typu "co to jest nadprzewodnictwo". Zadawali pytania wymagające syntezy wiedzy z różnych obszarów, interpretacji danych eksperymentalnych i rozumowania na poziomie doktoranta fizyki. To test, który pokazuje, czy modele językowe potrafią coś więcej niż tylko składać zdania w logiczną całość.

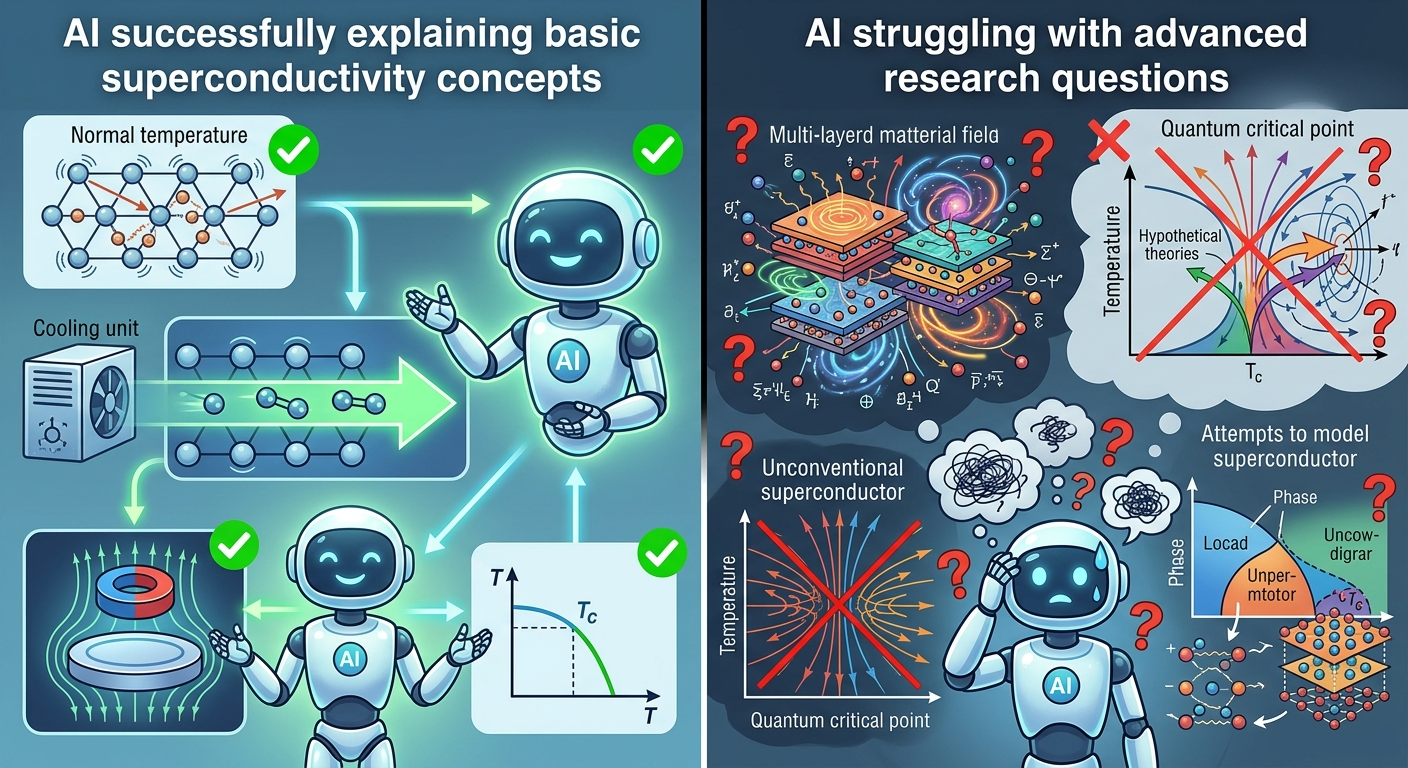

LLM-y zaskoczyły w obszarach podstawowej wiedzy teoretycznej. Pytania o mechanizmy nadprzewodnictwa, historię odkryć w tej dziedzinie czy właściwości klasycznych nadprzewodników – tutaj AI radziło sobie na poziomie porównywalnym z podręcznikiem akademickim. Modele potrafiły wyjaśnić zjawisko efektu Meissnera, opisać różnice między nadprzewodnikami typu I i II, a nawet przedstawić podstawy teorii BCS.

Dodatkowo AI pokazało umiejętność tłumaczenia skomplikowanych koncepcji prostszym językiem. Dla kogoś, kto uczy się fizyki lub potrzebuje szybkiego przypomnienia podstaw, to przydatne narzędzie – szybsze niż przeszukiwanie podręczników i bardziej interaktywne niż Wikipedia.

Problem pojawił się przy pytaniach o najnowsze badania i odkrycia z ostatnich lat. LLM-y miały trudności z interpretacją wyników eksperymentów opublikowanych po dacie ich treningu. Modele czasami generowały odpowiedzi, które brzmiały przekonująco, ale zawierały błędy merytoryczne – klasyczny problem halucynacji w AI.

Zespół Google zauważył też, że AI miało problem z pytaniami wymagającymi głębszego rozumowania przyczynowo-skutkowego. Pytania typu "dlaczego ten materiał wykazuje nadprzewodnictwo w tych warunkach, a nie w innych" często prowadziły do odpowiedzi powierzchownych lub zbyt ogólnych. To pokazuje różnicę między przetwarzaniem wzorców w danych a prawdziwym zrozumieniem fizyki.

Test Google pokazuje konkretny przypadek użycia AI w nauce – jako narzędzie wspierające, nie zastępujące. Student fizyki może użyć LLM-a do szybkiego sprawdzenia podstaw przed egzaminem. Naukowiec może wykorzystać AI do wygenerowania pierwszego draftu wyjaśnienia dla laika. To wartość, którą trudno przecenić (szczególnie jeśli kiedykolwiek próbowałeś wytłumaczyć mechanikę kwantową komuś spoza branży).

Zespół z Google sugeruje, że przyszłość leży w modelach specjalizowanych – wytrenowanych na literaturze naukowej z konkretnych dziedzin. Taki model mógłby mieć dostęp do najnowszych publikacji, rozumieć kontekst badań i wskazywać luki w wiedzy. To kierunek, który już widzimy w narzędziach takich jak Gemini Code Assist – tylko zamiast kodu, specjalizacja w fizyce, chemii czy biologii.

Wyniki testów Google pokazują coś ważnego: AI nie zastąpi naukowców, może za to zmienić sposób, w jaki pracują. Model językowy nie wymyśli nowej teorii nadprzewodnictwa, nie zaprojektuje eksperymentu i nie zinterpretuje nieoczekiwanych wyników. Może przyspieszyć dostęp do wiedzy, pomóc w edukacji i odciążyć naukowców od rutynowych zadań.

To podejście widać też w innych zastosowaniach AI w nauce. Google uczy AI przewidywać powodzie z artykułów prasowych, a Amazon wchodzi w zdrowie z AI – wszędzie tam AI jest narzędziem wspierającym ekspertów, nie ich zamiennikiem.

Kluczowa lekcja z testów Google? AI w nauce działa najlepiej, gdy traktujesz je jak asystenta badawczego – kogoś, kto zna podstawy, może szybko wyszukać informacje i pomóc w organizacji wiedzy. Nie kogoś, kto podejmuje decyzje badawcze czy weryfikuje hipotezy. Różnica jest subtelna, ale fundamentalna.

Za 12 miesięcy możemy zobaczyć modele językowe zintegrowane z bazami publikacji naukowych w czasie rzeczywistym. Naukowiec zadaje pytanie o najnowsze badania nad nadprzewodnikami – AI przeszukuje tysiące artykułów z ostatnich miesięcy, wyciąga kluczowe wnioski i wskazuje najbardziej obiecujące kierunki. To nie science fiction, to naturalna ewolucja narzędzi, które już istnieją.

Pytanie nie brzmi "czy AI będzie używane w nauce", tylko "jak szybko naukowcy nauczą się używać AI efektywnie". Test Google to pierwszy krok w tej edukacji – pokazanie, gdzie AI pomaga, a gdzie przeszkadza. Im więcej takich testów, tym lepiej rozumiemy granice i możliwości.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar