GPT4All zastąpił Ollama na Macu. Oto dlaczego

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Zastanawiasz się, czy warto uruchamiać AI lokalnie na swoim komputerze zamiast korzystać z ChatGPT w chmurze? Nie jesteś sam. Coraz więcej osób szuka sposobu na pracę z modelami językowymi bez wysyłania każdego zapytania na serwery OpenAI czy Anthropic.

Dobra, powiedzmy to wprost: jeśli zależy Ci na prywatności danych, lokalne modele to jedyna sensowna opcja. Nie chcesz, żeby każde Twoje pytanie do AI wędrowało przez czyjeś serwery. Problem? Do tej pory wymagało to albo zaawansowanej wiedzy technicznej, albo godzin walki z terminalem.

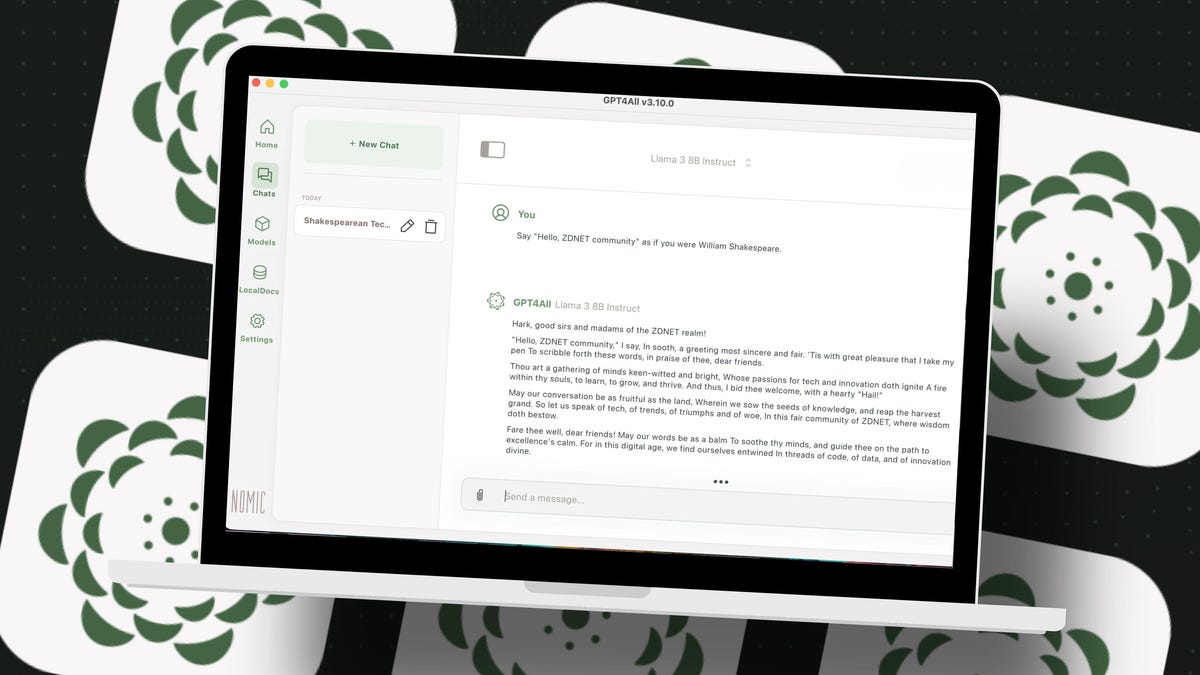

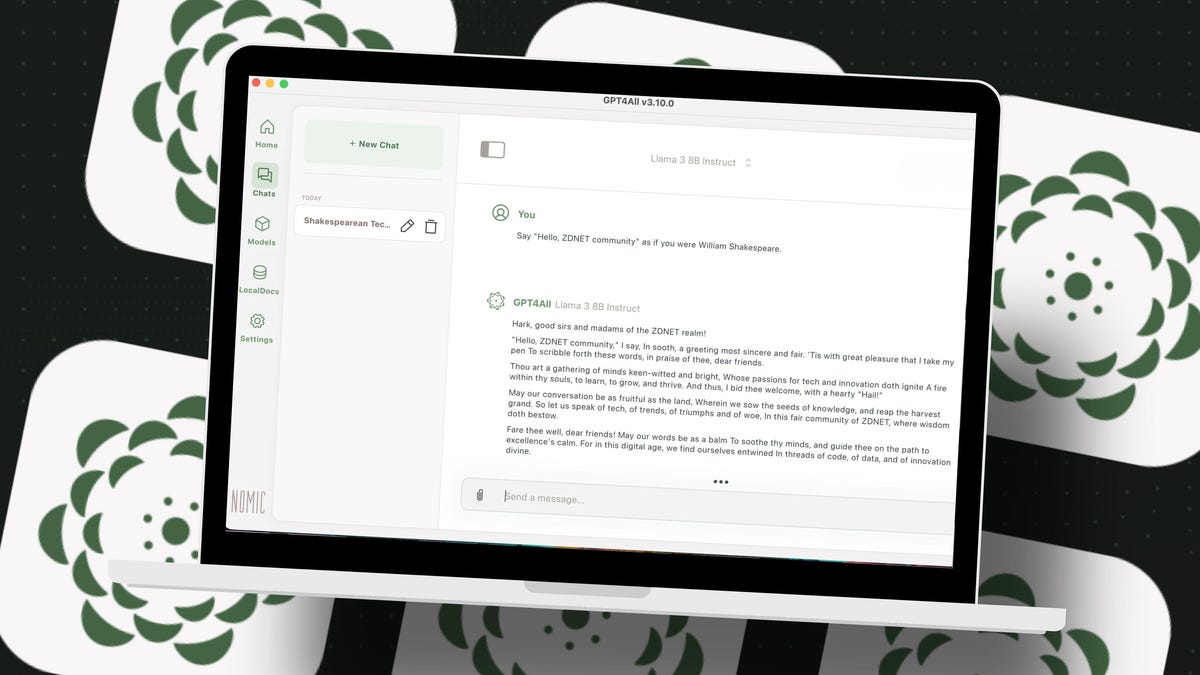

GPT4All zmienia tę grę. To darmowe, open-source'owe narzędzie, które pozwala uruchomić modele AI bezpośrednio na Twoim Macu. Z interfejsem graficznym. Bez linii komend. Bez wysyłania danych gdziekolwiek poza Twój komputer.

Ollama przez długi czas był standardem dla osób chcących uruchamiać modele AI lokalnie. Działa świetnie. Jest szybki. Obsługuje mnóstwo modeli. Jeden problem: wymaga obsługi przez terminal.

Dla programistów to żaden kłopot. Dla kogoś z marketingu, HR czy edukacji? Bariera wejścia jest realna.

GPT4All rozwiązuje ten problem fundamentalnie. Instalujesz aplikację jak każdą inną na Macu, otwierasz, wybierasz model z listy i zaczynasz rozmawiać. Żadnych komend. Żadnej konfiguracji. Żadnego googlowania "jak zainstalować Ollama na M2".

Interfejs przypomina ChatGPT – pole tekstowe, historia rozmów, przycisk wysyłania. Różnica? Wszystko dzieje się na Twoim dysku. Twoje zapytania o strategię marketingową, analizę konkurencji czy wrażliwe dane firmowe nie opuszczają komputera.

GPT4All obsługuje te same modele co Ollama: Llama 3.3, Mistral 7B, Phi-4, Gemma 2 i dziesiątki innych. Możesz pobrać kilka modeli jednocześnie i przełączać się między nimi w zależności od zadania. Mniejsze modele (3-7B parametrów) działają płynnie nawet na starszych Macach z 8GB RAM. Większe wymagają więcej zasobów, ale dają lepsze wyniki w złożonych zadaniach.

Kluczowa różnica wobec modeli w chmurze jak GPT-4o: lokalne modele są mniejsze i słabsze. Nie oczekuj poziomu Claude czy GPT-4. Oczekuj solidnej pomocy w pisaniu, analizie tekstu, burzy mózgów – bez wysyłania danych na zewnątrz.

Sprawdzam. Pobierasz plik DMG ze strony GPT4All. Przeciągasz ikonę do folderu Applications. Otwierasz. Przy pierwszym uruchomieniu aplikacja pyta, który model chcesz pobrać. Wybierasz jeden z listy (polecam zacząć od Llama 3.3 8B lub Mistral 7B), czekasz na pobranie i gotowe.

Cały proces – od kliknięcia "pobierz" do pierwszej rozmowy z AI – zajmuje mniej czasu niż założenie konta w ChatGPT Plus. Nie musisz instalować Pythona, Homebrew, ani żadnych zależności. Nie musisz otwierać terminala. Po prostu działa.

Dla porównania: instalacja Ollama wymaga terminala, zrozumienia jak działają komendy brew install, a potem uruchamiania modeli przez ollama run. To nie jest trudne dla kogoś z technicznym backgroundem. Dla reszty świata? GPT4All wygrywa bez walki.

Żadne Twoje dane nie opuszczają komputera. Żadne. GPT4All nie wymaga konta, nie loguje zapytań, nie wysyła telemetrii (chyba że wyraźnie włączysz tę opcję w ustawieniach). Model działa offline – możesz odłączyć internet i dalej rozmawiać z AI.

To ma znaczenie, jeśli pracujesz z wrażliwymi danymi: strategiami biznesowymi, danymi klientów, wewnętrznymi dokumentami. Podobnie jak rozwiązania dla regulowanych branż, lokalne AI daje Ci pełną kontrolę. Różnica? GPT4All jest darmowy i działa na Twoim laptopie.

Nie będę udawał, że GPT4All zastąpi Ci ChatGPT Plus czy Claude w każdym scenariuszu. Modele lokalne są słabsze. Nie poradzą sobie z bardzo złożonym rozumowaniem. Nie mają dostępu do internetu. Nie generują obrazków.

Mają sens, gdy:

Dla większości codziennych zadań – pisania emaili, poprawiania tekstów, burzy mózgów, analizy dokumentów – lokalne modele wystarczą. Nie będą tak błyskotliwe jak GPT-4. Zrobią robotę. I zrobią ją bez wysyłania Twoich danych do San Francisco.

GPT4All wykorzystuje akcelerację sprzętową na chipach M1/M2/M3. Modele 7B działają płynnie na Macach z 8GB RAM. Modele 13B wymagają 16GB. Większe modele (30B+) potrzebują 32GB lub więcej – szczerze mówiąc, dla większości zastosowań 7B wystarczy.

Szybkość generowania tekstu zależy od modelu i sprzętu. Na M2 Pro model Llama 3.3 8B generuje około 20-30 tokenów na sekundę. To wolniej niż GPT-4o w chmurze, ale wystarczająco szybko, żeby nie czuć opóźnień w rozmowie.

Pobierz GPT4All i przetestuj przez tydzień. Nie musisz rezygnować z ChatGPT czy Claude. Po prostu sprawdź, jak lokalne AI radzi sobie z Twoimi codziennymi zadaniami.

Zacznij od prostego modelu (Llama 3.3 8B lub Mistral 7B). Zadaj mu kilka pytań z Twojej branży. Poproś o pomoc w napisaniu emaila, analizę dokumentu, burzę mózgów. Zobacz, czy jakość odpowiedzi wystarcza do 80% Twoich potrzeb.

Jeśli tak – masz darmowe, prywatne AI bez subskrypcji i limitów. Jeśli nie – wracasz do chmury, ale przynajmniej wiesz, gdzie są granice lokalnych modeli. W obu przypadkach zyskujesz perspektywę, której nie dają Ci marketingowe materiały OpenAI.

GPT4All to nie rewolucja. To narzędzie, które robi jedną rzecz bardzo dobrze: daje dostęp do AI bez barier technicznych i bez wysyłania danych na zewnątrz. Dla wielu osób to wystarczający powód, żeby spróbować. Dla niektórych – powód, żeby zostać.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar