Jak duże modele językowe przechowują fakty – przewodnik

Źródło: Link

Źródło: Link

90 minut praktyki. Co tydzień na żywo.

Wpisujesz do ChatGPT: "Michael Jordan gra w..." i model bez wahania uzupełnia "koszykówkę". Skąd to wie? Gdzieś w setach miliardów parametrów musi być zapisana informacja o konkretnej osobie i konkretnym sporcie. Pytanie brzmi: gdzie dokładnie?

Grudniowe badania zespołu z Google DeepMind rzuciły światło na ten temat. Użyli dokładnie tego przykładu – dopasowywania sportowców do ich dyscyplin. Odkryli coś istotnego: fakty żyją w konkretnej części sieci zwanej multi-layer perceptrons (MLP). Brzmi technicznie? Zaraz rozbijemy to na czynniki pierwsze.

Zanim zrozumiesz, jak modele przechowują wiedzę, musisz wiedzieć, z czego składa się transformer – architektura stojąca za GPT-5, Claude czy Gemini. Każda warstwa transformera ma dwa główne elementy:

Attention to temat na osobny artykuł (możesz sprawdzić nasz przewodnik po architekturze AI). Dziś skupiamy się na MLP – bo to tam, według badaczy z DeepMind, leży wiedza o tym, że Jordan gra w koszykówkę, a nie w hokeja.

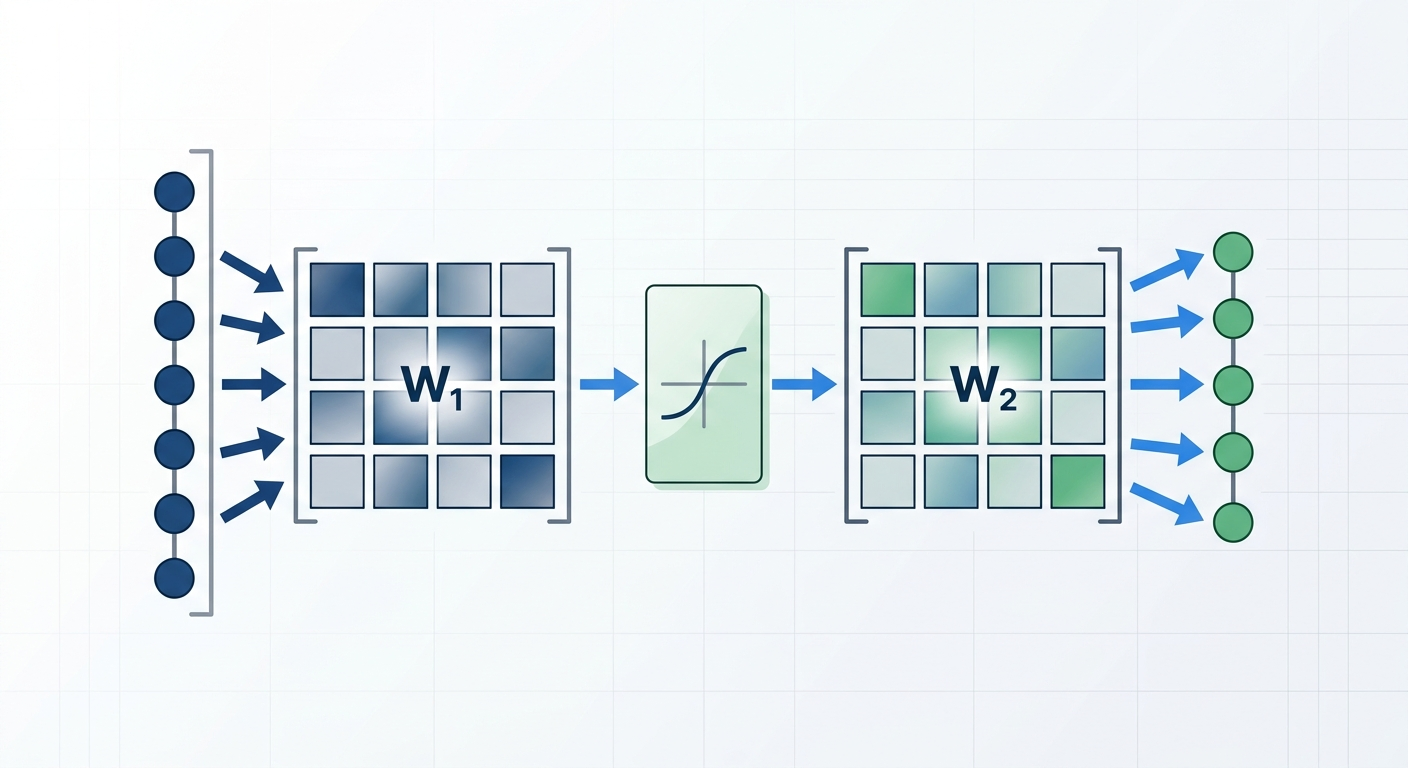

MLP to stosunkowo prosta struktura – zwłaszcza w porównaniu z attention. Sprowadza się do dwóch mnożeń macierzy:

Obliczeniowo to banalnie proste. Interpretacja? Tu zaczyna się problem. Co dokładnie dzieje się w tych macierzach? Jak sieć "zapisuje" fakt, że Michael Jordan to koszykarz?

Zespół z DeepMind nie zgadywał. Przeprowadzili serię eksperymentów na konkretnych przykładach – sportowcy i ich dyscypliny, stolice państw, znane osoby i ich zawody. Podawali modelowi zdanie z luką ("Michael Jordan gra w...") i śledzili, co się dzieje w poszczególnych warstwach sieci.

Najpierw wyłączali kolejne warstwy MLP i sprawdzali, czy model nadal potrafi uzupełnić brakujące słowo. Jeśli po wyłączeniu konkretnej warstwy model przestawał "wiedzieć", że Jordan gra w koszykówkę – znaczyło to, że ta warstwa przechowuje tę informację.

Następnie analizowali wagi w macierzach MLP. Okazało się, że pewne kombinacje neuronów aktywują się konsekwentnie, gdy model przetwarza fakt typu "osoba X → sport Y". Te wzorce aktywacji to właśnie zakodowana wiedza.

Najciekawszy test: spróbowali zmienić fakt w sieci. Zmodyfikowali wagi tak, żeby model "zapomniał", że Jordan gra w koszykówkę, i "nauczył się", że gra w hokeja. Zadziałało. Model zaczął konsekwentnie uzupełniać "hokej" zamiast "koszykówka".

To dowód, że fakty nie są rozproszone chaotycznie po całej sieci. Mieszkają w konkretnych miejscach – w określonych warstwach MLP.

Zrozumienie, jak duże modele językowe przechowują fakty, ma praktyczne konsekwencje:

Dla firm pracujących z AI to oznacza niższe koszty i większą kontrolę. Zamiast "czarnej skrzynki" masz narzędzie, które możesz precyzyjnie modyfikować.

Badania DeepMind to krok naprzód. Pełny obraz? Nadal nie mamy. Wciąż nie rozumiemy:

To otwarte pytania. Wiemy jednak wystarczająco dużo, żeby zacząć eksperymentować. Jeśli pracujesz z agentami AI lub budujesz własne modele, możesz wykorzystać tę wiedzę do precyzyjniejszego dostosowania narzędzi.

Nie musisz mieć doktoratu z deep learningu, żeby zobaczyć, jak to działa. Oto prosty eksperyment, który możesz przeprowadzić:

To nie jest naukowy eksperyment. Daje jednak intuicję: model nie generuje tekstu losowo. Ma wewnętrzną reprezentację wiedzy. I ta wiedza ma strukturę.

Zespoły z DeepMind, Anthropic i OpenAI kontynuują pracę nad mechanistyczną interpretowalnością – próbą zrozumienia, co dokładnie dzieje się w każdej warstwie sieci. To nie tylko akademicka ciekawostka. Jeśli zrozumiemy, jak modele przechowują wiedzę, będziemy mogli:

Za rok, dwa – możliwe, że będziemy mieli narzędzia pozwalające "edytować" fakty w modelach tak, jak dziś edytujesz tekst w Wordzie. To zmieni sposób, w jaki wdrażamy AI w firmach – zwłaszcza małych, które nie mają budżetu na trenowanie własnych modeli od zera.

Nie. Badania DeepMind skupiły się na prostych faktach typu "osoba → sport" czy "kraj → stolica". Bardziej złożona wiedza (np. zrozumienie kontekstu historycznego) prawdopodobnie jest rozproszona po całej sieci – zarówno w MLP, jak i w mechanizmach attention. Pełny obraz jeszcze nie istnieje.

Nie bezpośrednio. Modele komercyjne (GPT-5, Claude Opus 4.6) są zamknięte – nie masz dostępu do wag. Możesz użyć fine-tuningu (jeśli dostawca to umożliwia) albo pracować z otwartymi modelami typu Llama 4, gdzie masz pełną kontrolę nad parametrami.

Nie w ludzkim sensie. Model przechowuje reprezentację faktu jako wzorzec aktywacji neuronów. Nie ma świadomości, że "Michael Jordan to koszykarz". Ma tylko statystyczną korelację między tokenami "Michael Jordan" i "koszykówka". Różnica jest subtelna, ale kluczowa – zwłaszcza gdy model zaczyna halucynować.

W kursie "Praktyczna AI" na sukcesai.com omawiamy ten temat szczegółowo — z ćwiczeniami, przykładami i wsparciem. Zamiast zgadywać, naucz się AI krok po kroku.

Sprawdź kurs →Fakty w dużych modelach językowych nie są magią. Leżą w konkretnych warstwach MLP, jako wzorce aktywacji neuronów. Możemy je identyfikować, modyfikować i – w przyszłości – precyzyjnie edytować bez ponownego treningu całej sieci.

To zmienia sposób, w jaki myślimy o AI. Zamiast "czarnej skrzynki" mamy narzędzie, które powoli staje się transparentne. I to otwiera drzwi do praktycznych zastosowań – od fine-tuningu po eliminację halucynacji.

Następnym razem, gdy model da Ci dziwną odpowiedź, zapytaj go o źródło. Obserwuj, jak uzasadnia swoją odpowiedź. To da Ci intuicję, kiedy model "wie", a kiedy zgaduje. I to już połowa sukcesu w pracy z AI.

Na podstawie: 3Blue1Brown – How might LLMs store facts

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar