Jak wykorzystać szybkie tokenizery AI – przewodnik praktyczny

Źródło: Link

Źródło: Link

90 minut praktyki. Co tydzień na żywo.

Większość osób używających ChatGPT czy Claude nie ma pojęcia, że zanim ich pytanie trafi do modelu AI, przechodzi przez tokenizer. To jak tłumacz, który przekłada Twoje słowa na język zrozumiały dla sztucznej inteligencji. Standardowe tokenizery potrafią być wolne jak poczta ślimakowa. Dlatego powstały szybkie tokenizery – i różnica jest jak między pieszo a samochodem.

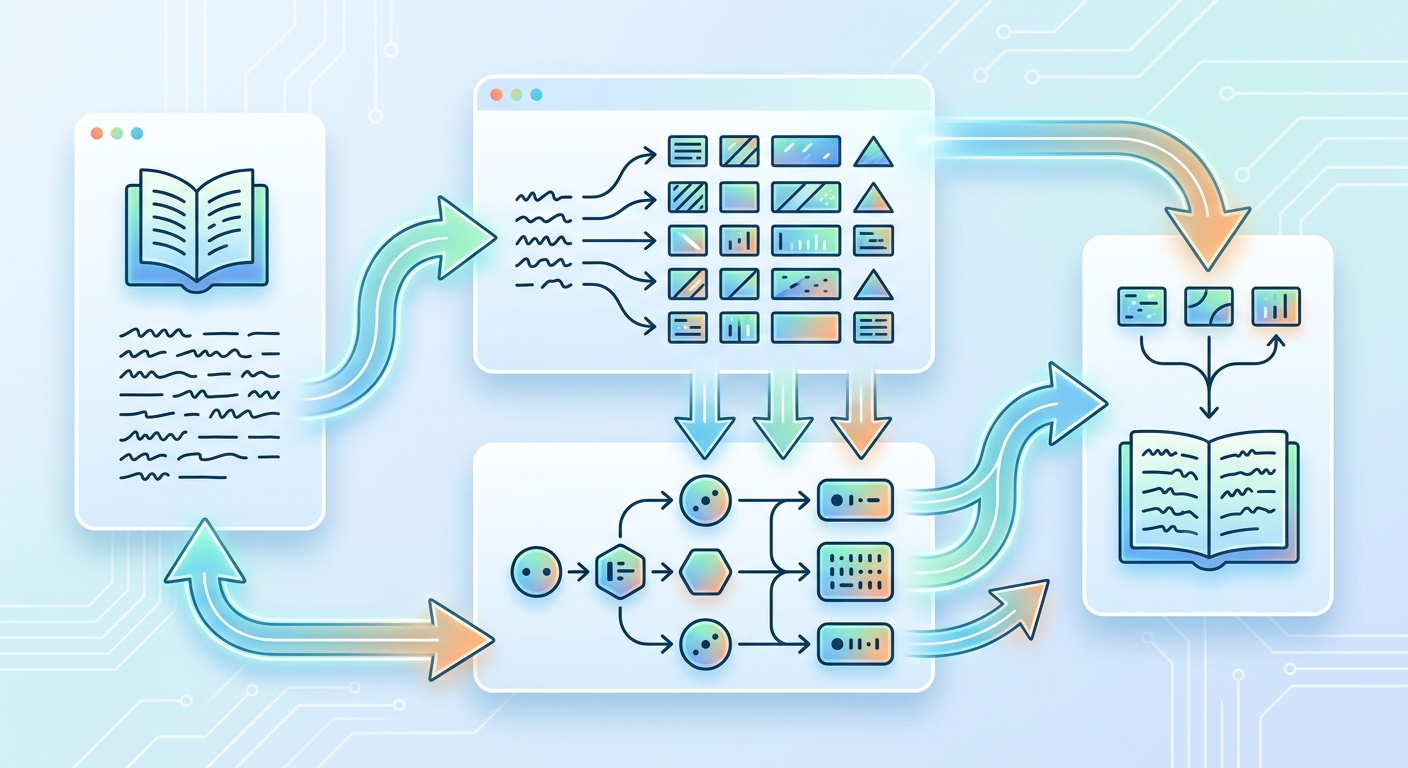

Tokenizer to narzędzie, które rozbija tekst na mniejsze kawałki zwane tokenami. Model AI nie rozumie słów tak jak Ty – potrzebuje ich numerycznej reprezentacji. Tokenizer bierze Twoje zdanie „Jak działa AI?” i przekształca je w ciąg liczb, z którymi model może pracować.

Przykład? Słowo „tokenizacja” może zostać podzielone na tokeny: „token”, „iz”, „acja”. Każdy z nich dostaje unikalny numer. Model przetwarza te liczby, generuje odpowiedź w postaci kolejnych liczb, a tokenizer przekłada je z powrotem na tekst, który widzisz na ekranie.

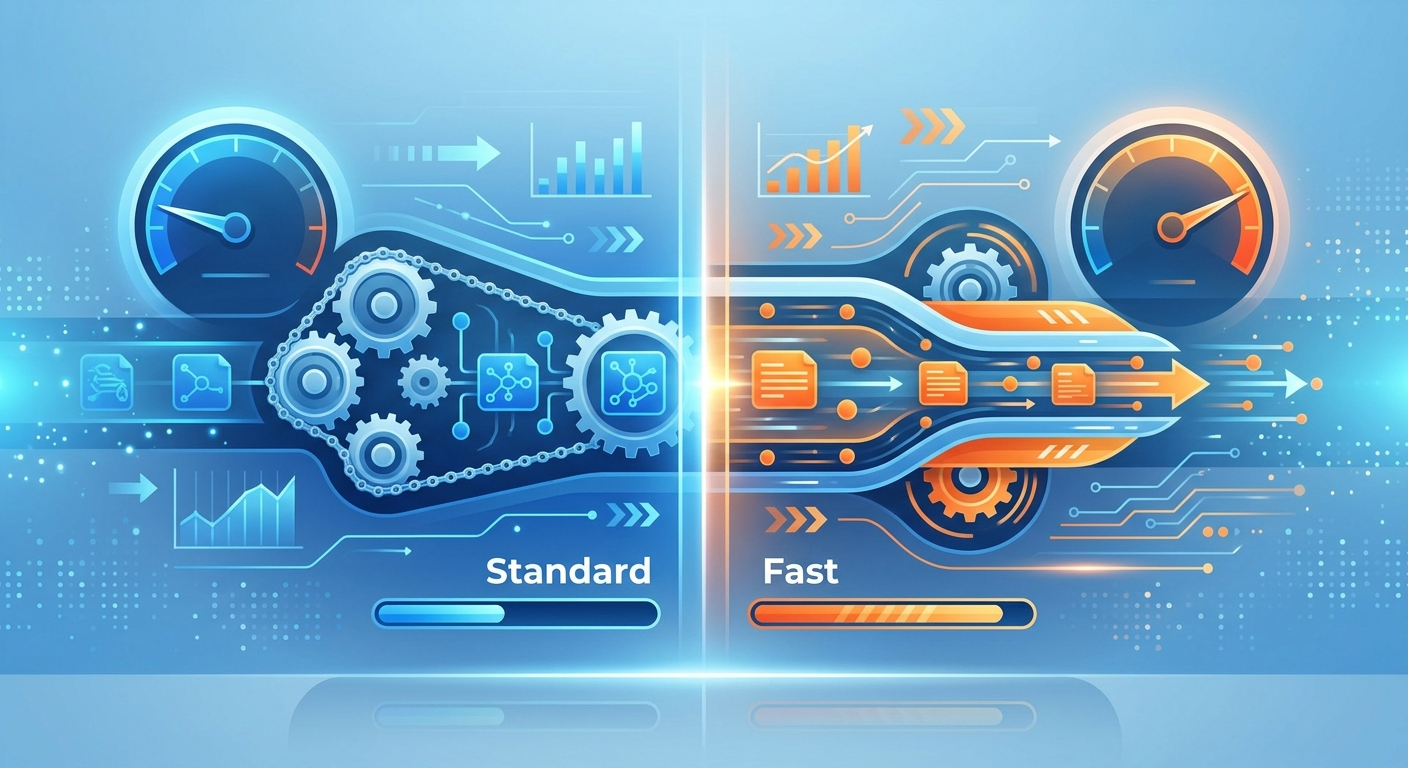

Standardowe tokenizery napisane w czystym Pythonie działają poprawnie, ale wolno. Kiedy przetwarzasz pojedyncze zapytanie, różnica jest niezauważalna. Kiedy analizujesz tysiące dokumentów w systemie RAG albo treningujesz model – każda sekunda się liczy.

Szybkie tokenizery (Fast Tokenizers) to implementacje napisane w Rust – języku programowania znanym z wydajności i bezpieczeństwa. Biblioteka Hugging Face Tokenizers oferuje właśnie takie rozwiązanie, które może przyśpieszyć przetwarzanie tekstu nawet 10-krotnie w porównaniu do standardowych implementacji Pythonowych.

Kluczowe różnice:

Standardowy tokenizer mówi Ci: „Oto tokeny”. Szybki tokenizer mówi: „Oto tokeny ORAZ dokładne pozycje, skąd pochodzą w oryginalnym tekście”.

To różnica między „Znalazłem słowo 'AI' w dokumencie” a „Znalazłem słowo 'AI' w dokumencie, dokładnie w znakach 47-49”. Druga opcja pozwala na precyzyjne wyodrębnianie fragmentów, co jest niezbędne w zadaniach takich jak rozpoznawanie nazwanych encji (NER) czy odpowiadanie na pytania.

Nie każdy projekt potrzebuje szybkich tokenizerów. Jeśli wysyłasz 5 zapytań dziennie do ChatGPT, różnica będzie niezauważalna. Są jednak sytuacje, gdzie to konieczność:

Analizujesz 100 000 recenzji produktów? Standardowy tokenizer może potrzebować godzin. Szybki tokenizer wykona to samo zadanie w kilkanaście minut. Różnica między zakończeniem analizy przed lunchem a czekaniem do końca dnia.

Chatboty obsługujące setki użytkowników jednocześnie, asystenci wirtualni w aplikacjach mobilnych, systemy moderacji treści – wszędzie tam, gdzie opóźnienie przekłada się na doświadczenie użytkownika, szybkie tokenizery są standardem.

Podczas dostosowywania modeli AI tokenizacja dzieje się miliony razy. Przyśpieszenie tego procesu o 10x oznacza oszczędność czasu i pieniędzy na infrastrukturze chmurowej.

Systemy RAG (Retrieval-Augmented Generation) muszą szybko przeszukiwać i tokenizować dokumenty, aby znaleźć odpowiednie fragmenty. Im szybszy tokenizer, tym krótszy czas odpowiedzi całego systemu.

Dobra wiadomość: jeśli korzystasz z biblioteki Transformers od Hugging Face, prawdopodobnie już masz dostęp do szybkich tokenizerów. Większość popularnych modeli (BERT, GPT-2, RoBERTa) ma wersje Fast dostępne od razu.

Potrzebujesz:

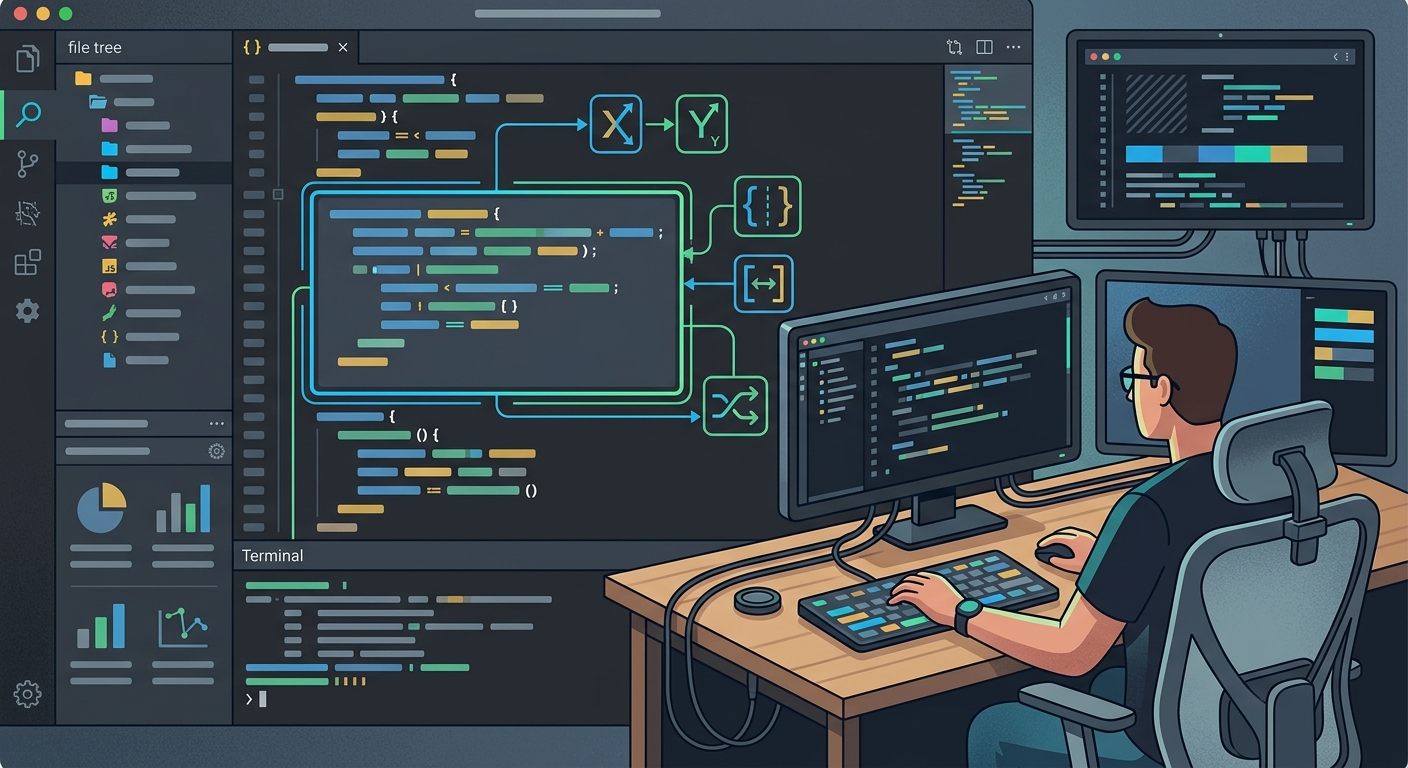

transformers zainstalowana (pip install transformers)Otwierasz terminal i wpisujesz:

from transformers import AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("bert-base-uncased")

print(tokenizer.is_fast)Jeśli zwróci True – gratulacje, masz szybki tokenizer. Jeśli False – sprawdź, czy istnieje wersja Fast dla Twojego modelu.

To funkcja, której nie ma w standardowych tokenizerach. Pozwala precyzyjnie mapować tokeny na oryginalne pozycje w tekście:

text = "Szybkie tokenizery AI zmieniają zasady gry"

encoding = tokenizer(text, return_offsets_mapping=True)

for token_id, (start, end) in zip(encoding['input_ids'], encoding['offset_mapping']):

print(f"Token: {tokenizer.decode([token_id])} → Pozycja: {text[start:end]}")To daje Ci dokładną kontrolę nad tym, skąd pochodzi każdy token – nieocenione w zadaniach NLP.

Zamiast tokenizować teksty pojedynczo, przetwarzaj je grupami:

texts = ["Pierwszy tekst", "Drugi tekst", "Trzeci tekst"]

encodings = tokenizer(texts, padding=True, truncation=True, return_tensors="pt")Szybkie tokenizery wykorzystają wielowątkowość i przetworzą wszystkie teksty równolegle. Różnica w wydajności rośnie wraz z liczbą tekstów.

Jeśli dostosujesz tokenizer do swoich potrzeb (np. dodasz specjalne tokeny), zapisz go:

tokenizer.save_pretrained("./moj_tokenizer")

# Później wczytujesz:

tokenizer = AutoTokenizer.from_pretrained("./moj_tokenizer")Szybkie tokenizery zachowują wszystkie ustawienia i optymalizacje.

Szybkie tokenizery nie są idealnym rozwiązaniem w każdej sytuacji. Oto co może pójść nie tak:

Niektóre starsze modele nie mają wersji Fast. Jeśli pracujesz z niszowym modelem sprzed kilku lat, możesz być zmuszony do użycia standardowego tokenizera.

Szybkie tokenizery ładują dodatkowe struktury danych do pamięci, aby przyśpieszyć przetwarzanie. Na serwerach produkcyjnych to nie problem, ale na urządzeniach z ograniczoną pamięcią (np. Raspberry Pi) może być wyzwaniem.

Kod w Rust jest szybszy, ale mniej przejrzysty dla osoby znającej tylko Pythona. Jeśli napotkasz błąd głęboko w implementacji tokenizera, naprawa może wymagać znajomości Rusta.

Firma zajmująca się analizą sentymentu w mediach społecznościowych przetwarzała 500 000 tweetów dziennie. Standardowy tokenizer potrzebował 4 godzin. Po przejściu na szybki tokenizer – 25 minut. To pozwoliło im dostarczać raporty klientom w czasie rzeczywistym, zamiast z opóźnieniem.

Inny przykład: startup budujący asystenta do analizy dokumentów PDF dla prawników. Szybkie tokenizery pozwoliły im przetwarzać 100-stronicowe umowy w sekundach, zamiast minut. Klienci zauważyli różnicę natychmiast.

Jeśli Twoja praca z AI ogranicza się do kilku zapytań dziennie w interfejsie webowym – nie, nie musisz się tym przejmować. ChatGPT i Claude już używają zoptymalizowanych tokenizerów pod maską.

Jeśli jednak:

...to szybkie tokenizery to nie opcja, a konieczność. Różnica między amatorskim projektem a profesjonalnym produktem często leży w takich detalach.

Tokenizery to fundament każdego systemu AI przetwarzającego tekst. Większość osób nigdy nie musi o nich myśleć – do momentu, gdy wydajność zaczyna mieć znaczenie. Wtedy znajomość szybkich tokenizerów staje się przewagą konkurencyjną.

W kursie "Praktyczna AI" na sukcesai.com omawiamy ten temat szczegółowo — z ćwiczeniami, przykładami i wsparciem. Zamiast zgadywać, naucz się AI krok po kroku.

Sprawdź kurs →Szybkie tokenizery to implementacje w Rust, które przyśpieszają przetwarzanie tekstu nawet 10-krotnie. Oferują dodatkowe funkcje jak offset mapping, które są niezbędne w zaawansowanych zadaniach NLP. Większość popularnych modeli w Hugging Face ma już wersje Fast dostępne od razu.

Nie każdy projekt ich potrzebuje. Jeśli jednak przetwarzasz duże ilości tekstu, budujesz systemy czasu rzeczywistego lub optymalizujesz koszty – to inwestycja, która się zwraca.

Otwórz terminal i sprawdź, czy tokenizer, którego używasz, jest szybki. Jeśli nie – zamień go na wersję Fast. To dosłownie jedna linijka kodu, a może zaoszczędzić Ci godzin przetwarzania.

Nie wszystkie modele mają wersje Fast. Większość popularnych architektur (BERT, GPT-2, RoBERTa, DistilBERT) ma implementacje szybkich tokenizerów w bibliotece Hugging Face. Starsze lub niszowe modele mogą nie mieć wsparcia. Sprawdź dokumentację konkretnego modelu przed użyciem.

W większości przypadków nie. Jeśli używasz AutoTokenizer.from_pretrained(), biblioteka automatycznie załaduje wersję Fast, jeśli jest dostępna. API pozostaje takie samo – Twój kod będzie działał bez modyfikacji, tylko szybciej.

Tak, biblioteka Hugging Face Tokenizers jest open-source i dostępna za darmo. Możesz używać jej w projektach komercyjnych bez opłat licencyjnych. Jedyne koszty to infrastruktura, na której uruchamiasz kod.

Na podstawie: Materiały kursu AI Evolution

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar