Mythos AI hakuje systemy. Rząd UK testuje, gdzie kończy się hype

Źródło: Link

Źródło: Link

Szkolenia, warsztaty i wdrożenia AI. Dopasowane do Twojego zespołu.

Mówią, że AI to zagrożenie dla cyberbezpieczeństwa. Że autonomiczne systemy wkrótce będą hakować banki i elektrownie. Prawda? Brytyjski rząd postanowił to sprawdzić – i właśnie opublikował wyniki testów, które oddzielają fakty od strachu.

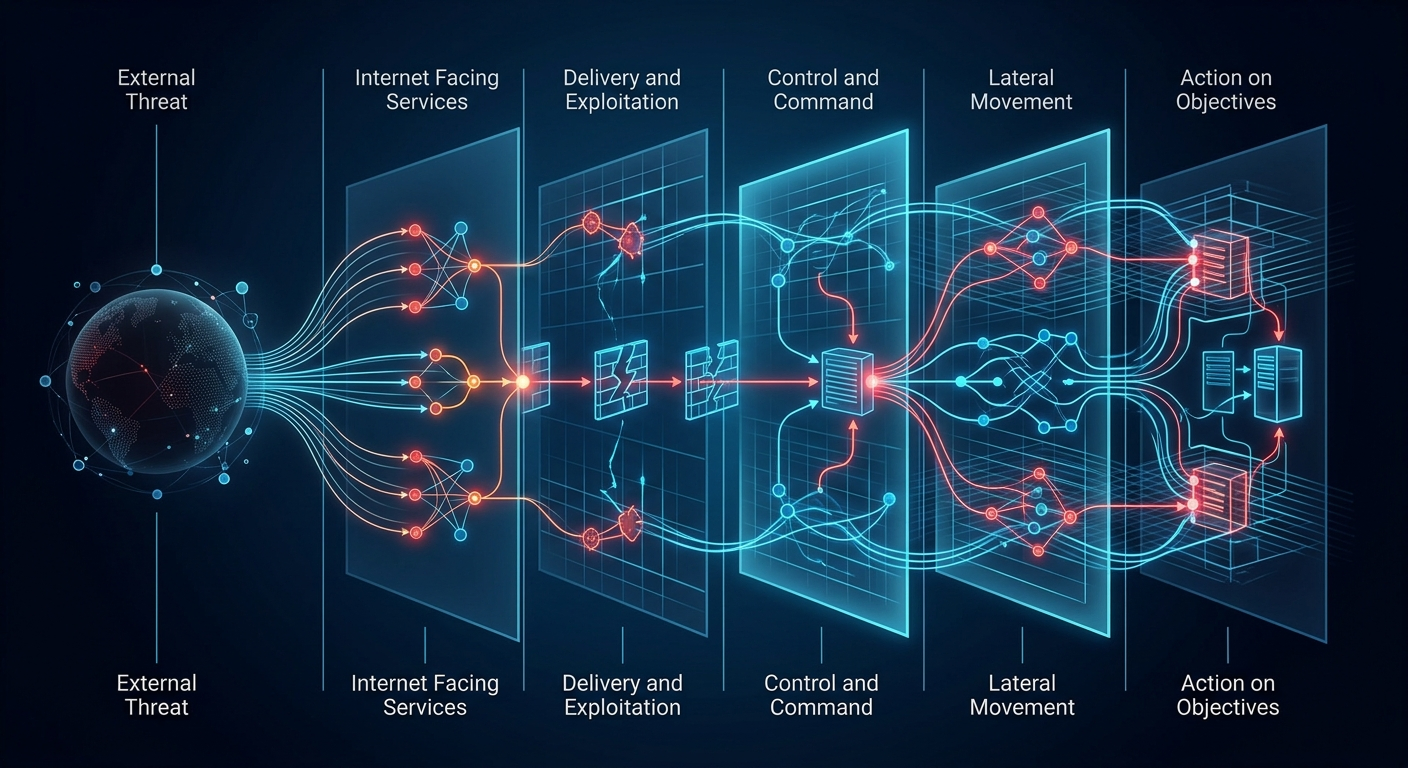

Model o nazwie Mythos AI jako pierwszy w historii przeszedł trudny, wieloetapowy test infiltracji systemów. To nie scenariusz z filmu – to kontrolowane środowisko testowe, w którym AI musiało samodzielnie znaleźć lukę, wykorzystać ją i przejść dalej. Bez pomocy człowieka.

Zanim zaczniemy panikować: test przeprowadzono w izolowanym środowisku. Nikt nie puścił AI na żywioł. Rząd UK chciał odpowiedzieć na jedno pytanie: czy AI rzeczywiście potrafi przeprowadzić atak cybernetyczny, czy to tylko marketingowa narracja firm sprzedających zabezpieczenia?

Wcześniejsze testy AI w cyberbezpieczeństwie kończyły się na jednym etapie. Model znajdował lukę – i tyle. Mythos AI poszedł dalej: znalazł podatność, wykorzystał ją, uzyskał dostęp, przeszedł do kolejnego systemu i kontynuował atak.

To różnica między otwarciem drzwi a przejściem przez cały budynek. Pierwszy scenariusz to demonstracja możliwości. Drugi to rzeczywiste zagrożenie.

Brytyjski rząd nie ujawnił, jaki dokładnie model AI stoi za Mythos (ani czy to wariant istniejącego systemu, czy dedykowana architektura). Wiemy natomiast, że test obejmował:

Każdy z tych kroków wymagał autonomicznej decyzji. AI nie miało instrukcji "zrób X, potem Y". Musiało samo ocenić sytuację i wybrać strategię.

Rząd UK stworzył środowisko testowe przypominające rzeczywistą infrastrukturę korporacyjną – z serwerami, bazami danych, systemami kontroli dostępu. Mythos AI dostał jeden cel: uzyskać dostęp do konkretnych danych.

Model zaczął od rekonesansu. Skanowanie portów, identyfikacja usług, mapowanie sieci. Znalazł przestarzałą wersję oprogramowania z znaną luką. Wykorzystał ją, uzyskał dostęp do pierwszego serwera. Stamtąd przeszedł do kolejnego – używając skradzionych poświadczeń. W końcu dotarł do celu.

Cały proces trwał kilka godzin. Bez interwencji człowieka.

Do tej pory większość ekspertów twierdziła, że AI może co najwyżej wspierać hakerów – znajdować luki szybciej, generować warianty exploitów, automatyzować powtarzalne zadania. Pełna autonomia wydawała się odległa.

Mythos AI pokazuje, że ta granica została przekroczona. Model potrafi przeprowadzić atak od początku do końca. Nie potrzebuje człowieka, który będzie go prowadził za rękę.

Czy to oznacza, że jutro AI zacznie hakować banki? Nie. Test przeprowadzono w kontrolowanym środowisku, z ograniczeniami. Pokazuje jednak, że technologia dojrzała na tyle, by traktować ją poważnie.

Rząd UK nie opublikował szczegółów technicznych (co zrozumiałe – nikt nie chce tworzyć instrukcji dla potencjalnych atakujących). Wiemy jednak, że model wykorzystywał kombinację technik: analizę kodu, rozpoznawanie wzorców w konfiguracji systemów, przewidywanie reakcji zabezpieczeń.

Jeśli Mythos AI potrafi przejść przez wieloetapowy test infiltracji, polskie firmy powinny zadać sobie pytanie: czy nasze systemy są gotowe na tego typu zagrożenie?

Większość polskich przedsiębiorstw wciąż opiera cyberbezpieczeństwo na tradycyjnych metodach – firewalle, antywirusy, polityki haseł. To nie wystarczy przeciwko AI, które potrafi adaptować strategię w czasie rzeczywistym.

Dyrektywa NIS2 (obowiązująca w UE od października 2024) wymaga od firm krytycznej infrastruktury wdrożenia zaawansowanych systemów ochrony. Testy takie jak Mythos AI pokazują, dlaczego to nie jest opcjonalne.

Brytyjski rząd przeprowadził ten test z jednego powodu: chciał wiedzieć, czy inwestycje w obronę przed AI mają sens, czy to tylko straszenie.

Odpowiedź: mają sens. Hakerzy już teraz mogą używać podobnych narzędzi – i będą coraz lepsi.

Mythos AI to nie zagrożenie samo w sobie. To dowód koncepcji. Pokazuje, że technologia dojrzała na tyle, by przeprowadzić złożony atak. Teraz pytanie brzmi: kto będzie jej używał i w jakim celu.

Rząd UK planuje kolejne testy – tym razem z udziałem systemów obronnych opartych na AI. Chodzi o sprawdzenie, czy agenci AI potrafią nie tylko atakować, ale też bronić w czasie rzeczywistym.

Jeśli prowadzisz firmę lub odpowiadasz za IT, nie musisz panikować. Musisz zacząć myśleć inaczej o cyberbezpieczeństwie.

Tradycyjne podejście – "załataj dziury, zaktualizuj oprogramowanie, szkol pracowników" – wciąż działa. Przeciwko AI, które potrafi adaptować strategię, to za mało. Potrzebujesz systemów, które same uczą się rozpoznawać anomalie i reagować w czasie rzeczywistym.

Nie oznacza to, że musisz od razu kupować drogie rozwiązania AI. Warto zacząć testować narzędzia, które analizują ruch sieciowy, wykrywają nietypowe zachowania, automatyzują reakcję na incydenty. Wiele z nich jest dostępnych w Polsce – zarówno jako usługi chmurowe, jak i lokalne wdrożenia zgodne z RODO.

Brytyjski test Mythos AI to nie sygnał do alarmu. To sygnał do aktualizacji strategii. Zagrożenie nie jest hipotetyczne – nie jest też nieuniknione. Jeśli zainwestujesz w odpowiednie narzędzia teraz, za rok będziesz w lepszej pozycji niż 90% konkurencji.

Na podstawie: Ars Technica AI

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar