AI splagiatowała badania. Narzędzia nie wykryły – aż autorka poznała swoją pracę

Źródło: Link

Źródło: Link

Szkolenia, warsztaty i wdrożenia AI. Dopasowane do Twojego zespołu.

Dostajesz do recenzji artykuł naukowy. Czytasz. Coś Ci świta. Sprawdzasz dokładniej.

I nagle widzisz: to Twoja własna praca. Tylko przepisana przez AI.

A systemy antyplagiatowe? Nic nie wykryły. To nie scenariusz z przyszłości – to właśnie się stało. I pokazuje, jak bardzo obecne narzędzia do wykrywania AI są bezużyteczne, gdy naprawdę ich potrzebujemy.

Badaczka otrzymała do recenzji artykuł, który miał zostać opublikowany w czasopiśmie naukowym. Podczas lektury zauważyła znajome sformułowania. Nie były to dosłowne cytaty – tekst był przeformułowany, struktura zmieniona.

Argumentacja? Identyczna. Kolejność myśli? Ta sama. Nawet specyficzne przykłady – wszystko pochodziło z jej wcześniejszej publikacji.

Ktoś najwyraźniej wrzucił jej pracę do modelu AI z promptem w stylu "przepisz to innymi słowami". I zadziałało.

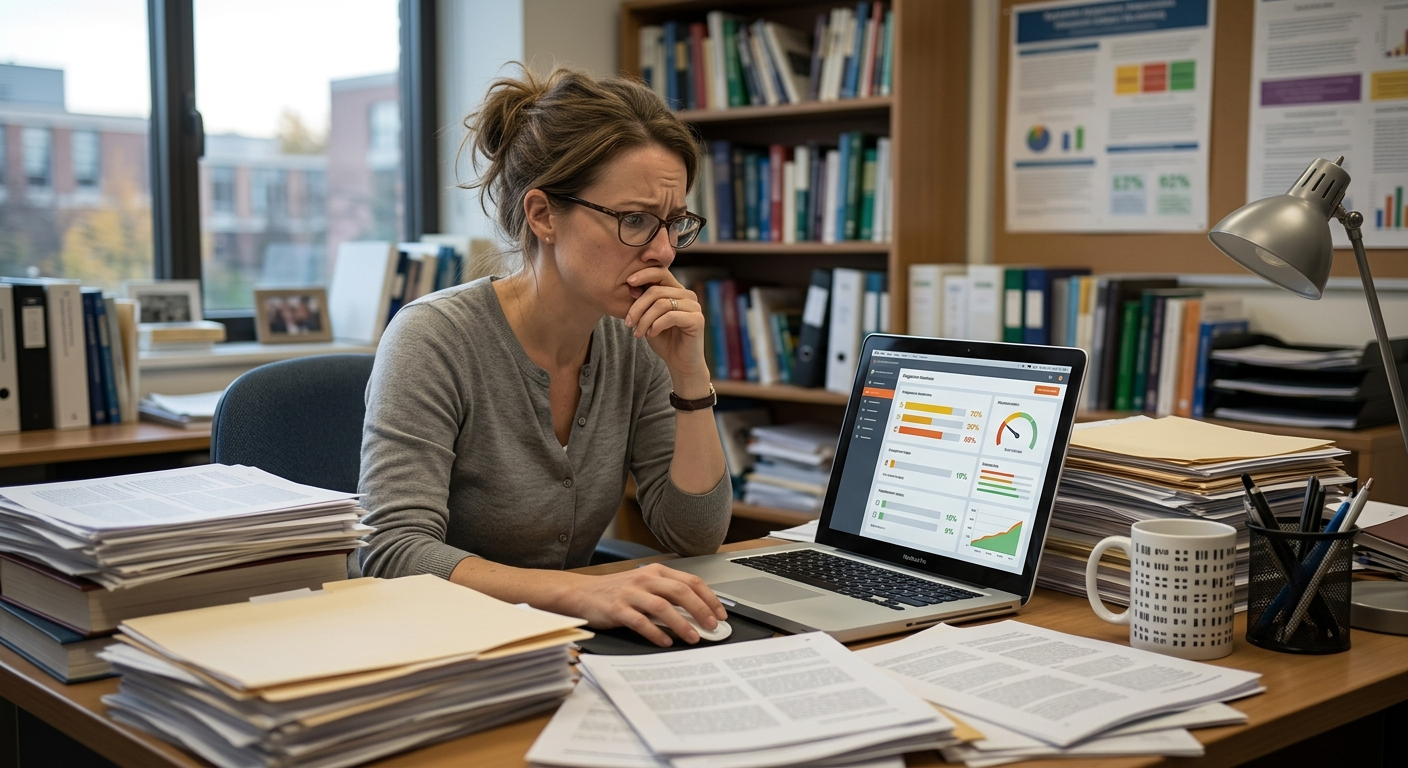

Co gorsza: artykuł przeszedł przez standardowe narzędzia antyplagiatowe. Nie wykryły podobieństwa, bo AI zmieniła wystarczająco dużo słów. Przeszedł też przez detektory AI – bo współczesne modele językowe potrafią pisać w sposób, który wygląda "wystarczająco ludzko".

Gdyby autorka przypadkiem nie trafiła na recenzję własnej pracy, plagiat zostałby opublikowany. I nikt by nie zauważył.

Narzędzia do wykrywania treści generowanych przez AI – takie jak GPTZero, Turnitin AI Detection czy Originality.ai – działają na zasadzie analizy statystycznej. Sprawdzają, czy tekst ma cechy typowe dla modeli językowych: przewidywalną strukturę zdań, powtarzalne wzorce, brak "ludzkich" błędów.

Problem? Modele AI w 2026 roku są na tyle dobre, że potrafią naśladować naturalne niedoskonałości ludzkiego pisania. A jeśli ktoś dodatkowo ręcznie edytuje wygenerowany tekst – dodaje kilka własnych zdań, zmienia kolejność akapitów – detekcja staje się praktycznie niemożliwa.

Badania pokazują, że współczynnik fałszywych pozytywów w detektorach AI sięga 30-40%. Co trzeci tekst napisany przez człowieka zostaje błędnie oznaczony jako AI. A jednocześnie dobrze zredagowany tekst AI przechodzi przez filtry bez problemu.

GPT-5, Claude Opus 4.6, Gemini 3 Pro – wszystkie te modele zostały wytrenowane na ogromnych zbiorach ludzkiego tekstu. Ich zadanie to właśnie naśladowanie naturalnego języka.

Im lepiej to robią, tym trudniej je wykryć.

To wyścig zbrojeń, którego detektory z definicji nie mogą wygrać. Bo ich zadanie to rozpoznać coś, co zostało zaprojektowane, żeby być nierozpoznawalne.

Plagiat naukowy to nie tylko kwestia etyki. To problem systemowy.

Kariera akademicka zależy od publikacji. Presja jest ogromna. A AI właśnie obniżyło koszt oszustwa do zera.

Nie musisz już płacić komuś za napisanie pracy. Nie musisz nawet dobrze znać tematu. Wystarczy dostęp do ChatGPT, Claude lub Gemini, kilka artykułów jako źródło i prompt "przepisz to w stylu akademickim".

Czasopisma naukowe próbują się bronić. Niektóre wprowadzają obowiązkowe oświadczenia o nieużywaniu AI. Inne wymagają dodatkowej weryfikacji od recenzentów.

To łatanie dziurawego systemu – bo jak weryfikować coś, czego nie da się wykryć?

To samo dzieje się w copywritingu, dziennikarstwie, pisaniu raportów biznesowych. Wszędzie tam, gdzie liczy się tekst, a nie weryfikowalna wiedza.

Firmy zatrudniają copywriterów, którzy w 80% korzystają z AI. Agencje PR wysyłają komunikaty prasowe wygenerowane przez ChatGPT. Studenci oddają prace napisane przez Claude.

I nikt nie jest w stanie tego skutecznie zweryfikować.

Skoro nie możemy wykryć, czy tekst napisała AI, musimy przestać próbować. I zacząć weryfikować coś innego: wiedzę, proces, zrozumienie.

W nauce to może oznaczać większy nacisk na recenzje merytoryczne zamiast formalnych. Sprawdzanie, czy autor rozumie to, co napisał – przez rozmowy, prezentacje, odpowiedzi na pytania recenzentów.

W edukacji – egzaminy ustne, projekty praktyczne, zadania wymagające zastosowania wiedzy w nowym kontekście (czego AI nie potrafi zrobić bez dodatkowego treningu).

W biznesie – weryfikacja wyników, nie procesu. Jeśli copywriter korzysta z AI, ale dostarczane teksty działają i są zgodne z briefem – czy to w ogóle problem?

Unijna dyrektywa AI Act wymaga oznaczania treści generowanych przez AI w niektórych kontekstach. Pytanie: jak to egzekwować, skoro nie mamy narzędzi do weryfikacji?

Polskie uczelnie eksperymentują z różnymi podejściami. Niektóre zakazują AI całkowicie (co jest nieegzekwowalne). Inne uczą, jak korzystać z AI odpowiedzialnie. Trzecie wprowadzają obowiązkowe obrony ustne dla wszystkich prac.

Nie ma jeszcze jednego standardu. I pewnie długo nie będzie – bo problem jest zbyt świeży, a technologia zmienia się szybciej niż regulacje.

Jeśli recenzujesz prace, artykuły lub raporty – przestań ufać detektorom AI. Zamiast tego zadawaj pytania sprawdzające zrozumienie. Proś o wyjaśnienie kluczowych fragmentów. Weryfikuj źródła i logikę argumentacji.

Jeśli sam korzystasz z AI w pracy – bądź transparentny. Nie udawaj, że tekst napisałeś od zera, jeśli AI zrobiło 80% roboty. Możesz używać narzędzi, które pomagają – pod warunkiem, że rozumiesz i weryfikujesz to, co generują.

A jeśli zarządzasz zespołem lub procesem edukacyjnym – zacznij projektować weryfikację wokół wiedzy i umiejętności, nie wokół tekstu. Bo tekst przestał być wiarygodnym dowodem czegokolwiek.

Era, w której mogliśmy ufać, że tekst napisał człowiek, właśnie się skończyła. Pytanie nie brzmi "jak wykryć AI". Pytanie brzmi: "jak weryfikować kompetencje w świecie, gdzie AI pisze za nas".

Na podstawie: Startup Daily AU

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar