Okno kontekstu w AI: dlaczego ChatGPT czasem nie rozumie

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Wklejasz do ChatGPT długi dokument. Zadajesz pytanie. Model odpowiada. Kontynuujesz rozmowę.

I nagle – jakby zapomniał, co pisałeś pięć wiadomości wcześniej.

Nie zepsuło się nic. To nie błąd. To okno kontekstu.

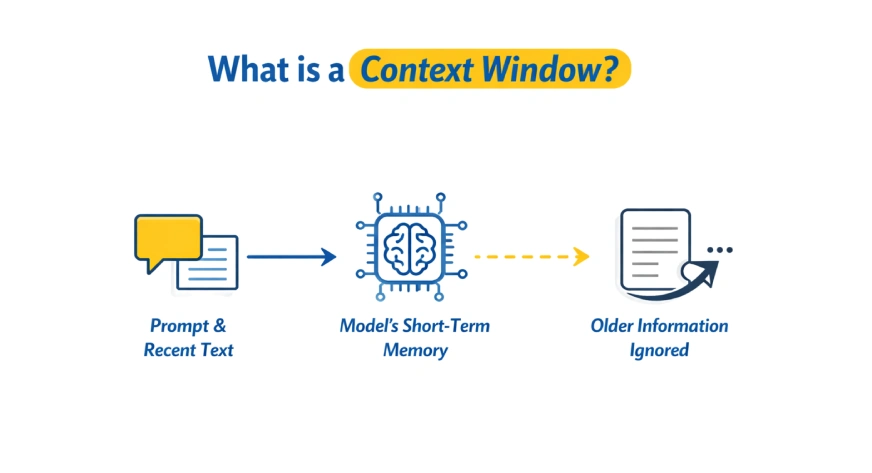

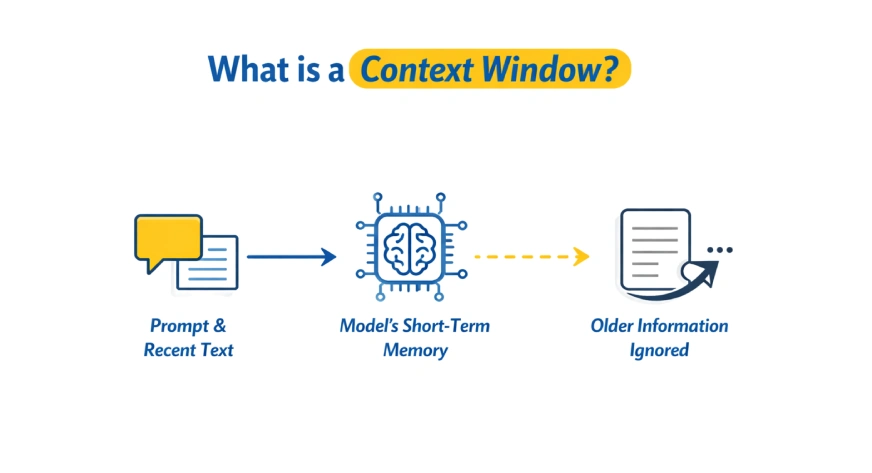

Każdy model AI ma pamięć. Nie w sensie dysku twardego, ale w sensie tego, ile tekstu potrafi "trzymać w głowie" jednocześnie. I to ma swoje granice.

Okno kontekstu (context window) to maksymalna ilość tekstu, którą model przetwarza w jednej sesji. Wlicza się w to wszystko: Twoje pytania, odpowiedzi AI, wklejone dokumenty, cała historia rozmowy.

Rozmawiasz z kimś, kto ma notatnik na 10 stron. Dopóki piszesz mniej – wszystko gra. Przekraczasz 11. stronę? Zaczyna wyrywać kartki od początku.

I nagle nie pamięta, jak się nazywasz.

Dokładnie tak działa AI.

Modele nie liczą słów. Liczą tokeny.

Token to kawałek tekstu – mniej więcej 3/4 słowa w języku angielskim. W polskim bywa gorzej, bo nasze słowa są dłuższe i bardziej skomplikowane gramatycznie. Jedno polskie słowo może zjeść dwa, trzy tokeny. Czasem więcej.

GPT-5 ma okno kontekstu na 128 tysięcy tokenów. Brzmi imponująco? To około 96 tysięcy słów po angielsku. Cała trylogia Władcy Pierścieni to jakieś 480 tysięcy słów – zmieściłbyś więc mniej więcej jedną piątą.

Claude Sonnet 4.6? 200 tysięcy tokenów. Gemini 3.1 Pro oferuje milion. A najnowszy Gemini 3.1 Pro? Dwa miliony tokenów – to już ponad 1,5 miliona słów. Cała biblioteczka w jednej sesji.

Tylko że większe okno nie zawsze oznacza lepszą jakość. I tu robi się ciekawie.

Im dłuższy kontekst, tym trudniej modelowi utrzymać uwagę na wszystkim jednocześnie.

Badania pokazują, że modele mają problem z "middle retrieval" – czyli wyciąganiem informacji ze środka długiego tekstu. Pamiętają początek. Pamiętają koniec. Ale to, co było gdzieś w okolicach strony 47?

Gubi się.

To trochę jak czytanie 500-stronicowej książki za jednym posiedzeniem. Pamiętasz, jak się zaczęła. Finał masz w głowie. Ale szczegóły z rozdziału 18? Mgliście, co najwyżej.

Dlatego samo zwiększanie okna kontekstu to nie jest magiczne rozwiązanie. Google może pochwalić się dwoma milionami tokenów, ale jeśli wrzucisz tam 50 dokumentów i zapytasz o konkretny szczegół z trzeciego od końca – model może mieć problem. Bo to nie jest kwestia pojemności. To kwestia uwagi.

Zależy od systemu.

Niektóre modele po prostu odrzucają nadmiar – obcinają najstarsze wiadomości. Inne próbują kompresować: zostawiają streszczenia zamiast pełnych tekstów. Jeszcze inne zwracają błąd i proszą, żebyś skrócił prompt.

ChatGPT w darmowej wersji ma mniejsze okno niż w Plus. Claude czasem ostrzega, że rozmowa jest długa i proponuje reset. Gemini w wersji Advanced pozwala na więcej – ale i tak ma granicę.

Problem pojawia się podstępnie. Nie dostajesz komunikatu "Hej, przekroczyłeś limit". Po prostu model zaczyna odpowiadać jakby... mniej trafnie. Gubi wątek. Powtarza się. Odpowiada na pytanie, którego nie zadałeś.

I myślisz: "Co się stało? Jeszcze przed chwilą działało".

A stało się to, że wypełniłeś notatnik.

Większość interfejsów nie pokazuje licznika tokenów. Są jednak narzędzia.

OpenAI ma oficjalny tokenizer – wklejasz tekst, pokazuje Ci, ile tokenów zje. Podobne narzędzia są dla Claude'a i innych modeli. Wystarczy wpisać w Google "tokenizer GPT-5" i masz.

Jeśli pracujesz przez API (czyli łączysz się z modelem programistycznie), dostajesz dokładne statystyki w każdej odpowiedzi. Ile tokenów wysłałeś, ile dostałeś z powrotem, ile zostało w limicie. Wszystko na tacy.

Dla zwykłego użytkownika? Reguła kciuka: jeśli wklejasz dokument dłuższy niż 20 stron A4, zaczynasz się zbliżać do granic w podstawowych modelach. Jeśli prowadzisz rozmowę dłuższą niż 30-40 wymian – podobnie.

Nie wklejaj wszystkiego na raz. Serio.

Jeśli masz pięć dokumentów i chcesz, żeby AI je przeanalizowało – nie wrzucaj ich jednocześnie. Przetwarzaj po kolei. Wyciągaj kluczowe informacje. Zapisuj. Potem następny dokument. Krok po kroku.

Dziel długie rozmowy. Jak czujesz, że wątek się rozlazł – zacznij nową sesję. Skopiuj najważniejsze ustalenia do świeżego czatu i kontynuuj stamtąd.

Używaj streszczeń. Zamiast trzymać całą historię rozmowy, poproś model: "Podsumuj nasze ustalenia w trzech punktach". Skopiuj to podsumowanie do nowego czatu. Oszczędzisz tysiące tokenów i model będzie miał klarowniejszy obraz sytuacji.

Jeśli pracujesz z bardzo długimi dokumentami – wybierz model z większym oknem. Gemini 3.1 Pro obsłuży milion tokenów. To wystarczy na całą książkę plus Twoje pytania. Pamiętaj tylko: większe okno = wyższa cena (jeśli płacisz za API) i potencjalnie wolniejsze odpowiedzi.

Trwa wyścig.

Google pcha w stronę coraz większych okien – dwa miliony tokenów to dopiero początek. Anthropic (twórcy Claude'a) eksperymentuje z "nieskończonym kontekstem" – systemem, który nie tyle zapamiętuje wszystko, co inteligentnie wyciąga to, co potrzebne w danym momencie.

Inni stawiają na RAG (Retrieval-Augmented Generation) – model nie dostaje całego dokumentu, tylko wyszukuje w nim fragmenty na bieżąco. Jak bibliotekarz, który nie czyta całej encyklopedii, tylko znajduje właściwy tom i konkretną stronę.

Jeszcze inni pracują nad pamięcią długoterminową. Model zapamięta, że lubisz kawę bez cukru i piszesz kod w Pythonie – i będzie to "wiedział" w każdej nowej rozmowie, bez wklejania historii.

Ale na dziś? Okno kontekstu to twój limit. I warto wiedzieć, gdzie on jest.

Okno kontekstu to nie abstrakcyjny termin techniczny. To konkretna granica tego, ile AI może przetworzyć jednocześnie. Przekroczysz ją – model zacznie gubić wątek. Nie chodzi o to, że jest zły. Dlatego, że tak został zbudowany.

Większe okno brzmi lepiej, prawda? Nie zawsze działa lepiej. Model z milionem tokenów może zgubić szczegół, który model ze 100 tysiącami by złapał – bo ten drugi ma mniej do przeszukania.

Mądre korzystanie to nie wpychanie wszystkiego na raz. To dzielenie, streszczanie, wybieranie. Traktuj okno kontekstu jak biurko – im więcej na nim leży, tym trudniej znaleźć to, czego szukasz.

Przeczytaj też:

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar