Pamięć RAM dusi AI bardziej niż brak GPU. Dane z rynku

Źródło: Link

Źródło: Link

90 minut praktyki na żywo. Pokazuję krok po kroku, jak zacząć z AI bez kodowania.

Mówią, że infrastruktura AI to wyścig o najszybsze GPU od Nvidii. Prawda wygląda inaczej.

Dobra, powiedzmy to wprost: GPU to tylko połowa problemu. Druga połowa – ta, o której mało kto mówi – to pamięć. Modele AI rosną szybciej niż pojemność pamięci w kartach graficznych. Masz najszybszy chip na rynku? Świetnie. Model i tak się nie zmieści.

Nvidia sprzedaje kolejne generacje GPU. Wszyscy liczą FLOPS-y i moc obliczeniową. Tymczasem współczesne modele AI potrzebują setek gigabajtów pamięci RAM – a standardowe GPU mają jej kilkadziesiąt.

Kiedy uruchamiasz model AI, cała jego struktura musi załadować się do pamięci. Im większy model, tym więcej parametrów. Każdy parametr to dane w RAM. GPT-5 ma setki miliardów parametrów. Llama 4 w największej wersji – 405 miliardów. Każdy z nich to liczba zmiennoprzecinkowa, która zajmuje miejsce.

Standardowa karta Nvidia A100 ma 80 GB pamięci HBM (High Bandwidth Memory). Imponująco? Nie wystarczy na większość najnowszych modeli. Żeby uruchomić duży model, musisz łączyć wiele kart w klaster. To oznacza nie tylko koszt GPU, ale przede wszystkim koszt pamięci.

Producenci chipów AI zaczęli to rozumieć. Nvidia w najnowszych generacjach (H100, H200) zwiększa przede wszystkim ilość pamięci HBM, nie tylko moc obliczeniową. H200 ma 141 GB HBM3e – niemal dwukrotność A100. Bez tego nie uruchomisz współczesnych modeli.

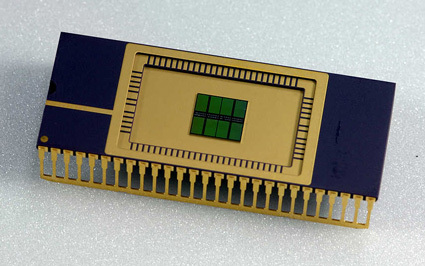

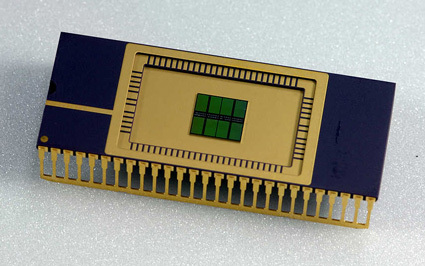

HBM (High Bandwidth Memory) to specjalny typ pamięci montowany bezpośrednio na chipie GPU. Ma o wiele większą przepustowość niż standardowa DDR – mówimy o kilku terabajtach na sekundę transferu danych. To kluczowe, bo model AI ciągle czyta i zapisuje parametry podczas obliczeń.

Problem? HBM jest droga. Bardzo droga. Produkuje ją tylko kilka firm na świecie – głównie SK Hynix, Samsung i Micron. Kiedy popyt na AI eksplodował w 2023 roku, ceny HBM poszły w górę o ponad 50%. Nie przez braki w produkcji GPU. Przez braki w produkcji pamięci.

Nvidia dominuje w GPU. SK Hynix dominuje w HBM. Firma dostarcza pamięć do większości najnowszych kart AI – w tym do całej serii H100 i H200 od Nvidii. W 2024 roku SK Hynix odnotował rekordowe zyski. Głównie dzięki sprzedaży HBM do centrów danych AI.

Samsung próbuje dogonić, inwestując miliardy w rozbudowę fabryk HBM. Micron również wchodzi na rynek – w 2024 roku ogłosił nową linię produkcyjną HBM3e. Wszyscy wiedzą: kto kontroluje pamięć, kontroluje infrastrukturę AI.

Ciekawy szczegół: Google i inne firmy technologiczne zaczynają projektować własne chipy AI (TPU, Trainium). Nadal kupują HBM od tych samych dostawców. Nie da się tego obejść. Pamięć to fundament.

Kiedy czytasz o kosztach uruchomienia modelu AI, większość analiz skupia się na GPU. "Potrzebujesz 1000 kart A100" – brzmi konkretnie. Prawdziwy koszt to nie tylko karty. To pamięć, którą te karty mają.

Przykład: uruchomienie modelu wielkości Llama 4 405B wymaga około 810 GB pamięci (przy precyzji 16-bit). To oznacza minimum 11 kart A100 (80 GB każda) – tylko po to, żeby model się zmieścił. Koszt? Około 220 tysięcy dolarów za sam sprzęt. Bez kosztów energii, chłodzenia, infrastruktury sieciowej.

Dlatego firmy takie jak OpenAI, Anthropic czy Black Forest Labs optymalizują modele pod kątem pamięci. Kwantyzacja (zmniejszenie precyzji obliczeń z 16-bit do 8-bit lub 4-bit) może zmniejszyć wymagania pamięciowe o połowę. To nie tylko oszczędność. To różnica między "da się uruchomić" a "nie da się uruchomić".

Producenci AI zaczynają projektować modele inaczej. Zamiast jednego gigantycznego modelu, który wymaga setek GB pamięci, tworzą architektury modularne. Mixture of Experts (MoE) – jak w Gemini 3.1 Pro czy GPT-5 – aktywuje tylko część parametrów na raz. Model ma 1,7 biliona parametrów, ale w danym momencie używa tylko 280 miliardów. Oszczędność pamięci: ogromna.

Inny trend: przesunięcie obliczeń z GPU na CPU z dużą pamięcią DDR. CPU mają mniej mocy obliczeniowej, ale mogą mieć terabajty zwykłej pamięci RAM. Firmy takie jak Cerebras budują chipy AI z setkami GB pamięci on-chip – bez potrzeby łączenia wielu kart.

Pojawia się też nowa kategoria sprzętu: akceleratory AI z priorytetem na pamięć, nie moc. AMD Instinct MI300X ma 192 GB HBM3 – więcej niż jakikolwiek chip Nvidii. To odpowiedź na realne potrzeby rynku.

Jeśli planujesz wdrożenie AI w firmie, przestań patrzeć tylko na moc GPU. Zapytaj o pamięć. Ile GB ma karta? Jaka przepustowość? Czy model, który chcesz uruchomić, w ogóle się zmieści?

Zrób jedną rzecz: przed wyborem infrastruktury AI policz wymagania pamięciowe modelu. Weź liczbę parametrów, pomnóż przez 2 (dla precyzji 16-bit) lub przez 1 (dla 8-bit). To minimum GB, które potrzebujesz. Dodaj 20% bufora na operacje. Dopiero wtedy wybieraj sprzęt.

Jeśli budżet jest ograniczony, postaw na kwantyzację i mniejsze modele. Andrej Karpathy pokazał, że dobrze zoptymalizowany mały model może działać lepiej niż źle wdrożony gigant. Pamięć to nie tylko koszt – to strategia.

Rynek się zmienia. Nvidia nadal dominuje, ale gra toczy się już nie tylko o GPU. Toczy się o pamięć. Kto to zrozumie pierwszy, ten wygra.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar