Stable Diffusion na Raspberry Pi. Generujesz obrazy bez chmury

Źródło: Link

Źródło: Link

118 lekcji od zera do eksperta. Bez kodowania.

Midjourney kasuje 30 dolarów miesięcznie. DALL-E liczy kredyty. A Ty możesz generować obrazy AI na minikomputerze wielkości karty kredytowej, który kosztuje mniej niż dwa miesiące abonamentu. Heise Online pokazuje, jak uruchomić Stable Diffusion na Raspberry Pi. I wcale nie jest to skomplikowane.

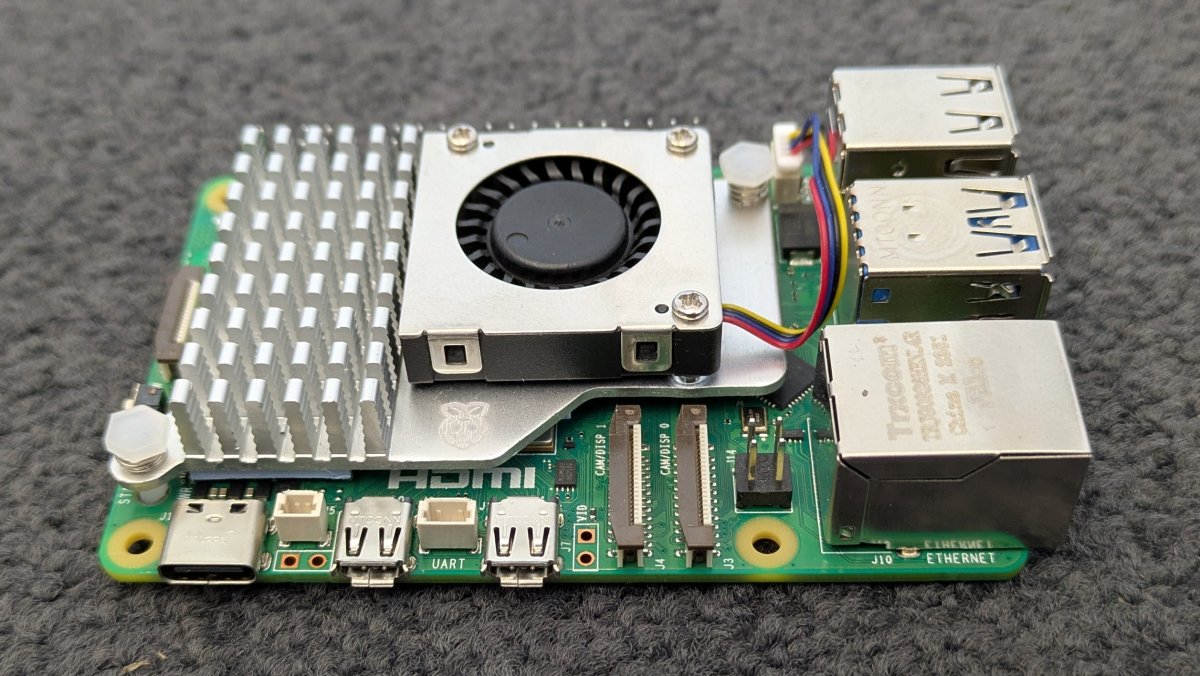

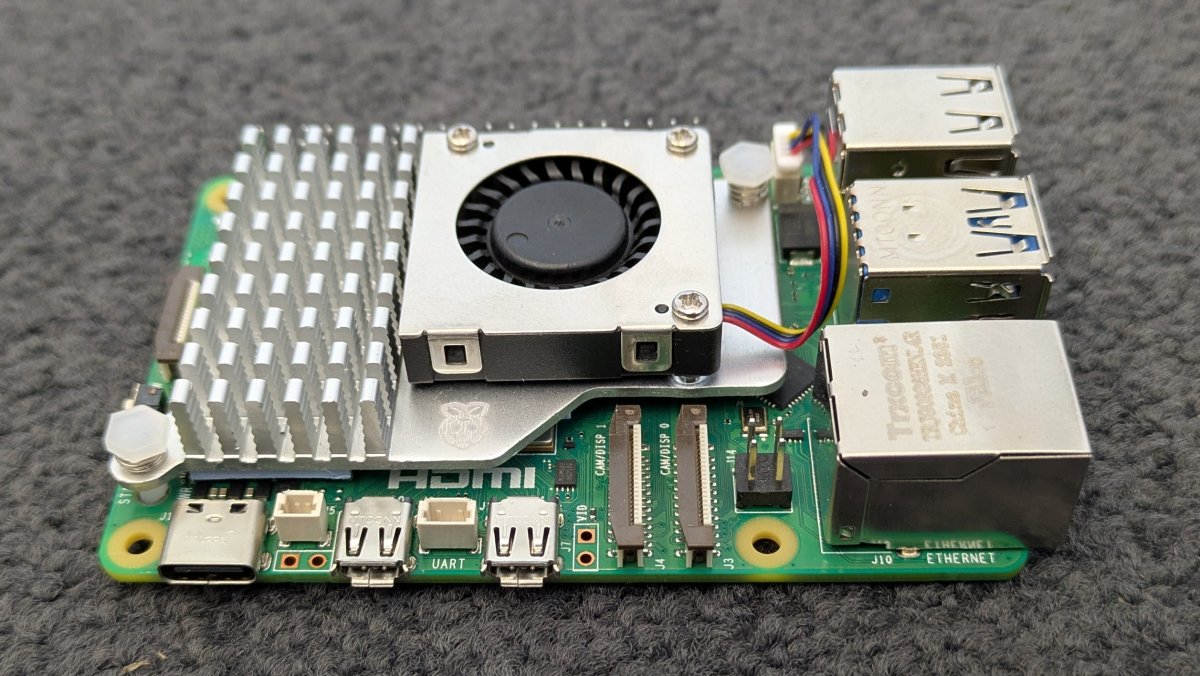

Raspberry Pi to komputer jednopłytkowy, który zmieścisz w kieszeni. Model 4 kupisz za około 200-300 złotych. Piątka to koszt rzędu 400-500 złotych. Dodaj kartę microSD (minimum 32 GB, lepiej 64 GB), zasilacz i masz kompletny zestaw.

Heise testował konfigurację na obu modelach. Różnica? Pi 5 generuje obrazy szybciej dzięki mocniejszemu procesorowi. Pi 4 też daje radę – po prostu musisz poczekać dłużej. Mówimy o minutach, nie sekundach jak w przypadku Adobe Firefly czy FLUX.2.

Kluczowa różnica: wszystko dzieje się lokalnie. Twoje prompty nie wędrują na serwery OpenAI, Google ani żadnej innej firmy. Nie ma logowania, nie ma śledzenia, nie ma limitów miesięcznych. Wpisujesz prompt, model generuje obraz – i tyle.

Heise opisuje proces instalacji jako "zaskakująco prosty". Potrzebujesz systemu Raspberry Pi OS (darmowy, ściągasz ze strony producenta), biblioteki Python i samego modelu Stable Diffusion. Cały setup zajmuje około godziny – większość tego czasu to pobieranie plików.

Model Stable Diffusion waży kilka gigabajtów. Ściągasz go raz, zapisujesz na karcie microSD i masz. Nie musisz płacić za dostęp, nie musisz się logować, nie musisz akceptować kolejnych regulaminów. Instalujesz, uruchamiasz, działasz.

Jeśli kiedykolwiek instalowałeś Linuxa albo bawiłeś się Dockerem, to będzie dla Ciebie spacer. Jeśli nie – Heise przygotował instrukcję krok po kroku, z konkretnymi komendami do wklejenia w terminal.

Dobra, powiedzmy to wprost: Raspberry Pi nie pobije GPU w chmurze. Generowanie jednego obrazu 512x512 pikseli zajmuje kilka minut na Pi 4, około minuty na Pi 5. Dla porównania – Nano Banana 2 w Gemini robi to w sekundę.

Zyskujesz za to: zero abonamentów, zero limitów, zero wysyłania danych na zewnątrz. Chcesz wygenerować tysiąc obrazów? Generujesz. Chcesz eksperymentować z promptami, które wolałbyś zachować dla siebie? Nie ma problemu. Nikt nie patrzy, nikt nie loguje, nikt nie sprzedaje Twoich danych reklamodawcom.

Heise podkreśla jeszcze jeden aspekt: edukacja. Jeśli chcesz zrozumieć, jak naprawdę działają modele generujące obrazy, lokalna instalacja daje Ci wgląd w proces. Widzisz, jak model przetwarza prompt, jak buduje obraz warstwa po warstwie, jak różne parametry wpływają na rezultat. W chmurze dostajesz gotowy obrazek – tutaj widzisz kuchnię.

Raspberry Pi ze Stable Diffusion to nie zamiennik Midjourney dla grafika, który produkuje setki obrazów dziennie dla klientów. To narzędzie dla kogoś, kto:

Jeśli generujesz obrazy sporadycznie – do prezentacji, na bloga, dla zabawy – lokalna instalacja może być tańsza niż płacenie 30 dolarów miesięcznie za dostęp do chmury. Koszt Raspberry Pi zwraca się po 2-3 miesiącach.

Stable Diffusion to model z 2022 roku. Od tamtej pory rynek zobaczył FLUX.2, kolejne wersje Midjourney, Adobe Firefly i dziesiątki innych narzędzi. Czy Stable Diffusion wciąż ma sens?

Tak, jeśli zależy Ci na otwartości i kontroli. Nowsze modele często są lepsze jakościowo, ale zamknięte. Stable Diffusion możesz modyfikować, trenować na własnych danych, uruchamiać gdzie chcesz. To różnica między wynajmem mieszkania a posiadaniem własnego domu – jedno jest wygodniejsze, drugie daje Ci więcej swobody.

Heise zwraca uwagę na jeszcze jeden aspekt: społeczność. Wokół Stable Diffusion powstało ekosystem wtyczek, rozszerzeń, dostosowanych wersji modelu. Możesz zainstalować wariant zoptymalizowany pod portrety, krajobrazy, grafikę techniczną – cokolwiek potrzebujesz. W zamkniętych usługach dostajesz to, co daje Ci dostawca.

Lokalne generowanie obrazów to nie tylko zabawa dla entuzjastów. Heise wymienia konkretne przypadki użycia:

Prototypowanie interfejsów. Potrzebujesz szybkich mockupów graficznych do testów UX? Generujesz lokalnie, nie wysyłasz pomysłów na serwery konkurencji.

Materiały edukacyjne. Szkoły i uniwersytety mogą generować ilustracje do prezentacji bez obaw o prywatność danych uczniów czy naruszenie regulaminów usług chmurowych.

Małe firmy. Jeśli prowadzisz jednoosobową działalność i potrzebujesz grafik do mediów społecznościowych, lokalna instalacja może być tańsza niż abonament – szczególnie jeśli nie generujesz obrazów codziennie.

Podobnie jak Karpathy pokazał z modelami językowymi, czasem prostsze, lokalne rozwiązanie lepiej pasuje do rzeczywistych potrzeb niż potężna, ale kosztowna usługa w chmurze.

Heise testował Stable Diffusion na Raspberry Pi, ale to tylko początek. Modele AI stają się coraz bardziej efektywne – to, co rok temu wymagało GPU za 10 tysięcy złotych, dziś działa na sprzęcie za 500 złotych. Za rok może działać na smartfonie.

Trend jest jasny: przetwarzanie wraca z chmury na urządzenia lokalne. Apple wbudowuje AI w iPhone'y, Google w Pixele, Microsoft w laptopy z Copilot+. Raspberry Pi ze Stable Diffusion to nie ciekawostka – to zapowiedź tego, jak będzie wyglądać AI za 2-3 lata.

Pytanie brzmi: czy chcesz czekać, aż wielkie firmy zdecydują, jakie AI dostaniesz w swoim urządzeniu – czy wolisz mieć kontrolę już teraz? Raspberry Pi kosztuje mniej niż dwa miesiące Midjourney. Resztę decyzji zostawiam Tobie.

Na podstawie: Heise Online

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar