Claude Code dostał tryb auto. Bezpieczniejszy? Sprawdzamy

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

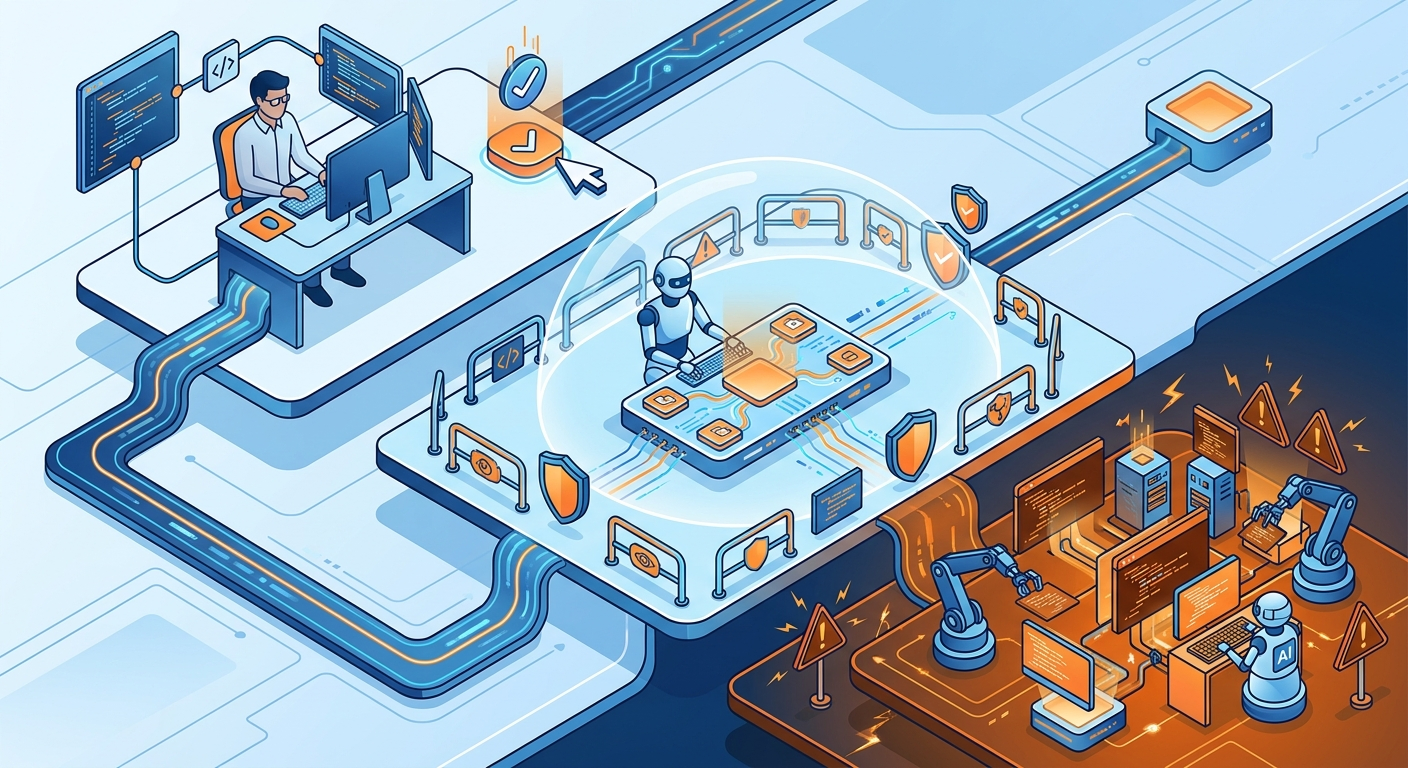

Mówią, że AI do kodowania to albo niania, którą musisz pilnować na każdym kroku, albo dziecko z zapałkami, któremu dałeś pełną swobodę. Anthropic twierdzi, że znalazł coś pomiędzy.

Claude Code właśnie dostał tryb automatyczny. To funkcja, która pozwala modelowi podejmować decyzje o uprawnieniach samodzielnie – bez pytania Cię za każdym razem, czy może otworzyć plik, uruchomić skrypt czy zmienić konfigurację.

Jeśli kiedykolwiek pracowałeś z narzędziami AI do kodowania, znasz ten dylemat. Dasz modelowi pełną autonomię – i za chwilę może skasować katalog, nadpisać kluczowy plik albo uruchomić coś, czego nie powinien.

Nie dasz – i co 30 sekund musisz klikać "tak, zgadzam się" na kolejne prośby o dostęp.

Anthropic nazywa tę grupę użytkowników "vibe coders" – osoby, które chcą szybko prototypować, testować pomysły, eksperymentować. Dla nich ciągłe zatwierdzanie to zabójca flow. Pełna autonomia? To proszenie się o kłopoty.

Tryb automatyczny ma być odpowiedzią. Model dostaje więcej swobody, ale w kontrolowanych ramach. Może podejmować decyzje o uprawnieniach sam – ale tylko te, które firma uznała za bezpieczne.

Zamiast pytać o zgodę przy każdej operacji, Claude Code w trybie automatycznym analizuje kontekst i podejmuje decyzję. Jeśli operacja mieści się w zdefiniowanych granicach bezpieczeństwa – wykonuje ją. Jeśli wykracza poza nie – zatrzymuje się i pyta.

Anthropic nie podał pełnej listy operacji, które model może wykonywać autonomicznie. Firma mówi o "decyzjach na poziomie uprawnień" – czyli prawdopodobnie chodzi o dostęp do plików, katalogów, uruchamianie skryptów w izolowanym środowisku.

To podejście przypomina trochę Gemini Code Assist od Google, który też próbuje zautomatyzować część decyzji deweloperskich. Różnica: Google stawia na kontekst całego projektu, Anthropic – na kontrolowane uprawnienia.

Anthropic używa słowa "safer" – bezpieczniejszy. Nie "bezpieczny", nie "w pełni kontrolowany". Bezpieczniejszy.

Niż co? Niż pełna autonomia – jasne. Niż ręczne zatwierdzanie każdej operacji? To zależy, jak zdefiniujesz bezpieczeństwo.

Jeśli chodzi o ochronę przed przypadkowym skasowaniem danych – prawdopodobnie tak, bo model ma wbudowane ograniczenia. Jeśli chodzi o pełną kontrolę nad tym, co dzieje się w Twoim projekcie – nie, bo część decyzji podejmuje AI.

To kompromis. I jak każdy kompromis – będzie działał dla jednych, a dla innych nie. Dla kogoś, kto prototypuje szybki proof of concept? Prawdopodobnie wystarczy. Dla kogoś, kto pracuje nad produkcyjnym kodem w projekcie klienta? Może nie.

Funkcja trafia do użytkowników Claude Code – narzędzia, które Anthropic pozycjonuje jako asystenta dla deweloperów. Firma nie podała szczegółów cenowych ani dostępności (czy to część darmowego planu, czy wymaga subskrypcji Pro).

Profil użytkownika jest jasny: osoby, które eksperymentują, uczą się, budują prototypy. Nie zespoły enterprise'owe z rygorystycznymi procesami code review. Nie projekty, gdzie każda zmiana musi przejść przez audyt.

To narzędzie dla "vibe coders" – i Anthropic nie ukrywa tego. Pytanie, czy ta grupa jest wystarczająco duża, żeby uzasadnić rozwój funkcji. I czy nie skończy się tak, że tryb auto stanie się domyślnym – bo "wszyscy tak robią".

Anthropic nie jest pierwszy z tym pomysłem. OpenAI testuje podobne mechanizmy w Codex, GitHub Copilot ma własne podejście do autonomii, narzędzia jak Cursor integrują różne modele i dają użytkownikowi wybór poziomu kontroli.

Trend jest jasny: narzędzia AI do kodowania przesuwają się w stronę większej autonomii. Pytanie nie brzmi "czy", tylko "jak szybko" i "z jakimi zabezpieczeniami".

Problem w tym, że każda firma definiuje "bezpieczeństwo" inaczej. Dla Anthropic to kontrolowane uprawnienia. Dla Google – kontekst projektu. Dla OpenAI – prawdopodobnie coś związanego z ich systemem moderacji (choć szczegóły nie są jasne).

Efekt? Użytkownik musi sam zdecydować, któremu podejściu ufa. I to nie jest decyzja techniczna – to decyzja o tym, ile kontroli jesteś gotów oddać.

Zależy, co robisz.

Prototypujesz nowy pomysł? Uczysz się nowego języka? Testujesz bibliotekę? Prawdopodobnie tak – oszczędzisz czas i nie stracisz niczego krytycznego.

Pracujesz nad produkcyjnym kodem? Masz dostęp do wrażliwych danych? Projekt ma rygorystyczne wymogi bezpieczeństwa? Prawdopodobnie nie – albo przynajmniej nie od razu. Najpierw przetestuj w izolowanym środowisku.

Anthropic dał Ci opcję. Ty musisz zdecydować, czy Twój projekt jest gotowy na AI, które podejmuje decyzje bez pytania. Bo jak pokazuje historia agenta AI, który skasował 2,5 roku pracy – autonomia bez kontroli potrafi kosztować.

Pytanie nie brzmi "czy tryb auto jest bezpieczny". Pytanie brzmi: czy jesteś gotów zaufać AI w swoim projekcie – i czy masz backup, jeśli coś pójdzie nie tak?

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar