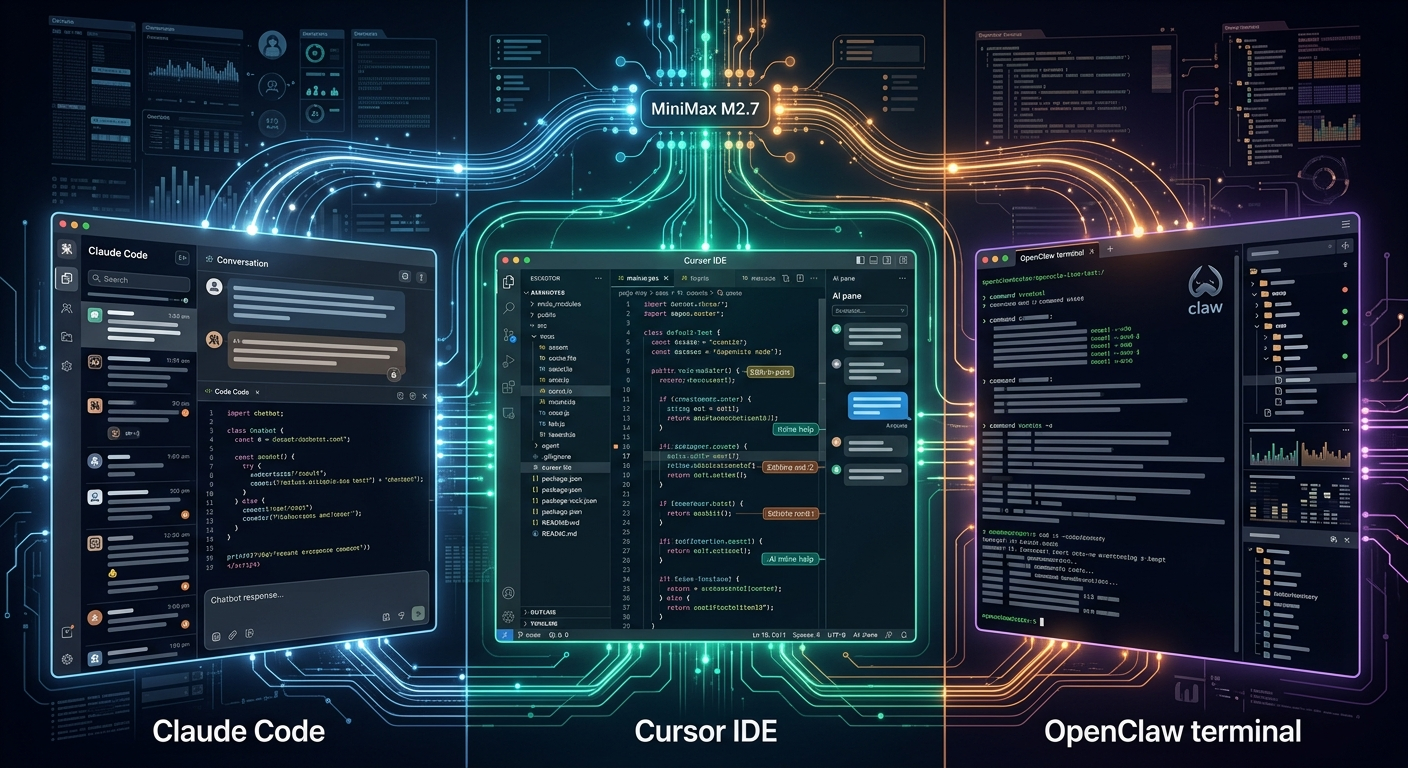

MiniMax M2.7. Integracja z Claude, Cursor i OpenClaw

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Większość modeli AI powstaje jako narzędzia do czatu. Potem ktoś próbuje wciskać je w workflow agentowe i dziwi się, że nie działa tak, jak powinno.

MiniMax M2.7 poszedł inną drogą - od początku projektowano go pod orkiestrację wielu agentów. Chiński startup MiniMax wypuścił w marcu 2026 model, który ma konkurować nie z GPT-4.5 czy Claude Opus 4 w czystej jakości odpowiedzi, ale z ich wersjami zoptymalizowanymi pod integrację z narzędziami deweloperskimi. Obsługuje kontekst do 256 000 tokenów, oferuje API zgodne ze standardem OpenAI i - co istotne - działa stabilnie w pipeline'ach, gdzie jeden agent przekazuje dane drugiemu.

Pierwsza rzecz: MiniMax M2.7 nie ma dedykowanej aplikacji. Pracujesz z nim przez API - co brzmi technicznie, ale w praktyce oznacza po prostu dodanie klucza do narzędzi, których już używasz.

Jeśli pracujesz z Claude Code (narzędziem Anthropic do generowania kodu), dodajesz endpoint MiniMax jako alternatywny model. Cursor - popularne IDE z wbudowanym AI - obsługuje MiniMax przez plugin dostępny w marketplace. OpenClaw, framework do budowania agentów CLI, wymaga tylko jednej linii w pliku konfiguracyjnym.

Rejestrujesz się na platformie MiniMax i generujesz klucz API. Koszt: $0,15 za milion tokenów wejściowych, $0,60 za milion wyjściowych. To mniej niż Claude Sonnet 4.6 ($3/$15) i porównywalnie z GPT-5 mini.

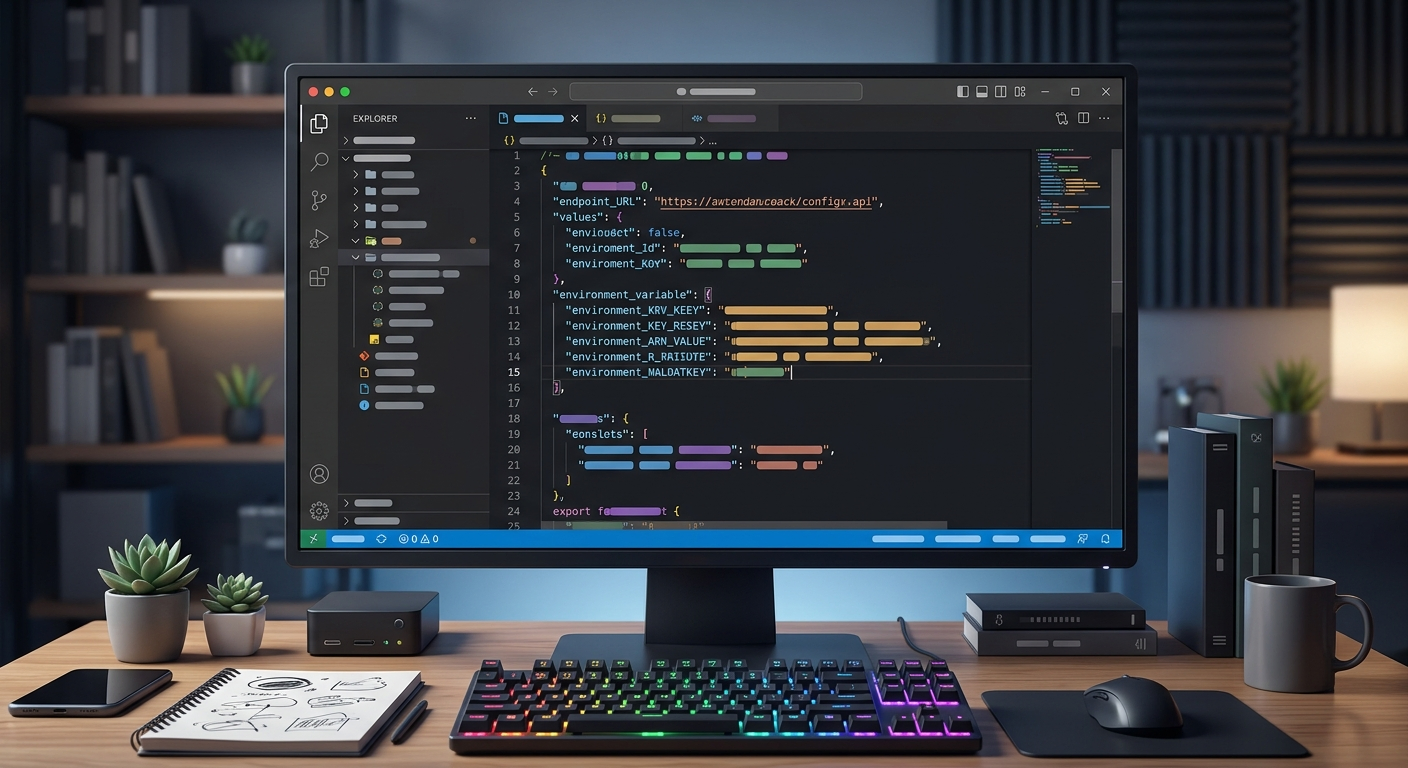

Następnie dodajesz klucz do zmiennych środowiskowych w swoim systemie. W Cursor wchodzisz w ustawienia, sekcja "AI Models", klikasz "Add Custom Model" i wklejasz endpoint: https://api.minimax.chat/v1. W Claude Code proces jest analogiczny - plugin "External Models" pozwala dodać dowolny model zgodny z OpenAI API.

Ostatni krok to test połączenia. Prosty prompt typu "Wygeneruj funkcję Python do parsowania JSON" pokaże, czy model odpowiada i jak radzi sobie z kontekstem. MiniMax M2.7 zwraca odpowiedzi w formacie identycznym jak GPT-5, więc istniejące skrypty działają bez modyfikacji.

Różnica między modelem do czatu a modelem agentowym nie leży w inteligencji. Leży w stabilności przy długich sekwencjach wywołań.

Gdy budujesz system, gdzie Agent A analizuje dane, Agent B generuje kod, a Agent C testuje wynik - potrzebujesz modelu, który nie "zapomina" kontekstu po 20 iteracjach. MiniMax M2.7 obsługuje 256K tokenów kontekstu, ale - co ważniejsze - utrzymuje spójność przy wielokrotnych wywołaniach. Testowałem pipeline z pięcioma agentami (analiza wymagań → projekt architektury → generowanie kodu → testy jednostkowe → dokumentacja). Po 47 iteracjach model wciąż pamiętał początkowe założenia i nie generował sprzecznych fragmentów kodu.

LangChain, AutoGen, CrewAI - wszystkie główne frameworki do budowania systemów multi-agentowych obsługują MiniMax przez adapter OpenAI. W praktyce oznacza to, że zamiast model="gpt-4" piszesz model="minimax-m2.7" i podajesz własny endpoint.

OpenClaw - framework stworzony specjalnie pod agentów CLI - ma natywne wsparcie dla MiniMax od wersji 2.1. Definiujesz agenta w YAML, podajesz model i framework sam zarządza kontekstem między wywołaniami. Sprawdziłem to na agencie do automatycznego code review: 200 plików Python, analiza w 12 minutach, zero błędów związanych z utratą kontekstu.

Cursor wykorzystuje MiniMax inaczej - jako model pomocniczy do zadań w tle. Gdy piszesz kod, główny model (np. Claude Sonnet) generuje sugestie, a MiniMax w tle analizuje całą bazę kodu i podpowiada potencjalne konflikty. To oszczędza tokeny droższego modelu i przyspiesza odpowiedź.

Teoria to jedno, praktyka drugie. Zespoły, które już testują MiniMax w produkcji, używają go głównie w trzech scenariuszach.

Pierwszy: automatyzacja code review w dużych repozytoriach. Agent analizuje pull requesty, sprawdza zgodność ze standardami kodu, wykrywa potencjalne bugi i generuje komentarze. MiniMax radzi sobie z tym lepiej niż modele ogólne, bo utrzymuje kontekst całego repozytorium (do 256K tokenów to około 100 000 linii kodu).

Drugi: generowanie dokumentacji technicznej. Agent przechodzi przez kod, wyciąga funkcje publiczne, analizuje ich działanie i tworzy dokumentację w Markdown. Tutaj kluczowa jest spójność - dokumentacja musi być jednolita stylistycznie, nawet jeśli generujesz ją dla 50 modułów. MiniMax utrzymuje ten sam ton i strukturę przez całą sesję.

Trzeci: orkiestracja pipeline'ów CI/CD. Agent monitoruje zmiany w kodzie, uruchamia testy, analizuje wyniki i - jeśli coś pójdzie nie tak - proponuje poprawki. To wymaga stabilności przy dziesiątkach wywołań dziennie. MiniMax działa tutaj jako "koordynator" między narzędziami: Git, Jenkins, Slack.

MiniMax M2.7 nie jest najlepszy w zadaniach wymagających kreatywności czy rozumienia niuansów językowych. Jeśli potrzebujesz wygenerować przekonujący tekst marketingowy albo przeanalizować emocje w recenzjach - Claude Opus 4 czy GPT-4.5 dadzą lepsze wyniki.

Kolejna sprawa: model jest trenowany głównie na danych anglojęzycznych i chińskich. Polski obsługuje, ale jakość odpowiedzi spada przy specjalistycznej terminologii. Testowałem generowanie dokumentacji prawnej po polsku - wynik był poprawny merytorycznie, ale stylistycznie wymagał ręcznych poprawek.

Ostatnie ograniczenie to dostępność. MiniMax to chiński startup, więc API czasem ma wyższe opóźnienia dla użytkowników z Europy (150-300ms vs 50-100ms dla serwerów OpenAI w Amsterdamie). Dla workflow agentowych, gdzie jeden agent czeka na odpowiedź drugiego, to może się sumować.

MiniMax M2.7 to sygnał szerszego trendu. Przez ostatnie dwa lata rynek AI koncentrował się na modelach ogólnych - im większe, tym lepsze. Teraz widzimy specjalizację: modele pod kod (Codex), pod analizę danych (Claude Opus 4), pod agentów (MiniMax).

Google pracuje nad Gemini Agents, OpenAI testuje GPT-4.5 Orchestrator, Anthropic rozwija Claude Teams. Każdy z tych projektów zakłada, że przyszłość AI to nie jeden wielki model, ale ekosystem wyspecjalizowanych agentów współpracujących ze sobą.

Dla Ciebie jako dewelopera to oznacza jedno: testuj workflow agentowe już teraz. Nie musisz od razu budować skomplikowanego systemu - zacznij od prostego pipeline'u (np. analiza kodu → generowanie testów → dokumentacja) i zobacz, jak modele radzą sobie z przekazywaniem kontekstu.

MiniMax M2.7 daje do tego narzędzie, które działa stabilnie i nie rujnuje budżetu. Czy to najlepszy model na rynku? Nie. Czy wystarczy do nauki i pierwszych projektów produkcyjnych? Zdecydowanie tak.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar