Jak przyspieszyć działanie modeli AI – przewodnik po optymalizacji

Źródło: Link

Źródło: Link

90 minut praktyki. Co tydzień na żywo.

Uruchamiasz model AI, zadajesz pytanie i... czekasz. I czekasz. Potem patrzysz na rachunek za API i zastanawiasz się, czy przypadkiem nie przepaliłeś budżetu na kwartał w tydzień. Znam to.

Problem nie leży w tym, że modele są złe – leży w tym, że działają w trybie fabrycznym, bez optymalizacji. Optymalizacja inferencji to sposób, żeby te same modele działały szybciej, taniej i bez utraty jakości.

Inferencja to moment, kiedy model AI przetwarza Twoje zapytanie i generuje odpowiedź. To nie jest trening – to codzienne użytkowanie. I właśnie tutaj dzieje się magia (albo katastrofa finansowa, zależy jak podejdziesz do tematu).

Duże modele językowe LLM, takie jak GPT-5 czy Claude Opus 4.6, mają miliardy parametrów. Każde zapytanie wymaga przejścia przez wszystkie te parametry, co zajmuje czas i zużywa moc obliczeniową. W praktyce oznacza to, że:

Optymalizacja inferencji to zestaw technik, które redukują te koszty – czasowe i finansowe – bez poświęcania jakości odpowiedzi. Szybko i dobrze jednocześnie.

Zanim zaczniesz, wiedz jedno: większość tych technik nie wymaga pisania kodu od zera. Narzędzia takie jak Hugging Face, ONNX Runtime czy TensorRT mają gotowe implementacje. Twoja rola to zrozumieć, którą technikę wybrać i jak ją zastosować.

Kwantyzacja to zamiana precyzyjnych liczb (32-bitowych) na mniej precyzyjne (8-bitowe lub nawet 4-bitowe). Zamiast mówić "temperatura wynosi 23.4567°C" mówisz "około 23°C". Dla większości zastosowań różnica jest nieistotna, a oszczędzasz miejsce i czas.

W praktyce kwantyzacja może zmniejszyć rozmiar modelu o 75% i przyspieszyć inferencję o 2-4x. Narzędzia takie jak Quanto (od Hugging Face) pozwalają na kwantyzację w kilku linijkach kodu – lub przez interfejs graficzny, jeśli nie kodujesz.

Kiedy to ma sens? Jeśli używasz modelu na urządzeniach z ograniczoną pamięcią (telefony, edge devices) albo chcesz obniżyć koszty API. Jeśli potrzebujesz absolutnej precyzji (np. w medycynie), ostrożnie z tą techniką.

Modele AI mają mnóstwo parametrów, z których część... nie robi nic istotnego. Pruning to proces usuwania tych zbędnych połączeń. Efekt? Model jest mniejszy, szybszy, a jakość odpowiedzi spada minimalnie (często o mniej niż 1%).

Istnieją dwa podejścia:

Narzędzia takie jak PyTorch Pruning albo TensorFlow Model Optimization mają gotowe funkcje. Jeśli korzystasz z lokalnych modeli AI, pruning może być różnicą między "działa" a "nie mieści się w pamięci".

Destylacja to proces, w którym duży model (nauczyciel) uczy mniejszy model (uczeń). Mały model uczy się nie tylko odpowiedzi, ale też "sposobu myślenia" dużego modelu. Efekt? Model 10x mniejszy, który działa 80-90% tak dobrze jak oryginał.

Przykład: DistilBERT to zdestylowana wersja BERT-a – 40% mniejsza, 60% szybsza, 97% dokładności. Jeśli budujesz chatbota AI i nie potrzebujesz pełnej mocy GPT-5, destylowany model może być idealny.

Kiedy to ma sens? Jeśli masz dostęp do dużego modelu (nawet przez API) i chcesz stworzyć szybszą, tańszą wersję do konkretnego zadania.

Zamiast przetwarzać każde zapytanie osobno, przetwarzaj je grupami (batch). To jak pakowanie paczek – wysłanie 10 paczek naraz jest taniej niż 10 osobnych wysyłek.

Batching może przyspieszyć inferencję o 5-10x, jeśli masz wiele zapytań do przetworzenia jednocześnie. Problem? Musisz poczekać, aż zbierze się grupa zapytań, co zwiększa latencję dla pojedynczego użytkownika.

Kiedy to ma sens? W systemach, gdzie masz stały strumień zapytań (np. analiza logów, przetwarzanie emaili) i nie potrzebujesz natychmiastowej odpowiedzi.

Jeśli 30% zapytań to powtórzenia lub niemal identyczne pytania, po co przetwarzać je od nowa? Caching to zapisywanie odpowiedzi na popularne zapytania i serwowanie ich z pamięci.

Proste, ale skuteczne. W praktyce może obniżyć koszty API o 20-40% bez żadnej zmiany w modelu. Narzędzia takie jak Redis czy Memcached obsługują to out-of-the-box.

Uwaga: działa tylko wtedy, gdy zapytania się powtarzają. Jeśli każde zapytanie jest unikalne, caching nie pomoże.

Zamiast uruchamiać model "na piechotę", użyj frameworka do obsługi modeli. Narzędzia takie jak TensorRT, ONNX Runtime czy TorchServe automatycznie optymalizują inferencję – kompilują model, zarządzają pamięcią, równoważą obciążenie.

W praktyce możesz zyskać 2-3x przyspieszenie bez zmiany ani linijki kodu modelu. Wystarczy "przepakować" model do formatu obsługiwanego przez framework.

Jeśli pracujesz z transformerami AI, ONNX Runtime ma dedykowane optymalizacje dla tej architektury.

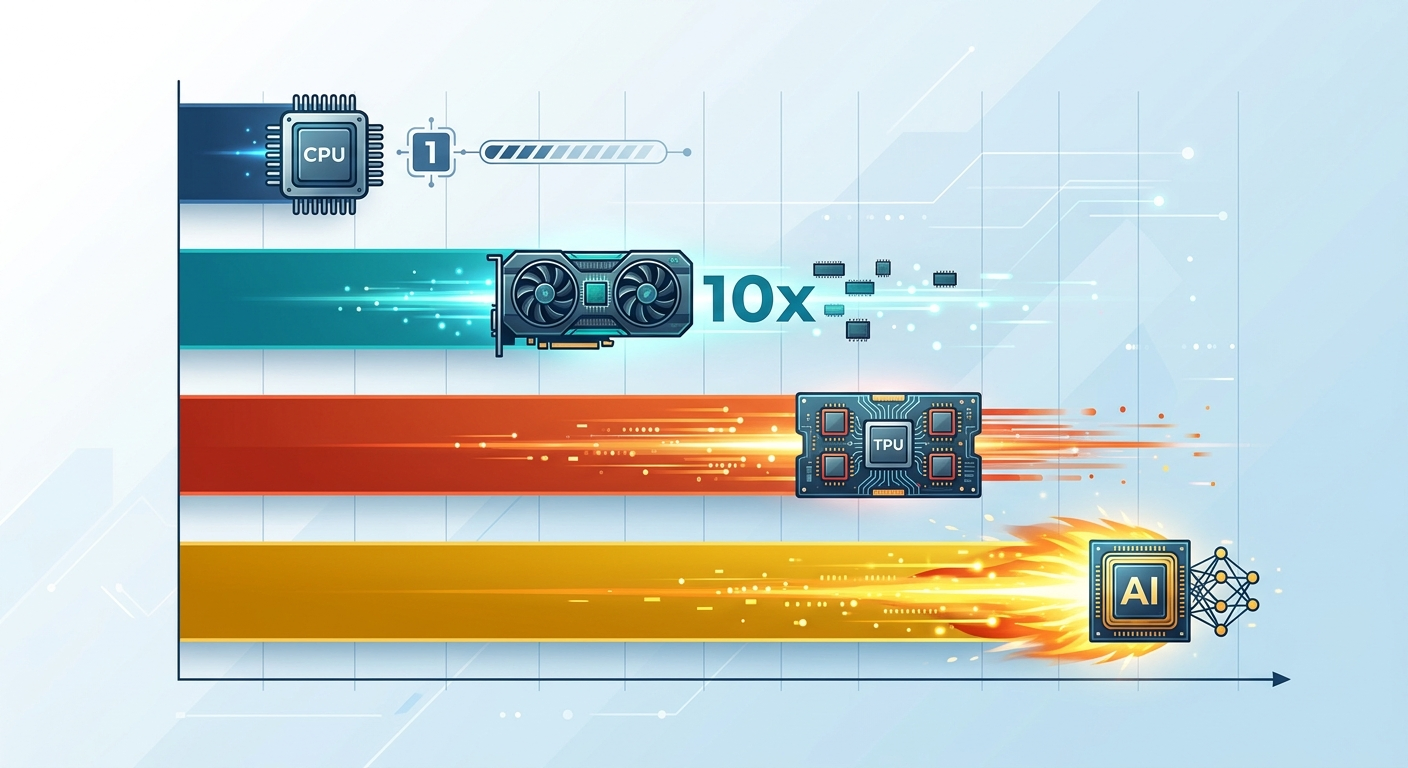

Procesory CPU są uniwersalne, ale wolne. GPU i TPU są zaprojektowane do obliczeń równoległych – idealnych dla AI. Przejście z CPU na GPU może przyspieszyć inferencję o 10-50x.

Nie musisz kupować sprzętu. Większość platform chmurowych (Google Cloud, AWS, Azure) oferuje dostęp do GPU/TPU na godziny. Jeśli przetwarzasz duże wolumeny, koszt sprzętu szybko się zwraca.

Uwaga: niektóre modele (np. kwantyzowane) działają lepiej na CPU niż na GPU. Testuj przed wdrożeniem.

Nie ma jednej uniwersalnej odpowiedzi. Wybór zależy od trzech czynników:

Jeśli priorytetem jest szybkość, zacznij od hardware acceleration i batch processing. Jeśli koszt, kwantyzacja i caching. Jeśli jakość, destylacja z ostrożnym pruningiem.

W większości przypadków najlepsze rezultaty daje kombinacja kilku technik. Przykład: kwantyzacja + ONNX Runtime + GPU może dać 10x przyspieszenie przy 50% niższych kosztach.

Optymalizacja inferencji to nie tylko korzyści. Są też ryzyka, o których warto wiedzieć przed wdrożeniem:

Jeśli dopiero zaczynasz z AI i nie masz doświadczenia technicznego, rozważ skorzystanie z gotowych rozwiązań. Platformy takie jak Hugging Face Inference API albo OpenAI oferują zoptymalizowane modele out-of-the-box – płacisz więcej, ale oszczędzasz czas i nerwy.

Jeśli nie jesteś programistą, ale chcesz zobaczyć optymalizację w akcji, oto trzy narzędzia z interfejsem graficznym:

Każde z tych narzędzi ma dokumentację i tutoriale. Jeśli potrzebujesz głębszego zrozumienia tematu, zajrzyj do materiałów o fine-tuningu modeli AI – wiele technik optymalizacji stosuje się również tam.

Optymalizacja inferencji przestaje być domeną specjalistów – staje się standardem. Platformy chmurowe oferują automatyczną optymalizację przy wdrożeniu modelu. Narzędzia no-code pozwalają na kwantyzację i pruning bez pisania linijki kodu.

To też oznacza, że jeśli nie optymalizujesz, konkurencja Cię wyprzedzi. Model, który działa 5 sekund zamiast 1, to nie tylko gorsze doświadczenie użytkownika – to utracone konwersje, wyższe koszty i niższa pozycja w wynikach wyszukiwania (tak, Google rankuje szybsze strony wyżej).

Jeśli dopiero zaczynasz z AI, nie musisz optymalizować od pierwszego dnia. Jeśli planujesz skalować – a większość firm planuje – optymalizacja inferencji to nie opcja. To konieczność. Lepiej zacząć wcześniej niż później, bo nauka na produkcji to droga lekcja.

Ten poradnik to dopiero początek. W naszym kursie "Praktyczna AI" nauczysz się korzystać z ChatGPT, Claude i innych narzędzi AI w sposób systematyczny – od zera do zaawansowanego poziomu.

Sprawdź kurs →Nie zawsze. Narzędzia takie jak Hugging Face Optimum czy TensorFlow Lite mają interfejsy graficzne, które pozwalają na podstawową optymalizację bez pisania kodu. Jeśli chcesz zaawansowanych technik (pruning, destylacja), wiedza programistyczna pomoże, ale nie jest konieczna – wystarczy umiejętność korzystania z gotowych skryptów i dokumentacji.

Zależy od techniki i modelu, ale realistyczne oszczędności to 30-70%. Kwantyzacja może obniżyć koszty o 50%, caching o 20-40%, a przejście na mniejszy zdestylowany model o 80-90%. Jeśli kombinujesz kilka technik, możesz obniżyć koszty nawet o 90% przy minimalnej utracie jakości.

Tak, ale zazwyczaj minimalnie. Kwantyzacja 8-bitowa obniża dokładność o 1-3%, destylacja o 5-10%, pruning o 1-5%. W większości zastosowań biznesowych ta różnica jest niezauważalna dla użytkownika końcowego. Kluczowe jest testowanie na rzeczywistych danych przed wdrożeniem – benchmarki nie zawsze odzwierciedlają realne użycie.

Dla dużych modeli językowych LLM najlepsze rezultaty dają: kwantyzacja (szczególnie 8-bit), specjalizowane frameworki (ONNX Runtime, TensorRT) i hardware acceleration (GPU/TPU). Jeśli masz powtarzające się zapytania, caching może obniżyć koszty o 30-40% bez żadnej zmiany w modelu. Destylacja działa świetnie, jeśli potrzebujesz modelu do konkretnego zadania i nie musisz zachować pełnej uniwersalności.

Bezpośrednio – nie, bo nie masz dostępu do wag modelu. Możesz jednak zastosować optymalizacje po stronie aplikacji: caching odpowiedzi, batch processing zapytań, prompt compression (skracanie promptów bez utraty sensu). Możesz też użyć destylacji – trenować mniejszy model na odpowiedziach z GPT-5, a potem używać tego mniejszego modelu lokalnie.

Podsumowanie: Optymalizacja inferencji to nie czarna magia – to zestaw konkretnych technik, które możesz wdrożyć już dziś. Kwantyzacja, pruning, destylacja, caching – każda z nich ma swoje miejsce i zastosowanie. Nie musisz być ekspertem, żeby zacząć. Wystarczy wybrać jedną technikę, przetestować na małą skalę i zobaczyć, co się stanie. Różnica między modelem, który działa 5 sekund i kosztuje 10 centów, a tym, który działa sekundę i kosztuje 2 centy, to nie detal. To przewaga konkurencyjna.

Jeden krok na start: Otwórz Hugging Face, znajdź model, którego używasz (albo planujesz użyć) i sprawdź, czy ma dostępną wersję skwantyzowaną. Jeśli tak – uruchom ją lokalnie i porównaj szybkość z oryginałem. To zajmie 15 minut i pokaże Ci, czy optymalizacja ma sens w Twoim przypadku. Nie czytaj więcej artykułów – przetestuj.

Na podstawie: SukcesAI Course Material Generator

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar