Pro-Human Declaration: manifest, który nikt nie chce słuchać

Źródło: Link

Źródło: Link

90 minut praktyki na żywo. Pokazuję krok po kroku, jak zacząć z AI bez kodowania.

Moja znajoma z HR-u pokazała mi wczoraj LinkedIn – pełen postów o "odpowiedzialnym AI" i "wartościach firmy". W tym samym tygodniu jej firma podpisała umowę z dostawcą AI, który współpracuje z wojskiem. Nie widziała w tym sprzeczności.

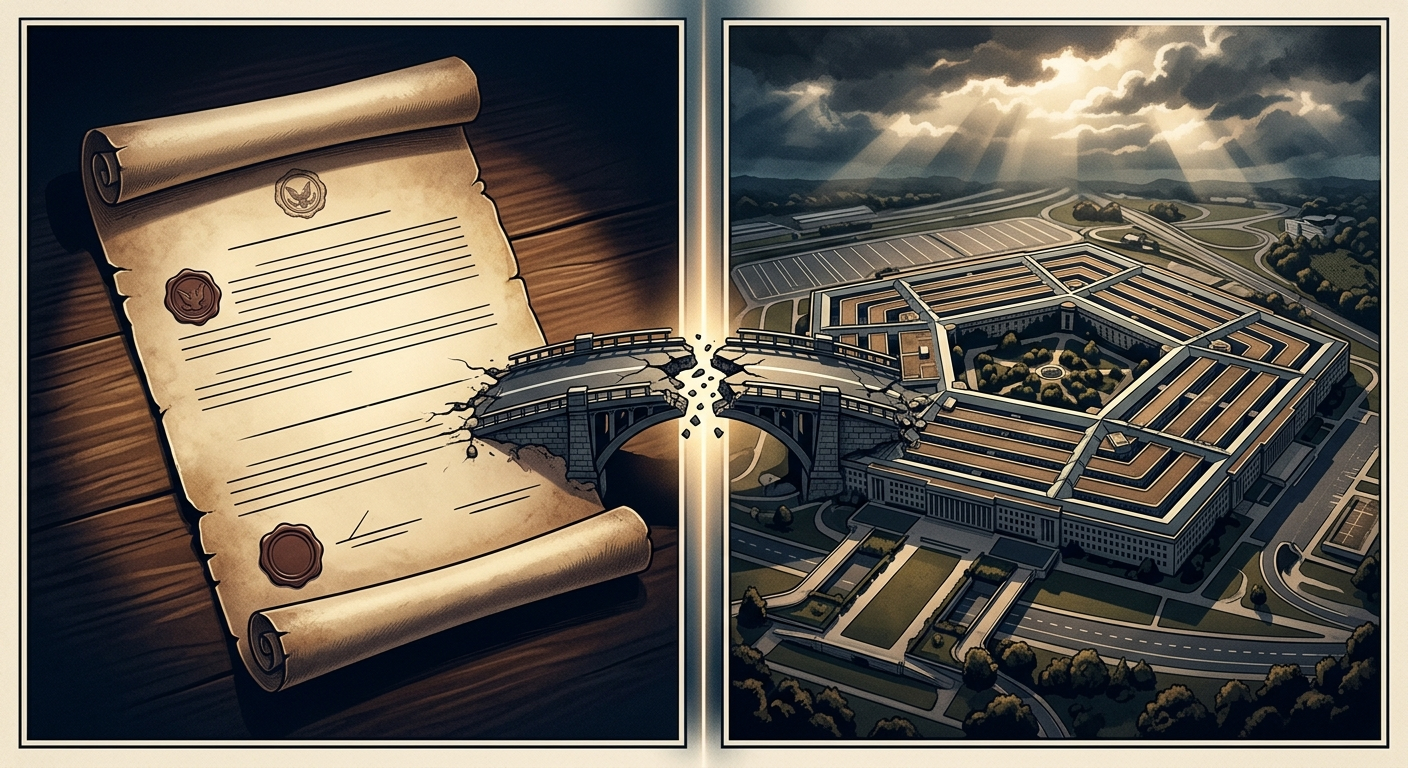

Pro-Human Declaration została sfinalizowana przed konfliktem Pentagon-Anthropic, który wybuchł w zeszłym tygodniu. Autorzy dokumentu nie musieli długo czekać na potwierdzenie, że ich manifest jest potrzebny. Nikt nie lubi słuchać niewygodnych prawd.

Pro-Human Declaration to nie kolejny zbiór ogólników o "etyce" i "odpowiedzialności". Dokument oferuje konkretną mapę drogową dla rozwoju AI, która stawia człowieka w centrum – nie jako użytkownika, ale jako podmiot, którego godność i autonomia są niepodważalne.

Timing publikacji? Nie mógł być bardziej ironiczny. W tym samym tygodniu, gdy manifest ujrzał światło dzienne, wybuchła afera wokół współpracy Anthropic z Pentagonem. Dario Amodei, CEO Anthropic, publicznie oskarżył OpenAI o kłamstwa w sprawie własnych kontraktów wojskowych. OpenAI odpowiedziało, że Anthropic też współpracuje z wojskiem.

Autorzy deklaracji nie musieli być prorokami. Branża AI od miesięcy balansuje na linie między głośnymi deklaracjami o bezpieczeństwie a cichymi kontraktami, które te deklaracje podważają.

Dokument nie ogranicza się do filozoficznych rozważań. Zawiera konkretne postulaty:

To nie są postulaty rewolucyjne. To podstawy, które powinny być oczywiste. Fakt, że trzeba je zapisywać w manifeście, mówi wszystko o stanie branży.

Deklaracja brzmi sensownie na papierze. Problem zaczyna się, gdy próbujesz ją wdrożyć w rzeczywistości, gdzie modele AI stają się coraz potężniejsze, a presja konkurencyjna wymusza szybkie tempo rozwoju.

Weź transparentność. Łatwo powiedzieć "użytkownicy muszą wiedzieć, że rozmawiają z AI". Trudniej to egzekwować, gdy Twój konkurent właśnie wypuścił model, który naśladuje styl pisania człowieka tak dobrze, że różnica znika.

Konflikt Pentagon-Anthropic wybuchł dosłownie dni po finalizacji deklaracji. To nie przypadek – to symptom. Branża AI od miesięcy żyje w stanie poznawczego dysonansu: głośno mówimy o bezpieczeństwie, cicho podpisujemy kontrakty, które to bezpieczeństwo podważają.

Anthropic budowało swoją markę na "odpowiedzialnym AI". Claude miał być bezpieczniejszą alternatywą dla ChatGPT. Współpraca z Pentagonem – nawet jeśli ograniczona do "nieofensywnych zastosowań" – to cios w tę narrację.

OpenAI przeszło podobną drogę. Zaczynali jako non-profit z misją zapewnienia, że AI będzie służyć całej ludzkości. Dziś to firma warta miliardy, której najnowsze modele są dostępne głównie dla płacących klientów korporacyjnych.

W Polsce obserwujemy ten konflikt z boku, ale nie jesteśmy od niego odizolowani. Unijne AI Act – najbardziej zaawansowana regulacja AI na świecie – próbuje narzucić część zasad zbieżnych z Pro-Human Declaration. Egzekwowanie przepisów wobec amerykańskich gigantów technologicznych to jedno. Budowanie własnego ekosystemu AI zgodnego z tymi wartościami to drugie.

Polskie firmy wdrażające AI często korzystają z modeli amerykańskich – Claude, ChatGPT, czy innych. Jeśli te modele są trenowane na danych wojskowych lub w sposób niezgodny z deklarowanymi wartościami, nie mamy nad tym kontroli.

Pro-Human Declaration dołącza do długiej listy manifestów, deklaracji i wytycznych dotyczących AI. Mamy już Partnership on AI, Montreal Declaration, Asilomar AI Principles i dziesiątki innych. Wszystkie brzmią rozsądnie. Wszystkie są w dużej mierze ignorowane.

Dlaczego? W branży AI obowiązuje prosta zasada: kto pierwszy, ten lepszy. Presja konkurencyjna jest tak silna, że etyka często schodzi na dalszy plan. System nagradza szybkość, nie ostrożność.

Manifest pojawia się w momencie, gdy branża AI stoi na rozdrożu. Z jednej strony mamy coraz potężniejsze modele, które mogą realnie zmienić sposób, w jaki pracujemy i żyjemy. Z drugiej – rosnącą przepaść między tym, co firmy AI deklarują, a tym, co robią.

Deklaracja oferuje mapę drogową. Pytanie nie brzmi "czy jest dobra" – jest. Pytanie brzmi: czy ktokolwiek będzie nią jechał, gdy skrót przez wojskowe kontrakty i luźne standardy bezpieczeństwa jest szybszy i bardziej opłacalny?

Historia sugeruje, że manifesty same w sobie nic nie zmieniają. Zmieniają je regulacje, presja publiczna i – czasem – skandale na tyle głośne, że ignorowanie ich staje się droższe niż przestrzeganie zasad. Konflikt Pentagon-Anthropic może być właśnie takim momentem. Albo kolejnym incydentem, który za tydzień wszyscy zapomną.

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar