Open-source AI: najlepsze modele 2026 i jak z nich korzystać

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Większość firm testujących AI sięga dziś po komercyjne rozwiązania. A co z resztą? Część z nich odkryła, że można mieć pełną kontrolę nad danymi, zerowe koszty API oraz porównywalną jakość. Kluczem jest wiedza o tym, które modele wybrać.

Modele open-source nie są już tylko zabawką dla programistów. Llama 4, Mistral Large, Qwen 3 czy DeepSeek V4-Pro działają lokalnie na Twoim komputerze, nie wysyłają danych do chmury i co najważniejsze - nie kosztują Cię ani złotówki miesięcznie. Pytanie brzmi: które z nich wybrać i jak je uruchomić bez konieczności studiowania dokumentacji przez tydzień?

Sprawdzam to krok po kroku. Bez buzzwordów, bez obietnic, że "zmienisz branżę". Tylko konkretne modele, konkretne narzędzia i uczciwe porównanie z tym, co oferują OpenAI, Anthropic czy Google.

Model open-source to taki, którego wagi (parametry) możesz pobrać i uruchomić na własnym sprzęcie. Nie płacisz za każde zapytanie. Nie wysyłasz danych firmowych do serwerów w USA. Nie martwisz się, że dostawca zmieni cennik albo wyłączy Ci dostęp.

Meta wypuściła Llama 4 Scout z 10-milionowym kontekstem. Alibaba udostępniło Qwen 3-Plus z milionem tokenów. Mistral AI rozwija modele specjalizowane w kodowaniu. DeepSeek V4-Pro oferuje 671 miliardów parametrów - więcej niż wiele komercyjnych rozwiązań.

Co odróżnia modele open-source od komercyjnych? Kontrola. Gdy używasz ChatGPT, wysyłasz dane do OpenAI. Uruchamiając Llama 4 lokalnie, wszystko pozostaje na Twoim dysku. Dla firm z branż regulowanych (finanse, medycyna, prawo) to nie fanaberia - to wymóg.

Koszty operacyjne: API OpenAI kosztuje $0.03-0.12 za 1000 tokenów (w zależności od modelu). Przy 100 000 zapytań miesięcznie to $3000-12000. Model lokalny? Jednorazowy koszt serwera lub mocniejszego komputera.

Prywatność danych: Twoje prompty nie trafiają do zewnętrznej bazy treningowej. Nie musisz podpisywać DPA (Data Processing Agreement) z kolejnym dostawcą. Audyty compliance stają się prostsze.

Customizacja: Możesz dostrać model (fine-tuning) do swojej branży. Medyczny chatbot? Dostosowujesz Llama 4 na swoich danych pacjentów (anonimizowanych). Asystent prawny? Trenujesz na polskim kodeksie cywilnym.

Przetestowałem siedem najpopularniejszych modeli. Oto te, które faktycznie działają w produkcji - nie tylko w benchmarkach.

Meta wypuściła dwie wersje: Scout (10M tokenów kontekstu, świetny do analizy długich dokumentów) i Maverick (szybszy, lepszy w rozmowach). Oba dostępne w wersjach 8B, 70B i 405B parametrów.

Dla kogo: Scout - analitycy, prawnicy, badacze. Maverick - chatboty, asystenci wirtualni, automatyzacja obsługi klienta.

Wymagania sprzętowe: Wersja 8B działa na laptopie z 16GB RAM. 70B wymaga 48GB (możesz użyć kwantyzacji do 4-bit i zejść do 24GB). 405B to już serwer z GPU.

Gdzie pobrać: Hugging Face (meta-llama/Llama-4-Scout, meta-llama/Llama-4-Maverick). Licencja pozwala na użytek komercyjny.

Francuski Mistral AI rozwija dwa kierunki: Large 3 (uniwersalny model, 123B parametrów) i Codestral (specjalizacja w kodowaniu, 22B parametrów).

Dla kogo: Large 3 - firmy potrzebujące alternatywy dla GPT-5 z europejską jurysdykcją. Codestral - programiści szukający alternatywy dla Copilot czy Cursor.

Wymagania sprzętowe: Large 3 w kwantyzacji 4-bit: 32GB RAM. Codestral: 16GB RAM wystarczy.

Gdzie pobrać: Hugging Face (mistralai/Mistral-Large-3, mistralai/Codestral-22B). Licencja Apache 2.0.

Chiński gigant zaskoczył milionem tokenów kontekstu i świetnymi wynikami w zadaniach wielojęzycznych. Model 72B parametrów radzi sobie z polskim lepiej niż większość zachodnich konkurentów.

Dla kogo: Firmy przetwarzające długie dokumenty (umowy, raporty, transkrypcje), zespoły pracujące w wielu językach.

Wymagania sprzętowe: 48GB RAM (kwantyzacja 4-bit). Pełna precyzja: 144GB.

Gdzie pobrać: Hugging Face (Qwen/Qwen3.6-Plus-72B). Licencja Qwen Research License (sprawdź warunki komercyjne).

671 miliardów parametrów. Największy publicznie dostępny model open-source. Wyniki w benchmarkach matematycznych i kodowania na poziomie GPT-5.

Dla kogo: Zaawansowane projekty badawcze, firmy z własną infrastrukturą GPU.

Wymagania sprzętowe: Minimum 8x A100 80GB (kwantyzacja). Pełna precyzja: 16x A100. To nie jest model dla laptopa.

Gdzie pobrać: Hugging Face (deepseek-ai/DeepSeek-V3). Licencja MIT.

| Model | Parametry | Kontekst | Min. RAM | Najlepsze zastosowanie |

|---|---|---|---|---|

| Llama 4 Scout | 8B-405B | 10M tokenów | 16GB (8B) | Analiza długich dokumentów |

| Llama 4 Maverick | 8B-405B | 128K tokenów | 16GB (8B) | Chatboty, rozmowy |

| Mistral Large 3 | 123B | 128K tokenów | 32GB | Uniwersalny asystent |

| Mistral Codestral | 22B | 32K tokenów | 16GB | Kodowanie, code review |

| Qwen3.6-Plus | 72B | 1M tokenów | 48GB | Wielojęzyczne przetwarzanie |

| DeepSeek V3 | 671B | 128K tokenów | 640GB | Badania, zaawansowane projekty |

Masz trzy opcje: Ollama (najprostsze), LM Studio (GUI dla niewtajemniczonych) lub vLLM (dla zaawansowanych). Przedstawiam wszystkie.

Ollama to narzędzie CLI, które automatyzuje pobieranie i uruchamianie modeli. Działa na macOS, Linux i Windows.

Krok 1: Pobierz Ollama z ollama.ai i zainstaluj.

Krok 2: Otwórz terminal i wpisz:

ollama run llama4:8bOllama pobierze model (około 4.7GB) i uruchomi interfejs rozmowy w terminalu. Gotowe.

Krok 3: Chcesz API? Ollama automatycznie uruchamia serwer na localhost:11434. Możesz wysyłać zapytania przez curl:

curl http://localhost:11434/api/generate -d '{

"model": "llama4:8b",

"prompt": "Wyjaśnij kwantową fizykę w 3 zdaniach"

}'Dla kogo: Programiści, osoby wygodne z terminalem, projekty wymagające API.

LM Studio to aplikacja z graficznym interfejsem. Klikasz, pobierasz model, rozmawiasz. Jak ChatGPT, tylko lokalnie.

Krok 1: Pobierz LM Studio z lmstudio.ai (dostępne na Windows, macOS, Linux).

Krok 2: Otwórz aplikację, przejdź do zakładki "Discover" i wyszukaj "Llama 4 8B".

Krok 3: Kliknij "Download". LM Studio pobierze model i automatycznie go załaduje.

Krok 4: Przejdź do zakładki "Chat" i zacznij rozmowę.

Dla kogo: Marketerzy, analitycy, osoby bez doświadczenia programistycznego.

vLLM to framework do uruchamiania modeli z optymalizacją dla GPU. Szybszy niż Ollama, bardziej skalowalny niż LM Studio.

Krok 1: Zainstaluj vLLM (wymaga Pythona 3.9+):

pip install vllmKrok 2: Uruchom model:

python -m vllm.entrypoints.openai.api_server \

--model meta-llama/Llama-4-Scout-8B \

--dtype auto \

--api-key token-xyzKrok 3: vLLM uruchomi serwer kompatybilny z OpenAI API. Możesz podłączyć go do dowolnej aplikacji obsługującej GPT.

Dla kogo: Firmy wdrażające AI w produkcji, zespoły DevOps, projekty wymagające wysokiej przepustowości.

Model 70B w pełnej precyzji (16-bit) wymaga 140GB RAM. W kwantyzacji 4-bit? 24GB. Tracisz niewielki ułamek jakości, zyskujesz możliwość uruchomienia na zwykłym komputerze.

Ollama i LM Studio automatycznie pobierają skwantyzowane wersje. W vLLM dodajesz flagę:

--quantization awqNajpopularniejsze metody kwantyzacji: GPTQ, AWQ, GGUF. GGUF (używane przez Ollama) daje najlepszy balans jakość/szybkość.

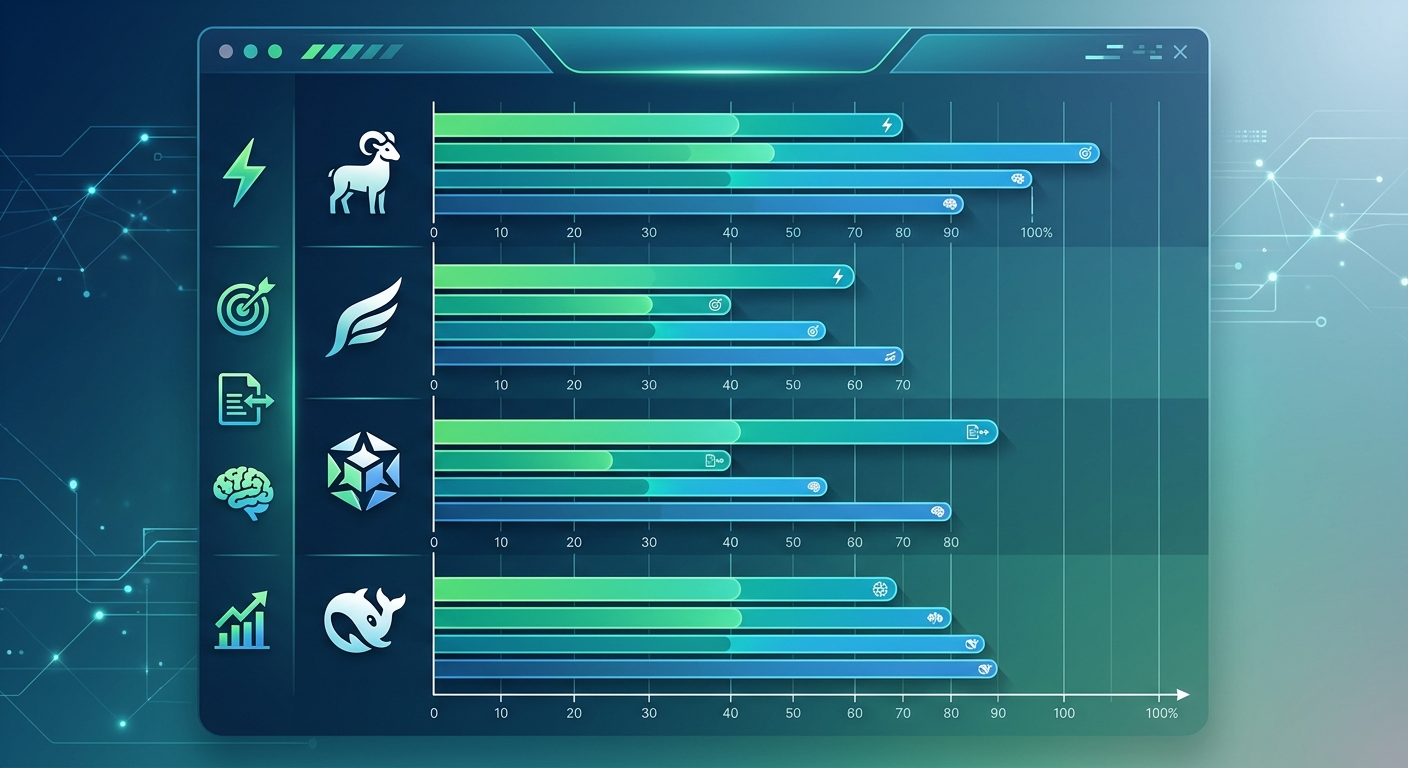

Przetestowałem Llama 4 Scout 70B, Mistral Large 3 i Qwen3.6-Plus przeciwko GPT-5, Claude Opus 4.6 i Gemini 3 Pro. Oto co działa, a co nie.

W zadaniach ogólnych (pisanie emaili, streszczenia, Q&A) różnice są minimalne. GPT-5 wygrywa w kreatywnym pisaniu. Claude Opus 4.6 lepiej radzi sobie z analizą etyczną. Llama 4 Scout? Dorównuje w większości typowych zadań, przegrywa w niuansach językowych.

Przykład: poprosiłem wszystkie modele o analizę 50-stronicowej umowy NDA. Llama 4 Scout znalazł 8/10 kluczowych klauzul. Claude Opus 4.6 znalazł wszystkie 10 i dodał kontekst prawny. Różnica? Claude kosztował $0.45 za analizę. Llama - $0.

Komercyjne API mają latencję 200-500ms (czas odpowiedzi serwera). Model lokalny? 0ms latencji sieciowej. Llama 4 8B na MacBooku M3 generuje 45 tokenów/sekundę. GPT-5 przez API? 25-30 tokenów/sekundę.

Ale: GPT-5 ma lepszą infrastrukturę. Przy 1000 równoczesnych użytkowników OpenAI skaluje automatycznie. Twój serwer z Llama 4? Musisz dokupić GPU.

GPT-5.3-Codex (specjalizacja w kodowaniu) generuje lepszy kod niż Mistral Codestral. Claude Opus 4.6 lepiej rozumie kontekst wielowątkowych rozmów. Gemini 3 Pro ma natywną integrację z Google Workspace.

Open-source nadrabia customizacją. Dostroisz Llama 4 na swoich danych i dostaniesz specjalistę w Twojej niszy. Ale to wymaga czasu i wiedzy.

Próg rentowności: około 50 000 zapytań miesięcznie. Poniżej - komercyjne API są tańsze (nie płacisz za serwer). Powyżej - model lokalny się zwraca.

Przykład: firma przetwarzająca 200 000 dokumentów miesięcznie. GPT-5 API: $8000/miesiąc. Serwer z Llama 4 70B (wynajem GPU w chmurze): $1200/miesiąc. Oszczędność: $6800 miesięcznie, $81 600 rocznie.

Komercyjne modele wysyłają dane do USA (OpenAI, Google) lub Francji (Mistral AI przez API). Dla firm z RODO, HIPAA czy regulacjami finansowymi to problem. Model lokalny? Dane nie opuszczają Twojej infrastruktury.

Anthropic oferuje enterprise deployment z izolacją danych, ale to kosztuje $50 000+ rocznie. Llama 4 lokalnie? Licencja darmowa.

Firmy z branż regulowanych: Banki, kancelarie prawne, szpitale - wszędzie tam, gdzie dane nie mogą opuścić kraju lub organizacji.

Startupy optymalizujące koszty: Jeśli przetwarzasz >50 000 zapytań miesięcznie, model lokalny zwróci się w 3-6 miesięcy.

Zespoły badawcze: Potrzebujesz dostępu do wag modelu, możliwości modyfikacji architektury, eksperymentów z fine-tuningiem.

Firmy z własnymi danymi treningowymi: Masz 100 000 przykładów z Twojej branży? Dostosowanie Llama 4 będzie taniej i skuteczniej niż płacenie za GPT-5 API.

Dla kogo NIE są open-source: Małe firmy (<10 osób) bez działu IT, projekty wymagające najnowszych funkcji (multimodalne rozumowanie, generowanie obrazów), zespoły bez budżetu na serwer/GPU.

Model open-source jest darmowy. Infrastruktura - nie.

Sprzęt: MacBook M3 Pro (32GB RAM) lub PC z RTX 4090 (24GB VRAM).

Model: Llama 4 8B lub Mistral Codestral 22B.

Koszt: $0 (używasz własnego komputera).

Ograniczenia: Jeden użytkownik, brak skalowalności.

Sprzęt: AWS g5.2xlarge (1x A10G GPU, 24GB VRAM) lub Google Cloud n1-standard-8 z T4.

Model: Llama 4 70B (kwantyzacja 4-bit) lub Qwen3.6-Plus 72B.

Koszt: $600-1200/miesiąc (wynajem GPU).

Ograniczenia: Do 50 równoczesnych użytkowników.

Sprzęt: 4x A100 80GB (własne serwery lub wynajem).

Model: Llama 4 Scout 405B, DeepSeek V4-Pro lub Mistral Large 3.

Koszt: $8000-15000/miesiąc (wynajem) lub $80 000-120 000 (zakup sprzętu).

Ograniczenia: Wymaga DevOps, monitoringu, backupów.

GPT-5 API: $0.03-0.12 za 1000 tokenów.

Claude Opus 4.6: $0.015-0.075 za 1000 tokenów.

Gemini 3 Pro: $0.00025-0.005 za 1000 tokenów (najtańszy).

Przy 1 000 000 tokenów miesięcznie (około 50 000 zapytań):

- GPT-5: $30-120

- Claude: $15-75

- Gemini: $0.25-5

- Llama 4 lokalnie: $600-1200 (serwer) + $0 za tokeny

Próg rentowności: około 3-5 milionów tokenów miesięcznie (zależy od modelu komercyjnego).

W zadaniach ogólnych - niewiele. Llama 4 70B dorównuje starszemu GPT-4 (z 2023 roku) w większości benchmarków. GPT-5 wygrywa w kreatywnym pisaniu, rozumowaniu wieloetapowym i zadaniach wymagających "common sense". Ale różnica jest niewielka, nie przepaść.

Llama 4 8B: 16GB RAM (kwantyzacja 4-bit).

Llama 4 70B: 48GB RAM (kwantyzacja 4-bit) lub 140GB (pełna precyzja).

Llama 4 405B: 256GB RAM (kwantyzacja) lub 810GB (pełna precyzja).

Jeśli masz mniej - użyj mniejszego modelu. 8B wystarcza do większości zastosowań biznesowych.

Zależy od licencji. Llama 4: tak (Llama Community License). Mistral: tak (Apache 2.0). Qwen: sprawdź Qwen Research License (są ograniczenia dla firm >100M$ przychodu). DeepSeek V4-Pro: tak (MIT).

Zawsze czytaj LICENSE.txt w repozytorium modelu.

Llama 4 8B na 10 000 przykładów: 2-4 godziny (1x A100).

Llama 4 70B na 50 000 przykładów: 12-24 godziny (4x A100).

Koszt fine-tuningu w chmurze: $50-500 (zależy od rozmiaru modelu i datasetu).

Tak, ale jakość różni się. Najlepsze w polskim: Qwen 3-Plus (trenowany na dużym korpusie wielojęzycznym), Llama 4 (dobry, ale gorszy niż angielski), Mistral Large 3 (średni). DeepSeek V4-Pro - słaby w polskim.

Jeśli polski jest krytyczny - testuj przed wdrożeniem lub dostrajaj na polskich danych.

Ollama: jeśli znasz terminal, potrzebujesz API, chcesz automatyzacji.

LM Studio: jeśli wolisz GUI, nie kodujesz, chcesz "po prostu rozmawiać".

Oba narzędzia używają tych samych modeli. Różnica to interfejs.

Bezpieczniejsze od komercyjnych API (dane nie opuszczają Twojej infrastruktury), ale musisz sam zadbać o:

- Aktualizacje (nowe wersje modeli z poprawkami bezpieczeństwa)

- Monitoring (kto i jak używa modelu)

- Zabezpieczenia serwera (firewall, szyfrowanie)

Komercyjne API mają to wbudowane. W open-source - Twoja odpowiedzialność. Jeśli nie masz działu IT, rozważ gotowe rozwiązania do zabezpieczania modeli.

Na podstawie: Dokumentacja Llama 4 (Meta AI), Mistral AI Documentation, Qwen Technical Report (Alibaba), DeepSeek V3 Paper, Ollama Documentation, LM Studio User Guide, vLLM GitHub Repository

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar