Jak działa Swin Transformer – przewodnik dla początkujących

Źródło: Link

Źródło: Link

118 lekcji bez kodowania. ChatGPT, Claude, Gemini, automatyzacje. Notatnik AI i AI Coach w cenie.

Otwierasz Instagram, przewijasz feed – i za każdym razem widzisz idealnie wykadrowne zdjęcia, automatyczne filtry, które "wiedzą" co poprawić. Albo skanujesz dokumenty telefonem, a AI od razu rozpoznaje tekst i usuwa tło. Jak to działa? Za kulisami często stoi architektura zwana Swin Transformer.

To konkretna technologia z 2021 roku, która sprawiła, że wizja komputerowa AI – czyli zdolność maszyn do "rozumienia" obrazów – zrobiła skok jakościowy. I nie musisz być programistą, żeby zrozumieć, jak to działa i dlaczego ma to znaczenie dla Twojej codziennej pracy.

W tym przewodniku rozłożymy Swin Transformer na czynniki pierwsze – prostym językiem, z konkretnymi przykładami. Pokażę Ci, gdzie już się z nim spotykasz (nawet o tym nie wiedząc) i jak możesz go wykorzystać w praktyce.

Zacznijmy od podstaw. Transformery AI to rodzaj architektury sieci neuronowej, która początkowo była używana głównie do przetwarzania tekstu – to one stoją za dużymi modelami językowymi LLM typu GPT-5 czy Claude Opus 4.7. Świetnie radziły sobie z analizowaniem słów i zdań. Ale kiedy ktoś próbował zastosować je do obrazów, pojawiły się problemy.

Tekst to sekwencja słów – czytasz od lewej do prawej, jedno po drugim. Obraz to matryca pikseli – miliony punktów, które muszą być analizowane jednocześnie, w różnych skalach. Zoom na twarz? Zoom na całe zdjęcie? To zupełnie inne informacje.

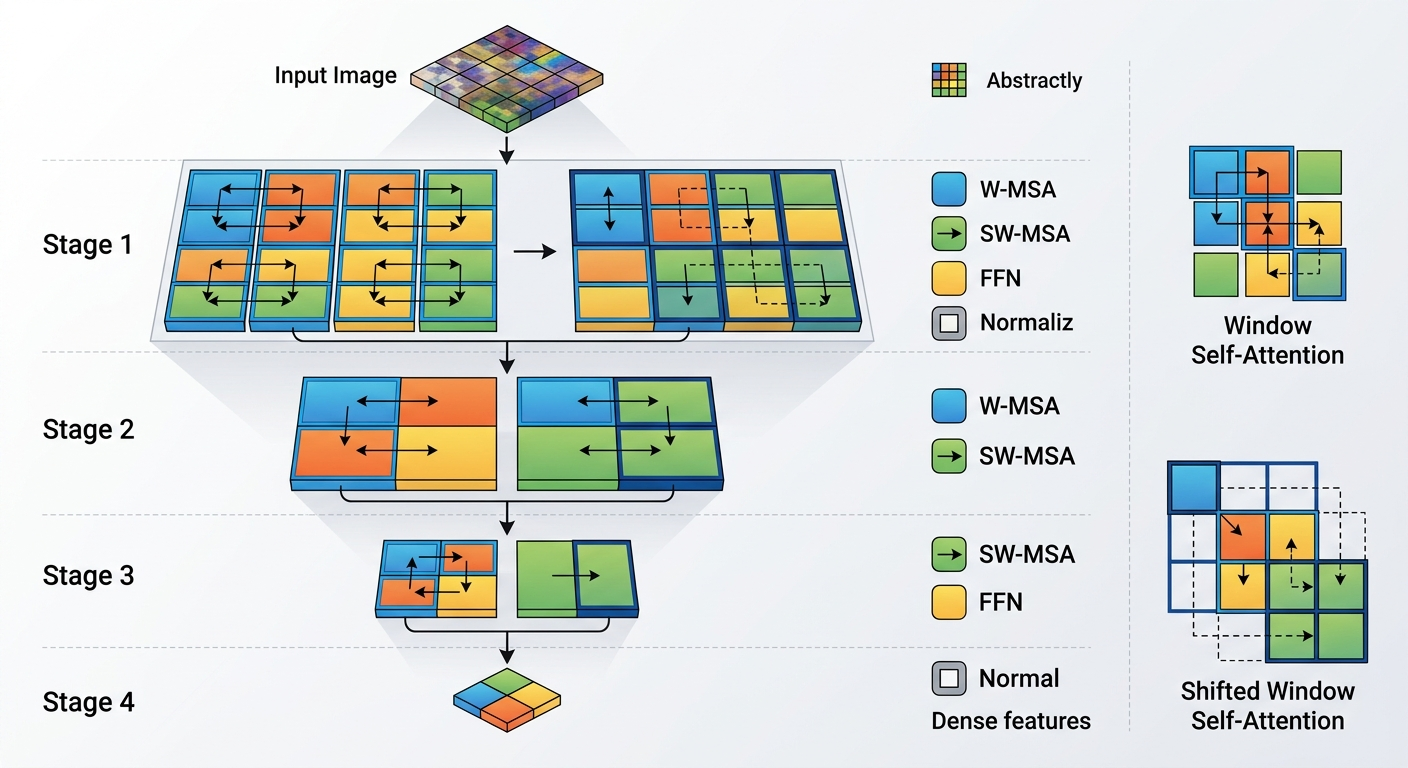

Swin Transformer ("Shifted Window Transformer") rozwiązał ten problem przez podejście zwane "hierarchicznym przetwarzaniem z przesuniętymi oknami". Rozbijmy to:

Efekt? AI widzi zarówno "las" (cały obraz), jak i "drzewa" (detale) – i robi to szybciej niż starsze metody.

Dobra wiadomość: żeby używać narzędzi opartych na Swin Transformer, nie musisz nic instalować ani kodować. Jeśli korzystasz z aplikacji do edycji zdjęć, narzędzi do OCR (rozpoznawania tekstu) czy platform analitycznych – prawdopodobnie już to robisz.

Jeśli chcesz świadomie wybierać narzędzia albo eksperymentować z modelami AI, przydadzą Ci się podstawy:

Ale powtarzam: to opcje dla ciekawskich. Większość ludzi korzysta z Swin Transformer przez gotowe aplikacje – nie wiedząc, że to właśnie ta technologia pracuje w tle.

Oto konkretne przykłady zastosowań, które prawdopodobnie znasz:

Wrzucasz zdjęcie do Google Photos, a ono automatycznie taguje "pies", "plaża", "zachód słońca". Albo używasz aplikacji do edycji, która sama usuwa tło – rozpoznaje, gdzie jest osoba, a gdzie reszta kadru. To właśnie wizja komputerowa AI oparta na architekturach typu Swin Transformer.

Dlaczego to działa lepiej niż starsze metody? Bo Swin Transformer "rozumie" kontekst – widzi, że pies na pierwszym planie to coś innego niż trawa w tle, nawet jeśli kolory są podobne.

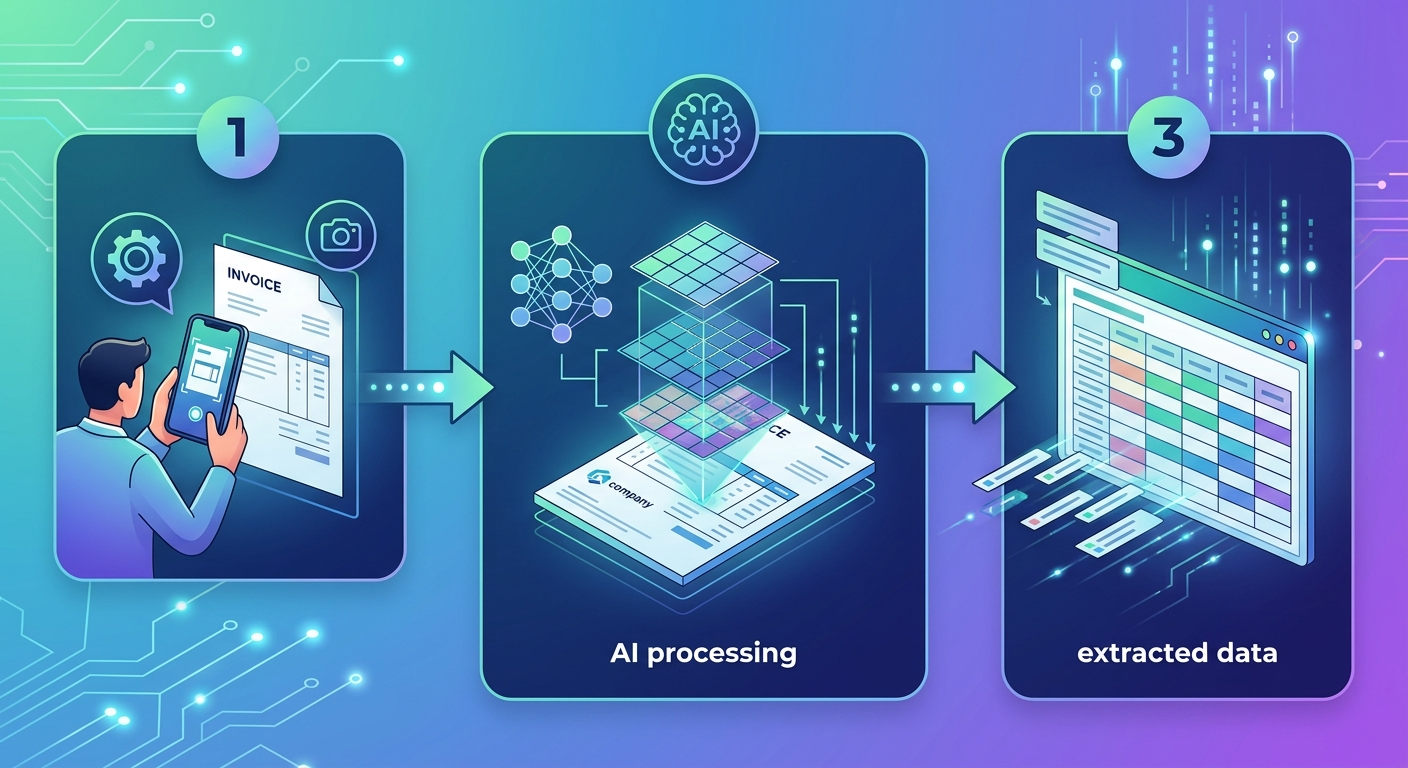

Skanujesz fakturę telefonem, a aplikacja od razu wyciąga numer rachunku, datę, kwotę. Albo robisz zdjęcie wizytówki, a kontakt ląduje w telefonie. To OCR (Optical Character Recognition) – i najnowsze systemy używają właśnie Swin Transformer do analizy układu dokumentu.

Stare OCR-y czytały tekst linia po linii. Swin Transformer "widzi" całą stronę naraz – rozpoznaje nagłówki, tabele, podpisy pod obrazkami. Dlatego radzi sobie z chaotycznymi fakturami czy odręcznymi notatkami.

Lekarze używają AI do analizy zdjęć RTG, tomografii, MRI. Swin Transformer pomaga wykrywać anomalie – guzy, pęknięcia kości, zmiany w tkankach – często szybciej i dokładniej niż ludzkie oko.

Tu hierarchiczne przetwarzanie ma kluczowe znaczenie: AI musi zobaczyć zarówno cały narząd (kontekst), jak i drobne zmiany w tkance (detale). Swin Transformer robi to jednocześnie.

OK, teoria za nami. Teraz konkretne działania, które możesz wykonać dzisiaj – bez kodowania, bez instalacji skomplikowanych narzędzi.

Hugging Face to platforma z tysiącami gotowych modeli AI – w tym Swin Transformer. Możesz je testować bezpośrednio w przeglądarce.

Model zwróci Ci wyniki – na przykład "dog: 95%, grass: 78%, outdoor: 92%". To AI analizuje Twoje zdjęcie w czasie rzeczywistym.

Jeśli chcesz dowiedzieć się więcej o podstawach pracy z transformerami, sprawdź nasz artykuł Jak zrozumieć transformery AI dzięki Jayowi Alammarowi – tam znajdziesz wizualizacje, które ułatwiają zrozumienie mechanizmu.

Masz setki zdjęć z wakacji, eventów, projektów – i zero czasu na ręczne tagowanie? Swin Transformer zrobi to za Ciebie.

Zamiast przeszukiwać 500 zdjęć ręcznie, znajdujesz to, czego potrzebujesz, w 3 sekundy.

Jeśli pracujesz z fakturami, umowami, raportami – OCR oparty na Swin Transformer oszczędzi Ci godziny.

Przykład z życia: zamiast przepisywać 20 faktur ręcznie (2 godziny), robisz zdjęcia telefonem i AI wyciąga wszystkie dane w 5 minut. Jeśli szukasz więcej sposobów na automatyzację pracy, zobacz Jak oszczędzić 2 godziny dziennie dzięki AI do pisania maili.

Segmentacja to proces "wycinania" obiektów z tła – przydatne w e-commerce (zdjęcia produktów), marketingu (grafiki do social media), designie.

Alternatywa: jeśli masz dostęp do Photoshopa, użyj funkcji "Select Subject" – to też AI, często oparte na Swin Transformer lub podobnych architekturach.

Może się zastanawiasz: skoro Swin Transformer to technologia z 2021 roku, czy w kwietniu 2026 nie jest już przestarzały? Odpowiedź: nie do końca.

Swin Transformer nadal jest używany jako backbone (podstawa) w wielu nowszych systemach – zwłaszcza tam, gdzie liczy się równowaga między dokładnością a szybkością. Oto porównanie z innymi popularnymi architekturami:

Kluczowa różnica? Swin Transformer to open-source – możesz go pobrać, zmodyfikować, wdrożyć we własnym projekcie. Gemini 3.1 czy GPT-5 Vision to API – płacisz za każde zapytanie, nie masz kontroli nad modelem.

Jeśli interesuje Cię, jak duże modele językowe LLM przechowują i przetwarzają informacje (podobny mechanizm działa w transformerach wizualnych), sprawdź Jak duże modele językowe przechowują fakty – przewodnik.

Zanim zaczniesz eksperymentować, oto trzy rzeczy, które mogą Cię zaskoczyć:

Nie rozwiąże. To świetna architektura, ale nie uniwersalna. Jeśli masz do czynienia z bardzo małymi obiektami (na przykład wykrywanie defektów w produkcji przemysłowej na poziomie mikrometrów), specjalizowane CNN (sieci konwolucyjne) mogą być lepsze.

Swin Transformer świetnie radzi sobie z obrazami naturalnymi (zdjęcia, sceny, ludzie), gorzej z ekstremalnymi przypadkami (satelity, mikroskopy).

Technicznie tak, ale praktycznie – nie. Trening Swin Transformer od zera wymaga potężnego GPU (karty graficznej) i dni/tygodni obliczeń. Jeśli nie masz dostępu do chmury (Google Colab, AWS) lub własnego klastra GPU – lepiej użyj gotowego modelu z Hugging Face.

Fine-tuning (dostrajanie gotowego modelu do Twojego zadania) to inna sprawa – to możesz zrobić na przyzwoitym laptopie z GPU w kilka godzin. Trening od zera? Zostaw to badaczom.

Nie rozpozna. Swin Transformer (jak każdy model AI) ma ograniczenia – zwłaszcza przy nietypowych kątach, słabym oświetleniu, obiektach, których nie widział w danych treningowych.

Przykład: jeśli wytrenowałeś model na zdjęciach psów, a potem pokażesz mu wilka – może go sklasyfikować jako psa (bo są podobne). AI nie "rozumie" świata – dopasowuje wzorce.

Dlatego zawsze weryfikuj wyniki – zwłaszcza w krytycznych zastosowaniach (medycyna, bezpieczeństwo). Jeśli interesuje Cię, jak AI uczy się rozpoznawać wzorce, przeczytaj Jak nauczyć sieć neuronową pisać teksty – przewodnik RNN – mechanizm jest podobny.

Oto prosta lista decyzyjna:

Użyj Swin Transformer, jeśli:

Szukaj alternatywy, jeśli:

Jeśli zastanawiasz się, jak wizja komputerowa AI wpisuje się w szerszy kontekst uczenia maszynowego, zobacz Jak działa uczenie ze wzmocnieniem w dużych modelach językowych – tam wyjaśniamy, jak AI uczy się przez feedback.

Nie do końca. ChatGPT (GPT-5) to duży model językowy LLM – przetwarzanie tekstu. Swin Transformer to architektura do wizji komputerowej – przetwarzanie obrazów. Oba używają mechanizmu transformerów (stąd podobna nazwa), ale działają na różnych danych. Nowsze modele multimodalne (Gemini 3.1, GPT-5 Vision) łączą oba podejścia – mogą analizować tekst i obrazy jednocześnie.

Tak. Większość aplikacji (Google Photos, Adobe Lightroom, narzędzia OCR) używa Swin Transformer lub podobnych architektur "pod maską" – nie musisz pisać ani linijki kodu. Jeśli chcesz eksperymentować bezpośrednio z modelem, Hugging Face pozwala testować go w przeglądarce (krok 1 z sekcji "Jak wykorzystać w praktyce"). Kodowanie potrzebne jest tylko, jeśli chcesz wdrożyć własne rozwiązanie od podstaw.

Sama architektura i pretrenowane modele – tak, są open-source (licencja Apache 2.0). Możesz je pobrać z Hugging Face i używać bez opłat. Jeśli chcesz trenować własny model od zera, potrzebujesz mocy obliczeniowej (GPU) – a to już kosztuje (chyba że masz własny sprzęt). Gotowe API (Google Vision, Azure) są płatne – płacisz za liczbę zapytań.

Swin Transformer sam w sobie nie "rozumie" tekstu – analizuje tylko piksele. W połączeniu z OCR (rozpoznawanie tekstu) może wykrywać obszary z tekstem, a potem inny model (na przykład Tesseract OCR lub Google Vision API) czyta ten tekst. Polskie znaki (ą, ę, ł) są obsługiwane przez większość nowoczesnych OCR-ów – ale jakość zależy od jakości obrazu i czcionki.

Nie zastąpi – uzupełni. W zadaniach rutynowych (tagowanie zdjęć, wykrywanie defektów, OCR) AI jest szybsze i tańsze. W sytuacjach wymagających kontekstu, etyki, kreatywności – człowiek nadal jest niezbędny. Przykład: AI może wykryć guz na zdjęciu RTG, ale decyzję o leczeniu podejmuje lekarz. Swin Transformer to narzędzie, nie zamiennik dla ludzkiego osądu.

Ten poradnik to dopiero początek. W naszym kursie "Praktyczna AI" nauczysz się korzystać z ChatGPT, Claude i innych narzędzi AI w sposób systematyczny — od zera do zaawansowanego poziomu.

Sprawdź kurs →Swin Transformer to architektura AI do analizy obrazów, która łączy hierarchiczne przetwarzanie z przesuwanymi oknami – dzięki temu "widzi" zarówno całość, jak i detale. Używasz jej prawdopodobnie codziennie (Google Photos, OCR, automatyczne usuwanie tła), nawet jeśli nie zdajesz sobie z tego sprawy.

Kluczowe zalety:

Ograniczenia:

Jeden krok na start: Wejdź dzisiaj na Hugging Face, wyszukaj "Swin Transformer image-classification", wgraj dowolne zdjęcie i zobacz, jak AI je analizuje. Zajmie Ci to 5 minut – i od razu zobaczysz, jak działa technologia, o której właśnie przeczytałeś. Eksperymentuj teraz.

Na podstawie: SukcesAI Course Material

Podoba Ci się ten artykuł?

Co piątek wysyłam podsumowanie najlepszych artykułów tygodnia. Zapisz się!

90 minut praktycznej wiedzy o AI. Pokaze Ci krok po kroku, jak zaczac oszczedzac 10 godzin tygodniowo dzieki sztucznej inteligencji.

Zapisz sie na webinar